爬虫—分析Ajax爬取今日头条图片

以今日头条为例分析Ajax请求抓取网页数据。本次抓取今日头条的街拍关键字对应的图片,并保存到本地

一,分析

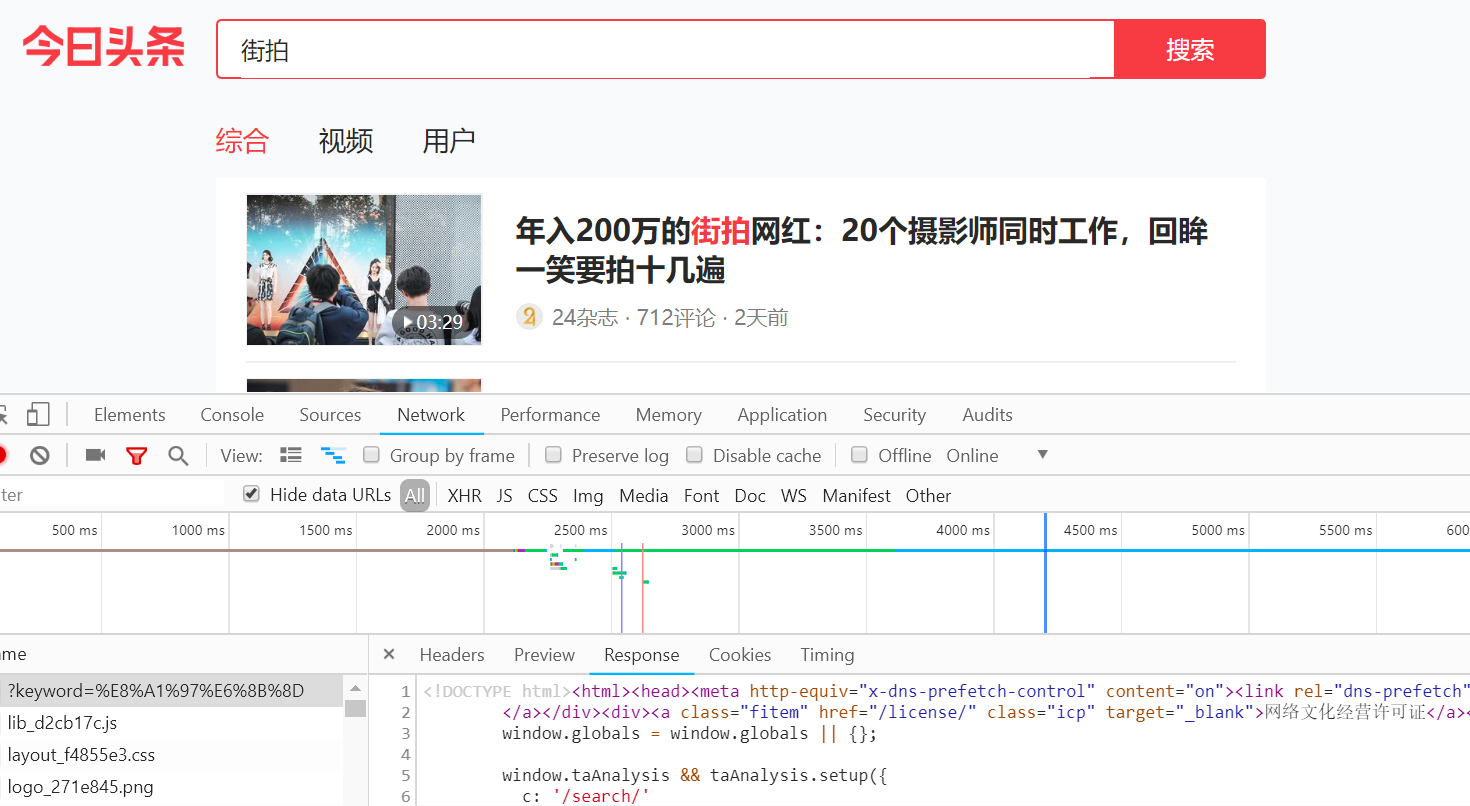

打开今日头条主页,在搜索框中输入街拍二字,打开开发者工具,发现浏览器显示的数据不在其源码里面。这样可以出初步判断这些内容是由

Ajax加载,然后使用JavaScript渲染出来的。

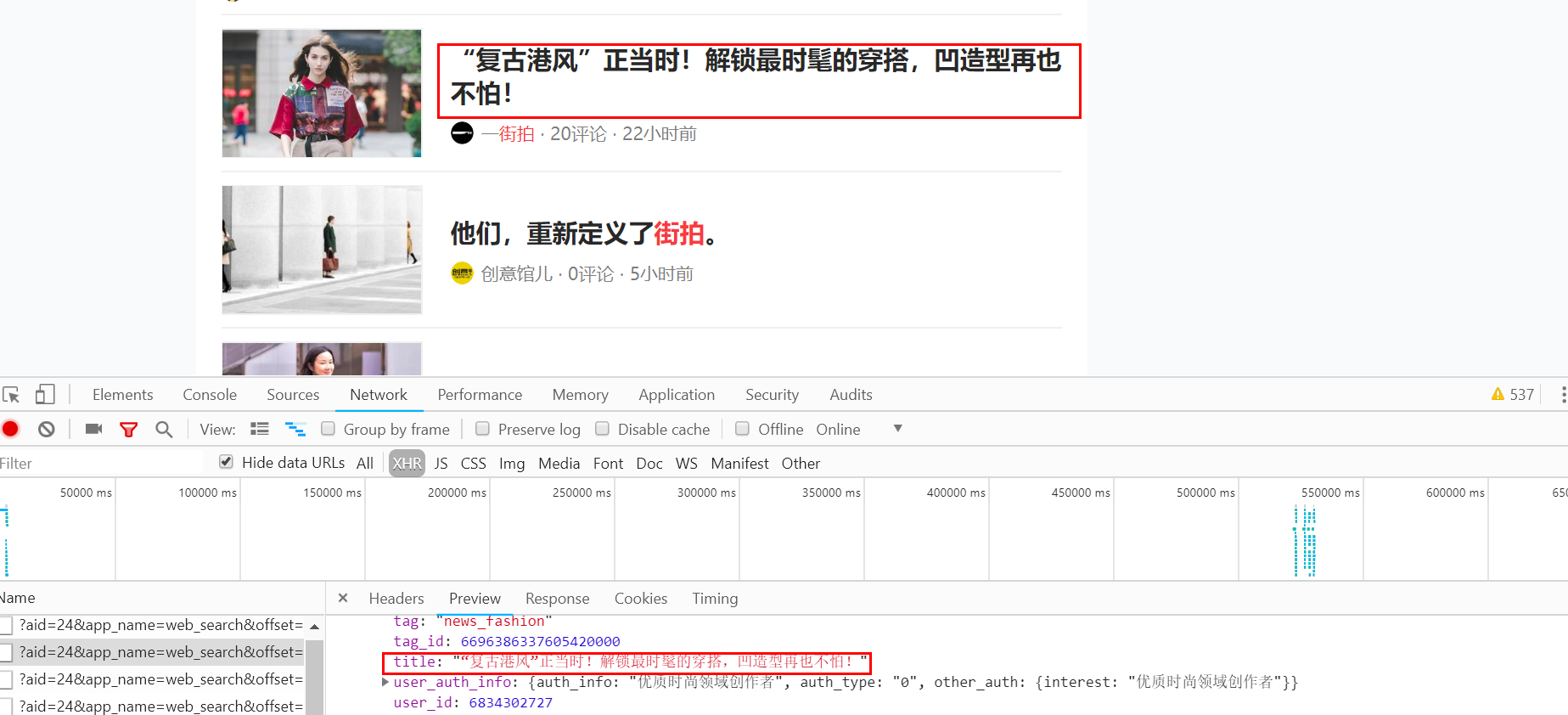

切换到XHR过滤选项卡,查看其Ajax请求。点击其中一条进去,进入data展开,发现其中一个title字段对应的值正好是页面中的某条数据的标题。再查看其他数据,正好也是一一对应的,这说明这些数据确实是由Ajax加载的。

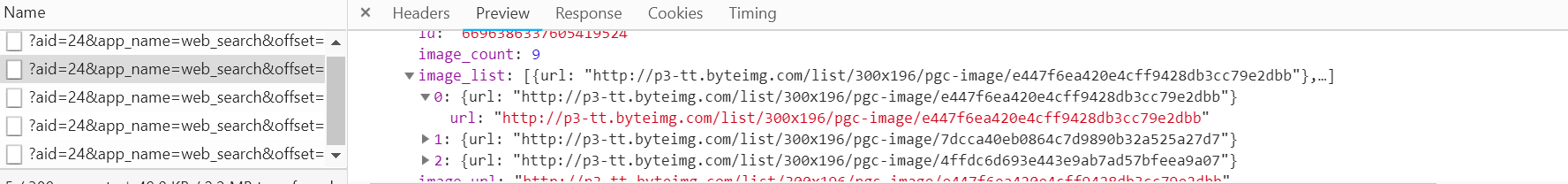

本次的目的是抓取其中的图片内容,data中每个元素就是一篇文章,元素中的image_list字段包含了该文章的图片内容。它是一个列表形式,包含了所有的图片列表。我们只需要将列表中的url字段下载下来就好了,每篇文章都创建一个文件夹,文件夹名称即文章标题。

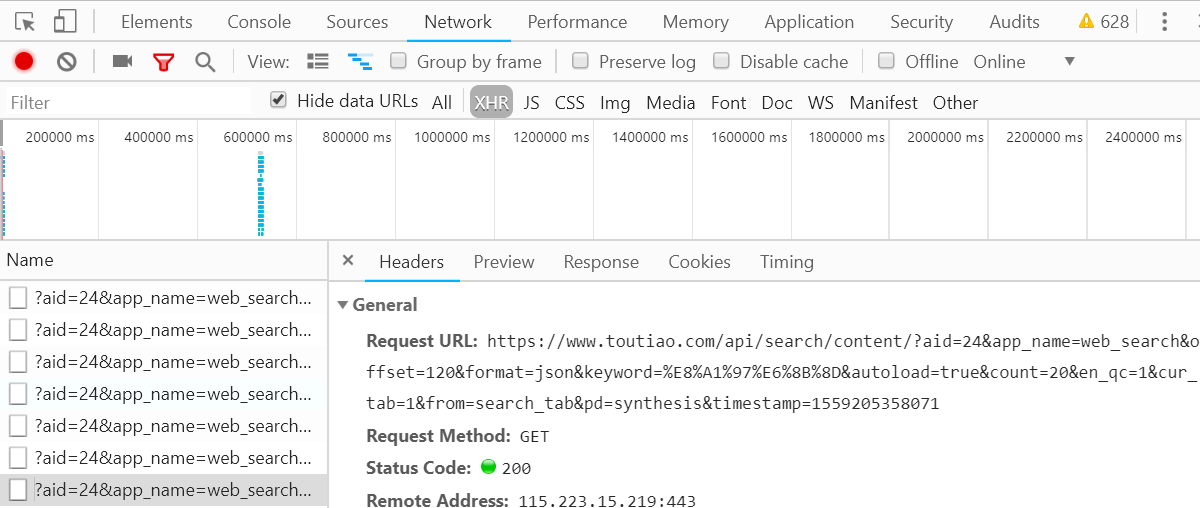

在使用Python爬取之前还需要分析一下URL的规律。切换到Headers选项卡,查看Headers信息。可以看到,这是一个GET请求,请求的参数有aid,app_name,offset,format,keyword,autoload,count,en_qc,cur_tab,from,pd,timestamp。继续往下滑动,多加载一些数据,找出其中的规律。

经过观察,可以发现变化的参数只有offset,timestamp。第一次请求的offset的值为0,第二次为20,第三次为40,key推断出这个offset就是偏移量,count为每次请求的数据量,而timestamp为时间戳。这样一来,我们就可以使用offset参数控制分页了,通过模拟Ajax请求获取数据,最后将数据解析后下载即可。

二,爬取

刚才已经分析完了整个Ajax请求,接下来就是使用代码来实现这个过程。

# _*_ coding=utf-8 _*_ import requests

import time

import os

from hashlib import md5

from urllib.parse import urlencode

from multiprocessing.pool import Pool def get_data(offset):

"""

构造URL,发送请求

:param offset:

:return:

"""

timestamp = int(time.time())

params = {

'aid': '',

'app_name': 'web_search',

'offset': offset,

'format': 'json',

'autoload': 'true',

'count': '',

'en_qc': '',

'cur_tab': '',

'from': 'search_tab',

'pd': 'synthesis',

'timestamp': timestamp

} base_url = 'https://www.toutiao.com/api/search/content/?keyword=%E8%A1%97%E6%8B%8D'

url = base_url + urlencode(params)

try:

res = requests.get(url)

if res.status_code == 200:

return res.json()

except requests.ConnectionError:

return '555...' def get_img(data):

"""

提取每一张图片连接,与标题一并返回,构造生成器

:param data:

:return:

"""

if data.get('data'):

page_data = data.get('data')

for item in page_data:

# cell_type字段不存在的这类文章不爬取,它没有title,和image_list字段,会出错

if item.get('cell_type') is not None:

continue

title = item.get('title').replace(' |', ' ') # 去掉某些可能导致文件名错误而不能创建文件的特殊符号,根据具体情况而定

imgs = item.get('image_list')

for img in imgs:

yield {

'title': title,

'img': img.get('url')

} def save(item):

"""

根据title创建文件夹,将图片以二进制形式写入,

图片名称使用其内容的md5值,可以去除重复的图片

:param item:

:return:

"""

img_path = 'img' + '/' + item.get('title')

if not os.path.exists(img_path):

os.makedirs(img_path)

try:

res = requests.get(item.get('img'))

if res.status_code == 200:

file_path = img_path + '/' + '{name}.{suffix}'.format(

name=md5(res.content).hexdigest(),

suffix='jpg')

if not os.path.exists(file_path):

with open(file_path, 'wb') as f:

f.write(res.content)

print('Successful')

else:

print('Already Download')

except requests.ConnectionError:

print('Failed to save images') def main(offset):

data = get_data(offset)

for item in get_img(data):

print(item)

save(item) START = 0

END = 10

if __name__ == "__main__":

pool = Pool()

offsets = ([n * 20 for n in range(START, END + 1)])

pool.map(main, offsets)

pool.close()

pool.join()

这里定义了起始页START和结束页END,可以自定义设置。然后利用多进程的进程池,调用map()方法实现多进程下载。运行之后发现图片都报存下来了。

爬虫—分析Ajax爬取今日头条图片的更多相关文章

- 【Python3网络爬虫开发实战】 分析Ajax爬取今日头条街拍美图

前言本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理.作者:haoxuan10 本节中,我们以今日头条为例来尝试通过分析Ajax请求 ...

- 分析Ajax爬取今日头条街拍美图-崔庆才思路

站点分析 源码及遇到的问题 代码结构 方法定义 需要的常量 关于在代码中遇到的问题 01. 数据库连接 02.今日头条的反爬虫机制 03. json解码遇到的问题 04. 关于response.tex ...

- 用Ajax爬取今日头条图片集

Ajax原理 在用requests抓取页面时,得到的结果可能和浏览器中看到的不一样:在浏览器中可以正常显示的页面数据,但用requests得到的结果并没有.这是因为requests获取的都是原始 ...

- 【Python3网络爬虫开发实战】6.4-分析Ajax爬取今日头条街拍美图【华为云技术分享】

[摘要] 本节中,我们以今日头条为例来尝试通过分析Ajax请求来抓取网页数据的方法.这次要抓取的目标是今日头条的街拍美图,抓取完成之后,将每组图片分文件夹下载到本地并保存下来. 1. 准备工作 在本节 ...

- 转:【Python3网络爬虫开发实战】6.4-分析Ajax爬取今日头条街拍美图

[摘要] 本节中,我们以今日头条为例来尝试通过分析Ajax请求来抓取网页数据的方法.这次要抓取的目标是今日头条的街拍美图,抓取完成之后,将每组图片分文件夹下载到本地并保存下来. 1. 准备工作 在本节 ...

- 分析AJAX抓取今日头条的街拍美图并把信息存入mongodb中

今天学习分析ajax 请求,现把学得记录, 把我们在今日头条搜索街拍美图的时候,今日头条会发起ajax请求去请求图片,所以我们在网页源码中不能找到图片的url,但是今日头条网页中有一个json 文件, ...

- 关于爬虫的日常复习(9)—— 实战:分析Ajax抓取今日头条接拍美图

- 分析Ajax抓取今日头条街拍美图

spider.py # -*- coding:utf-8 -*- from urllib import urlencode import requests from requests.exceptio ...

- python爬取今日头条图片

import requests from urllib.parse import urlencode from requests import codes import os # qianxiao99 ...

随机推荐

- Linux scp 后台运行传输文件

Linux scp 设置nohup后台运行 1.正常执行scp命令 2.输入ctrl + z 暂停任务 3.bg将其放入后台 4.disown -h 将这个作业忽略HUP信号 5.测试会话中断,任务继 ...

- 【原创】你知道Oracle 10G能存多少数据吗

昨天晚上在看Oracle 10G联机文档中关于bigfile tablespaces的描述(引用1),发现了关于Oracle存储极限的简单描述.bigfile tablespaces的存在,让Orac ...

- 终极解决VS2015 安装失败问题,如 安装包损坏或丢失

1.去微软官网下载完成ISO镜像,最好不要在线安装, 打开官方链接 https://www.visualstudio.com/zh-cn/downloads/download-visual-studi ...

- SmartUpload实现文件上传

(一)SmartUpload组件简介 SmartUpload组件 专门用于实现文件上传及下载的免费组件 (二)SmartUpload组件特点 使用简单:编写少量代码,完成上传下载功能 能够控制上传 ...

- dubbo之上下文信息

上下文信息 上下文中存放的是当前调用过程中所需的环境信息.所有配置信息都将转换为 URL 的参数,参见 schema 配置参考手册 中的对应URL参数一列. RpcContext 是一个 Thread ...

- java这个404你能解决吗?

前言 本文首发于公众号[我的小碗汤]本公众号免费提供csdn下载服务,海量IT学习资源,如果你准备入IT坑,励志成为优秀的程序猿,那么这些资源很适合你,包括但不限于java.go.python.spr ...

- <转>c++引用与指针的区别(着重理解)

★ 相同点: 1. 都是地址的概念: 指针指向一块内存,它的内容是所指内存的地址:引用是某块内存的别名. ★ 区别: 1. 指针是一个实体,而引用仅是个别名: 2. 引用使用时无需解引用(*),指 ...

- 上传菜品数据&生成点餐二维码

基础数据上传 在门店助手打开数据上传功能,点击上传到微餐厅3.0,,即将门店本地的基础数据上传到线上. 注意1:上传前,需要在线下系统维护好基础数据 注意2:线下基础数据发生更改时,需要手动在门店助手 ...

- python 直接存入Excel表格

def write_excels(self, document): outwb = openpyxl.Workbook() outws = outwb.create_sheet(index=0) fo ...

- ios开发——runtime

首先,最重要的一点,学runtime能干嘛? 1.使用runtime改变变量值 2.使用runtime交换方法 3.使用runtime添加方法 4.使用runtime给分类扩展属性 学了runtime ...