线性回归(linear regression)

基本形式

最小二乘法估计拟合参数

最小二乘法:基于均方误差最小化来进行模型求解的方法称为“最小二乘法”(least square method)

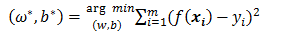

即 (左边代表 $\mathbf{\omega }$ 和 b 的解)

(左边代表 $\mathbf{\omega }$ 和 b 的解)

为了计算的方便,可以把常数 b 看出一个特殊的值为 1 的 x 。

将 $\mathbf{\omega }$ 和 b 吸收入向量形式 ,如下所示:

,如下所示:

$X = \begin{pmatrix}

x_{11} &x_{12} &... &x_{1d} &1\\

x_{21} &x_{2} &... &x_{2d} &1\\

\vdots &\vdots &\ddots &\vdots &\vdots \\

x_{m1} &x_{m2} &... &x_{md} &1

\end{pmatrix} = \begin{pmatrix}

\mathbf{x_{1}^{T}}& 1\\

\mathbf{x_{2}^{T}}&1 \\

\vdots & \vdots \\

\mathbf{x_{m}^{T}}& 1

\end{pmatrix}$

把标记也写成向量形式$\mathbf{y}=(y_{1};y_{2};...;y_{m})$,则参数的求解为:

$ \hat{\mathbf{\omega} }^{*}=_{\hat{\mathbf{\omega} }}^{arg\ min}\ \textrm{}(\mathbf{y}-\mathbf{X}\hat{\mathbf{\omega} })^{T}(\mathbf{y}-\mathbf{X\hat{\mathbf{\omega} }})$

令$E_{\hat{\mathbf{\omega} }}=(\mathbf{y}-\mathbf{X}\hat{\mathbf{\omega} })^{T}(\mathbf{y}-\mathbf{X\hat{\mathbf{\omega} }})$,对$\hat{\mathbf{\omega} }$求导得到:

$\frac{\partial E_{\hat{\mathbf{\omega} }}}{\partial\hat{\mathbf{\omega} }} = 2\mathbf{X}^{T}(\mathbf{X\hat{\mathbf{\omega} }-\mathbf{y}})$

要得到这个求导结果,需要知道一些矩阵求导的常见性质:

$f(x)=Ax,则\frac{\partial f(x)}{\partial x^{T}}=\frac{\partial (Ax)}{\partial x^{T}}=A$

$f(x)=x^{T}Ax,则\frac{\partial f(x)}{\partial x}=\frac{\partial (x^{T}Ax)}{\partial x}=Ax+A^{T}x$

$f(x)=a^{T}x,则\frac{\partial f(x)}{\partial x}=\frac{\partial (a^{T}x)}{\partial x}=\frac{\partial x^{T}a}{\partial x}=a$

令上式为0即可得参数的最优解,由于涉及到矩阵逆计算,所有只有当$\mathbf{X}^{T}\mathbf{X})^{-1}$为满秩矩阵或正定矩阵才可以得到如下结果:

$\hat{\mathbf{\omega} }^{*}=(\mathbf{X}^{T}\mathbf{X})^{-1}\mathbf{X}^{T}\mathbf{y}$

简单例子

该例子来自《机器学习实战》。

数据如下:

这里第一列均为1,目的就是将式子中的b转化为1。

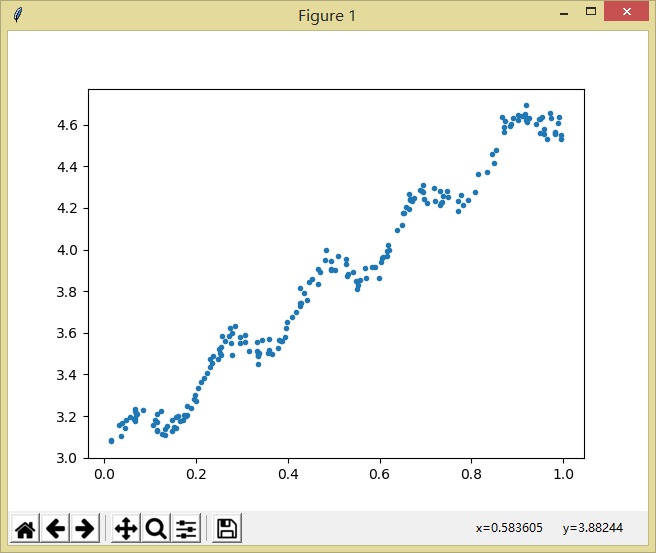

首先可以绘制图形大致观察一下:

只要明白上面的,计算参数其实很简单,代码如下:

import numpy as np def load_data_set(filename): # 数据导入

fr = open(filename)

num_feat = len(open(filename).readline().split('\t'))-1 data_mat = []

label_mat = [] for line in fr.readlines():

line_arr = []

cur_line = line.strip().split('\t')

for i in range(num_feat):

line_arr.append(float(cur_line[i])) data_mat.append(line_arr)

label_mat.append(float(cur_line[-1]))

return data_mat, label_mat def stand_regress(x_arr, y_arr): # 计算拟合参数

x_mat = np.mat(x_arr)

y_mat = np.mat(y_arr).T

xtx = x_mat.T * x_mat

if np.linalg.det(xtx) == 0:

print("This matrix is singular, cannot do inverse")

return

ws = xtx.I * x_mat.T * y_mat

return ws # 返回最后得到的参数值

第一个函数打开用tab分隔的文本文件,提取出其中的数据。

第二个函数计算最佳拟合直线,代码中numpy的linalg.det()可以计算行列式的值。计算的公式直接套用上面所讲的最终公式即可。

最后得到的参数值为:

线性回归(linear regression)的更多相关文章

- Stanford机器学习---第二讲. 多变量线性回归 Linear Regression with multiple variable

原文:http://blog.csdn.net/abcjennifer/article/details/7700772 本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归 ...

- 机器学习(三)--------多变量线性回归(Linear Regression with Multiple Variables)

机器学习(三)--------多变量线性回归(Linear Regression with Multiple Variables) 同样是预测房价问题 如果有多个特征值 那么这种情况下 假设h表示 ...

- Ng第二课:单变量线性回归(Linear Regression with One Variable)

二.单变量线性回归(Linear Regression with One Variable) 2.1 模型表示 2.2 代价函数 2.3 代价函数的直观理解 2.4 梯度下降 2.5 梯度下 ...

- 斯坦福第二课:单变量线性回归(Linear Regression with One Variable)

二.单变量线性回归(Linear Regression with One Variable) 2.1 模型表示 2.2 代价函数 2.3 代价函数的直观理解 I 2.4 代价函数的直观理解 I ...

- 机器学习方法:回归(一):线性回归Linear regression

欢迎转载,转载请注明:本文出自Bin的专栏blog.csdn.net/xbinworld. 开一个机器学习方法科普系列:做基础回顾之用,学而时习之:也拿出来与大家分享.数学水平有限,只求易懂,学习与工 ...

- 斯坦福CS229机器学习课程笔记 Part1:线性回归 Linear Regression

机器学习三要素 机器学习的三要素为:模型.策略.算法. 模型:就是所要学习的条件概率分布或决策函数.线性回归模型 策略:按照什么样的准则学习或选择最优的模型.最小化均方误差,即所谓的 least-sq ...

- 机器学习 (一) 单变量线性回归 Linear Regression with One Variable

文章内容均来自斯坦福大学的Andrew Ng教授讲解的Machine Learning课程,本文是针对该课程的个人学习笔记,如有疏漏,请以原课程所讲述内容为准.感谢博主Rachel Zhang的个人笔 ...

- 机器学习 (二) 多变量线性回归 Linear Regression with Multiple Variables

文章内容均来自斯坦福大学的Andrew Ng教授讲解的Machine Learning课程,本文是针对该课程的个人学习笔记,如有疏漏,请以原课程所讲述内容为准.感谢博主Rachel Zhang 的个人 ...

- ML 线性回归Linear Regression

线性回归 Linear Regression MOOC机器学习课程学习笔记 1 单变量线性回归Linear Regression with One Variable 1.1 模型表达Model Rep ...

- TensorFlow 学习笔记(1)----线性回归(linear regression)的TensorFlow实现

此系列将会每日持续更新,欢迎关注 线性回归(linear regression)的TensorFlow实现 #这里是基于python 3.7版本的TensorFlow TensorFlow是一个机器学 ...

随机推荐

- Hadoop fs -put bandwidth 暴力版

/* * Licensed to the Apache Software Foundation (ASF) under one or more * contributor license agreem ...

- MUI - 复选框、单选框、使用js获取选择值

<!DOCTYPE html> <html> <head> <meta charset="utf-8"> <meta name ...

- oracle索引分类

参考文档:https://wenku.baidu.com/view/d4d6ee1ba76e58fafab00336.html https://blog.csdn.net/u010719917/art ...

- qt 操作注册表,设置ie代理

void SetIEProxy(QString proxy) { QSettings settings("HKEY_CURRENT_USER\\Software\\Microsoft\\Wi ...

- poj3278

#include<iostream> #define MAX 100001 int john,cow; int queue[MAX]; int vis[MAX]; int ans; voi ...

- echart 判断数据是否为空

formatter 判断数据是否为空

- js/jquery 元素是否存在

<!DOCTYPE html><html><head><meta charset="UTF-8"><title>spli ...

- 20165330 2017-2018-2 《Java程序设计》第7周学习总结

课本知识总结 第十一章 JDBC与MySQL数据库 安装XAMPP软件及启动MySQL 下载链接:XAMPP 安装步骤:参考教程xampp新手学习指引(windows示例) 启动MySQL:打开系统c ...

- Mac快捷键大全及cheatsheet插件

常用快捷键 CheatSheet 在微信上看到一篇文章分享了一款小软件,觉得有必要推荐一下.名叫CheatSheet.如果你想知道某程序的所有快捷键,只需在Mac上安装CheatSheet,然后长按住 ...

- Mac破解免费office软件

一.下载安装包及破解工具 地址: https://pan.baidu.com/s/1hugtoLQ 密码: s5in 附官网地址 文件夹中包含三个文件: Office16安装文件 Microsoft_ ...