基于tensorflow的RBF神经网络案例

1 前言

在使用RBF神经网络实现函数逼近中,笔者介绍了使用 Matlab 训练RBF神经网络。本博客将介绍使用 tensorflow 训练RBF神经网络。代码资源见:RBF案例(更新版)

这几天,笔者在寻找 tensorflow 中 RBF 官方案例,没找到,又看了一些博客,发现这些博客或不能逼近多元函数,或不能批量训练。于是,自己手撕了一下代码。

RBF神经网络中需要求解的参数有4个:基函数的中心和方差、隐含层到输出层的权值和偏值。

RBF 神经网络的关键在于中心的选取,一般有如下三种方法:

- 直接计算法:直接通过先验经验固定中心,并计算方差,再通过有监督学习得到其他参数

- 自组织学习法:先通过k-means等聚类算法求出中心(无监督学习),并计算方差,再通过有监督学习得到其他参数

- 有监督学习法:直接通过有监督学习求出所有参数

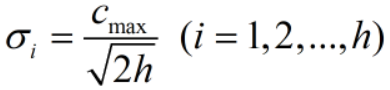

在直接计算法和自组织学习法中,方差的计算公式如下:

其中 Cmax 表示 h 个中心间的最大距离。

本博客主要介绍后两种中心计算方法实现 RBF 神经网络。

笔者工作空间如下:

2 RBF神经网络实现

2.1 自组织学习选取RBF中心

RBF_kmeans.py

import tensorflow as tf

import numpy as np

from sklearn.cluster import KMeans

class RBF:

#初始化学习率、学习步数

def __init__(self,learning_rate=0.002,step_num=10001,hidden_size=10):

self.learning_rate=learning_rate

self.step_num=step_num

self.hidden_size=hidden_size

#使用 k-means 获取聚类中心、标准差

def getC_S(self,x,class_num):

estimator=KMeans(n_clusters=class_num,max_iter=10000) #构造聚类器

estimator.fit(x) #聚类

c=estimator.cluster_centers_

n=len(c)

s=0;

for i in range(n):

j=i+1

while j<n:

t=np.sum((c[i]-c[j])**2)

s=max(s,t)

j=j+1

s=np.sqrt(s)/np.sqrt(2*n)

return c,s

#高斯核函数(c为中心,s为标准差)

def kernel(self,x,c,s):

x1=tf.tile(x,[1,self.hidden_size]) #将x水平复制 hidden次

x2=tf.reshape(x1,[-1,self.hidden_size,self.feature])

dist=tf.reduce_sum((x2-c)**2,2)

return tf.exp(-dist/(2*s**2))

#训练RBF神经网络

def train(self,x,y):

self.feature=np.shape(x)[1] #输入值的特征数

self.c,self.s=self.getC_S(x,self.hidden_size) #获取聚类中心、标准差

x_=tf.placeholder(tf.float32,[None,self.feature]) #定义placeholder

y_=tf.placeholder(tf.float32,[None,1]) #定义placeholder

#定义径向基层

z=self.kernel(x_,self.c,self.s)

#定义输出层

w=tf.Variable(tf.random_normal([self.hidden_size,1]))

b=tf.Variable(tf.zeros([1]))

yf=tf.matmul(z,w)+b

loss=tf.reduce_mean(tf.square(y_-yf))#二次代价函数

optimizer=tf.train.AdamOptimizer(self.learning_rate) #Adam优化器

train=optimizer.minimize(loss) #最小化代价函数

init=tf.global_variables_initializer() #变量初始化

with tf.Session() as sess:

sess.run(init)

for epoch in range(self.step_num):

sess.run(train,feed_dict={x_:x,y_:y})

if epoch>0 and epoch%500==0:

mse=sess.run(loss,feed_dict={x_:x,y_:y})

print(epoch,mse)

self.w,self.b=sess.run([w,b],feed_dict={x_:x,y_:y})

def kernel2(self,x,c,s): #预测时使用

x1=np.tile(x,[1,self.hidden_size]) #将x水平复制 hidden次

x2=np.reshape(x1,[-1,self.hidden_size,self.feature])

dist=np.sum((x2-c)**2,2)

return np.exp(-dist/(2*s**2))

def predict(self,x):

z=self.kernel2(x,self.c,self.s)

pre=np.matmul(z,self.w)+self.b

return pre

2.2 有监督学习选取RBF中心

RBF_Supervised.py

import numpy as np

import tensorflow as tf

class RBF:

#初始化学习率、学习步数

def __init__(self,learning_rate=0.002,step_num=10001,hidden_size=10):

self.learning_rate=learning_rate

self.step_num=step_num

self.hidden_size=hidden_size

#高斯核函数(c为中心,s为标准差)

def kernel(self,x,c,s): #训练时使用

x1=tf.tile(x,[1,self.hidden_size]) #将x水平复制 hidden次

x2=tf.reshape(x1,[-1,self.hidden_size,self.feature])

dist=tf.reduce_sum((x2-c)**2,2)

return tf.exp(-dist/(2*s**2))

#训练RBF神经网络

def train(self,x,y):

self.feature=np.shape(x)[1] #输入值的特征数

x_=tf.placeholder(tf.float32,[None,self.feature]) #定义placeholder

y_=tf.placeholder(tf.float32,[None,1]) #定义placeholder

#定义径向基层

c=tf.Variable(tf.random_normal([self.hidden_size,self.feature]))

s=tf.Variable(tf.random_normal([self.hidden_size]))

z=self.kernel(x_,c,s)

#定义输出层

w=tf.Variable(tf.random_normal([self.hidden_size,1]))

b=tf.Variable(tf.zeros([1]))

yf=tf.matmul(z,w)+b

loss=tf.reduce_mean(tf.square(y_-yf))#二次代价函数

optimizer=tf.train.AdamOptimizer(self.learning_rate) #Adam优化器

train=optimizer.minimize(loss) #最小化代价函数

init=tf.global_variables_initializer() #变量初始化

with tf.Session() as sess:

sess.run(init)

for epoch in range(self.step_num):

sess.run(train,feed_dict={x_:x,y_:y})

if epoch>0 and epoch%500==0:

mse=sess.run(loss,feed_dict={x_:x,y_:y})

print(epoch,mse)

self.c,self.s,self.w,self.b=sess.run([c,s,w,b],feed_dict={x_:x,y_:y})

def kernel2(self,x,c,s): #预测时使用

x1=np.tile(x,[1,self.hidden_size]) #将x水平复制 hidden次

x2=np.reshape(x1,[-1,self.hidden_size,self.feature])

dist=np.sum((x2-c)**2,2)

return np.exp(-dist/(2*s**2))

def predict(self,x):

z=self.kernel2(x,self.c,self.s)

pre=np.matmul(z,self.w)+self.b

return pre

3 案例

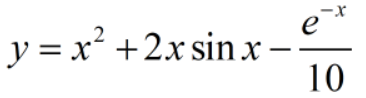

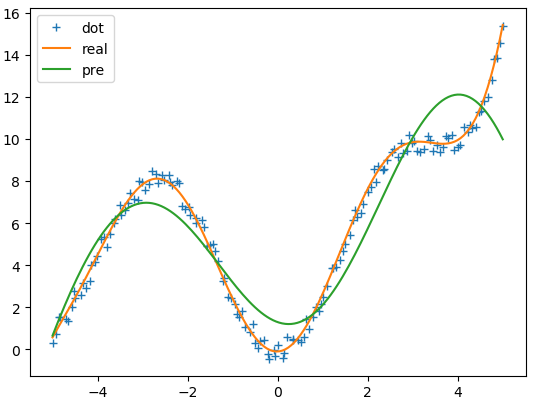

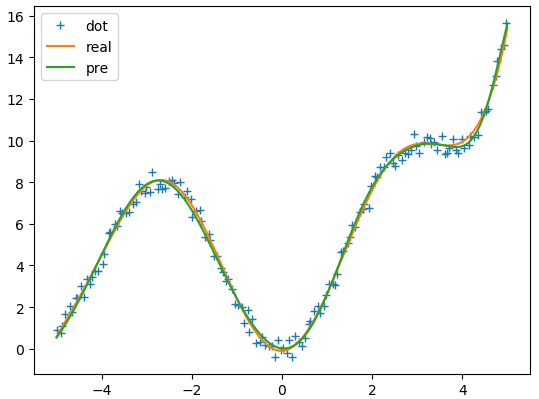

3.1 一元函数逼近

待逼近函数:

(1)自组织学习选取RBF中心

test_kmeans.py

import numpy as np

import matplotlib.pyplot as plt

from RBF_kmeans import RBF

#待逼近的函数

def fun(x):

return x*x+2*x*np.sin(x)-np.exp(-x)/10

#生成样本

def generate_samples():

n=150 #样本点个数

wideX=0.03 #横轴噪声的宽度

wideY=0.5 #纵轴噪声宽度

t=np.linspace(-5,5,n).reshape(-1,1) #横轴理想值

u=fun(t) #纵轴理想值

noisyX=np.random.uniform(-wideX,wideX,n).reshape(n,-1) #横轴噪声

noisyY=np.random.uniform(-wideY,wideY,n).reshape(n,-1) #纵轴噪声

x=t+noisyX #横轴实际值

y=u+noisyY #纵轴实际值

return t,u,x,y

t,u,x,y=generate_samples()

rbf=RBF(0.003,20001,4) #学习率

rbf.train(x,y)

pre=rbf.predict(t)

plt.plot(x,y,'+')

plt.plot(t,u)

plt.plot(t,pre)

plt.legend(['dot','real','pre'],loc='upper left')

自组织学习选取RBF中心

自组织学习选取RBF中心

(2)有监督学习选取RBF中心

test_Supervised.py

import numpy as np

import matplotlib.pyplot as plt

from RBF_Supervised import RBF

#待逼近的函数

def fun(x):

return x*x+2*x*np.sin(x)-np.exp(-x)/10

#生成样本

def generate_samples():

n=150 #样本点个数

wideX=0.03 #横轴噪声的宽度

wideY=0.5 #纵轴噪声宽度

t=np.linspace(-5,5,n).reshape(-1,1) #横轴理想值

u=fun(t) #纵轴理想值

noisyX=np.random.uniform(-wideX,wideX,n).reshape(n,-1) #横轴噪声

noisyY=np.random.uniform(-wideY,wideY,n).reshape(n,-1) #纵轴噪声

x=t+noisyX #横轴实际值

y=u+noisyY #纵轴实际值

return t,u,x,y

t,u,x,y=generate_samples()

rbf=RBF(0.003,20001,4) #学习率

rbf.train(x,y)

pre=rbf.predict(t)

plt.plot(x,y,'+')

plt.plot(t,u)

plt.plot(t,pre)

plt.legend(['dot','real','pre'],loc='upper left')

有监督学习选取RBF中心

有监督学习选取RBF中心

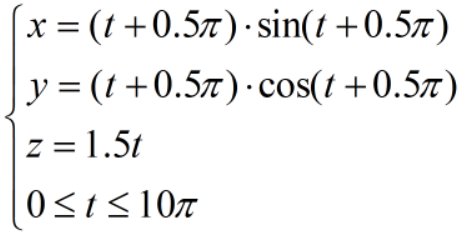

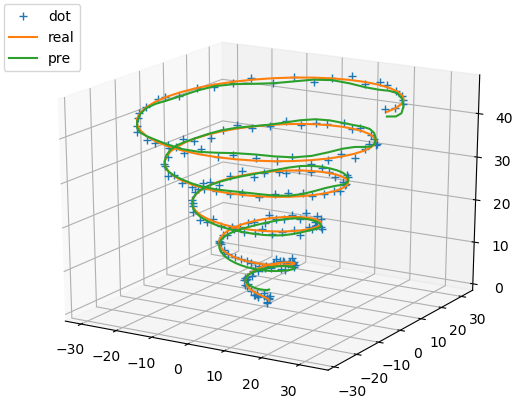

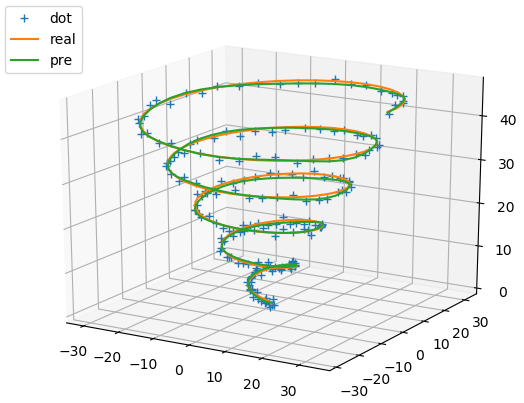

3.2 二元函数逼近

待逼近函数:

(1)自组织学习选取RBF中心

test_kmeans2.py

import numpy as np

from mpl_toolkits.mplot3d import Axes3D

import matplotlib.pyplot as plt

from RBF_kmeans import RBF

#待逼近的函数

def fun(t):

x1=(t+0.5*np.pi)*np.sin(t+0.5*np.pi)

x2=(t+0.5*np.pi)*np.cos(t+0.5*np.pi)

y=1.5*t

x=np.append(x1,x2,1)

return x,y

#生成样本

def generate_samples():

n=200 #样本点个数

wideX=0.6 #水平方向噪声的宽度

wideY=1 #纵轴噪声宽度

t=np.linspace(0,10*np.pi,n).reshape(-1,1) #横轴理想值

u,v=fun(t) #纵轴理想值

noisyX=np.random.uniform(-wideX,wideX,u.shape).reshape(n,-1) #水平方向噪声

noisyY=np.random.uniform(-wideY,wideY,n).reshape(n,-1) #纵轴噪声

x=u+noisyX #横轴实际值

y=v+noisyY #纵轴实际值

return u,v,x,y

u,v,x,y=generate_samples()

rbf=RBF(0.02,20001,10) #学习率

rbf.train(x,y)

pre=rbf.predict(u)

ax=plt.figure().gca(projection='3d')

ax.plot(x[:,0],x[:,1],y[:,0],'+')

ax.plot(u[:,0],u[:,1],v[:,0])

ax.plot(u[:,0],u[:,1],pre[:,0])

plt.legend(['dot','real','pre'],loc='upper left')

plt.show()

自组织学习选取RBF中心

自组织学习选取RBF中心

(2)有监督学习选取RBF中心

test_Supervised2.py

import numpy as np

from mpl_toolkits.mplot3d import Axes3D

import matplotlib.pyplot as plt

from RBF_Supervised import RBF

#待逼近的函数

def fun(t):

x1=(t+0.5*np.pi)*np.sin(t+0.5*np.pi)

x2=(t+0.5*np.pi)*np.cos(t+0.5*np.pi)

y=1.5*t

x=np.append(x1,x2,1)

return x,y

#生成样本

def generate_samples():

n=200 #样本点个数

wideX=0.6 #水平方向噪声的宽度

wideY=1 #纵轴噪声宽度

t=np.linspace(0,10*np.pi,n).reshape(-1,1) #横轴理想值

u,v=fun(t) #纵轴理想值

noisyX=np.random.uniform(-wideX,wideX,u.shape).reshape(n,-1) #水平方向噪声

noisyY=np.random.uniform(-wideY,wideY,n).reshape(n,-1) #纵轴噪声

x=u+noisyX #横轴实际值

y=v+noisyY #纵轴实际值

return u,v,x,y

u,v,x,y=generate_samples()

rbf=RBF(0.02,20001,10) #学习率

rbf.train(x,y)

pre=rbf.predict(u)

ax=plt.figure().gca(projection='3d')

ax.plot(x[:,0],x[:,1],y[:,0],'+')

ax.plot(u[:,0],u[:,1],v[:,0])

ax.plot(u[:,0],u[:,1],pre[:,0])

plt.legend(['dot','real','pre'],loc='upper left')

plt.show()

有监督学习选取RBF中心

有监督学习选取RBF中心

通过实验可以看到:无论是一元函数逼近还是二元函数逼近,在隐藏层神经元个数、学习率、学习步数相同的情况下,有监督学习法都比自组织学习法效果好。

声明:本文转自基于tensorflow的RBF神经网络案例

基于tensorflow的RBF神经网络案例的更多相关文章

- 基于HHT和RBF神经网络的故障检测——第二篇论文读后感

故障诊断主要包括三部分: 1.故障信号检测方法(定子电流信号检测 [ 定子电流幅值和电流频谱 ] ,振动信号检测,温度信号检测,磁通检测法,绝缘检测法,噪声检测法) 2.故障信号的处理方法,即故障特征 ...

- 基于tensorflow搭建一个神经网络

一,tensorflow的简介 Tensorflow是一个采用数据流图,用于数值计算的 开源软件库.节点在图中表示数字操作,图中的线 则表示在节点间相互联系的多维数据数组,即张量 它灵活的架构让你可以 ...

- 基于TensorFlow的循环神经网络(RNN)

RNN适用场景 循环神经网络(Recurrent Neural Network)适合处理和预测时序数据 RNN的特点 RNN的隐藏层之间的节点是有连接的,他的输入是输入层的输出向量.extend(上一 ...

- 基于 SoC 的卷积神经网络车牌识别系统设计(1)概述

NOTES: 这是第三届全国大学生集成电路创新创业大赛 - Arm 杯 - 片上系统设计挑战赛(本人指导的一个比赛).主要划分为以下的 Top5 重点.难点.亮点.热点以及创新点:1.通过 Arm C ...

- Chinese-Text-Classification,用卷积神经网络基于 Tensorflow 实现的中文文本分类。

用卷积神经网络基于 Tensorflow 实现的中文文本分类 项目地址: https://github.com/fendouai/Chinese-Text-Classification 欢迎提问:ht ...

- 基于TensorFlow解决手写数字识别的Softmax方法、多层卷积网络方法和前馈神经网络方法

一.基于TensorFlow的softmax回归模型解决手写字母识别问题 详细步骤如下: 1.加载MNIST数据: input_data.read_data_sets('MNIST_data',one ...

- 深度学习(五)基于tensorflow实现简单卷积神经网络Lenet5

原文作者:aircraft 原文地址:https://www.cnblogs.com/DOMLX/p/8954892.html 参考博客:https://blog.csdn.net/u01287127 ...

- 使用TensorFlow的递归神经网络(LSTM)进行序列预测

本篇文章介绍使用TensorFlow的递归神经网络(LSTM)进行序列预测.作者在网上找到的使用LSTM模型的案例都是解决自然语言处理的问题,而没有一个是来预测连续值的. 所以呢,这里是基于历史观察数 ...

- 基于Tensorflow + Opencv 实现CNN自定义图像分类

摘要:本篇文章主要通过Tensorflow+Opencv实现CNN自定义图像分类案例,它能解决我们现实论文或实践中的图像分类问题,并与机器学习的图像分类算法进行对比实验. 本文分享自华为云社区< ...

- 从环境搭建到回归神经网络案例,带你掌握Keras

摘要:Keras作为神经网络的高级包,能够快速搭建神经网络,它的兼容性非常广,兼容了TensorFlow和Theano. 本文分享自华为云社区<[Python人工智能] 十六.Keras环境搭建 ...

随机推荐

- [转帖]Region is unavailable的排查总结

https://tidb.net/blog/07c99ed0#4%C2%A0%20%E4%B8%80%E4%BA%9B%E5%BB%BA%E8%AE%AE 1 region访问基本流程 tidb在访问 ...

- [转帖]tiup cluster reload

https://docs.pingcap.com/zh/tidb/stable/tiup-component-cluster-reload 4 Contributors 在修改集群配置之后,需要通过 ...

- [转帖]Kafka 核心技术与实战学习笔记(六)kafka线上集群部署方案

一.操作系统-Linux Kafka是JVM系的大数据框架 kafka由Scala语言和Java语言编写而成,编译之后的源代码就是普通的".class"文件 使用Linux kaf ...

- stress-NG 磁盘测试结果-全国产信创部分验证

stress-NG 磁盘测试结果 摘要 前几天分别还是用了redis-benchmark还有specjvm2008进行了多种系统的压测 得出了信创CPU的一些简单结论 但是一直还没有压测磁盘, 今天想 ...

- Python处理Oracle数据库的学习过程

Python处理Oracle数据库的学习过程 背景 产品数据存在一些大小写敏感的数据迁移到不敏感的数据库时出现报错的情况. 基于此, 我这边跟帅男同学学习了下Python的使用. 因为这一块一直比较菜 ...

- 仅杀掉当前目录的java进程的办法

比较简单,比如当前目录名字是 /su 就可以写成如下: 利用 /proc/ 下面的cwd 来进行判断直接杀进程 尽量路径唯一标识符 进行处理. for i in `ps -ef |grep java ...

- 神经网络优化篇:详解超参数调试的实践:Pandas VS Caviar(Hyperparameters tuning in practice: Pandas vs. Caviar)

超参数调试的实践 如今的深度学习已经应用到许多不同的领域,某个应用领域的超参数设定,有可能通用于另一领域,不同的应用领域出现相互交融.比如,曾经看到过计算机视觉领域中涌现的巧妙方法,比如说Confon ...

- 原生js拖拽元素(onmouseup不能够触发的原因)

我们经常会遇见拖拽某一个元素的场景,拖拽也是很常用的: 这次拖拽遇见一个问题,有时在拖拽的时候吗,鼠标松开,元素仍然可以拖拽: 经过查阅资料,发现: 会触发H5原生的拖拽事件.并且不会监听到onmou ...

- Linux慢 进程kswapd0与events/0消耗大量CPU的问题 一次网站宕机的处理

今天下午网站宕了两次机,发工单给阿里云,发现原因是服务器的CPU 100%了. 重启服务器后,使用 top 命令看看是哪些进程消耗那么大的 CPU 使用.盯了有好十几分钟,主要消耗 CPU 的进程有两 ...

- Why gRPC ?

gRPC(gRPC Remote Procedure Call)是由 Google 开发的开源 RPC 框架,它基于 HTTP/2 标准,使用 Protocol Buffers 作为接口定义语言(ID ...