tensorflow的variable、variable_scope和get_variable的用法和区别

在tensorflow中,可以使用tf.Variable来创建一个变量,也可以使用tf.get_variable来创建一个变量,但是在一个模型需要使用其他模型的变量时,tf.get_variable就派上大用场了。

先分别介绍两个函数的用法:

import tensorflow as tf

var1 = tf.Variable(1.0,name='firstvar')

print('var1:',var1.name)

var1 = tf.Variable(2.0,name='firstvar')

print('var1:',var1.name)

var2 = tf.Variable(3.0)

print('var2:',var2.name)

var2 = tf.Variable(4.0)

print('var2:',var2.name)

get_var1 = tf.get_variable(name='firstvar',shape=[1],dtype=tf.float32,initializer=tf.constant_initializer(0.3))

print('get_var1:',get_var1.name)

get_var1 = tf.get_variable(name='firstvar1',shape=[1],dtype=tf.float32,initializer=tf.constant_initializer(0.4))

print('get_var1:',get_var1.name) with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

print('var1=',var1.eval())

print('var2=',var2.eval())

print('get_var1=',get_var1.eval())

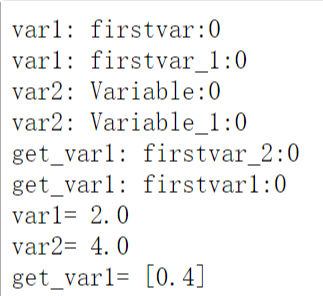

结果如下:

我们来分析一下代码,tf.Varibale是以定义的变量名称为唯一标识的,如var1,var2,所以可以重复地创建name='firstvar'的变量,但是tensorflow会给它们按顺序取后缀,如firstvar_1:0,firstval_2:0,...,如果没有制定名字,系统会自动加上一个名字Variable:0。而且由于tf.Varibale是以定义的变量名称为唯一标识的,所以当第二次命名同一个变量名时,第一个变量就会被覆盖,所以var1由1.0变成2.0。

对于tf.get_variable,它是以指定的name属性为唯一标识,而不是定义的变量名称,所以不能同时定义两个变量name是相同的,例如下面这种就会报错:

1 get_var1 = tf.get_variable(name='a',shape=[1],dtype=tf.float32,initializer=tf.constant_initializer(0.3))

2 print('get_var1:',get_var1.name)

3 get_var2 = tf.get_variable(name='a',shape=[1],dtype=tf.float32,initializer=tf.constant_initializer(0.4))

4 print('get_var1:',get_var1.name)

这样就会报错了。如果我们想声明两次相同name的变量,这时variable_scope就派上用场了,可以使用variable_scope将它们分开:

import tensorflow as tf

with tf.variable_scope('test1'):

get_var1 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

with tf.variable_scope('test2'):

get_var2 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

print('get_var1:',get_var1.name)

print('get_var2:',get_var2.name)

这样就不会报错了,variable_scope相当于声明了作用域,这样在不同的作用域存在相同的变量就不会冲突了,结果如下:

当然,scope还支持嵌套:

import tensorflow as tf

with tf.variable_scope('test1',):

get_var1 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

with tf.variable_scope('test2',):

get_var2 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

print('get_var1:',get_var1.name)

print('get_var2:',get_var2.name)

输出结果为:

怎么样?可以对照上面的结果体会一下不同。那么如何通过get_variable来实现变量共享呢?这就要用到variable_scope里的一个属性:reuse,顾名思义嘛,当把reuse设置成True时就可以了,它表示使用已经定义过的变量,这是get_variable就不会再创建新的变量,而是去找与name相同的变量:

import tensorflow as tf

with tf.variable_scope('test1',):

get_var1 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

with tf.variable_scope('test2',):

get_var2 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

print('get_var1:',get_var1.name)

print('get_var2:',get_var2.name)

with tf.variable_scope('test1',reuse=True):

get_var3 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

with tf.variable_scope('test2',):

get_var4 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

print('get_var3:',get_var3.name)

print('get_var4:',get_var4.name)

输出结果如下:

当然前面说过,reuse=True是使用前面已经创建过的变量,如果仅仅只有从第八行到最后的代码,也会报错的,如果还是想这么做,就需要把reuse属性设置成tf.AUTO_REUSE

import tensorflow as tf

with tf.variable_scope('test1',reuse=tf.AUTO_REUSE):

get_var3 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

with tf.variable_scope('test2',):

get_var4 = tf.get_variable(name='firstvar',shape=[2],dtype=tf.float32)

print('get_var3:',get_var3.name)

print('get_var4:',get_var4.name)

此时就不会报错,tf.AUTO_REUSE可以实现第一次调用variable_scope时,传入的reuse值为False,再次调用时,传入reuse的值就会自动变为True。

tensorflow的variable、variable_scope和get_variable的用法和区别的更多相关文章

- tf.Variable()、tf.get_variable()和tf.placeholder()

1.tf.Variable() tf.Variable(initializer,name) 功能:tf.Variable()创建变量时,name属性值允许重复,检查到相同名字的变量时,由自动别名机制创 ...

- tf.variable和tf.get_Variable以及tf.name_scope和tf.variable_scope的区别

在训练深度网络时,为了减少需要训练参数的个数(比如具有simase结构的LSTM模型).或是多机多卡并行化训练大数据大模型(比如数据并行化)等情况时,往往需要共享变量.另外一方面是当一个深度学习模型变 ...

- TF.VARIABLE、TF.GET_VARIABLE、TF.VARIABLE_SCOPE以及TF.NAME_SCOPE关系

1. tf.Variable与tf.get_variable tensorflow提供了通过变量名称来创建或者获取一个变量的机制.通过这个机制,在不同的函数中可以直接通过变量的名字来使用变量,而不需要 ...

- 彻底弄懂tf.Variable、tf.get_variable、tf.variable_scope以及tf.name_scope异同

https://blog.csdn.net/qq_22522663/article/details/78729029 1. tf.Variable与tf.get_variabletensorflow提 ...

- Tensorflow函数——tf.variable_scope()

Tensorflow函数——tf.variable_scope()详解 https://blog.csdn.net/yuan0061/article/details/80576703 2018年06月 ...

- 理解 tf.Variable、tf.get_variable以及范围命名方法tf.variable_scope、tf.name_scope

tensorflow提供了通过变量名称来创建或者获取一个变量的机制.通过这个机制,在不同的函数中可以直接通过变量的名字来使用变量,而不需要将变量通过参数的形式到处传递. 1. tf.Variable( ...

- Tensorflow 之 name/variable_scope 变量管理

name/variable_scope 的作用 充分理解 name / variable_scope TensorFlow 入门笔记 当一个神经网络比较复杂.参数比较多时,就比较需要一个比较好的方式来 ...

- tensorflow冻结变量方法(tensorflow freeze variable)

最近由于项目需要,要对tensorflow构造的模型中部分变量冻结,然后继续训练,因此研究了一下tf中冻结变量的方法,目前找到三种,各有优缺点,记录如下: 1.名词解释 冻结变量,指的是在训练模型时, ...

- Tensorflow get_variable和Varialbe的区别

import tensorflow as tf """ tf.get_variable()和Variable有很多不同点 * 它们对重名操作的处理不同 * 它们受name ...

- tf.Variable() 与tf.get_variable()的区别

每次调用 tf.Variable() 都会产生一个新的变量,变量名称是一个可选参数,运行命名相同,如果命名冲突会根据命名先后对名字进行处理, tf.get_variable()的变量名称是必填参数,t ...

随机推荐

- Django进阶之路由层和视图层

Django的路由系统 [1]什么是URL配置(URLconf) URL调度器 | Django 文档 | Django (djangoproject.com) URL配置(URLconf)就像Dja ...

- axios post xml data方法

axios#request(config) axios#get(url[,config]) axios#delete(url[,config]) axios#head(url[,config]) ax ...

- redis三主三从详细搭建过程

搭建Redis三主三从集群的详细步骤如下: 准备环境: 确保你有六台服务器或虚拟机,每台服务器上都已经安装了Redis.这些服务器将用于搭建三主三从的Redis集群. 确保所有服务器之间的网络连接正常 ...

- python数组基本用法实例解析

一 数组的内容的查找 array的查找是依靠index,超出内容的会报错误 import array int_array = array.array('i', [0, 1, 2, 3, 1, 2]) ...

- FFmpeg命令行之ffmpeg调整音视频播放速度

FFmpeg对音频.视频播放速度的调整的原理不一样.下面简单的说一下各自的原理及实现方式: 一.调整视频速率 视频的倍速主要是通过控制filter中的setpts来实现,setpts是视频滤波器通过改 ...

- Global AI Bootcamp 成都站 圆满结束!

3月10日星期天下午2点「Global AI Bootcamp 2024 - 成都站」,在成都银泰中心蔚来汽车会议区圆满结束了! 本次活动共计吸引了约50名IT行业从业者线下参与,他们分别来自成都各行 ...

- 记录-关于console你不知道的那些事

这里给大家分享我在网上总结出来的一些知识,希望对大家有所帮助 了解 console ● 什么是 console ? console 其实是 JavaScript 内的一个原生对象 内部存储的方法大部分 ...

- 深度探索.NET Feature Management功能开关的魔法

前言 .NET Feature Management 是一个用于管理应用程序功能的库,它可以帮助开发人员在应用程序中轻松地添加.移除和管理功能.使用 Feature Management,开发人员可以 ...

- KingbaseES V8R6集群运维案例之---sys_rewind应用分析

案例说明: sys_rewind是用于在数据库cluster的时间线分叉以后,同步一个 KingbaseES 数据库cluster 和同一数据库cluster另一份拷贝的工具.一种典型的场景是在失 ...

- how to install local jar to maven repository

如何把maven不能引入的依赖安装到本地Repository: 1.比如fastdfs-client-java. <dependency> <groupId>org.csour ...