PetaPoco批量插入数据

VS添加完组件,自动生成的PetaPoco.cs文件中没有SqlBulkInsert这个方法,但是可以在里面添加,代码如下:

/// <summary>

/// BulkInsert

/// </summary>

/// <param name="dt">dttable(must 1、columns exactly alike,2、without self-increasing primary key)</param>

/// <param name="tableName">table name(must include schema)</param>

/// <param name="fieldName">field name string[](must 1、exactly alike,2、without self-increasing primary key)</param>

/// <returns></returns>

public bool SqlBulkInsert(DataTable dt, string tableName, string[] fieldName)

{

try

{

OpenSharedConnection();

var entry = ConfigurationManager.ConnectionStrings[];//获取web.config中的数据库连接字符串

using (SqlBulkCopy bulk = new SqlBulkCopy(entry.ConnectionString))

{

try

{

bulk.DestinationTableName = tableName;

foreach (string field in fieldName)

{

bulk.ColumnMappings.Add(field, field);

}

bulk.WriteToServer(dt);

return true;

}

catch

{

return false;

}

finally

{

bulk.Close();

}

}

}

finally

{

CloseSharedConnection();

}

}

第一个参数不解释了,把DataTable传过来;第二个是表名,需要注意的是这边需要SQL Server表的全名,包括schema。一般是dbo,但也有可能是别的,例如:org.Provinces;第三个是DataTable中的列名数组,需要注意的是大小写要和数据库中一致。

如果是List类型数据源,可以通过以下方法得到DataTable数据和其列名数组:

public class ModelConvertHelper<T> where T : new()

{

//List<T>转成DataTable并返回列名数组

public static Tuple<DataTable, string[]> batchExecData(List<T> List)

{

DataTable dt = new DataTable();

List<string> list = new List<string>();

foreach (T entity in List)

{

DataRow dr = dt.NewRow();

foreach (PropertyInfo column in entity.GetType().GetProperties())

{

if (!dt.Columns.Contains(column.Name))

{

dt.Columns.Add(column.Name);

list.Add(column.Name);

}

object value = column.GetValue(entity);

if (value != null)

{

dr[column.Name] = value;

}

}

dt.Rows.Add(dr);

}

return new Tuple<DataTable, string[]>(dt, list.ToArray());

}

}

调用方法:

//得到list数据

Tuple<DataTable, string[]> tule = ChineseAbs.DealLab.Helpers.ModelConvertHelper<AssetPoolData>.batchExecData(list);

var res = m_db.SqlBulkInsert(tule.Item1, "org.Provinces", tule.Item2);

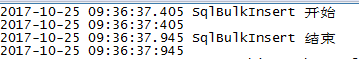

效果还不错,测试了两万条数据,用了0.5秒左右。

By QJL

PetaPoco批量插入数据的更多相关文章

- PetaPoco 批量插入数据

网上找的代码,还没经过验证 /// <summary> /// Bulk inserts multiple rows to SQL /// </summary> /// < ...

- C#批量插入数据到Sqlserver中的四种方式

我的新书ASP.NET MVC企业级实战预计明年2月份出版,感谢大家关注! 本篇,我将来讲解一下在Sqlserver中批量插入数据. 先创建一个用来测试的数据库和表,为了让插入数据更快,表中主键采用的 ...

- .Net批量插入数据到SQLServer数据库,System.Data.SqlClient.SqlBulkCopy类批量插入大数据到数据库

批量的的数据导入数据库中,尽量少的访问数据库,高性能的对数据库进行存储. 采用SqlBulkCopy来处理存储数据.SqlBulkCopy存储大批量的数据非常的高效,将内存中的数据表直接的一次性的存储 ...

- sql 中的Bulk和C# 中的SqlBulkCopy批量插入数据 ( 回顾 and 粗谈 )

通常,我们会对于一个文本文件数据导入到数据库中,不多说,上代码. 首先,表结构如下. 其次,在我当前D盘中有个文本文件名为2.txt的文件. 在数据库中,可以这样通过一句代码插入. Bulk in ...

- Java 批量插入数据(Oracle)

//批量添加20000条数据用时8秒. try { String url = "jdbc:oracle:thin:@IP:1521:orcl"; // orcl为数据库的SI ...

- 批量插入数据(基于Mybatis的实现-Oracle)

前言:做一个数据同步项目,要求:同步数据不丢失的情况下,提高插入性能. 项目DB框架:Mybatis.DataBase:Oracle. -------------------------------- ...

- C#批量插入数据到Sqlserver中的三种方式

本篇,我将来讲解一下在Sqlserver中批量插入数据. 先创建一个用来测试的数据库和表,为了让插入数据更快,表中主键采用的是GUID,表中没有创建任何索引.GUID必然是比自增长要快的,因为你生 成 ...

- SqlServer——批量插入数据

像Major表里面批量插入数据演示: 代码如下: Declare @I int Set @I= Begin Tran InsertData: Insert into Major values(@I,' ...

- mybatis批量插入数据到oracle

mybatis 批量插入数据到oracle报 ”java.sql.SQLException: ORA-00933: SQL 命令未正确结束“ 错误解决方法 oracle批量插入使用 insert a ...

随机推荐

- 手把手教你树莓派实现简易室内监控系统(C)之BOA服务器的搭建

本篇主要讲利用BOA服务器做室内监控系统的服务器端. 古人云:万事开头靠百度,实在不行就Google.小编也是一步一步的,亲自搭建成功,不能说是万全之策,仅仅是给大家一个参考就满足了. 第一步: 1. ...

- Yii中DataProvider的使用

1,DataProvider 什么是数据提供者 数据提供者可以获取数据,并提供给其他组件或页面使用 可以获得列的数据进行分页和排序 经常用来给数据小部件提供数据,方便用户互动地进行数据的分页与排序 实 ...

- SQL注入漏洞产生的原因是什么?怎么防止?XSS呢?

SQL注入产生的原因:程序开发过程中不注意规范书写sql语句和对特殊字符进行过滤,导致客户端可以通过全局变量POST和GET提交一些sql语句正常执行. 防止SQL注入: 1.开启配置文件中的magi ...

- C语言_来了解一下GCC编译器编译C可执行脚本的过程

GCC简介 Linux系统下的gcc(GNU C Compiler)是GNU推出的功能强大.性能优越的多平台编译器,是GNU的代表作品之一.gcc是可以在多种硬体平台上编译出可执行程序的超级编译 ...

- 剑指offer第一天

15.反转链表 输入一个链表,反转链表后,输出链表的所有元素. 解法一:(使用栈) /* public class ListNode { int val; ListNode next = null; ...

- nyoj61 传纸条(一) dp

思路:两人一个从左上角出发只能向右和向下,另一人从右下角出发只能向左和向上,可以看做两人都是从右下角出发,且只能向左和向上传纸条,并且两条路径不会相交,因为一个人只会传一次,那么随便画一个图就能知道两 ...

- 初探Java多线程

多线程是由Java提出的概念,那么什么是线程呢?这里会涉及到几个名字听着很类似的东西:程序.线程.进程. 程序:存储在磁盘上的一系列的文件,包括可执行文件和不可执行文件. 进程:在内存中,每一个程序都 ...

- mysql导入导出数据

mysqldump是MySQL自带的导出数据工具,通常我们用它来导出MySQL中,但是有时候我们需要导出MySQL数据库中某个表的部分数据作为测试. mysqldump命令中带有一个 --where/ ...

- Centos搭建mysql/Hadoop/Hive/Hbase/Sqoop/Pig

目录: 准备工作 Centos安装 mysql Centos安装Hadoop Centos安装hive JDBC远程连接Hive Hbase和hive整合 Centos安装Hbase 准备工作: 配置 ...

- linux 搭建CA服务器 http+ssl mail+ssl 扫描与抓包

搭建CA服务器 CA服务是给服务器发放数字证书,被通信双方信任,独立的第三方机构 国内常见的CA机构 中国金融认证中心(CFCA) 中国电信安全认证中心(CTCA) 北京数字证书认证中心(BJCA) ...