Hive的介绍及安装

简介

Hive 是基于 Hadoop 的一个数据仓库工具,可以将结构化的数据文件 映射为一张数据库表,并提供类 SQL 查询功能。

本质是将 SQL 转换为 MapReduce 程序。

Hive组件

用户接口:包括 CLI、JDBC/ODBC、WebGUI。其中,CLI(command lineinterface)为 shell 命令行;JDBC/ODBC 是 Hive 的 JAVA 实现,与传统数据库JDBC 类似;WebGUI 是通过浏览器访问 Hive。

元数据存储:通常是存储在关系数据库如 mysql/derby 中。Hive 将元数据存储在数据库中。Hive 中的元数据包括表的名字,表的列和分区及其属性,表的属性(是否为外部表等),表的数据所在目录等。

解释器、编译器、优化器、执行器:完成 HQL 查询语句从词法分析、语法分析、编译、优化以及查询计划的生成。生成的查询计划存储在 HDFS 中,并在随后有 MapReduce 调用执行。

Hive 与 Hadoop 的关系

Hive 利用HDFS 存储数据,利用 MapReduce 查询分析数据

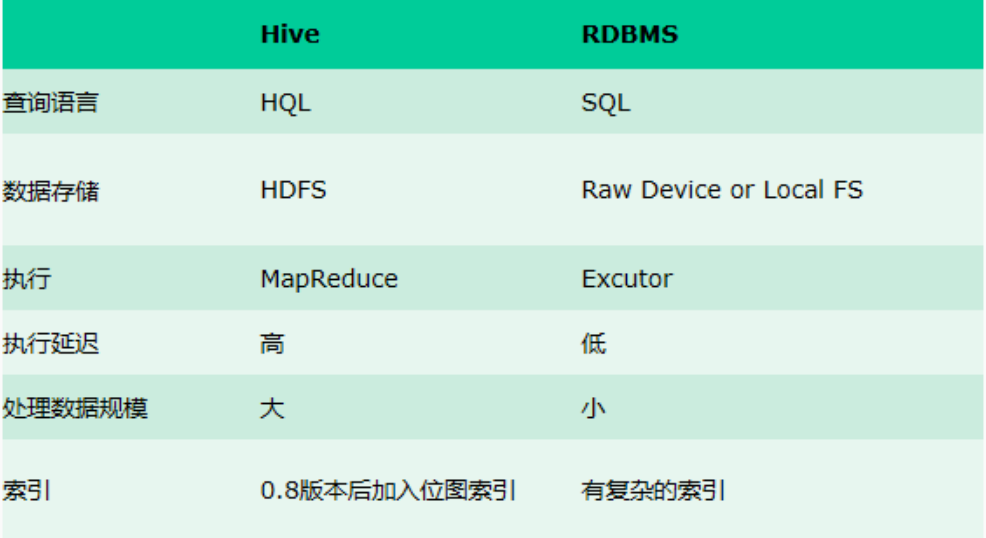

Hive 与传统数据库 对比

hive 用于海量数据的离线数据分析。

hive 具有 sql 数据库的外表,但应用场景完全不同,hive 只适合用来做批量数据统计分析。

1、具备数据存储的能力,使用Hadoop hdfs来进行数据的存储

2、具备ETL的能力,使用Hadoop MapReduce进行数据的ETL (提供sql转化成MapReduce的能力)

Hive数据模型

Hive 中所有的数据都存储在 HDFS 中,没有专门的数据存储格式,在创建表时指定数据中的分隔符,Hive 就可以映射成功,解析数据。

Hive 中包含以下数据模型:

db :在 hdfs 中表现为 hive.metastore.warehouse.dir 目录下一个文件夹

table :在 hdfs 中表现所属 db 目录下一个文件夹

external table :数据存放位置可以在 HDFS 任意指定路径

partition :在 hdfs 中表现为 table 目录下的子目录

bucket :在 hdfs 中表现为同一个表目录下根据 hash 散列之后的多个文件

一些专业术语

增量(上次导出之后的新数据):i_s.Peking.orders_20130711_000.lzo

加密:i_s.peking.orders_20130711_000.md5

表结构:i_s.peking.orders_20130711_000.xml

全量(表中所有的数据):a_s.Peking.orders_20130711_000.lzo

加密:a_s.peking.orders_20130711_000.md5

表结构:a_s.peking.orders_20130711_000.xml

PV:页面访问量,即PageView,用户每次对网站的访问均被记录,用户对同一页面的多次访问,访问量累计。

UV:独立访问用户数:即UniqueVisitor,访问网站的一台电脑客户端为一个访客。一天内相同的客户端只被计算一次。

数据仓库:Data Warehouse,简写为 DW 或 DWH

数据库:database,简写DB

联机事务处理 OLTP(On-Line Transaction Processing) --> 关系型数据库RDBMS

联机分析处理 OLAP(On-Line Analytical Processing) --> 数据仓库

ETL(抽取 Extra, 转化 Transfer, 装载 Load)

源数据层(ODS)

数据仓库层(DW)

数据应用层(DA 或 APP)

元数据(Meta Date)

Hive MySQL版本的安装

内置derby版缺点:不同路径启动 hive,每一个 hive 拥有一套自己的元数据,无法共享

安装hive

上传hive的安装包并解压

切换到hive安装目录的配置文件路径中修改配置信息

cd /export/servers/hive/conf

vi hive-env.sh

export HADOOP_HOME=/export/servers/hadoop-2.7.4

vi hive-site.xml

<configuration>

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/hive?createDatabaseIfNotExist=true</value>

<description>JDBC connect string for a JDBC metastore</description>

</property> <property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description>Driver class name for a JDBC metastore</description>

</property> <property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>username to use against metastore database</description>

</property> <property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>hadoop</value>

<description>password to use against metastore database</description>

</property>

</configuration>

安装mysql

yum install -y mysql mysql-server mysql-devel

#启动mysql服务

/etc/init.d/mysqld start

mysql

USE mysql;

#设置用户及密码

UPDATE user SET Password=PASSWORD('hadoop') WHERE user='root';

#刷新权限

FLUSH PRIVILEGES;

#设置权限

GRANT ALL PRIVILEGES ON . TO 'root'@'%' IDENTIFIED BY 'hadoop' WITH GRANT OPTION;

#设置开机启动mysql服务

chkconfig mysqld on

注意把mysql数据库驱动mysql-connector-java-5.1.32.jar放置在hive lib/目录中

启动hive前,先启动HDFS及YARN集群

Hive几种使用方式:

1.Hive交互shell bin/hive

2.Hive JDBC服务(参考java jdbc连接mysql)

3.hive启动为一个服务器,来对外提供服务

bin/hiveserver2

nohup bin/hiveserver2 1>/var/log/hiveserver.log 2>/var/log/hiveserver.err &

启动成功后,可以在别的节点上用beeline去连接

bin/beeline -u jdbc:hive2://mini1:10000 -n root

或者

bin/beeline

! connect jdbc:hive2://mini1:10000

4.Hive命令

hive -e ‘sql’

bin/hive -e 'select * from t_test'

Hive的介绍及安装的更多相关文章

- Hive学习之一 《Hive的介绍和安装》

一.什么是Hive Hive是建立在 Hadoop 上的数据仓库基础构架.它提供了一系列的工具,可以用来进行数据提取转化加载(ETL),这是一种可以存储.查询和分析存储在 Hadoop 中的大规模数据 ...

- 吴超老师课程--Hive的介绍和安装

1.Hive1.1在hadoop生态圈中属于数据仓库的角色.他能够管理hadoop中的数据,同时可以查询hadoop中的数据. 本质上讲,hive是一个SQL解析引擎.Hive可以把SQL查询转换为 ...

- 从零自学Hadoop(14):Hive介绍及安装

阅读目录 序 介绍 安装 系列索引 本文版权归mephisto和博客园共有,欢迎转载,但须保留此段声明,并给出原文链接,谢谢合作. 文章是哥(mephisto)写的,SourceLink 序 本系列已 ...

- hive学习笔记_hive的介绍与安装

一.什么是Hive Hive是建立在 Hadoop 上的数据仓库基础构架.它提供了一系列的工具,可以用来进行数据提取转化加载(ETL),这是一种可以存储.查询和分析存储在 Hadoop 中的大规模数据 ...

- Hive介绍及安装

Hive介绍及安装 介绍: Hive是基于Hadoop的数据仓库解决方案.由于Hadoop本身在数据存储和计算方面有很好的可扩展性和高容错性,因此使用Hive构建的数据仓库也秉承了这些特性. 简单来说 ...

- Hive介绍和安装部署

搭建环境 部署节点操作系统为CentOS,防火墙和SElinux禁用,创建了一个shiyanlou用户并在系统根目录下创建/app目录,用于存放 Hadoop等组件运行包.因为该目录用于安装h ...

- 从零自学Hadoop(19):HBase介绍及安装

阅读目录 序 介绍 安装 系列索引 本文版权归mephisto和博客园共有,欢迎转载,但须保留此段声明,并给出原文链接,谢谢合作. 文章是哥(mephisto)写的,SourceLink 序 上一篇, ...

- Hive的三种安装方式(内嵌模式,本地模式远程模式)

一.安装模式介绍: Hive官网上介绍了Hive的3种安装方式,分别对应不同的应用场景. 1.内嵌模式(元数据保村在内嵌的derby种,允许一个会话链接,尝试多个会话链接时会报错) ...

- Hadoop入门进阶课程8--Hive介绍和安装部署

本文版权归作者和博客园共有,欢迎转载,但未经作者同意必须保留此段声明,且在文章页面明显位置给出原文连接,博主为石山园,博客地址为 http://www.cnblogs.com/shishanyuan ...

随机推荐

- mysql笔记--group by,limit用法

table: id tag status a b c d 一.group by用法 .与count 联合计数 select status,count(*) from table group by st ...

- tensorflow 滑动平均使用和恢复

https://www.cnblogs.com/hrlnw/p/8067214.html

- mysql时间字符串按年/月/天/时分组查询 -- date_format

SELECT DATE_FORMAT( deteline, "%Y-%m-%d %H" ) , COUNT( * ) FROM test GROUP BY DATE_FORMAT( ...

- Kafka消息重新发送

Kafka消息重新发送 1. 使用kafka消息队列做消息的发布.订阅,如果consumer端消费出问题,导致数据并没有消费,此时不需要担心,数据并不会立刻丢失,kafka会把数据在服务器的磁盘 ...

- UUID生成随机数工具类

package com.qiyuan.util; import java.util.UUID; public class RanNum { /** * 生成随机数<br> * GUID: ...

- MySQL5.6.12 rpm制作及及自动化部署安装

转自:http://blog.itpub.net/29254281/viewspace-1268918/ 首先,下载rpmbuildyum install rpm-build -y它是Red Hat用 ...

- [转]数据库中Schema(模式)概念的理解

在学习数据库时,会遇到一个让人迷糊的Schema的概念.实际上,schema就是数据库对象的集合,这个集合包含了各种对象如:表.视图.存储过程.索引等. 如果把database看作是一个仓库,仓库很多 ...

- Head First Python学习笔记3——持久存储

经过上几章的学习,完成如下任务:读取一个文本文件里的内容,将每一行的内容按“:”分割成两部分,根据分割出第一项判断并分别放入两个列表里,去除首尾空白,在屏幕上打印. # 两个列表用于存储数据man=[ ...

- Linux 添加定时任务,crontab -e 命令与直接编辑 /etc/crontab 文件

1. 使用 crontab -e 命令编辑定时任务列表 使用这个命令编辑的定时任务列表是属于用户级别的,初次编辑后在 /var/spool/cron 目录下生成一个与用户名相同的文件,文件内容就是我们 ...

- JVM读书笔记

1 概念 java virtual machine为java虚拟机,运行使用jdk中编译器编译的java程序. 2 JVM内存模型 程序计数器:线程私有.当前线程正在执行的行号指示器. Java虚拟机 ...