Kafka01--Kafka生产者使用方式

Kafka之--生产者入门

前言:

Kafka诞生至今,产生两个版本的生产者客户端:1是早期基于scala语言编写的客户端;2是随着Java用户的广泛涌入,kafka0.9版本开始退出Java版本的客户端;

一个基本生产者producer逻辑需要具备以下基本条件:

- 配置Producer,创建生产者实例;

- 构建待发送消息;

- 发送消息;

- 关闭生产者实例;

KafkaProducer必要参数和常用参数配置:

必要参数:

bootstrap.servers:待连接的broker地址;

- key.serializer和value.serializer:kafka中的消息都需要转化为字节数组byte[]进行传递,一般会使用到改参数指定key和value的序列化方式。对应的服务端的参数配置中需要有反序列化参数配置,他们是对应的。

KafkaProducer是线程安全的,可以在多个线程中共享单个KafkaProducer实例,或者进行池化,这样方便了使用。在实际使用中,可以通过Java配置方式,在项目启动时进行生产端的初始化,生成对应的实例即可。

可选参数,部分参数没有列出:

- acks :消息发送到某个partition,该参数指定需有多少个副本同步确认后,服务端才会向客户端确认消息发送成功。有三个String的值可配置:

- “1”:默认值。leader副本写入即可确认;

- “0”:生产者只管发送,不需要服务端确认;

- "-1"或者"all":ISR集合中的所有副本确认之后,才会确认;(若ISR中只有leader副本,那仍然无法百分百可靠)

- max.request.size :客户端一条消息容量的最大值,默认为1M。

- retries ,retry.backoff.ms :生产者发送异常时的重试次数和两次重试间的时间间隔。

- max.in.flight.request.per.connection :默认值为5,限制客户端与Node之间最多缓存的请求数量。

- Kafka只能保证一个partition中的消息是有序的。当缓存数>1,且配置重试机制后,有可能出现先发送的消息异常,后发送消息成功,然后先发送的消息重试,这样两条消息的顺序就出现了错乱。若要保证顺序,建议将connection置为1.

- linger.ms :指定生产者发送ProducerBatch之前等待更多消息的写入,默认为0。当batch满了或者linger时间到了,才会 发送。

- request.time.out :生产者发送消息后等待响应的最长时间。

KafkaProducer发送消息:

kafka消息的发送需要通过构建ProducerRecoder对象来实现,该类的属性有:

private final String topic;

private final Integer partition;

private final Headers headers;

private final K key;

private final V value;

private final Long timestamp;

其中,最简的一种使用只需要指定topic和消息体即可。`ProducerRecord<String, String> record = new ProducerRecord<>(topic, "hello, Kafka!");

Kafka有三种发送消息的模式:

- 发送即忘:KafkaProducer只管发送,不管有没有发送成功。

- 同步模式:KafkaProducer发送后阻塞,一致等到Server端返回消息或者抛出异常;(Server端一般有多个副本,多副本的消息确认机制等到服务端介绍时再说);

- 同步模式下,可以根据返回的数据进行进一步的业务处理,比如返回的partition,offset等;

异步模式:通过CallBack回调函数,对服务端响应后的事件进一步处理,;

示例代码如下:

1 public static void main(String[] args) {

2 Properties properties = new Properties();

3 properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, brokerList);

4 properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

5 properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());

6 KafkaProducer<String, String> producer = new KafkaProducer<>(properties);

7 ProducerRecord<String, String> record = new ProducerRecord<>(topic, "hello, Kafka!");

8 try {

9 /**①:发送不管*/

10 producer.send(record);

11 /**②:同步发送:通过调用get方法,进行阻塞,可以通过Future获取发送结果,进行业务逻辑处理*/

12 producer.send(record).get();//同步发送

13 Future<RecordMetadata> future = producer.send(record);

14 RecordMetadata metadata = future.get();

15 //分区为:0偏移量为:240048

16 System.out.println("分区为:" + metadata.partition() + "偏移量为:" + metadata.offset());

17 /**③:异步发送:KafkaProducer将发送请求暂存,当服务端response响应后,从中取出对应的发送请求,然后调用回调函数*/

18 producer.send(record, new Callback() {

19 @Override

20 public void onCompletion(RecordMetadata metadata, Exception exception) {

21 if (exception != null){

22 exception.printStackTrace();

23 }else {

24 //分区为:0偏移量为:240048

25 System.out.println("分区为:" + metadata.partition() + "偏移量为:" + metadata.offset());

26 }

27 }

28 });

29 } catch (Exception e) {

30 e.printStackTrace();

31 }

32 producer.close();

33 }

三种发送模式-示例代码

KafkaProducer消息序列化:

生产端和消费端的序列化方式要一一对应,一般而言,会将消息进行json话之后发送,因此一般指定为kafka自带的StringSerializer类即可;

KafkaProducer分区器:

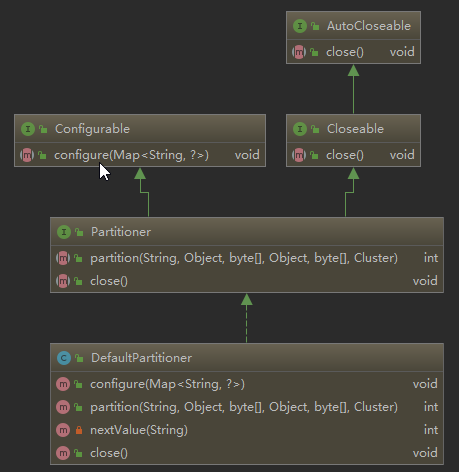

1、生产端将消息发送到broker时,可能要经过拦截器,序列化器,分区器等一系列节点进行处理。默认情况下,Kafka中的消息在发送前,会经过 DefaultPartation 默认分区器进行处理,其从父类实现了两个方法, close(...) 主要进行分区器关闭之后的资源回收。 partition(...) 主要就进行分区的分配,返回int值。configure(...)方法继承自Configurable接口,可以用来获取配置信息和初始化数据,这里只是空实现。

* @param key The key to partition on (or null if no key) key的值

* @param keyBytes serialized key to partition on (or null if no key) key序列化后的值

* @param value The value to partition on or null value值,待发送内容值

* @param valueBytes serialized value to partition on or null value值序列化后的值

* @param cluster The current cluster metadata 集群的元数据信息,包含一些分区数量等信息;

*/

public int partition(String topic, Object key, byte[] keyBytes, Object value, byte[] valueBytes, Cluster cluster

由上面的ProducerRecoder的属性可知,可以在发送消息时,指定消息发送到哪个分区。若采用默认的分区器 DefaultPartation则会包含以下两种情况:

- key为null,消息以轮询的方式发送消息到 topic 中的所有可用分区;

- key不为null,对key进行hash,通过hash值计算分区号,相同key的消息会被发送到同一个分区。

采用默认分区器时,不改变分区的数量,那么key与分区号的映射关系时对应的。若增加一个分区,那么相同的key在增加分区后,就可能不在同一个分区中了。

2、若采用自定义分区器,完全可以根据业务需要,进行自定义分配规则,只需继承父类 Partitioner ,并在生产端配置中加入分区器配置即可,代码示例如下:

//配置中指定分区器

properties.put(ProducerConfig.PARTITIONER_CLASS_CONFIG, DemoPartitioner.class);

...

//因为用了字符串序列化方式,消息体中指定key值为字符串“1”。(这里是根据key值进行分区分配的)

ProducerRecord<String, String> record = new ProducerRecord(topic,"1", "hello, Kafka!");

自定义分区器的示例代码如下:

public class DemoPartitioner implements Partitioner {

//原子类,线程安全

private final AtomicInteger counter = new AtomicInteger(0);

@Override

public int partition(String topic, Object key, byte[] keyBytes, Object value, byte[] valueBytes, Cluster cluster) {

//获取可用分区

List<PartitionInfo> partitions = cluster.partitionsForTopic(topic);

int numPartitions = partitions.size();

// if (null == keyBytes) {

// return counter.getAndIncrement() % numPartitions;

// } else

// return Utils.toPositive(Utils.murmur2(keyBytes)) % numPartitions;

if (key.toString() == "0"){

return 0;

}else

return 1;

}

@Override

public void close() {

}

@Override

public void configure(Map<String, ?> configs) {

}

}

自定义分区器

通过send之后的Future,可以观察到消息确实发送到了不同的分区中。

KafkaProducer拦截器:

拦截器分生产者拦截器和消费者拦截器(后续介绍);

生产者拦截器的作用时间点:

- 消息序列化和计算分区之前,调用生产者拦截器的 onSend() 方法进行个性化操作;

- 消息被服务端应答,或者发送失败时,调用 onAcknowledgement() 方法进行处理,该操作优先于回调函数。

Kafka中提供了父接口 ProducerInterceptor 方便用户进行自定义的拦截器实现,比如可以在自定义的拦截器中对kafka消息的发送数量进行统计:

注:通过onAcknowledgement()统计发送成功与失败数量,而不是 onSend()方法;

public class HawkKafkaProducerInterceptor implements ProducerInterceptor<String, String> {

@Override

public ProducerRecord<String, String> onSend(ProducerRecord<String, String> producerRecord) {

return producerRecord;

}

@Override

public void onAcknowledgement(RecordMetadata recordMetadata, Exception e) {

if (e == null) {

/// success

Cat.logEvent(HawkConstants.KAFKA_PRODUCER_EVENT_TYPE, recordMetadata.topic());

} else {

/// failed

Cat.logEvent(HawkConstants.KAFKA_PRODUCER_EVENT_TYPE, recordMetadata.topic(), HawkConstants.EVENT_FAILED_STATUS, null);

}

}

@Override

public void close() {

}

@Override

public void configure(Map<String, ?> map) {

}

}

自定义拦截器统计消息发送数量

然后需要在配置文件中加入该拦截器:

// 只配置一个拦截器

props.put(ProducerConfig.INTERCEPTOR_CLASSES_CONFIG, HawkKafkaProducerInterceptor.class.getName()); // 若想配置多个拦截器,形成拦截链,则配置顺序即为拦截顺序,以“,”隔开(注意,若拦截器2完全依赖拦截器1的结果,则不利于稳定性)

props.put(ProducerConfig.INTERCEPTOR_CLASSES_CONFIG, "Intercepter01"+","+"Intercepter02);

Kafka01--Kafka生产者使用方式的更多相关文章

- Kafka集群安装部署、Kafka生产者、Kafka消费者

Storm上游数据源之Kakfa 目标: 理解Storm消费的数据来源.理解JMS规范.理解Kafka核心组件.掌握Kakfa生产者API.掌握Kafka消费者API.对流式计算的生态环境有深入的了解 ...

- 【转】 详解Kafka生产者Producer配置

粘贴一下这个配置,与我自己的程序做对比,看看能不能完善我的异步带代码: ----------------------------------------- 详解Kafka生产者Produce ...

- Python 使用python-kafka类库开发kafka生产者&消费者&客户端

使用python-kafka类库开发kafka生产者&消费者&客户端 By: 授客 QQ:1033553122 1.测试环境 python 3.4 zookeeper- ...

- Kafka权威指南 读书笔记之(三)Kafka 生产者一一向 Kafka 写入数据

不管是把 Kafka 作为消息队列.消息总线还是数据存储平台来使用 ,总是需要有一个可以往 Kafka 写入数据的生产者和一个从 Kafka 读取数据的消费者,或者一个兼具两种角色的应用程序. 开发者 ...

- java实现Kafka生产者示例

使用java实现Kafka的生产者 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 3 ...

- kafka生产者和消费者流程

前言 根据源码分析kafka java客户端的生产者和消费者的流程. 基于zookeeper的旧消费者 kafka消费者从消费数据到关闭经历的流程. 由于3个核心线程 基于zookeeper的连接器监 ...

- JAVA封装消息中间件调用一(kafka生产者篇)

这段时间因为工作关系一直在忙于消息中间件的发开,现在趁着项目收尾阶段分享下对kafka的一些使用心得. kafka的原理我这里就不做介绍了,可参考http://orchome.com/kafka/in ...

- Kafka生产者----向kafka写入数据

开发者可以使用kafka内置的客户端API开发kafka应用程序.除了内置的客户端之外,kafka还提供了二进制连接协议,也就是说,我们直接向kafka网络端口发送适当的字节序列,就可以实现从Kafk ...

- 了解Kafka生产者

了解Kafka生产者 之前对kafka的整体架构有浅显的了解,这次正好有时间,准备深入了解一下kafka,首先先从数据的生产者开始吧. 生产者的整体架构 可以看到整个生产者进程主要由两个线程进 ...

- kafka生产者和消费者api的简单使用

kafka生产者和消费者api的简单使用 一.背景 二.需要实现的功能 1.生产者实现功能 1.KafkaProducer线程安全的,可以在多线程中使用. 2.消息发送的key和value的序列化 3 ...

随机推荐

- Ubuntu20.04 Focal Cloudimage扩容以及KVM安装的问题记录

运行Ubuntu20.04的KVM虚机遇到一些问题, 单独总结一下 镜像扩容 不能用virt-resize --expand /dev/sda1 old.qcow2 new.qcow2这样的命令, 这 ...

- NSSCTF-gift_pwn

最近才开始接触"pwn"这个东西,这是近两天做的一个题目,然后就想着记一下. 好的,步入正题, 直接nc连接返回空白,然后直接退出,用kali的checksec工具或者是die检测 ...

- k8s管理平台:rancher

简介 中文官网:https://docs.rancher.cn/ github:https://github.com/rancher/rancher 基础环境 https://www.cnblogs. ...

- C#值类型回收

函数调用在执行时,首先要在栈中为形参和局部变量分配存储空间,然后还要将实参的值复制给形参,接下来还要将函数的返回地址(该地址指明了函数执行结束后,程序应该回到哪里继续执行)放入栈中,最后才跳转到函数内 ...

- MMU 以及 TLB

MMU 以及 TLB MMU(Memory Management Unit)内存管理单元: 一种硬件电路单元负责将虚拟内存地址转换为物理内存地址 所有的内存访问都将通过 MMU 进行转换,除非没有使能 ...

- Codeforces Round #770 (Div. 2)D

传送门 题目大意: 交互题, n ( 4 ≤ n ≤ 1000 ) n(4\leq n\leq1000) n(4≤n≤1000)个数字组成的数列 a 1 , a 2 , - , a n ( 0 ≤ a ...

- java-排查

https://www.chinacion.cn/article/4271.html https://blog.csdn.net/zhengwei223/article/details/7715122 ...

- python post请求中Content-Typ为application/x-www-form-urlencoded; charset=UTF-8 解决方案

# -*- coding: utf-8 -*- import requests import json from urllib import parse import quotes def GtgLo ...

- java面向对象(三)

java面向对象(三) 1.四种权限修饰符 public > protected > (default) > private 注意:(default)并不是关键字default,而是 ...

- 使用MASA Blazor开发一个标准的查询表格页

前言 大家好,我是开源项目 MASA Blazor 主要开发者之一,如果你还不了解MASA Blazor,可以访问我们的 官网 和博客 <初识MASA Blazor> 一探究竟.简单来说, ...