Spark + sbt + IDEA + HelloWorld + MacOS

构建项目步骤

首先要安装好scala、sbt、spark,并且要知道对应的版本

- sbt版本可以在sbt命令行中使用

sbtVersion查看 spark-shell可以知晓机器上spark以及对应的scala的版本

- sbt版本可以在sbt命令行中使用

IDEA中plugin安装scala插件

- pass

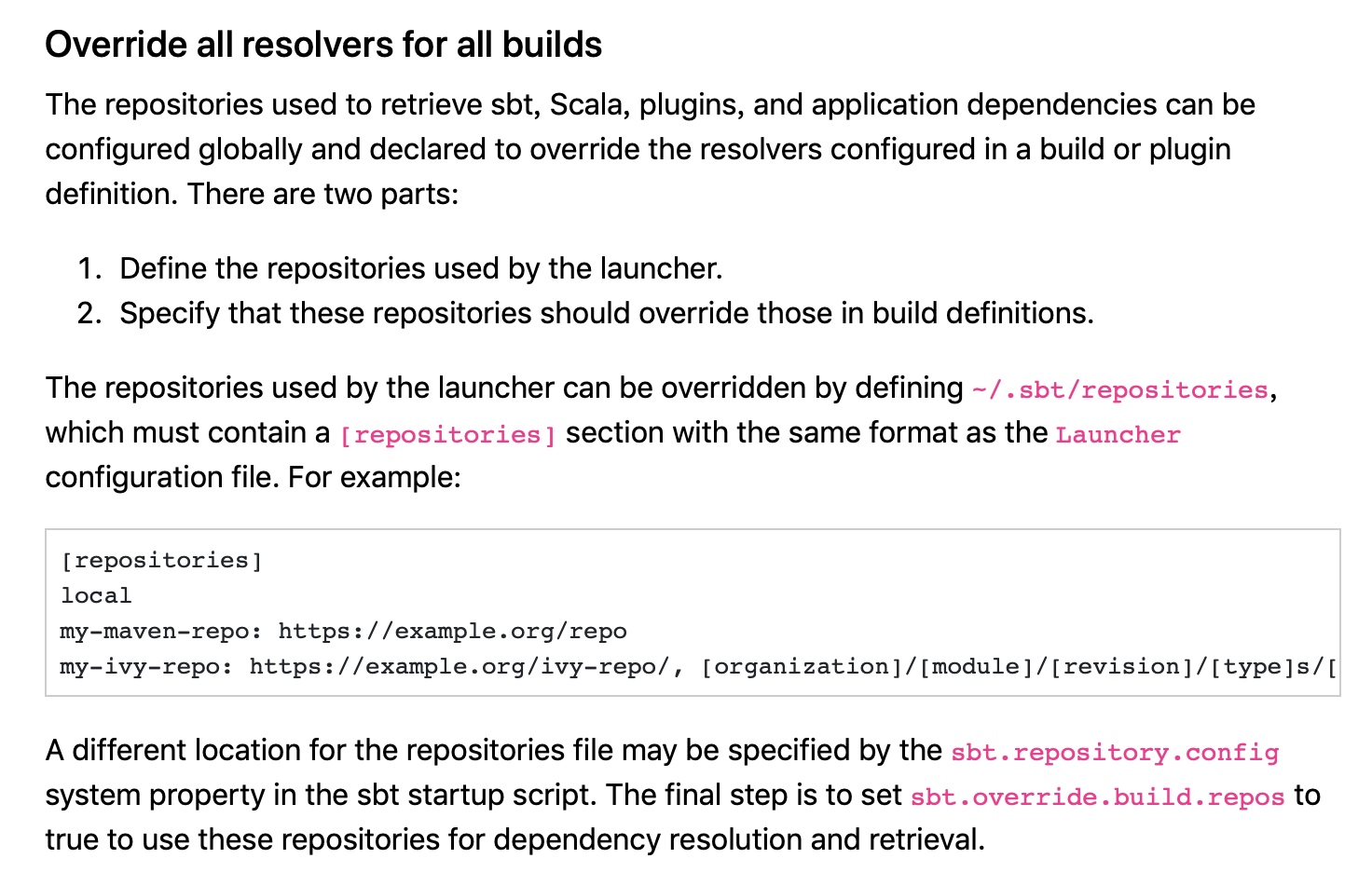

修改配置文件改变IDEA下sbt依赖下载速度慢的问题

参考官网:

具体做法:

vi ~/.sbt/repositories

<---加入--->

[repositories]

local

oschina: http://maven.aliyun.com/nexus/content/groups/public/

jcenter: http://jcenter.bintray.com/

typesafe-ivy-releases: http://repo.typesafe.com/typesafe/ivy-releases/, [organization]/[module]/[revision]/[type]s/[artifact](-[classifier]).[ext], bootOnly

maven-central: http://repo1.maven.org/maven2/

<---结束--->

并在IDEA中找到sbt下的VM parameters,往其中加入:

-Xmx2048M

-XX:MaxPermSize=512m

-XX:ReservedCodeCacheSize=256m

-Dsbt.log.format=true

-Dsbt.global.base=/Users/shayue/.sbt (这里应该替换成.sbt所在地址,下同)

-Dsbt.boot.directory=/Users/shayue/.sbt/boot/

-Dsbt.ivy.home=/Users/shayue/.ivy2 (这里应该替换成.ivy2所在地址,下同)

-Dsbt.override.build.repos=true

-Dsbt.repository.config=/Users/shayue/.sbt/repositories

其中倒数第二句是Jetbrain给出的官方做法,参考https://www.scala-sbt.org/1.0/docs/Command-Line-Reference.html#Command+Line+Options 的最后一行

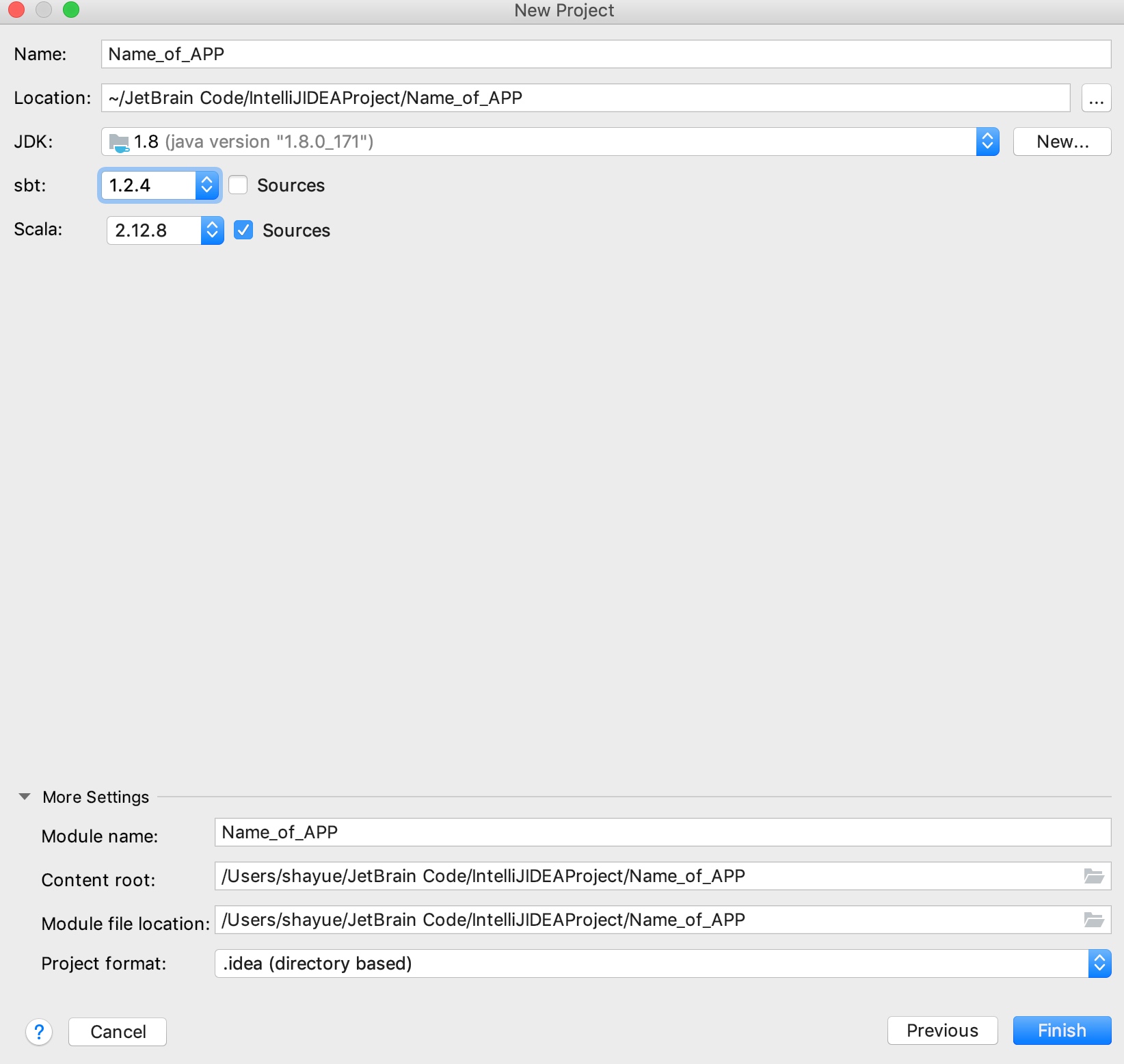

通过sbt构建scala项目,选对版本

修改build.sbt和build.properties,在其中加入适合的版本,并引入Spark依赖

# build.sbt

name := "Name_of_APP" version := "0.1" scalaVersion := "2.12.8" libraryDependencies += "org.apache.spark" %% "spark-core" % "2.4.2"

libraryDependencies += "org.apache.spark" %% "spark-sql" % "2.4.2" # build.properties

sbt.version = 1.2.4其中spark的依赖可以通过spark下载页面找到,或者参考http://spark.apache.org/docs/latest/rdd-programming-guide.html 中的Link with Spark

代码

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.log4j.{Level,Logger}

object ScalaApp {

def main(args: Array[String]) {

//屏蔽启动spark等日志

Logger.getLogger("org.apache.spark").setLevel(Level.WARN)

Logger.getLogger("org.eclipse.jetty.server").setLevel(Level.OFF)

// 设置数据路径

val path = "/Users/shayue/Sample_Code/Machine-Learning-with-Spark/Chapter01/scala-spark-app/data/UserPurchaseHistory.csv"

// 初始化SparkContext

val sc = new SparkContext("local[2]", "First Spark App")

// 将 CSV 格式的原始数据转化为(user,product,price)格式的记录集

val data = sc.textFile(path)

.map(line => line.split(","))

.map(purchaseRecord => (purchaseRecord(0), purchaseRecord(1), purchaseRecord(2)))

// 求购买总次数

val numPurchases = data.count()

// 求有多少个不同用户购买过商品

val uniqueUsers = data.map{ case (user, product, price) => user }.distinct().count()

// 求和得出总收入

val totalRevenue = data.map{ case (user, product, price) => price.toDouble }.sum()

// 求最畅销的产品是什么

val productsByPopularity = data

.map{ case (user, product, price) => (product, 1) }

.reduceByKey(_ + _ ).collect()

.sortBy(-_._2)

val mostPopular = productsByPopularity(0)

// 打印

println("Total purchases: " + numPurchases)

println("Unique users: " + uniqueUsers)

println("Total revenue: " + totalRevenue)

println("Most popular product: %s with %d purchases" .format(mostPopular._1, mostPopular._2))

}

}

输出:

Total purchases: 5

Unique users: 4

Total revenue: 39.91

Most popular product: iPhone Cover with 2 purchases

参考

- 第一张VM parameter修改参考https://blog.csdn.net/jameshadoop/article/details/522957109153012.html

- 代码来自《Spark机器学习》第二版

Spark + sbt + IDEA + HelloWorld + MacOS的更多相关文章

- IDEA 学习笔记之 Spark/SBT项目开发

Spark/SBT项目开发: 下载Scala SDK 下载SBT 配置IDEA SBT:(如果不配置,就会重新下载SBT, 非常慢,因为以前我已经下过了,所以要配置为过去使用的SBT) 新建立SBT项 ...

- Eclipse + Idea + Maven + Scala + Spark +sbt

http://jingpin.jikexueyuan.com/article/47043.html 新的scala 编译器idea使用 https://www.jetbrains.com/idea/h ...

- spark入门(helloworld插件)

1 http://www.cnblogs.com/openfire/archive/2013/04/26/3044722.html 2 在bulid文件夹下,(注意为主目录不是插件下的bulid.xm ...

- [转] 用SBT编译Spark的WordCount程序

问题导读: 1.什么是sbt? 2.sbt项目环境如何建立? 3.如何使用sbt编译打包scala? [sbt介绍 sbt是一个代码编译工具,是scala界的mvn,可以编译scala,java等,需 ...

- 用SBT编译Spark的WordCount程序

问题导读: 1.什么是sbt? 2.sbt项目环境如何建立? 3.如何使用sbt编译打包scala? sbt介绍 sbt是一个代码编译工具,是scala界的mvn,可以编译scala,java等,需要 ...

- Spark环境搭建(六)-----------sprk源码编译

想要搭建自己的Hadoop和spark集群,尤其是在生产环境中,下载官网提供的安装包远远不够的,必须要自己源码编译spark才行. 环境准备: 1,Maven环境搭建,版本Apache Maven 3 ...

- sbt安装

使用 Scala 编写的程序需要使用 sbt 进行编译打包,官网sbt下载解压 在解压路径下创建脚本: #!/bin/bash SBT_OPTS="-Xms512M -Xmx1536M -X ...

- Spark和pyspark的配置安装

如何安装Spark和Pyspark构建Spark学习环境[MacOs] JDK环境 Python环境 Spark引擎 下载地址:Apache-Spark官网 MacOs下一般安装在/usr/local ...

- 查看Spark与Hadoop等其他组件的兼容版本

安装与Spark相关的其他组件的时候,例如JDK,Hadoop,Yarn,Hive,Kafka等,要考虑到这些组件和Spark的版本兼容关系.这个对应关系可以在Spark源代码的pom.xml文件中查 ...

随机推荐

- fsLayuiPlugin富文本编辑器使用(layedit)

富文本编辑器基于layedit实现.演示地址:http://fslayui.itcto.cn 富文本编辑器使用 必须使用textarea标签 id必须定义 必须定义样式fsLayedit 可以通过he ...

- ubuntu 服务器添加新磁盘

原文 Linux系统扩容根目录磁盘空间的操作方法 这篇文章主要介绍了Linux系统扩容根目录磁盘空间的操作方法,非常不错,具有一定的参考借鉴价值,需要的朋友可以参考下 一.使用背景 Linux根目录磁 ...

- EMF中复制对象属性

1.简单的场景就是复制一个EObject,可以用工具类中的方法EcoreUtil.copy(). 2.场景:自己的TO类继承了EMF创建出的类,需要复制父类中的所有属性. /** * 将父类所有的属性 ...

- Java8-Lambda-No.01

import java.util.Arrays; import java.util.Collections; import java.util.Comparator; import java.util ...

- Java8-Lock-No.05

import java.util.concurrent.ExecutorService; import java.util.concurrent.Executors; import java.util ...

- 2019牛客多校第三场D BigInteger——基础数论

题意: 用 $A(n)$ 表示第 $n$ 个只由1组成分整数,现给定一个素数 $p$,求满足 $1 \leq i\leq n, 1 \leq j \leq m, A(i^j) \equiv 0(mo ...

- Spring Boot常用的注解

@SpringBootApplication:包含@Configuration.@EnableAutoConfiguration.@ComponentScan通常用在主类上.由于大量项目都会在主要的配 ...

- vmware 安装centos7 阿里云镜像 虚拟机

一.资源准备: 1.vmware软件下载: 百度自行下载安装 2.阿里云镜像地址:https://opsx.alibaba.com/mirror 1).镜像下载步骤: 点击计入centos: 这里直接 ...

- 【题解】狼和羊-C++

Description 米基家的后院养着一群羊,米基由于疲劳睡着了,这时一群饿狼钻进了后院开始攻击羊群,后院是由许多个方格构成的长方形区域,每个方格中用字符'?'表示空地,'#'表示栅栏,'o'表示羊 ...

- Flutter布局4--Row

Row 简介 mainAxisAlignment:主轴布局方式,row主轴方向是水平方向 crossAxisAlignment: 交叉轴的布局方式,对于row来说就是垂直方向的布局方式 Row 是一个 ...