【Hadoop学习之十】MapReduce案例分析二-好友推荐

环境

虚拟机:VMware 10

Linux版本:CentOS-6.5-x86_64

客户端:Xshell4

FTP:Xftp4

jdk8

hadoop-3.1.1

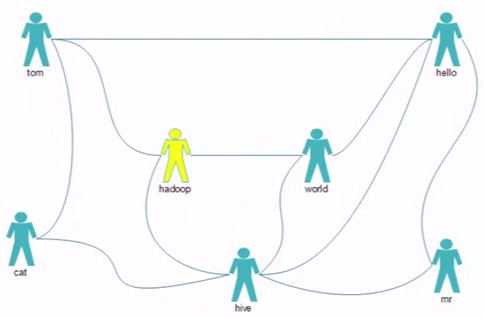

最应该推荐的好友TopN,如何排名?

tom hello hadoop cat

world hadoop hello hive

cat tom hive

mr hive hello

hive cat hadoop world hello mr

hadoop tom hive world

hello tom world hive mr

package test.mr.fof; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser; public class MyFOF { /**

* 最应该推荐的好友TopN,如何排名? * @param args

* @throws Exception

*/

public static void main(String[] args) throws Exception { Configuration conf = new Configuration(true);

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();

conf.set("sleep", otherArgs[2]); Job job = Job.getInstance(conf,"FOF");

job.setJarByClass(MyFOF.class); //Map

job.setMapperClass(FMapper.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(IntWritable.class); //Reduce

job.setReducerClass(FReducer.class); //HDFS 输入路径

Path input = new Path(otherArgs[0]);

FileInputFormat.addInputPath(job, input );

//HDFS 输出路径

Path output = new Path(otherArgs[1]);

if(output.getFileSystem(conf).exists(output)){

output.getFileSystem(conf).delete(output,true);

}

FileOutputFormat.setOutputPath(job, output ); System.exit(job.waitForCompletion(true) ? 0 :1);

}

// tom hello hadoop cat

// world hadoop hello hive

// cat tom hive

// mr hive hello

// hive cat hadoop world hello mr

// hadoop tom hive world

// hello tom world hive mr }

package test.mr.fof; import java.io.IOException; import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.util.StringUtils; public class FMapper extends Mapper<LongWritable, Text, Text, IntWritable>{ Text mkey= new Text();

IntWritable mval = new IntWritable(); @Override

protected void map(LongWritable key, Text value,Context context)

throws IOException, InterruptedException { //value: 0-直接关系 1-间接关系

//tom hello hadoop cat : hello:hello 1

//hello tom world hive mr hello:hello 0 String[] strs = StringUtils.split(value.toString(), ' '); String user=strs[0];

String user01=null;

for(int i=1;i<strs.length;i++){

//与好友清单中好友属于直接关系

mkey.set(fof(strs[0],strs[i]));

mval.set(0);

context.write(mkey, mval); for (int j = i+1; j < strs.length; j++) {

Thread.sleep(context.getConfiguration().getInt("sleep", 0));

//好友列表内 成员之间是间接关系

mkey.set(fof(strs[i],strs[j]));

mval.set(1);

context.write(mkey, mval);

}

}

} public static String fof(String str1 , String str2){ if(str1.compareTo(str2) > 0){

//hello,hadoop

return str2+":"+str1;

}

//hadoop,hello

return str1+":"+str2;

} }

package test.mr.fof; import java.io.IOException; import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer; public class FReducer extends Reducer<Text, IntWritable, Text, Text> { Text rval = new Text();

@Override

protected void reduce(Text key, Iterable<IntWritable> vals, Context context)

throws IOException, InterruptedException

{

//是简单的好友列表的差集吗?

//最应该推荐的好友TopN,如何排名? //hadoop:hello 1

//hadoop:hello 0

//hadoop:hello 1

//hadoop:hello 1

int sum=0;

int flg=0;

for (IntWritable v : vals)

{

//0为直接关系

if(v.get()==0){

//hadoop:hello 0

flg=1;

}

sum += v.get();

} //只有间接关系才会被输出

if(flg==0){

rval.set(sum+"");

context.write(key, rval);

}

}

}

【Hadoop学习之十】MapReduce案例分析二-好友推荐的更多相关文章

- MapReduce深度分析(二)

MapReduce深度分析(二) 五.JobTracker分析 JobTracker是hadoop的重要的后台守护进程之一,主要的功能是管理任务调度.管理TaskTracker.监控作业执行.运行作业 ...

- Hadoop学习笔记—20.网站日志分析项目案例(二)数据清洗

网站日志分析项目案例(一)项目介绍:http://www.cnblogs.com/edisonchou/p/4449082.html 网站日志分析项目案例(二)数据清洗:当前页面 网站日志分析项目案例 ...

- 【Hadoop学习之十三】MapReduce案例分析五-ItemCF

环境 虚拟机:VMware 10 Linux版本:CentOS-6.5-x86_64 客户端:Xshell4 FTP:Xftp4 jdk8 hadoop-3.1.1 推荐系统——协同过滤(Collab ...

- Hadoop学习笔记—20.网站日志分析项目案例(一)项目介绍

网站日志分析项目案例(一)项目介绍:当前页面 网站日志分析项目案例(二)数据清洗:http://www.cnblogs.com/edisonchou/p/4458219.html 网站日志分析项目案例 ...

- Hadoop学习笔记—20.网站日志分析项目案例(三)统计分析

网站日志分析项目案例(一)项目介绍:http://www.cnblogs.com/edisonchou/p/4449082.html 网站日志分析项目案例(二)数据清洗:http://www.cnbl ...

- [b0012] Hadoop 版hello word mapreduce wordcount 运行(二)

目的: 学习Hadoop mapreduce 开发环境eclipse windows下的搭建 环境: Winows 7 64 eclipse 直接连接hadoop运行的环境已经搭建好,结果输出到ecl ...

- 【第二课】kaggle案例分析二

Evernote Export 推荐系统比赛(常见比赛) 推荐系统分类 最能变现的机器学习应用 基于应用领域分类:电子商务推荐,社交好友推荐,搜索引擎推荐,信息内容推荐等 **基于设计思想:**基于协 ...

- 【Hadoop学习之十二】MapReduce案例分析四-TF-IDF

环境 虚拟机:VMware 10 Linux版本:CentOS-6.5-x86_64 客户端:Xshell4 FTP:Xftp4 jdk8 hadoop-3.1.1 概念TF-IDF(term fre ...

- 【Hadoop学习之九】MapReduce案例分析一-天气

环境 虚拟机:VMware 10 Linux版本:CentOS-6.5-x86_64 客户端:Xshell4 FTP:Xftp4 jdk8 hadoop-3.1.1 找出每个月气温最高的2天 1949 ...

随机推荐

- js中值的基本类型与引用类型,以及对象引用,对象的浅拷贝与深拷贝

js有两种类型的值:栈:原始数据类型(undefinen,null,boolead,number,string)堆:引用数据类型(对象,函数和数组)两种类型的区别是:储存位置不同,原始数据类型直接存储 ...

- 01.jupyter环境安装

jupyter notebook环境安装 一.什么是Jupyter Notebook? 1. 简介 Jupyter Notebook是基于网页的用于交互计算的应用程序.其可被应用于全过程计算:开发.文 ...

- python小练--使用正则表达式将json解析成dict

练习python语法,自己实现了一个简单的解析json字符,存为dict字典对象. { "id":12, "name":"jack", &q ...

- (1.11)SQL优化——mysql提示(hint)

(1.11)mysql hint 关键词:mysql提示 1.SQL提示 (hint)是优化数据库的手段之一,使用它加入一些人为的提示来达到优化操作的目的: 举例: select sql_buffer ...

- pip安装提示pkg_resources.DistributionNotFound: pip==18.1

在用pip install安装依赖的时候提示pkg_resources.DistributionNotFound: pip==18.1,更新一下pip就可以了 easy_install pip==18 ...

- HIVE简单操作

1.hive命令登录HIVE数据库后,执行show databases;命令可以看到hive数据库中有一个默认的default数据库. [root@hadoop hive]# hive Logging ...

- docker基本原理

写的很不错的文章,作个存档 什么是容器 容器是 种轻量级.可移植的为应用程序提供了隔离的运行空间 .每个容器内都包含一个独享的完整用户环境,并且 个容器内的环境变动不会影响其他容器的运行环境,可以使应 ...

- 008-docker-安装-tomcat:8.5.38-jre8

1.搜索镜像 docker search tomcat 2.拉取合适镜像 查询tags:https://hub.docker.com/ docker pull tomcat:8.5.38-jre8 d ...

- [js]javascript中4种异步

javascript中4种异步: 1.ajax 2.定时器 3.事件绑定 4,回调 定时器 //顺序执行 /* var s = 0; for (var i = 0; i < 10000; i++ ...

- Visual Studio Code的常用快捷键

一.Visual Studio Code简介 Visual Studio Code是个牛逼的编辑器,启动非常快,完全可以用来代替其他文本文件编辑工具.又可以用来做开发,支持各种语言,相比其他IDE,轻 ...