Sqoop(三)将关系型数据库中的数据导入到HDFS(包括hive,hbase中)

一、说明:

将关系型数据库中的数据导入到 HDFS(包括 Hive, HBase) 中,如果导入的是 Hive,那么当 Hive 中没有对应表时,则自动创建。

二、操作

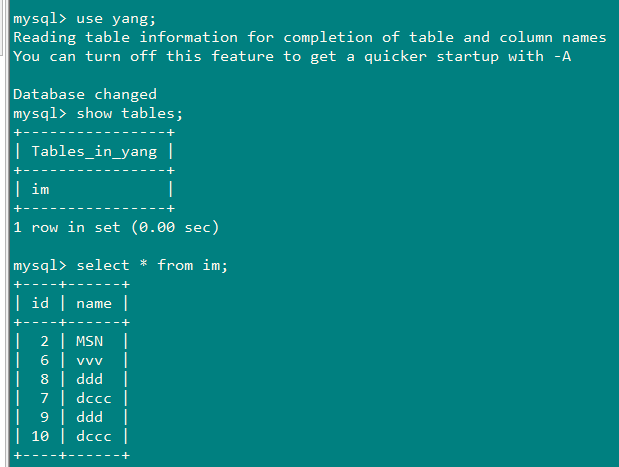

1、创建一张跟mysql中的im表一样的hive表im:

sqoop create-hive-table \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--hive-table im

过程中报错总结:

ERROR Could not register mbeans java.security.AccessControlException: access denied

("javax.management.MBeanTrustPermission" "register

解决方法:

1、将hive-site.xml复制到${SQOOP_HOME}/conf下

2、vim $JAVA_HOME/jre/lib/security/java.policy:

在grant{}内部添加如下内容:

permission javax.management.MBeanTrustPermission "register";

Could not load org.apache.hadoop.hive.conf.HiveConf. Make sure HIVE_CONF_DIR

解决方法:

将hive 里面的lib下的hive-exec-**.jar 放到sqoop 的lib 下

2、将mysql中的数据导入到HDFS

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209\

--table im \

-m 1

3、将mysql中的数据导入到HDFS(按照指定分隔符和路径进行导入)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--target-dir /test/ \

--fields-terminated-by ',' \

-m 1

4、将mysql中的数据导入到HDFS(带where条件)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--where "name='dccc'" \

--table im \

--target-dir /test/ \

-m 1

带where条件,查询指定列(相当于select name from im where name="dccc")

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--columns "name" \

--where "name='dccc'" \

--table im \

--target-dir /test/ \

-m 1

5、将mysql中的数据导入到HDFS(自定义查询SQL)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--target-dir /test/ \

--query 'select id,name from im where $CONDITIONS ' \

--split-by id \

--fields-terminated-by '\t' \

-m 2

说明:

--split-by:

1.split-by 根据不同的参数类型有不同的切分方法,如int型,Sqoop会取最大和最小split-by字段值,然后根据传入的num-mappers来 确定划分几个区域。比如select max(split_by),min(split-by) from得到的max(split-by)和min(split-by)分别为1000和1,而num-mappers(-m)为2的话,则会分成两个区域 (1,500)和(501-1000),同时也会分成2个sql给2个map去进行导入操作,分别为select XXX from table where split-by>=1 and split-by<500和select XXX from table where split-by>=501 and split-by<=1000.最后每个map各自获取各自SQL中的数据进行导入工作。

2.当split-by不是int型时出现如上场景中的问题。目前想到的解决办法是:将-m 设置称1,split-by不设置,即只有一个map运行,缺点是不能并行map录入数据。(注意,当-m 设置的值大于1时,split-by必须设置字段)

3.split-by即便是int型,若不是连续有规律递增的话,各个map分配的数据是不均衡的,可能会有些map很忙,有些map几乎没有数据处理的情况

CONDITIONS:

SQoop Query imports自由查询模式下$CONDITIONS的作用:

1、必须制定目标文件的位置:--target-dir

2、必须使用$CONDITIONS关键字

3、选择使用--split-by分片(分区,结果分成多个小文件)

6、将mysql中的数据导入到Hive

sqoop import --connect jdbc:mysql://192.168.200.100:3306/yang --username root --password 010209 --table im --hive-import -m 1

7、指定分隔符和列分隔符,指定hive-import,指定覆盖导入,指定自动创建Hive表,指定表名,指定删除中间结果数据目录

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--fields-terminated-by "\t" \

--lines-terminated-by "\n" \

--hive-import \

--hive-overwrite \

--create-hive-table \

--delete-target-dir \

--hive-database yang \

--hive-table im

-m 1

8、将Mysql数据库中的表数据导入到Hbase(普通导入)

sqoop import \

--connect jdbc:mysql://192.168.200.100:3306/yang \

--username root \

--password 010209 \

--table im \

--hbase-table im \

--column-family cf \

--hbase-row-key keyid

Sqoop(三)将关系型数据库中的数据导入到HDFS(包括hive,hbase中)的更多相关文章

- sqoop数据导入到Hdfs 或者hive

用java代码调用shell脚本执行sqoop将hive表中数据导出到mysql http://www.cnblogs.com/xuyou551/p/7999773.html 用sqoop将mysql ...

- 大数据入门到精通18--sqoop 导入关系库到hdfs中和hive表中

一,选择数据库,这里使用标准mysql sakila数据库 mysql -u root -D sakila -p 二.首先尝试把表中的数据导入到hdfs文件中,这样后续就可以使用spark来dataf ...

- Sqoop1.99.7将MySQL数据导入到HDFS中

准备 本示例将实现从MySQL数据库中将数据导入到HDFS中 参考文档: http://sqoop.apache.org/docs/1.99.7/user/Sqoop5MinutesDemo.html ...

- 如何使用免费控件将Word表格中的数据导入到Excel中

我通常使用MS Excel来存储和处理大量数据,但有时候经常会碰到一个问题—我需要的数据存储在word表格中,而不是在Excel中,这样处理起来非常麻烦,尤其是在数据比较庞大的时候, 这时我迫切地需要 ...

- 使用sqoop将MySQL数据库中的数据导入Hbase

使用sqoop将MySQL数据库中的数据导入Hbase 前提:安装好 sqoop.hbase. 下载jbdc驱动:mysql-connector-java-5.1.10.jar 将 mysql-con ...

- 如何将数据库中的数据导入到Solr中

要使用solr实现网站中商品搜索,需要将mysql数据库中数据在solr中创建索引. 1.需要在solr的schema.xml文件定义要存储的商品Field. 商品表中的字段为: 配置内容是: < ...

- phpexcel的写操作将数据库中的数据导入到excel中

这个版本据说是可以支持excel2007,但是我使用2007编辑的xlsx是无法获得该库的支持.于是乎我就将它转化为2003.感觉支持地很好. 下面介绍一下具体的使用: require_once('. ...

- 用ttBulkCp把excel中的数据导入到timesten数据库中

最近要做数据预处理,需要用到数据库.而且是以前从来没听说过的TimesTen. 首要目标是要把Excel里的数据,导入到TimesTen数据库中.而TimesTen在win10里用不了,于是我就在虚拟 ...

- 如何将redis中的数据导入到本地MongoDB和MySQL数据库

将redis中的数据导入到本地MongoDB数据库 创建一个process_items_mongodb.py文件(文件名自定义): #!/usr/bin/env python # -*- coding ...

随机推荐

- 搭建ARL资产安全灯塔

老年人了,只能靠安装部署项目混混日子这样~ 简介: 斗象TCC团队正式发布「ARL资产安全灯塔」开源版,该项目现已上线开源社区GitHub.ARL旨在快速侦察与目标关联的互联网资产,构建基础资产信息库 ...

- Symbol类型是不可枚举的

const info = { [Symbol('a')]: 'b' } console.log(info)//{Symbol('a'): 'b'} console.log(Object.keys(in ...

- sql server如何把退款总金额拆分到尽量少的多个订单中

一.问题 原来有三个充值订单,现在要退款450元,如何分配才能让本次退款涉及的充值订单数量最少?具体数据参考下图: 二.解决方案 Step 1:对可退金额进行降序排列,以便优先使用可退金额比较大的订单 ...

- 1、MyCat入门

1.Mycat简介 [1].Mycat是什么 Mycat 是数据库中间件 [2].why使用Mycat ①.Java与数据库紧耦合 ②.高访问量高并发对数据库的压力 ③.读写请求数据不一致 [3].数 ...

- Docker 安装并部署Tomcat、Mysql8、Redis

1. 安装前检查 1 #ContOS 7安装Docker系统为64位,内核版本为3.10+ 2 lsb_release -a 3 4 uname -r 5 6 #更新yum源 7 yum -y up ...

- 深入浅出java的Map

HashMap的组成 首先了解数组和链表两个数据结构 1.数组 寻址容易,插入和删除元素困难 数组由于是紧凑连续存储,可以随机访问,通过索引快速找到对应元素,而且相对节约存储空间. 但正因为连续存储, ...

- react第十三单元(react路由-react路由的跳转以及路由信息) #课程目标

第十三单元(react路由-react路由的跳转以及路由信息) #课程目标 熟悉掌握路由的配置 熟悉掌握跳转路由的方式 熟悉掌握路由跳转传参的方式 可以根据对其的理解封装一个类似Vue的router- ...

- [BUUCTF] MISC-九连环

0x01 知识点 伪加密 steghide提取信息 0x02 伪加密的判断 首先,在winhex分析,发现有4个zip文件的文件头和2个文件尾,有完整文件头尾那么可以直接修改后缀为zip解压, 查看一 ...

- PHP代码样例

1 <?php 2 3 /** 4 * 时间:2015-8-6 5 * 作者:River 6 * 超级有用.必须收藏的PHP代码样例 7 */ 8 class Helper { 9 10 /** ...

- MySQL在Windows下压缩包方式安装与卸载

一.MySQL的卸载: 1.停止MySQL服务 2.移除MySQL 二.安装: 1.官网下载压缩版 https://downloads.mysql.com/archives/community/ 2. ...