[DB] Spark SQL

概述

- 基于Spark,兼容Hive

- 集成在Spark中,不需单独安装

- 提供统一的数据访问方式

- 结构化的数据类型:JDBC、JSON、Hive、Parquet(Saprk SQL 默认数据源)

- 支持标准的数据连接:JDBC、ODBC

- Hive把sql解析成了mapreduce程序,sparksql把sql语句解析成了Spark任务

- spark core 操作RDD,spark sql 操作DataFrame

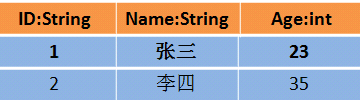

- RDD内部元素是java对象,DataFrame内部是Row对象,相比于RDD多了元信息

- DataFrame是一种以RDD为基础的分布式数据集,类似MySQL的表

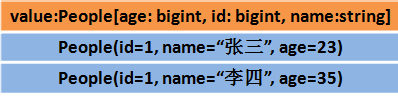

- DataSet是分布式的数据集合,提供了强类型支持,在RDD每行增加类型约束,解决了DataFrame缺乏编译时类型安全

- DataSet包含了DataFrame功能,Spark2.0中两者统一,DataFrame表示为DataSet[Row]

- 表(DataFrame)= 结构(Schema) + 数据(RDD)

- Spark on Hive:通过Sparksql加载Hive配置文件,获取元信息,底层运行Spark RDD(Spark主导,拿到Hive元信息),例如通过Spark程序将Hive数据写入ES

- Hive on Spark:把Hive查询从mr操作替换为Spark RDD操作,需重新编译Spark,操作较复杂(Hive主导,替换计算引擎)

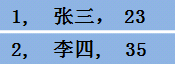

RDD

RDD

DataFrame

DataFrame

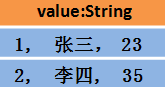

或

或 DataSet

DataSet

优缺点

RDD

- 优点

- 编译时类型安全

- 面向对象开发风格

- 缺点

- 构建java对象会占用heap堆空间,导致频繁GC

- 数据序列化,反序列化开销大

DataFrame

- 优点

- 引入off-heap,对象构建不占用堆内存,避免频繁GC,运行效率高

- 引入schema,传输数据量减小,序列化反序列化开销减小

- 缺点

- 编译时不安全

- 不具有面向对象开发风格

DataSet

- 优点

- 结合RDD和DataFrame

- 支持自定义对象存储

- 支持结构化数据sql查询

- 采用堆外存储,gc友好

- 类型转换安全,代码友好

创建DataFrame

- 使用 case class 样本类

- 定义表的 schema

- 导入HDFS的dept.csv作为数据

- 使用 Spark Session

- 包括 Spark Context、SQL Context、Streaming Context

- 2.0后引入的统一访问接口,可访问所有spark组件

- 使用StructType创建schema

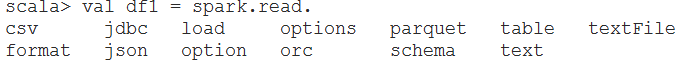

- 读取带格式文件

- Json

操作DataFrame

- DSL语句

- SQL语句

DataSet

视图

- 虚表,不存储数据

- 普通视图:本地视图,只在当前session中有效

- 全局视图:在不同session中都有效,把全局视图创建命名空间,global_temp

数据源

- load() 和 save()

- Parquet文件

- 列式存储文件,Spark SQL默认数据源

- 把其它文件转为Parquet文件

- 支持Schema的合并:项目开始的时候,表(schema)很简单,逐步向表中增加新的列

- Json文件

- val testResult = spark.read.json("/usr/local/tmp_files/emp.json")

- JDBC

- Hive

自定义函数

- UDF

- UDAF

性能优化

- 缓存方式:在内存中缓存数据

- 性能优化参数

IDE中开发

- 关闭log4j

参考

官网

Spark 集成 Hive

https://www.cnblogs.com/juncaoit/p/6545092.html

https://blog.csdn.net/qq_16633405/article/details/78278786

https://blog.csdn.net/weixin_37677769/article/details/83580893

http://bcxw.net/article/550.html

https://blog.csdn.net/qq_38704184/article/details/86482948

https://blog.csdn.net/xiaohu21/article/details/108960672

[DB] Spark SQL的更多相关文章

- Spark SQL Thrift Server 配置 Kerberos身份认证和权限管理

转载请注明出处:http://www.cnblogs.com/xiaodf/ 之前的博客介绍了通过Kerberos + Sentry的方式实现了hive server2的身份认证和权限管理功能,本文主 ...

- Spark SQL概念学习系列之Spark SQL 架构分析(四)

Spark SQL 与传统 DBMS 的查询优化器 + 执行器的架构较为类似,只不过其执行器是在分布式环境中实现,并采用的 Spark 作为执行引擎. Spark SQL 的查询优化是Catalyst ...

- Spark SQL 初步

已经Spark Submit 2013哪里有介绍Spark SQL.就在很多人都介绍Catalyst查询优化框架.经过一年的发展后,.今年Spark Submit 2014在.Databricks放弃 ...

- 大数据技术之_19_Spark学习_03_Spark SQL 应用解析 + Spark SQL 概述、解析 、数据源、实战 + 执行 Spark SQL 查询 + JDBC/ODBC 服务器

第1章 Spark SQL 概述1.1 什么是 Spark SQL1.2 RDD vs DataFrames vs DataSet1.2.1 RDD1.2.2 DataFrame1.2.3 DataS ...

- spark SQL读取ORC文件从Driver启动到开始执行Task(或stage)间隔时间太长(计算Partition时间太长)且产出orc单个文件中stripe个数太多问题解决方案

1.背景: 控制上游文件个数每天7000个,每个文件大小小于256M,50亿条+,orc格式.查看每个文件的stripe个数,500个左右,查询命令:hdfs fsck viewfs://hadoop ...

- 通过spark sql 将 hdfs上文件导入到mongodb

功能:通过spark sql 将hdfs 中文件导入到mongdo 所需jar包有:mongo-spark-connector_2.11-2.1.2.jar.mongo-java-driver-3.8 ...

- Spark SQL笔记

HDFS HDFS架构 1.Master(NameNode/NN) 对应 N个Slaves(DataNode/NN)2.一个文件会被拆分成多个块(Block)默认:128M例: 130M ==> ...

- Spark SQL快速离线数据分析

拷贝hive-site.xml到spark的conf目录下面 打开spark的conf目录下的hive-site.xml文件 加上这段配置(我这里三个节点的spark都这样配置) 把hive中的mys ...

- Caused by: java.sql.SQLException: Failed to start database 'metastore_db' with class loader org.apache.spark.sql.hive.client.IsolatedClientLoader$$anon$1@d7c365, see the next exception for details.

解决方法:https://stackoverflow.com/questions/37442910/spark-shell-startup-errors 异常: 18/01/29 19:04:27 W ...

随机推荐

- Http请求状态码302,已得到html页面但未跳转?HttpServletRequest转发/HttpServletResponse重定向后,前端页面未跳转?Ajax怎么处理页面跳转?

论断 出现此类错误,服务器端出现问题的可能性不大,大概率是前端问题. 问题概述 事情是这样的,我在用Java开发后端.前端页面使用jQuery库的 $.getJSON() 方法发送了一个Ajax请求. ...

- 【RocketMQ源码分析】深入消息存储(3)

前文回顾 CommitLog篇 --[RocketMQ源码分析]深入消息存储(1) ConsumeQueue篇 --[RocketMQ源码分析]深入消息存储(2) 前面两篇已经说过了消息如何存储到Co ...

- 学习笔记-vue+quill简单的后台demo

功能比较单一 https://github.com/opceclee/vue-quill

- nacos下载慢吗?来这里

https://gitee.com/soul_PreCoder/springcloudalibab/repository/archive/master.zip

- ES9的新特性:异步遍历Async iteration

ES9的新特性:异步遍历Async iteration 目录 简介 异步遍历 异步iterable的遍历 异步iterable的生成 异步方法和异步生成器 简介 在ES6中,引入了同步iteratio ...

- MySQL提升笔记(2):存储引擎盘点

在前面我们了解了server层调用存储引擎层接口来完成sql的执行,使用存储引擎的好处是:每个存储引擎都有各自的特点,能够根据具体的应用建立不同存储引擎表. 需要注意的是,存储引擎是基于表的,而不是数 ...

- 1.PreparedStatement VS Statement

两者都是Sun公司定义的接口,PreparedStatement属于Statement的子接口.二者类似信使,向数据库中执行sql语句: Statement存在拼串的操作,比较繁琐:存在SQL注入问题 ...

- 当 Go struct 遇上 Mutex

struct 是我们写 Go 必然会用到的关键字, 不过当 struct 遇上一些比较特殊类型的时候, 你注意过你的程序是否正常吗 ? 一段代码 type URL struct { Ip string ...

- 源码编译安装MySQL8.0.20

1 概述 本文章主要讲述了如何从源码编译安装MySQL社区版8.0.20,首先会介绍一些编译安装的相关知识,然后开始编译安装 2 源码编译安装的相关知识 2.1 make与configure make ...

- Java JVM 启动参数

JVM 启动参数 java -Xmx4096m // 设置JVM最大可用内存为4096m. -Xms4096m // 设置JVM促使内存为4096m.此值可以设置与-Xmx相同,以避免每次垃圾回收完成 ...