在昇腾Ascend 910B上运行Qwen2.5推理

目前在国产 AI 芯片,例如昇腾 NPU 上运行大模型是一项广泛且迫切的需求,然而当前的生态还远未成熟。从底层芯片的算力性能、计算架构的算子优化,到上层推理框架对各种模型的支持及推理加速,仍有很多需要完善的地方。

今天带来一篇在昇腾 910B 上运行 Qwen 2.5 执行推理的操作实践。

配置昇腾环境

在昇腾 NPU 服务器上,确认昇腾 NPU 驱动已安装:

npu-smi info

根据架构下载对应的 CANN Toolkit 包(开发套件)和对应芯片的 Kernel 包(CANN 算子) https://www.hiascend.com/zh/software/cann/community-history:

wget https://ascend-repo.obs.cn-east-2.myhuaweicloud.com/Milan-ASL/Milan-ASL%20V100R001C19SPC703/Ascend-cann-toolkit_8.0.RC3.alpha003_linux-aarch64.run

wget https://ascend-repo.obs.cn-east-2.myhuaweicloud.com/Milan-ASL/Milan-ASL%20V100R001C19SPC703/Ascend-cann-kernels-910b_8.0.RC3.alpha003_linux-aarch64.run

安装 Toolkit,按提示操作:

sudo sed -i 's/user=true/user=false/' ~/.pip/pip.conf

sudo chmod +x Ascend-cann-toolkit_8.0.RC3.alpha003_linux-aarch64.run && sudo ./Ascend-cann-toolkit_8.0.RC3.alpha003_linux-aarch64.run --install --install-for-all

安装 Kernel,按提示操作:

sudo chmod +x Ascend-cann-kernels-910b_8.0.RC3.alpha003_linux-aarch64.run && sudo ./Ascend-cann-kernels-910b_8.0.RC3.alpha003_linux-aarch64.run --install --install-for-all

配置环境变量:

sudo echo "source /usr/local/Ascend/ascend-toolkit/set_env.sh" >> /etc/profile

source /usr/local/Ascend/ascend-toolkit/set_env.sh

昇腾环境已经配置完成,接下来准备运行 Qwen 2.5 模型的私有大模型服务平台。

安装 GPUStack

GPUStack 是一个开源的大模型即服务平台,支持 Nvidia、Apple Metal、华为昇腾和摩尔线程等各种类型的 GPU/NPU,可以在昇腾 910B 上运行包括 Qwen 2.5 在内的各种大模型,安装步骤如下。

通过以下命令在昇腾 NPU 服务器上在线安装 GPUStack,在安装过程中需要输入 sudo 密码:

curl -sfL https://get.gpustack.ai | sh -

如果环境连接不了 GitHub,无法下载一些二进制文件,使用以下命令安装,用 --tools-download-base-url 参数指定从腾讯云对象存储下载:

curl -sfL https://get.gpustack.ai | sh - --tools-download-base-url "https://gpustack-1303613262.cos.ap-guangzhou.myqcloud.com"

当看到以下输出时,说明已经成功部署并启动了 GPUStack:

[INFO] Install complete.

GPUStack UI is available at http://localhost.

Default username is 'admin'.

To get the default password, run 'cat /var/lib/gpustack/initial_admin_password'.

CLI "gpustack" is available from the command line. (You may need to open a new terminal or re-login for the PATH changes to take effect.)

接下来按照脚本输出的指引,拿到登录 GPUStack 的初始密码,执行以下命令:

cat /var/lib/gpustack/initial_admin_password

在浏览器访问 GPUStack UI,用户名 admin,密码为上面获得的初始密码。

重新设置密码后,进入 GPUStack:

纳管昇腾 NPU 资源

GPUStack 支持纳管 Linux、Windows 和 macOS 设备的 GPU 资源,如果有多台昇腾 NPU 服务器,通过以下步骤来纳管这些 NPU 资源。

其他节点需要通过认证 Token 加入 GPUStack 集群,在 GPUStack Server 节点执行以下命令获取 Token:

cat /var/lib/gpustack/token

拿到 Token 后,在其他节点上运行以下命令添加 Worker 到 GPUStack,纳管这些节点的 NPU(将其中的 http://YOUR_IP_ADDRESS 替换为 GPUStack 访问地址,将 YOUR_TOKEN 替换为用于添加 Worker 的认证 Token):

curl -sfL https://get.gpustack.ai | sh - --server-url http://YOUR_IP_ADDRESS --token YOUR_TOKEN --tools-download-base-url "https://gpustack-1303613262.cos.ap-guangzhou.myqcloud.com"

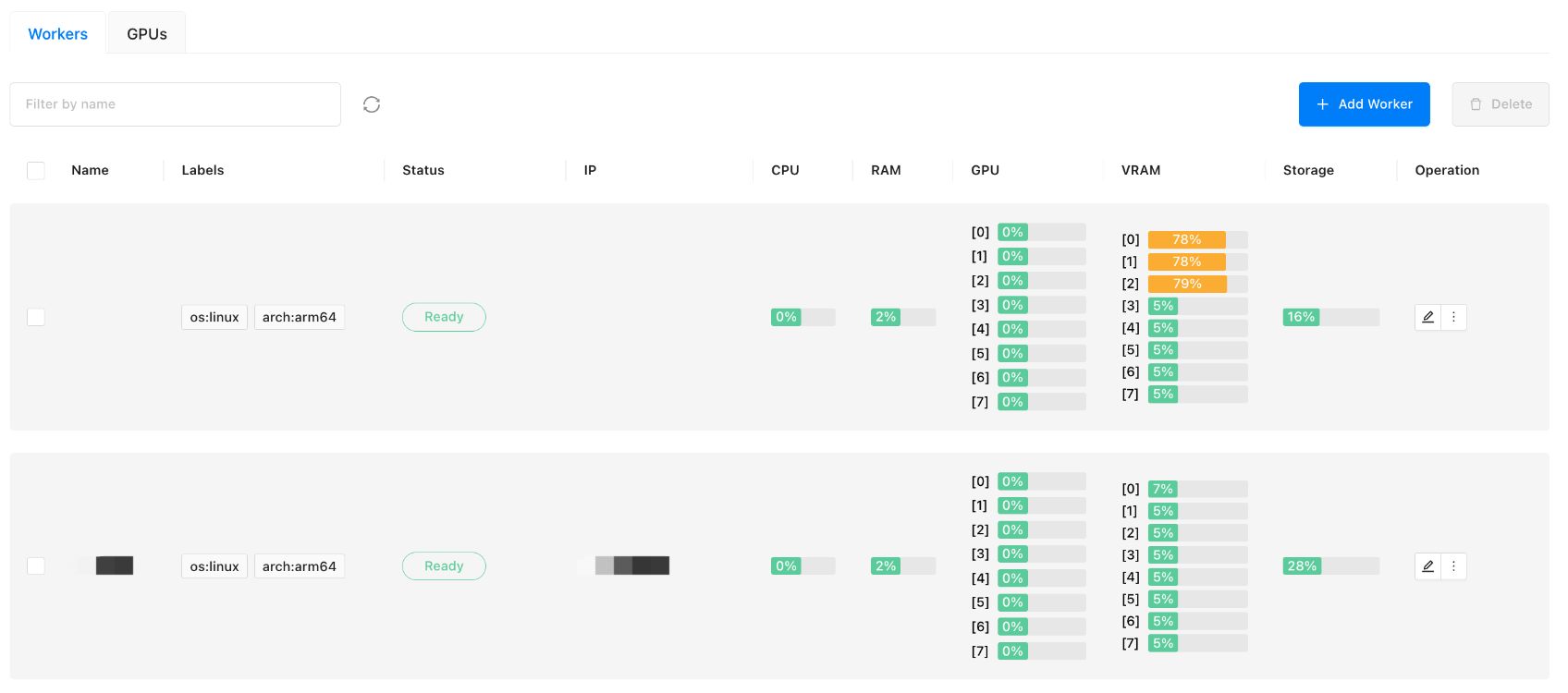

纳管的昇腾 NPU 服务器资源如下:

部署 Qwen 2.5 模型

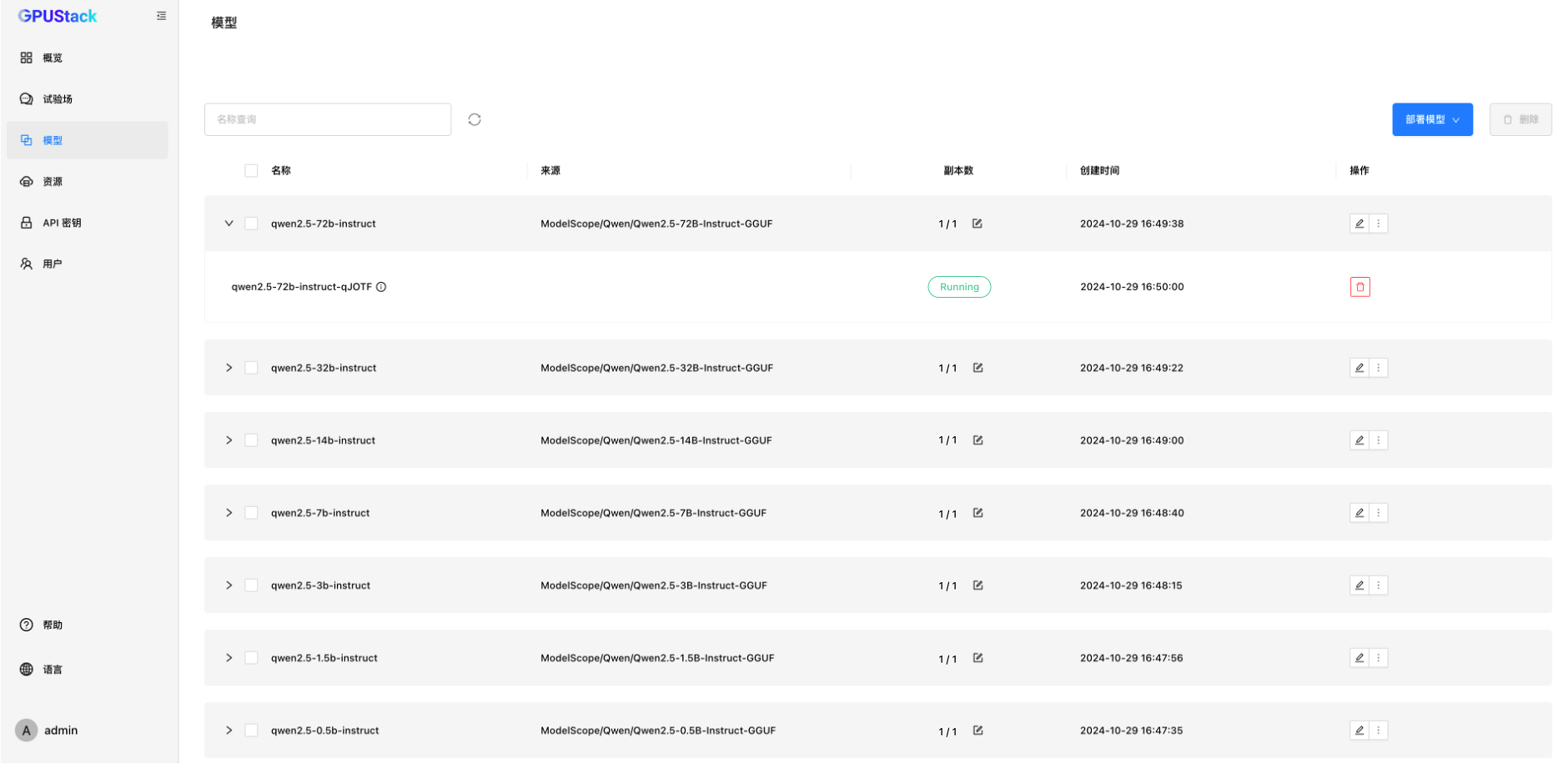

在 GPUStack 的模型菜单中部署模型。GPUStack 支持从 HuggingFace、Ollama Library、ModelScope 和私有模型仓库部署模型,国内网络建议从 ModelScope 部署。

GPUStack 支持 vLLM 和 llama-box 推理后端,llama-box 是 llama.cpp 的优化版本,对性能和稳定性进行了针对性的优化。目前 GPUStack 中基于 llama-box 提供对昇腾 NPU 的支持,在昇腾 NPU 上部署模型需要模型为 GGUF 格式。

从 ModelScope 部署 Qwen 2.5 的全系列模型,目前 CANN 算子的支持完整度方面还有不足,目前只能运行 FP16 精度、Q8_0 和 Q4_0 量化的模型,建议运行 FP16 精度的模型:

- Qwen2.5-0.5B-Instruct-GGUF FP16

- Qwen2.5-1.5B-Instruct-GGUF FP16

- Qwen2.5-3B-Instruct-GGUF FP16

- Qwen2.5-7B-Instruct-GGUF FP16

- Qwen2.5-14B-Instruct-GGUF FP16

- Qwen2.5-32B-Instruct-GGUF FP16

- Qwen2.5-72B-Instruct-GGUF FP16

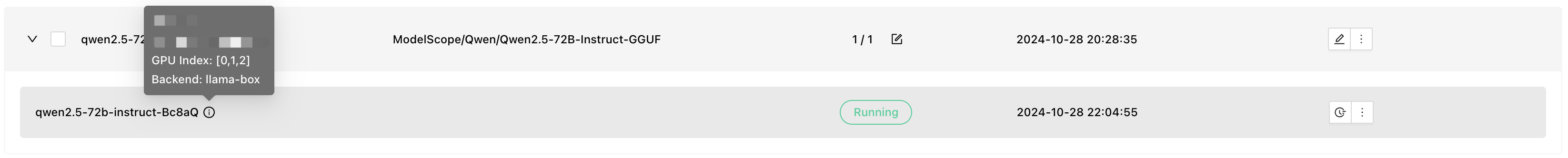

来看其中 Qwen 2.5 72B 模型的具体运行情况,Qwen 2.5 72B 被调度到 3 块 910B 上运行:

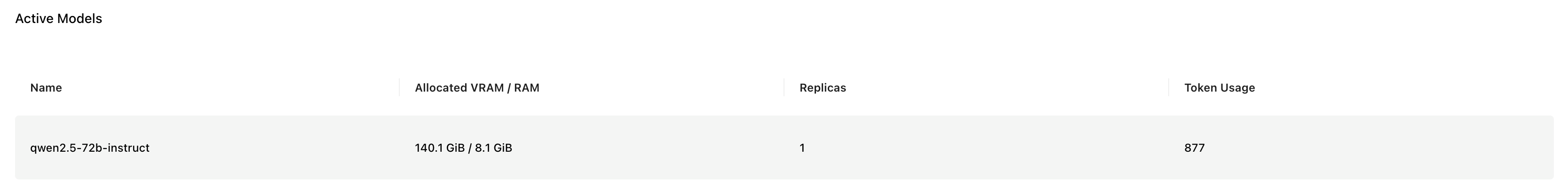

在 Dashboard 可以看到 Qwen 2.5 72B 被分配了 140.1 GiB 显存和 8.1 GiB 内存:

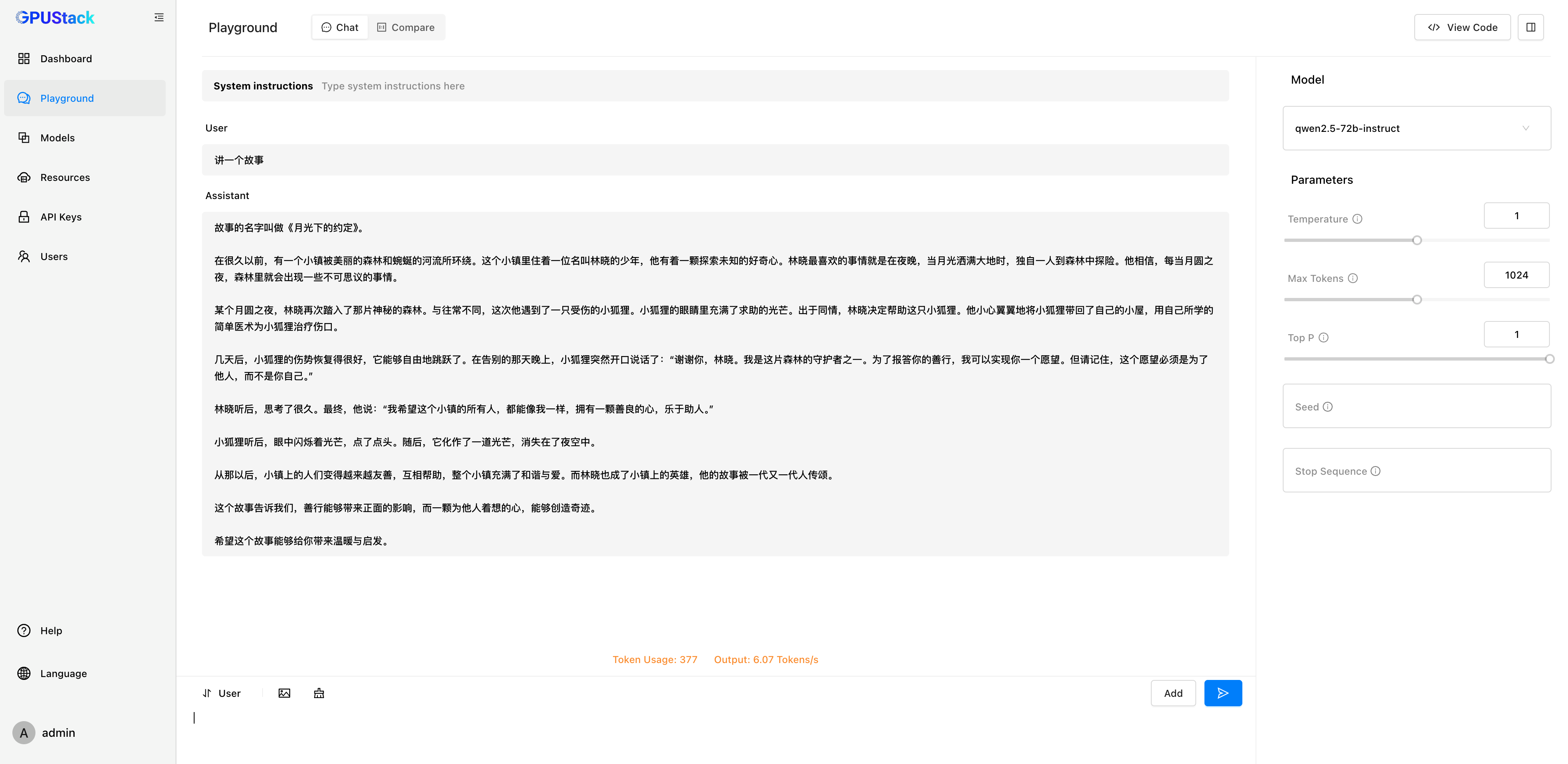

从 Playground 的实际测试来看,使用 llama-box 在昇腾 910B 上运行 Qwen 2.5 72B 的推理性能表现为 6 Tokens/s 左右,NPU 利用率在 10~30%左右:

以下为 Qwen 2.5 全系列模型在昇腾 910B 上的推理性能表现汇总数据,包括 Qwen2.5 0.5B、1.5B、3B 的 Q8_0 和 Q4_0 量化的推理性能数据作为对比参考:

| Model | Tokes / Second | NPU Util | NPU Mem | NPUs |

|---|---|---|---|---|

| Qwen2.5 0.5B FP16 | 42 tokens/second | Util 6~7% | Mem 7% | 单卡 |

| Qwen2.5 1.5B FP16 | 35 tokens/second | Util 11~13% | Mem 10% | 单卡 |

| Qwen2.5 3B FP16 | 29 tokens/second | Util 15~16% | Mem 15% | 单卡 |

| Qwen2.5 7B FP16 | 32 tokens/second | Util 16~21% | Mem 16% | 单卡 |

| Qwen2.5 14B FP16 | 19 tokens/second | Util 19~22% | Mem 28% | 单卡 |

| Qwen2.5 32B FP16 | 10.5 tokens/second | Util 10~45% | Mem 54% | 双卡 |

| Qwen2.5 72B FP16 | 6 tokens/second | Util 10~60% | Mem 78% | 三卡 |

| Qwen2.5 0.5B Q8_0 | 6.5 tokens/second | Util 2~5% | Mem 6% | 单卡 |

| Qwen2.5 0.5B Q4_0 | 6 tokens/second | Util 4~5% | Mem 6% | 单卡 |

| Qwen2.5 1.5B Q8_0 | 3.5 tokens/second | Util 4~11% | Mem 8% | 单卡 |

| Qwen2.5 1.5B Q4_0 | 17~18 tokens/second | Util 9~12% | Mem 7% | 单卡 |

| Qwen2.5 3B Q8_0 | 3.2 tokens/second | Util 10~15% | Mem 10% | 单卡 |

| Qwen2.5 3B Q4_0 | 14.5 tokens/second | Util 8~15% | Mem 8% | 单卡 |

对其中的 Qwen 2.5 0.5B FP16 模型进行并发测试的性能表现如下:

| CC | Tokens / Second | TP | NPU Util | NPU Mem |

|---|---|---|---|---|

| 1 | 39 tokens/second | 39 | Util 6~7% | Mem 7% |

| 2 | 38 tokens/second | 76 | Util 6~7% | Mem 7% |

| 3 | 37.66 tokens/second | 113 | Util 6~7% | Mem 7% |

| 4 | 34.25 tokens/second | 137 | Util 6~7% | Mem 7% |

| 5 | 31 tokens/second | 155 | Util 6~7% | Mem 7% |

| 6 | 28.16 tokens/second | 169 | Util 6~7% | Mem 7% |

| 7 | 27.57 tokens/second | 193 | Util 6~7% | Mem 7% |

| 8 | 26.87 tokens/second | 215 | Util 6~7% | Mem 7% |

| 9 | 26 tokens/second | 234 | Util 6~7% | Mem 7% |

| 10 | 26.9 tokens/second | 269 | Util 6~7% | Mem 7% |

| 20 | 20.3 tokens/second | 406 | Util 6~7% | Mem 8% |

| 50 | 10.34 tokens/second | 517 | Util 3~5% | Mem 8% |

| 100 | 4.17 tokens/second | 417 | Util 2~5% | Mem 9% |

从测试结果来看,目前硬件性能未得到充分发挥,CANN 算子优化方面还有可观的优化空间,推理引擎层面也还有一些可以优化的推理加速技术,也期待后续 GPUStack 的另外一个高性能推理后端 vLLM 对昇腾 NPU 的支持,提供更佳的推理性能表现。

以上为使用 GPUStack 在昇腾 910B 上运行 Qwen 2.5 推理的操作实践。GPUStack 是一个开源的大模型即服务平台,以下为 GPUStack 功能的简单介绍。

GPUStack 功能介绍

异构 GPU 支持:支持异构 GPU 资源,当前支持 Nvidia、Apple Metal、华为昇腾和摩尔线程等各种类型的 GPU/NPU

多推理后端支持:支持 vLLM 和 llama-box (llama.cpp) 推理后端,兼顾生产性能需求与多平台兼容性需求

多平台支持:支持 Linux、Windows 和 macOS 平台,覆盖 amd64 和 arm64 架构

多模型类型支持:支持 LLM 文本模型、VLM 多模态模型、Embedding 文本嵌入模型 和 Reranker 重排序模型等各种类型的模型

多模型仓库支持:支持从 HuggingFace、Ollama Library、ModelScope 和私有模型仓库部署模型

丰富的自动/手动调度策略:支持紧凑调度、分散调度、指定 Worker 标签调度、指定 GPU 调度等各种调度策略

分布式推理:如果单个 GPU 无法运行较大的模型,可以通过 GPUStack 的分布式推理功能,自动将模型运行在跨主机的多个 GPU 上

CPU 推理:如果没有 GPU 或 GPU 资源不足,GPUStack 可以用 CPU 资源来运行大模型,支持 GPU&CPU 混合推理和纯 CPU 推理两种 CPU 推理模式

多模型对比:GPUStack 在 Playground 中提供了多模型对比视图,可以同时对比多个模型的问答内容和性能数据,以评估不同模型、不同权重、不同 Prompt 参数、不同量化、不同 GPU、不同推理后端的模型 Serving 效果

GPU 和 LLM 观测指标:提供全面的性能、利用率、状态监控和使用数据指标,以评估 GPU 和 LLM 的利用情况

GPUStack 作为一个开源项目,只需要非常简单的安装设置,就可以开箱即用地构建企业私有大模型即服务平台。

总结

以上为使用 GPUStack 在昇腾 910B 上运行 Qwen 2.5 的操作实践,项目的开源地址为:https://github.com/gpustack/gpustack。

期待后续国产 AI 芯片在算子优化上更加完善,同时也期待上层推理引擎对国产 AI 芯片的更多支持,充分发挥国产 AI 芯片的硬件性能,提供更佳的推理性能表现。

如果觉得写得不错,欢迎点赞、转发、关注。

在昇腾Ascend 910B上运行Qwen2.5推理的更多相关文章

- 在传统.NET Framework 上运行ASP.NET Core项目

新的项目我们想用ASP.NET Core来开发,但是苦于我们历史的遗产很多,比如<使用 JavaScriptService 在.NET Core 里实现DES加密算法>,我们要估计等到.N ...

- Hyper-V上运行的Linux虚拟机验证是否安装了集成服务

Hyper-V上运行的Linux虚拟机验证是否安装了集成服务 ps aux|grep "hv"root 311 0.0 0.0 0 0 ? ...

- 通过Mono 在 Heroku 上运行 .NET 应用

英文原文:Running .NET on Heroku 中文原文:在 Heroku 上运行 .NET 应用 自从加入了Heroku之后,我就想在这个平台上运行.NET程序.现在我很高兴向大家宣布,我们 ...

- Linux上运行NET

今天尝试了下Ubuntu上运行NET程序,按照 https://github.com/aspnet/Home 的指引,一步一步来: 1.安装DNVM(原名KVM) Linux控制台下输入 curl - ...

- Mono 4.0 Mac上运行asp.net mvc 5.2.3

Mono 4.0 已经发布,二进制包已经准备好,具体的发布说明参见:http://www.mono-project.com/docs/about-mono/releases/4.0.0/. 今天在Ma ...

- ASP.NET Core 中文文档 第二章 指南(5) 在 Nano Server 上运行ASP.NET Core

原文 ASP.NET Core on Nano Server 作者 Sourabh Shirhatti 翻译 娄宇(Lyrics) 校对 刘怡(AlexLEWIS).许登洋(Seay).谢炀(kile ...

- 【无私分享:ASP.NET CORE 项目实战(第十章)】发布项目到 Linux 上运行 Core 项目

目录索引 [无私分享:ASP.NET CORE 项目实战]目录索引 简介 ASP.Net Core 给我们带来的最大的亮点就是跨平台,我在我电脑(win7)上用虚拟机建了个 CentOS7 ,来演示下 ...

- 玩儿转物联网IoT - 在Beagle Bone Black上运行node.js 程序

物联网(IoT)技术方兴未艾,智能手环,智能血压计,智能眼镜甚至智能鞋垫都开始进入我们的生活,各种智能设备层出不穷,世界已经到了一个"人有多大胆,地有多大产"的时代,不玩儿点物联网 ...

- 不装mono,你的.NET程序照样可以在Linux上运行!

让.NET应用程序在linux上运行,目前通用的做法就是在Linux上安装mono,然后通过”mono your.exe“命令运行这个程序. 这种运行.net程序的办法有两个弱点,一个是需要客户机安装 ...

- Spark源码编译并在YARN上运行WordCount实例

在学习一门新语言时,想必我们都是"Hello World"程序开始,类似地,分布式计算框架的一个典型实例就是WordCount程序,接触过Hadoop的人肯定都知道用MapRedu ...

随机推荐

- 面试官:JDK中都用了哪些设计模式?

设计模式是前辈们经过实践验证总结的解决方案,帮助我们构建出更具可维护性.可扩展性和可读性的代码.当然,在面试的过程中,也会或多或少的被问到.那么今天,我们就来看一道设计模式中的常见面试问题:JDK 中 ...

- 你还在手动操作仓库?这款 CLI 工具让你效率飙升300%!

前言 作为一名开发者,我经常会在 GitHub 和 Gitee 上 fork 各种项目.时间一长,这些仓库就会堆积如山,变成了"垃圾仓库".每次打开代码托管平台,看到那些不再需要的 ...

- 【CMake系列】09-cmake install

本节我们来学习,cmake的安装,将我们构建的目标安装到指定位置,为了模拟一般情况,实现了 可执行文件.静态库.动态库的安装,以及一般的 file 安装.代码的安装 本专栏的实践代码全部放在 gith ...

- MessageBox弹出后无响应

这几天学习了自定义模板对话框类,就是说不用系统定义的模板对话框类来创建对话框 消息处理就不用返回0了,可直接返回DefWindowProc HINSTANCE hInstance = ::GetMod ...

- 第三方软件测评实验室-CNAS

一家获得中国合格评定国家认可委员会CNAS认证资质的第三方软件测评机构,能够提供以下专业服务 1. 登记测试报告:用于政府项目申报.高新认证.创新产品认定.首版次申报.招投标和报奖. 2. 信息系统验 ...

- 配置 Windows Boot Manager

配置 Windows Boot Manager 通常需要使用 bcdedit 命令,这是一个命令行工具,用于管理 Boot Configuration Data (BCD) 存储.BCD 存储包含了启 ...

- linux 前端部署 tomcat 脚本

前提: 打包后的文件位置:/home/usr/back 目的部署位置:/home/usr/prod1 目的部署位置:/home/usr/prod2 在linux 服务器上 新增文件deploy-web ...

- Scikit-learn从入门到放弃

目录 Scikit-learn简介 SVM分类 随机森林回归 K-means聚类 前置建议阅读: 1.NumPy从入门到放弃 2.Pandas从入门到放弃 3.SciPy从入门到放弃 Scikit-l ...

- 手把手教你安装Jupyter Notebook(保姆级教程)

来源于:https://blog.csdn.net/weixin_43855159/article/details/137738714 1. 什么是Jupyter Notebook Jupyter N ...

- chroot 整理

chroot 是什么? 就是change root directory ,比如默认是 /, 可以用这个chroot 把 / 换成其他指定的目录 chroot 干什么的? 增加了系统的安全性,限制了用户 ...