Spark与mysql整合

一、需求:把最终结果存储在mysql中

1、UrlGroupCount1类

import java.net.URL

import java.sql.DriverManager import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext} /**

* 把最终结果存储在mysql中

*/

object UrlGroupCount1 {

def main(args: Array[String]): Unit = {

//1.创建spark程序入口

val conf: SparkConf = new SparkConf().setAppName("UrlGroupCount1").setMaster("local[2]")

val sc: SparkContext = new SparkContext(conf) //2.加载数据

val rdd1: RDD[String] = sc.textFile("e:/access.log") //3.将数据切分

val rdd2: RDD[(String, Int)] = rdd1.map(line => {

val s: Array[String] = line.split("\t")

//元组输出

(s(1), 1)

}) //4.累加求和

val rdd3: RDD[(String, Int)] = rdd2.reduceByKey(_+_) //5.取出分组的学院

val rdd4: RDD[(String, Int)] = rdd3.map(x => {

val url = x._1

val host: String = new URL(url).getHost.split("[.]")(0)

//元组输出

(host, x._2)

}) //6.根据学院分组

val rdd5: RDD[(String, List[(String, Int)])] = rdd4.groupBy(_._1).mapValues(it => {

//根据访问量排序 倒序

it.toList.sortBy(_._2).reverse.take(1)

}) //7.把计算结果保存到mysql中

rdd5.foreach(x => {

//把数据写到mysql

val conn = DriverManager.getConnection("jdbc:mysql://localhost:3306/urlcount?charactorEncoding=utf-8","root", "root")

//把spark结果插入到mysql中

val sql = "INSERT INTO url_data (xueyuan,number_one) VALUES (?,?)"

//执行sql

val statement = conn.prepareStatement(sql) statement.setString(1, x._1)

statement.setString(2, x._2.toString())

statement.executeUpdate()

statement.close()

conn.close()

}) //8.关闭资源

sc.stop()

}

}

2、mysql创建数据库和表

CREATE DATABASE urlcount;

USE urlcount; CREATE TABLE url_data(

uid INT PRIMARY KEY AUTO_INCREMENT,

xueyuan VARCHAR(50),

number_one VARCHAR(200)

)

3、结果

二、Spark提供的连接mysql的方式--jdbcRDD

1、JdbcRDDDemo类

import java.sql.DriverManager import org.apache.spark.rdd.JdbcRDD

import org.apache.spark.{SparkConf, SparkContext} /**

* spark提供的连接mysql的方式

* jdbcRDD

*/

object JdbcRDDDemo {

def main(args: Array[String]): Unit = {

//1.创建spark程序入口

val conf: SparkConf = new SparkConf().setAppName("JdbcRDDDemo").setMaster("local[2]")

val sc: SparkContext = new SparkContext(conf) //匿名函数

val connection = () => {

Class.forName("com.mysql.jdbc.Driver").newInstance()

DriverManager.getConnection("jdbc:mysql://localhost:3306/urlcount?characterEncoding=utf-8","root", "root")

} //查询数据

val jdbcRdd: JdbcRDD[(Int, String, String)] = new JdbcRDD(

//指定sparkContext

sc,

connection,

"SELECT * FROM url_data where uid >= ? AND uid <= ?",

//2个任务并行

1, 4, 2,

r => {

val uid = r.getInt(1)

val xueyuan = r.getString(2)

val number_one = r.getString(3)

(uid, xueyuan, number_one)

}

) val result: Array[(Int, String, String)] = jdbcRdd.collect()

println(result.toBuffer)

sc.stop()

}

}

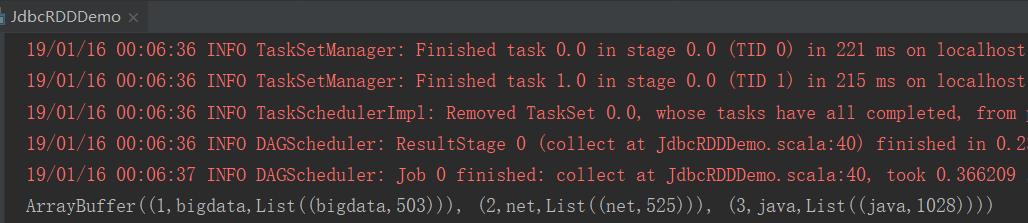

2、结果

Spark与mysql整合的更多相关文章

- 大数据工具篇之Hive与MySQL整合完整教程

大数据工具篇之Hive与MySQL整合完整教程 一.引言 Hive元数据存储可以放到RDBMS数据库中,本文以Hive与MySQL数据库的整合为目标,详细说明Hive与MySQL的整合方法. 二.安装 ...

- 使用Apache Spark 对 mysql 调优 查询速度提升10倍以上

在这篇文章中我们将讨论如何利用 Apache Spark 来提升 MySQL 的查询性能. 介绍 在我的前一篇文章Apache Spark with MySQL 中介绍了如何利用 Apache Spa ...

- Hive+Sqoop+Mysql整合

Hive+Sqoop+Mysql整合 在本文中,LZ随意想到了一个场景: 车,道路,监控,摄像头 即当一辆车在道路上面行驶的时候,道路上面的监控点里面的摄像头就会对车进行数据采集. 我们对采集的数据进 ...

- 记录一次spark连接mysql遇到的问题

版权声明:本文为博主原创文章,未经博主允许不得转载 在使用spark连接mysql的过程中报错了,错误如下 08:51:32.495 [main] ERROR - Error loading fact ...

- [Spark][Python]Spark 访问 mysql , 生成 dataframe 的例子:

[Spark][Python]Spark 访问 mysql , 生成 dataframe 的例子: mydf001=sqlContext.read.format("jdbc").o ...

- freeradius+xl2tp+mysql整合

freeradius+xl2tp+mysql整合 搭了5个小时,可以说是入门到精通了.首先请确认你已经搭建好L2TP,并可以正常使用. 如何在Ubuntu下配置L2TP VPN L2TP使用radi ...

- spark SQL学习(spark连接 mysql)

spark连接mysql(打jar包方式) package wujiadong_sparkSQL import java.util.Properties import org.apache.spark ...

- spark第十篇:Spark与Kafka整合

spark与kafka整合需要引入spark-streaming-kafka.jar,该jar根据kafka版本有2个分支,分别是spark-streaming-kafka-0-8和spark-str ...

- spark练习--mysql的读取

前面我们一直操作的是,通过一个文件来读取数据,这个里面不涉及数据相关的只是,今天我们来介绍一下spark操作中存放与读取 1.首先我们先介绍的是把数据存放进入mysql中,今天介绍的这个例子是我们前两 ...

随机推荐

- iOS开发-NSDictionary

判断一个字典中是否存在某个key,有两种方法: 方法一: if ([dictionary allKeys] containsObject: key]){ // cotains key operatio ...

- BootStrap Table将时间戳更改为日期格式

一.使用BootStrap Table遇到的问题: 1.MyBatis从数据库中取出的时间格式如下:2017-12-04 21:43:19.0,时间后面多了一个点零. 2.从BootStrap Tab ...

- CentOS7--su和sudo

在某些情况下, 以root用户身份访问系统有潜在危险,并可能导致系统和数据损害.我们可以用setuid程序,例如su和sudo解决. su命令 [app01rot@app-01 ~]$ su - ro ...

- Java中获取资源文件的方法总结

这里总结3中方法获取资源文件的 ServletContext Class ClassLoader 文件的位置 1. ServletContext public void doGet(HttpServl ...

- codeblocks编译pthread多线程问题

默认的编译选项是没有pthread的,所以要自己添加: 参考:http://hi.baidu.com/u_soa/item/9d6cc40b7e9d76eb3499024d 错误: undefined ...

- 【vue基础学习】vue.js开发环境搭建

1.安装node.js(http://www.runoob.com/nodejs/nodejs-install-setup.html) 2.基于node.js,利用淘宝npm镜像安装相关依赖 在cmd ...

- 【大数据系列】MapReduce详解

MapReduce是hadoop中的一个计算框架,用来处理大数据.所谓大数据处理,即以价值为导向,对大数据加工,挖掘和优化等各种处理. MapReduce擅长处理大数据,这是由MapReduce的设计 ...

- C# 泛型的简单讲解和应用

泛型 什么是泛型 泛型是 2.0 版 C# 语言和公共语言运行库 (CLR) 中的一个新功能.泛型将类型参数的概念引入 .NET Framework,类型参数使得设计如下类和方法成为可能:这些类和方法 ...

- 安装cnpm

使用淘宝镜像的cnpm $ npm install -g cnpm --registry=https://registry.npm.taobao.org

- 3-2 axios基础介绍

1.静态引用 <script src="https://unpkg.com/axios/dist/axios.min.js"></script> 2.npm ...