HDFS文件操作

hadoop装好后,文件系统中没有任何目录与文件

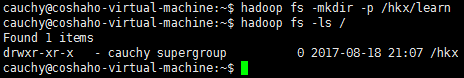

1、 创建文件夹

hadoop fs -mkdir -p /hkx/learn

参数-p表示递归创建文件夹

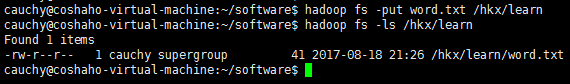

2、 浏览文件

hadoop fs -ls /

3、 上传本地文件到HDFS

hadoop fs -put word.txt /hkx/learn

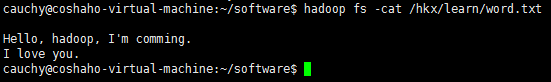

4、 查看文件

hadoop fs -cat /hkx/learn/word.txt

HDFS Shell命令介绍文章很多,这里就不一一列举了,引用一篇文章来介绍:https://segmentfault.com/a/1190000002672666

命令基本格式:

hadoop fs -cmd < args >

1.ls

hadoop fs -ls /

列出hdfs文件系统根目录下的目录和文件

hadoop fs -ls -R /

列出hdfs文件系统所有的目录和文件

2.put

hadoop fs -put < local file > < hdfs file >

hdfs file的父目录一定要存在,否则命令不会执行

hadoop fs -put < local file or dir >...< hdfs dir >

hdfs dir 一定要存在,否则命令不会执行

hadoop fs -put - < hdsf file>

从键盘读取输入到hdfs file中,按Ctrl+D结束输入,hdfs file不能存在,否则命令不会执行

2.1.moveFromLocal

hadoop fs -moveFromLocal < local src > ... < hdfs dst >

与put相类似,命令执行后源文件 local src 被删除,也可以从从键盘读取输入到hdfs file中

2.2.copyFromLocal

hadoop fs -copyFromLocal < local src > ... < hdfs dst >

与put相类似,也可以从从键盘读取输入到hdfs file中

3.get

hadoop fs -get < hdfs file > < local file or dir>

local file不能和 hdfs file名字不能相同,否则会提示文件已存在,没有重名的文件会复制到本地

hadoop fs -get < hdfs file or dir > ... < local dir >

拷贝多个文件或目录到本地时,本地要为文件夹路径

注意:如果用户不是root, local 路径要为用户文件夹下的路径,否则会出现权限问题,

3.1.moveToLocal

当前版本中还未实现此命令

3.2.copyToLocal

hadoop fs -copyToLocal < local src > ... < hdfs dst >

与get相类似

4.rm

hadoop fs -rm < hdfs file > ...

hadoop fs -rm -r < hdfs dir>...

每次可以删除多个文件或目录

5.mkdir

hadoop fs -mkdir < hdfs path>

只能一级一级的建目录,父目录不存在的话使用这个命令会报错

hadoop fs -mkdir -p < hdfs path>

所创建的目录如果父目录不存在就创建该父目录

6.getmerge

hadoop fs -getmerge < hdfs dir > < local file >

将hdfs指定目录下所有文件排序后合并到local指定的文件中,文件不存在时会自动创建,文件存在时会覆盖里面的内容

hadoop fs -getmerge -nl < hdfs dir > < local file >

加上nl后,合并到local file中的hdfs文件之间会空出一行

7.cp

hadoop fs -cp < hdfs file > < hdfs file >

目标文件不能存在,否则命令不能执行,相当于给文件重命名并保存,源文件还存在

hadoop fs -cp < hdfs file or dir >... < hdfs dir >

目标文件夹要存在,否则命令不能执行

8.mv

hadoop fs -mv < hdfs file > < hdfs file >

目标文件不能存在,否则命令不能执行,相当于给文件重命名并保存,源文件不存在

hadoop fs -mv < hdfs file or dir >... < hdfs dir >

源路径有多个时,目标路径必须为目录,且必须存在。

注意:跨文件系统的移动(local到hdfs或者反过来)都是不允许的

9.count

hadoop fs -count < hdfs path >

统计hdfs对应路径下的目录个数,文件个数,文件总计大小

显示为目录个数,文件个数,文件总计大小,输入路径

10.du

hadoop fs -du < hdsf path>

显示hdfs对应路径下每个文件夹和文件的大小

hadoop fs -du -s < hdsf path>

显示hdfs对应路径下所有文件和的大小

hadoop fs -du - h < hdsf path>

显示hdfs对应路径下每个文件夹和文件的大小,文件的大小用方便阅读的形式表示,例如用64M代替67108864

11.text

hadoop fs -text < hdsf file>

将文本文件或某些格式的非文本文件通过文本格式输出

12.setrep

hadoop fs -setrep -R 3 < hdfs path >

改变一个文件在hdfs中的副本个数,上述命令中数字3为所设置的副本个数,-R选项可以对一个人目录下的所有目录+文件递归执行改变副本个数的操作

13.stat

hdoop fs -stat [format] < hdfs path >

返回对应路径的状态信息

[format]可选参数有:%b(文件大小),%o(Block大小),%n(文件名),%r(副本个数),%y(最后一次修改日期和时间)

可以这样书写hadoop fs -stat %b%o%n < hdfs path >,不过不建议,这样每个字符输出的结果不是太容易分清楚

14.tail

hadoop fs -tail < hdfs file >

在标准输出中显示文件末尾的1KB数据

15.archive

hadoop archive -archiveName name.har -p < hdfs parent dir > < src >* < hdfs dst >

命令中参数name:压缩文件名,自己任意取;< hdfs parent dir > :压缩文件所在的父目录;< src >:要压缩的文件名;< hdfs dst >:压缩文件存放路径

*示例:hadoop archive -archiveName hadoop.har -p /user 1.txt 2.txt /des

示例中将hdfs中/user目录下的文件1.txt,2.txt压缩成一个名叫hadoop.har的文件存放在hdfs中/des目录下,如果1.txt,2.txt不写就是将/user目录下所有的目录和文件压缩成一个名叫hadoop.har的文件存放在hdfs中/des目录下

显示har的内容可以用如下命令:

hadoop fs -ls /des/hadoop.jar

显示har压缩的是那些文件可以用如下命令

hadoop fs -ls -R har:///des/hadoop.har

注意:har文件不能进行二次压缩。如果想给.har加文件,只能找到原来的文件,重新创建一个。har文件中原来文件的数据并没有变化,har文件真正的作用是减少NameNode和DataNode过多的空间浪费。

16.balancer

hdfs balancer

如果管理员发现某些DataNode保存数据过多,某些DataNode保存数据相对较少,可以使用上述命令手动启动内部的均衡过程

17.dfsadmin

hdfs dfsadmin -help

管理员可以通过dfsadmin管理HDFS,用法可以通过上述命令查看

hdfs dfsadmin -report

显示文件系统的基本数据

hdfs dfsadmin -safemode < enter | leave | get | wait >

enter:进入安全模式;leave:离开安全模式;get:获知是否开启安全模式;

wait:等待离开安全模式

18.distcp

用来在两个HDFS之间拷贝数据

HDFS文件操作的更多相关文章

- Hadoop之HDFS文件操作常有两种方式(转载)

摘要:Hadoop之HDFS文件操作常有两种方式,命令行方式和JavaAPI方式.本文介绍如何利用这两种方式对HDFS文件进行操作. 关键词:HDFS文件 命令行 Java API HD ...

- hadoop的hdfs文件操作实现上传文件到hdfs

这篇文章主要介绍了使用hadoop的API对HDFS上的文件访问,其中包括上传文件到HDFS上.从HDFS上下载文件和删除HDFS上的文件,需要的朋友可以参考下hdfs文件操作操作示例,包括上传文件到 ...

- HDFS文件操作(命令行)

HDFS是一种分布式文件系统,为MapReduce这种框架下的海量数据分布式处理而设计. Hadoop之HDFS文件操作常有两种方式,一种是命令行方式,即Hadoop提供了一套与Linux文件命令类似 ...

- Hadoop之HDFS文件操作

摘要:Hadoop之HDFS文件操作常有两种方式.命令行方式和JavaAPI方式.本文介绍怎样利用这两种方式对HDFS文件进行操作. 关键词:HDFS文件 命令行 Java API HD ...

- JAVA API 实现hdfs文件操作

java api 实现hdfs 文件操作会出现错误提示: Permission denied: user=hp, access=WRITE, inode="/":hdfs:supe ...

- eclipse 对 hadoop1.2.1 hdfs 文件操作

package com.hdfs; import java.io.FileInputStream;import java.io.FileNotFoundException;import java.io ...

- Hadoop HDFS文件操作

1.创建目录 import java.io.IOException; import org.apache.hadoop.conf.Configuration; import org.apache.ha ...

- thrift实现HDFS文件操作

thrift 文件如下 namespace java com.pera.file.transform struct File{ 1:string path , 2:string co ...

- [bigdata] 使用Flume hdfs sink, hdfs文件未关闭的问题

现象: 执行mapreduce任务时失败 通过hadoop fsck -openforwrite命令查看发现有文件没有关闭. [root@com ~]# hadoop fsck -openforwri ...

随机推荐

- 纯CSS绘制的三角形箭头图案【原创】

参考:http://www.webhek.com/css-triangles/ 使用上下左右的三角形箭头标志,直接用css即可完成,直接附上代码. css: div#up { width: 0px; ...

- vue之修饰符

修饰符 .lazy 在默认情况下,v-model 在每次 input 事件触发后将输入框的值与数据进行同步 .你可以添加 lazy 修饰符,从而转变为使用 change 事件进行同步: <!-- ...

- 9.11 Django关于母版语言的灵活用法

2018-9-11 12:45:38 还是这个连接 : http://www.cnblogs.com/liwenzhou/p/7931828.html 注意: 这节讲的是 母版语言的灵活用法! 可 ...

- C++和Java中的静态Static用法

C++和Java中都有的一个静态关键字Static,可以放在类中的变量或者函数之前,就成了静态变量或者静态函数. 静态变量又分为静态全局变量和静态局部变量,可参见网上大神总结的C++全局变量,局部变量 ...

- [实战]MVC5+EF6+MySql企业网盘实战(1)

写在前面 不久前,一个朋友让帮他弄一个单位的企业网盘的管理站点,一直忙,最近抽出了点时间,也想琢磨琢磨mvc,ef,mysql,这算是边琢磨,边实践吧. 系列文章 [实战]MVC5+EF6+MySql ...

- 微信都在用的移动敏捷测试方法和工具|视频+PPT

本文是腾讯优测总监雷彬在MPD2016 北京站上的演讲视频.他详细讲述了腾讯多年来在实践敏捷研发过程中测试的优化之路,为测试角色(包括测试工程师和开发自测)提供敏捷作业的思路.点击此处观看视频.时长5 ...

- 对于Python中回调函数的理解

关于回调函数,网上有很多说明和各种解释,多数在尝试用语言描述.我认为,如果对各个角色之间的关系不清楚,如果没有相关的编程需求,那么语言便非常无力,很难理解. 这是360百科的解释: 在计算机程序设计中 ...

- codeforces 779D - String Game

time limit per test 2 seconds memory limit per test 512 megabytes input standard input output standa ...

- 使用TensorFlow Serving优化TensorFlow模型

使用TensorFlow Serving优化TensorFlow模型 https://www.tensorflowers.cn/t/7464 https://mp.weixin.qq.com/s/qO ...

- lamp docker apache2 supervisor monitor

sudo docker run -d -p 80:80 -p 3306:3306 -v /data/lampp/supervisormonitor:/app --name mylamp01 tutum ...