Python爬虫抓取糗百的图片,并存储在本地文件夹

思路:

1.观察网页,找到img标签

2.通过requests和BS库来提取网页中的img标签

3.抓取img标签后,再把里面的src给提取出来,接下来就可以下载图片了

4.通过urllib的urllib.urlretrieve来下载图片并且放进文件夹里面(第一之前的准备工作就是获取当前路径然后新建一个文件夹)

5.如果有多张图片,不断的重复3-4

由于爬虫写得少,通过自己的调试,终于写了出来了

下面直接上代码:

#coding = 'utf-8'

import requests

from bs4 import BeautifulSoup

import urllib

import os

import sys

reload(sys)

sys.setdefaultencoding("utf-8") if __name__ == '__main__':

url = 'http://www.qiushibaike.com/'

res = requests.get(url)

res.encoding = 'utf-8'

soup = BeautifulSoup(res.text, 'html.parser')

imgs = soup.find_all("img") _path = os.getcwd()

new_path = os.path.join(_path , 'pictures')

if not os.path.isdir(new_path):

os.mkdir(new_path)

new_path += '\ ' try:

x = 1

if imgs == []:

print "Done!"

for img in imgs:

link = img.get('src')

if 'http' in link:

print "It's downloading %s" %x + "th's piture"

urllib.urlretrieve(link, new_path + '%s.jpg' %x)

x += 1 except Exception, e:

print e

else:

pass

finally:

if x :

print "It's Done!!!"

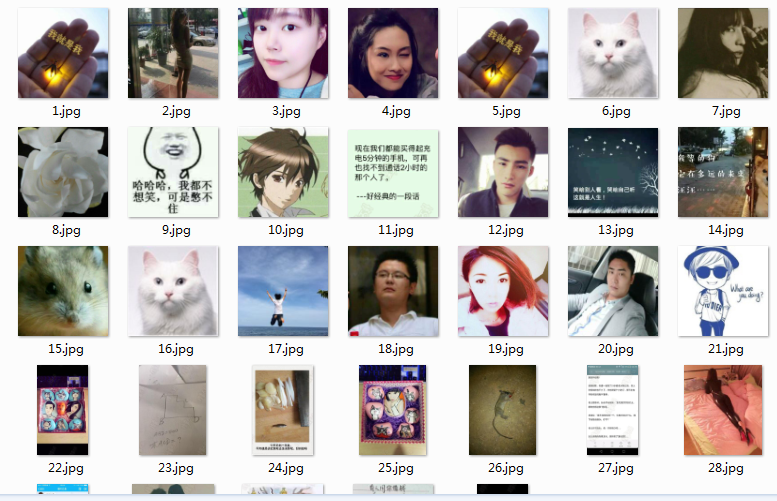

接下来上结果:

python3中的版本,略有有一点点不同,就是下载图片的方法需要加上request,然后才能使用urlretrieve方法进行下载

#!/usr/bin/python3

#coding = 'utf-8' import requests

from bs4 import BeautifulSoup

import urllib

import os

import sys

#reload(sys)

#sys.setdefaultencoding("utf_8") if __name__ == '__main__':

url = 'http://www.qiushibaike.com/'

res = requests.get(url)

res.encoding = 'utf-8'

print (res)

soup = BeautifulSoup(res.text,'html.parser')

#imgs = soup.find_all('img', attrs={'class': 'item_img'})

imgs = soup.find_all('img') _path = os.getcwd()

new_path = os.path.join(_path,'pictures\\')#需要添加斜杠,才能将图片放进单独的文件夹里面

print(new_path) if not os.path.isdir(new_path):

os.mkdir(new_path) #new_path = new_path + '\'

#print (str(new_path)) try:

x = 1

if imgs == []:

print ("Done!")

print (len(imgs))

for img in imgs:

link = img.get('src')

link = 'http:' + link

#print (link)

if True:

print ("It's downloading %s" %x + "th's piture")

#python3如下使用urlretrieve

#_new111 = new_path + '%s.jpg'%5

#print (_new111)

urllib.request.urlretrieve(link,new_path + '%s.jpg' %x)

x += 1 except Exception:

pass

# else:

# pass

finally:

if x:

print ("It's Done!")

结果都是一样,就不再另外贴结果截图了

总结:

虽然一开始思路不清晰,而且对怎样把图片保存下来,都不是很熟

但是经过自己的思考,只要思路清楚了,确定了方向就好办了,至于函数不会用的话,可以直接百度查,很方便的

总而言之,写程序之前一定要有思路,边写边想思路是不行的,那样容易返工

不过最后还是写出来了,哈哈

也请大家来共同学习和指正

----------------------

转载的话请大家注明出处哦,谢谢了

Python爬虫抓取糗百的图片,并存储在本地文件夹的更多相关文章

- Python爬虫——抓取糗百段子

在别人博客里学习的 抓取糗百段子,由于糗百不断的更新,代码需要改正. 抓取网页:http://www.qiushibaike.com/hot/page/1 修改后的代码如下: # -*- coding ...

- Python 爬虫: 抓取花瓣网图片

接触Python也好长时间了,一直没什么机会使用,没有机会那就自己创造机会!呐,就先从爬虫开始吧,抓点美女图片下来. 废话不多说了,讲讲我是怎么做的. 1. 分析网站 想要下载图片,只要知道图片的地址 ...

- python 爬虫抓取心得

quanwei9958 转自 python 爬虫抓取心得分享 urllib.quote('要编码的字符串') 如果你要在url请求里面放入中文,对相应的中文进行编码的话,可以用: urllib.quo ...

- 使用Python爬虫爬取网络美女图片

代码地址如下:http://www.demodashi.com/demo/13500.html 准备工作 安装python3.6 略 安装requests库(用于请求静态页面) pip install ...

- Python爬虫----抓取豆瓣电影Top250

有了上次利用python爬虫抓取糗事百科的经验,这次自己动手写了个爬虫抓取豆瓣电影Top250的简要信息. 1.观察url 首先观察一下网址的结构 http://movie.douban.com/to ...

- Python爬虫抓取东方财富网股票数据并实现MySQL数据库存储

Python爬虫可以说是好玩又好用了.现想利用Python爬取网页股票数据保存到本地csv数据文件中,同时想把股票数据保存到MySQL数据库中.需求有了,剩下的就是实现了. 在开始之前,保证已经安装好 ...

- python学习-抓取知乎图片

#!/bin/usr/env python3 __author__ = 'nxz' """ 抓取知乎图片webdriver Chromedriver驱动需要安装,并指定d ...

- python爬虫抓取哈尔滨天气信息(静态爬虫)

python 爬虫 爬取哈尔滨天气信息 - http://www.weather.com.cn/weather/101050101.shtml 环境: windows7 python3.4(pip i ...

- Python爬虫 —— 抓取美女图片

代码如下: #coding:utf-8 # import datetime import requests import os import sys from lxml import etree im ...

随机推荐

- email 正则

^\w+((-\w+)|(\.\w+))*\@[A-Za-z0-]+((\.|-)[A-Za-z0-]+)*\.[A-Za-z0-]+$

- 小表驱动大表, 兼论exists和in

给出两个表,A和B,A和B表的数据量, 当A小于B时,用exists select * from A where exists (select * from B where A.id=B.id) ex ...

- windows使用nginx实现网站负载均衡测试实例

如果你关注过nginx,必定知道nginx这个软件有什么用的,如果你的网站访问量越来越高,一台服务器已经没有办法承受流量压力,那就增多几台服务器来做负载吧.做网站负载可以买硬件设备来实现,比如F5,不 ...

- flash builder (fb) 与flash professional cs6(fla) 联合调试

注意加载的swf名字与项目(fla)名字一致,在fb进行构建,如果fla代码做了修改,保持在fb构建最新.

- MVC+EasyUI 菜单导航的实现

一个简单的使用mvc+easyUi 动态菜单显示 直接上代码 前端 function initMenu() { $.get("/Admin/Home/GetNav", functi ...

- i2c 读写

在I2C设备读取,必须是在同一个周期内. 一个例子,可以同时读出两个值 int read_register_double_value(int reg_addr, unsigned char *valu ...

- 2015-06-02 关于mvc表格点击按钮自动添加一行<tr></tr>

前台代码: @using (Html.BeginForm("ContactPerson", "User", FormMethod.Post, new { @cl ...

- Python基础篇【第6篇】: Python装饰器

装饰器 装饰器模式(Decorator Pattern)允许向一个现有的对象添加新的功能,同时又不改变其结构.这种类型的设计模式属于结构型模式,它是作为现有的类的一个包装. 这种模式创建了一个装饰类, ...

- 项目中用到RouteTable,发布到IIS7中无法访问

项目中用到RouteTable,发布到IIS7中,访问之后没有任何反应,google半天终于找到了解决方法,就是要把iis的“HTTP重定向”功能打开

- 慕课网-Java入门第一季-7-3 Java 中无参带返回值方法的使用

来源:http://www.imooc.com/code/1579 如果方法不包含参数,但有返回值,我们称为无参带返回值的方法. 例如:下面的代码,定义了一个方法名为 calSum ,无参数,但返回值 ...