机器学习之逻辑回归(logistic回归)

前言

以下内容是个人学习之后的感悟,转载请注明出处~

逻辑回归

一、为什么使用logistic回归

一般来说,回归不用在分类问题上,因为回归是连续型模型,而且受噪声影响比较大。

Why? 为什么回归一般不用在分类上?其实,很多初学者都会提出这个问题。然而,文字的解释往往不能说服我们,接下来

用图示的方式为大家讲解。

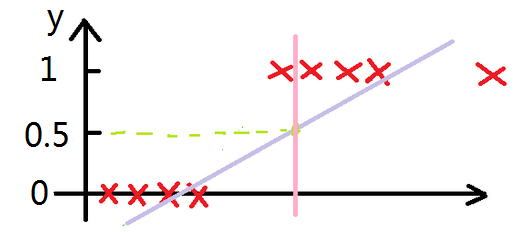

以最简单的分类为例,当y≥0.5时,输出“1”;当y<0.5时,输出“0”。下面左图,数据样本较好,线性回归模型在y=0.5处的橘色分界线

刚好在“0”、“1”两类样本的分界线处,完美地完成分类。然而,现实情况往往没有这么乐观,下面有图中出现了一个额外的样本,所谓的噪

声点,会使训练完毕的线性回归模型准确度变差。从右图中可以做直观地看到,线性回归模型在y=0.5处的粉色分界线将一个“1”类样本分类到

了“0”类样本集中,此时就出现了判断失误。

所以线性回归一般不用在分类问题上,如果非要用于分类,可以使用logistic回归。

逻辑回归为什么可以用在分类上?why?

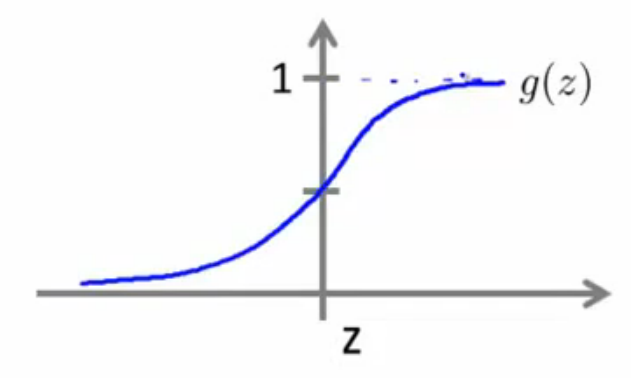

原因很简单,逻辑回归本质上是线性回归,只是在特征到结果的映射中加入了一层函数映射,即先把特征线性求和θTx,设为z,然后使用函

数g(z)作为假设函数来预测。g(z)可以将连续值映射到0和1上。如下图所示,当z≥0时,输出为1;当z<0时,输出为0。这样可以实现很好的分类。

具体实现请看下文~

二、logistic回归

- 假设函数:

- 初始代价函数:

(细心的童鞋会发现,这里的代价函数与线性回归模型中的J(θ0,θ1)不一样,其实就是整体误差和平均误差的区别。)

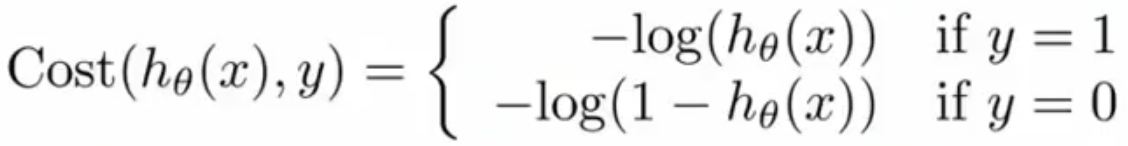

显然,由于S型函数的存在,代价函数是非凸函数,无法使用梯度下降法来求极小值。这就需要转换为下面的简易代价函数。

- 简易代价函数:

说实话,这一步,我也不知道是怎么推导的,有哪位大神知道的话,请不吝赐教~

然而,要想使用梯度下降法,还需要转换为J(θ)代价函数

- J(θ)代价函数(凸函数):

- 使用方法:

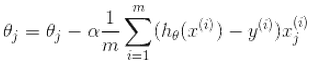

1、采用梯度下降法,不断迭代下列公式,直到收敛,求出θ。

其推导过程如下:

细心的童鞋可能会注意到,逻辑回归和线性回归在梯度下降法中使用的迭代公式竟然一样。其实不然,不同点在于

迭代公式中的hθ(x):

逻辑回归:

线性回归:

2、判断θTx的大小来分类。

“y=1”,当θTx≥0

“y=0”,当θTx<0

(很容易发现θTx=0是分类的决策边界)

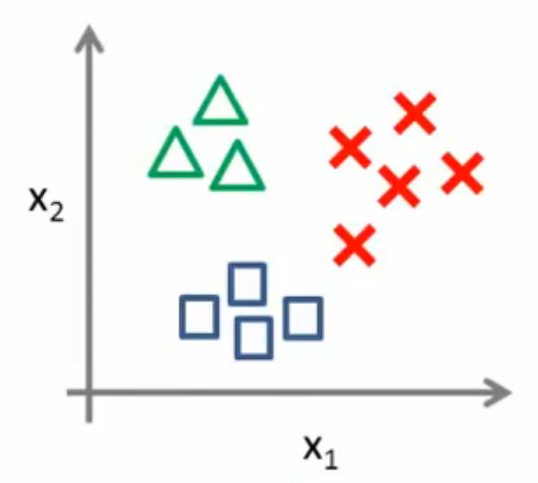

三、多分类逻辑回归

使用逻辑回归算法进行多分类时,可以设其中一类为1,其他都为0,建立一个分类器,以此类推,遍历全部类别,建立N个分类器。

如下表所示,总共3个类别,因此设立3个分类器,每个分类器的样本训练由上文中的二分类步骤完成。

|

|

三角形设为1,其他设为0。作为分类器1,即hθ(1)(x) |

|

正方形设为1,其他设为0。作为分类器2,即hθ(2)(x) | |

|

红十字设为1,其他设为0。作为分类器3,即hθ(3)(x) |

每个分类器训练完毕后,取一个新的x数据,代入3个分类器中,哪个求出的h值最大,则这个分类器可信度最高,此分类器的“1”类别

就是此x的类别。

以上是全部内容,如果有什么地方不对,请在下面留言,谢谢~

机器学习之逻辑回归(logistic回归)的更多相关文章

- 机器学习实战笔记5(logistic回归)

1:简单概念描写叙述 如果如今有一些数据点,我们用一条直线对这些点进行拟合(改线称为最佳拟合直线),这个拟合过程就称为回归.训练分类器就是为了寻找最佳拟合參数,使用的是最优化算法. 基于sigmoid ...

- 机器学习算法( 五、Logistic回归算法)

一.概述 这会是激动人心的一章,因为我们将首次接触到最优化算法.仔细想想就会发现,其实我们日常生活中遇到过很多最优化问题,比如如何在最短时间内从A点到达B点?如何投入最少工作量却获得最大的效益?如何设 ...

- 机器学习(六)— logistic回归

最近一直在看机器学习相关的算法,今天学习logistic回归,在对算法进行了简单分析编程实现之后,通过实例进行验证. 一 logistic概述 个人理解的回归就是发现变量之间的关系,也就是求回归系数, ...

- 机器学习之线性回归以及Logistic回归

1.线性回归 回归的目的是预测数值型数据的目标值.目标值的计算是通过一个线性方程得到的,这个方程称为回归方程,各未知量(特征)前的系数为回归系数,求这些系数的过程就是回归. 对于普通线性回归使用的损失 ...

- python机器学习实现逻辑斯蒂回归

逻辑斯蒂回归 关注公众号"轻松学编程"了解更多. [关键词]Logistics函数,最大似然估计,梯度下降法 1.Logistics回归的原理 利用Logistics回归进行分类的 ...

- <机器学习实战>读书笔记--logistic回归

1. 利用logistic回归进行分类的主要思想是:根据现有数据对分类边界线建立回归公式,以此进行分类. 2.sigmoid函数的分类 Sigmoid函数公式定义 3.梯度上升法 基本思想:要找 ...

- 【机器学习】分类算法——Logistic回归

一.LR分类器(Logistic Regression Classifier) 在分类情形下,经过学习后的LR分类器是一组权值w0,w1, -, wn,当测试样本的数据输入时,这组权值与测试数据按照线 ...

- Softmax回归——logistic回归模型在多分类问题上的推广

Softmax回归 Contents [hide] 1 简介 2 代价函数 3 Softmax回归模型参数化的特点 4 权重衰减 5 Softmax回归与Logistic 回归的关系 6 Softma ...

- Logistic回归(逻辑回归)和softmax回归

一.Logistic回归 Logistic回归(Logistic Regression,简称LR)是一种常用的处理二类分类问题的模型. 在二类分类问题中,把因变量y可能属于的两个类分别称为负类和正类, ...

- [机器学习实战-Logistic回归]使用Logistic回归预测各种实例

目录 本实验代码已经传到gitee上,请点击查收! 一.实验目的 二.实验内容与设计思想 实验内容 设计思想 三.实验使用环境 四.实验步骤和调试过程 4.1 基于Logistic回归和Sigmoid ...

随机推荐

- 无法安装 golang.org/x/tools/的库

安装godep 官方的安装文档是使用go get github.com/tools/godep,很可惜,因为“网络”问题会报一个找不到golang.org/x/tools/go/vcs的错误. 而ht ...

- Linux Kernel Maintainers

http://en.wikipedia.org/wiki/Ingo_Molnár http://zh.wikipedia.org/wiki/英格·蒙內 Ingo Molnár Ingo Molnár, ...

- 基于websocket实现的web聊天室

# -*- coding:utf-8 -*- import socket import base64 import hashlib def get_headers(data): "" ...

- TFS 解除独占锁定

cmd 进入Program Files (x86)\Microsoft Visual Studio 10.0\Common7\IDE tf workspace /delete 工作区名;创建的用户 / ...

- teradata培训文档 相关索引

teradata培训文档 http://wenku.baidu.com/view/ec44c201cc175527072208ba.html Teradata 和Greenplum 的讨论 http: ...

- ZeroClipboard—ZeroClipboard的使用

1.ZeroClipboard的作用: 借助Zero Clipboard能够简单高速地将内容拷贝到剪贴板,相似点击某些网页中"复制"按钮后复制对应区域的内容. 2.ZeroClip ...

- 记使用WaitGroup时的一个错误

记使用WaitGroup时的一个错误 近期重构我之前写的server代码时,不当使用了WaitGroup,碰到了个错误,记录下. package main import ( "fmt&quo ...

- 谈谈加载(Loading)的那点事

谈谈加载(Loading)的那点事 2013/10/12 | 分类: 设计 | 0 条评论 | 标签: 交互设计, 加载 分享到:33 原文出处: 搜狐焦点 对于加载(loading),想必大家都不陌 ...

- objective-c中#import和@class的差别

在Objective-C中,能够使用#import和@class来引用别的类型, 可是你知道两者有什么差别吗? @class叫做forward-class, 你常常会在头文件的定义中看到通过@cla ...

- 【Effective C++】继承与面向对象设计

关于OOP 1,继承可以是单一继承或多重继承,每一个继承连接可以是public.protected或private,也可以是virtual或non-virtual. 2,成员函数的各个选项:virtu ...