cuSPARSELt开发NVIDIA Ampere结构化稀疏性

深度神经网络在各种领域(例如计算机视觉,语音识别和自然语言处理)中均具有出色的性能。处理这些神经网络所需的计算能力正在迅速提高,因此有效的模型和计算至关重要。神经网络剪枝(删除不必要的模型参数以生成稀疏网络)是一种在保持准确性的同时降低模型复杂性的有用方法。

为了利用细粒度的网络剪枝,NVIDIA Ampere GPU架构引入了细粒度的结构稀疏性的概念。在NVIDIA A100 GPU上,结构显示为2:4模式:每四个元素中至少有两个必须为零。通过使用新的NVIDIA Sparse Tensor Core跳过零值的计算,这可以将一个矩阵乘法(也称为GEMM)操作数的数据占用空间和带宽减少2倍,并使吞吐量翻倍。

cuSPARSELt:用于稀疏矩阵-密集矩阵乘法的高性能CUDA库

为了简化NVIDIA Ampere架构稀疏功能的使用,NVIDIA引入了cuSPARSELt ,这是一种高性能CUDA库,专用于常规矩阵操作,其中至少一个操作数是稀疏矩阵。cuSPARSELt库可以使用NVIDIA第三代Tensor Core稀疏矩阵乘累加(SpMMA)操作,而无需进行底层编程。该库还提供用于剪枝和压缩矩阵的辅助函数。

· NVIDIA Sparse Tensor Core支持

o BFLOAT16输入/输出,FP32张量核心累积

· Row-major and column-major memory layouts的内存布局

NVIDIA Sparse Tensor Core support

Mixed-precision support:

FP16 inputs/output, FP32 Tensor Core accumulation

BFLOAT16 inputs/output, FP32 Tensor Core accumulation

INT8 inputs/output, INT32 Tensor Core accumulation

Row-major and column-major memory layouts

Matrix pruning and compression utilities

Auto-tuning functionality

cuSPARSELt库遵循等效方法,并采用与

cuBLASLt和

cuTENSOR类似的概念。库编程模型要求以某种方式组织计算,以使相同的设置可以重复用于不同的输入。

· 用户偏好和约束:提供算法选择或限制可行实现(候选)的搜索空间。

· 计划:收集执行的描述符,并在需要时“找到”最佳实施。

1. 初始化库句柄:cusparseLtInit。

2. 指定输入/输出矩阵特征:cusparseLtDenseDescriptorInit, cusparseLtStructuredDescriptorInit。

3. 初始化矩阵乘法描述符和它的属性(例如操作,计算类型等): cusparseLtMatmulDescriptorInit。

4. 初始化算法选择描述符:cusparseLtMatmulAlgSelectionInit。

5. 初始化矩阵乘法计划:cusparseLtMatmulPlanInit。

6. 剪枝A矩阵:cusparseLtSpMMAPrune。如果用户提供已经满足2:4结构化稀疏性约束的矩阵,例如由

ASP库生成的权重矩阵,则不需要此步骤。

7. 压缩剪枝后的矩阵:cusparseLtSpMMACompress。

8. 执行矩阵乘法:cusparseLtMatmul。可以使用不同的输入多次重复此步骤。

9. 销毁矩阵乘法计划和库句柄:cusparseLtMatmulPlanDestroy,cusparseLtDestroy。

稀疏的GEMM性能

与密集矩阵乘法一样,稀疏矩阵乘法的性能随GEMM尺寸,布局和数据类型而变化。这是当前软件与稀疏GEMM相对性能的快照。

下表显示了cuSPARSELt和cuBLAS在以下操作中的性能:

D = alpha * op(A)* op(B)+ beta * C

在该操作中,A,B,和 D=C分别是尺寸的密集矩阵MXK,KXN,和M×N个。矩阵的布局A和B与Ñ为列主顺序(OP是非转置)和Ť为行优先顺序(OP调换)。

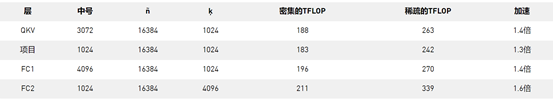

为了展示使用cuSPARSELt可以针对实际工作负载实现的性能,下表显示了带有主要列TN FP16内核的剪枝后的BERT-Large模型(seqlen = 128,BS = 128)使用的一些常见GEMM大小。通常,工作量越大,稀疏性可以提供的帮助越多。

表1. BERT-Large模型和不同层的cuSPARSELt性能。

结构化稀疏矩阵-矩阵乘法代码示例

首先,包括cuSPARSELt标头,设置一些设备指针和数据结构,并初始化cuSPARSELt句柄。

#include <cusparseLt.h> // cusparseLt header // Device pointers and coefficient definitions float alpha = 1.0f; float beta = 0.0f; __half* dA = ... __half* dB = ... __half* dC = ... // cusparseLt data structures and handle initialization cusparseLtHandle_t handle; cusparseLtMatDescriptor_t matA, matB, matC; cusparseLtMatmulDescriptor_t matmul; cusparseLtMatmulAlgSelection_t alg_sel; cusparseLtMatmulPlan_t plan; cudaStream_t stream = nullptr; cusparseLtInit(&handle);

接下来,初始化结构化的稀疏输入矩阵(matrix A),密集输入矩阵(matrix B)和密集输出矩阵(matrix C)描述符。

cusparseLtStructuredDescriptorInit(&handle, &matA, num_A_rows, num_A_cols, lda, alignment, type, order, CUSPARSELT_SPARSITY_50_PERCENT); cusparseLtDenseDescriptorInit(&handle, &matB, num_B_rows, num_B_cols, ldb, alignment, type, order); cusparseLtDenseDescriptorInit(&handle, &matC, num_C_rows, num_C_cols, ldc, alignment, type, order);

准备好描述符后,可以准备矩阵乘法运算的描述符,选择用于执行matmul运算的算法,并初始化matmul计划。

cusparseLtMatmulDescriptorInit(&handle, &matmul, opA, opB, &matA, &matB, &matC, &matC, compute_type); cusparseLtMatmulAlgSelectionInit(&handle, &alg_sel, &matmul, CUSPARSELT_MATMUL_ALG_DEFAULT); int alg = 0; // set algorithm ID cusparseLtMatmulAlgSetAttribute(&handle, &alg_sel, CUSPARSELT_MATMUL_ALG_CONFIG_ID, &alg, sizeof(alg)); size_t workspace_size, compressed_size; cusparseLtMatmulGetWorkspace(&handle, &alg_sel, &workspace_size); cusparseLtMatmulPlanInit(&handle, &plan, &matmul, &alg_sel, workspace_size);

如果稀疏矩阵尚未被其他进程剪枝,则可以在此时进行。不要忘记检查稀疏模式的有效性,以确保可以使用稀疏张量核心来加速它。

cusparseLtSpMMAPrune(&handle, &matmul, dA, dA, CUSPARSELT_PRUNE_SPMMA_TILE, stream); // checking the correctness int is_valid = 0; cusparseLtSpMMAPruneCheck(&handle, &matmul, dA, &is_valid, stream); if (is_valid != 0) { std::printf("!!!! The matrix does not conform to the SpMMA sparsity pattern. " "cusparseLtMatmul does not provide correct results\n"); return EXIT_FAILURE; }

现在已将矩阵A剪枝为2:4稀疏度,可以将其压缩到大约原始大小的一半。与实际的矩阵乘法(小于5%)相比,该步骤的执行时间可以忽略不计。

cusparseLtSpMMACompressedSize(&handle, &plan, &compressed_size); cudaMalloc((void**) &dA_compressed, compressed_size); cusparseLtSpMMACompress(&handle, &plan, dA, dA_compressed, stream);

设置完成后,执行matmul操作。cusparseLtMatmul使用不同的B矩阵可以多次重复调用 。只需设置一次稀疏矩阵。对于A矩阵值更改的用例,cusparseLtSpMMACompress必须再次调用该例程以设置稀疏矩阵的数据结构。

void* d_workspace = nullptr; int num_streams = 0; cudaStream_t* streams = nullptr; cusparseLtMatmul(&handle, &plan, &alpha, dA_compressed, dB, &beta, dC, dD, d_workspace, streams, num_streams) )

最后,通过破坏matmul计划和cuSPARSELt句柄来清理已使用的内存。

cusparseLtMatmulPlanDestroy(&plan); cusparseLtDestroy(&handle);

通过cuSPARSELt库,可以轻松利用NVIDIA Sparse Tensor Core运算,从而在不降低网络准确性的情况下,显着提高了用于深度学习应用程序的矩阵矩阵乘法的性能。该库还提供了用于矩阵压缩,剪枝和性能自动调整的实用程序。简而言之,与普通的密集数学方法相比,cuSPARSELt减少了计算,功耗,执行时间和内存存储。

- 【转】移动Web单页应用开发实践——页面结构化

1. 前言 在开发面向现代智能手机的移动Web应用的时候,无法避免一个事实,就是需要开发单页应用(Single Page WebApp).对于不同的系统需求,单页应用的粒度会不同,可能是整个系统都使用 ...

- 移动Web单页应用开发实践——页面结构化

1. 前言 在开发面向现代智能手机的移动Web应用的时候,无法避免一个事实,就是需要开发单页应用(Single Page WebApp).对于不同的系统需求,单页应用的粒度会不同,可能是整个系统都使用 ...

- Play Framework Web开发教程(33): 结构化页面-组合使用模板

和你编写代码相似,你编写的页面也能够由多个小的片段组合而成,这些小的片段本身也能够由更小的片段构成.这些小片段一般是能够在其他页面反复使用的:有些部分能够用在全部页面,而有些部分是某些页面特定的.本篇 ...

- 第六章 Odoo 12开发之模型 - 结构化应用数据

在本系列文章第三篇Odoo 12 开发之创建第一个 Odoo 应用中,我们概览了创建 Odoo 应用所需的所有组件.本文及接下来的一篇我们将深入到组成应用的每一层:模型层.视图层和业务逻辑层. 本文中 ...

- 【转】自编码算法与稀疏性(AutoEncoder and Sparsity)

目前为止,我们已经讨论了神经网络在有监督学习中的应用.在有监督学习中,训练样本时有类别标签的.现在假设我们只有一个没带类别标签的训练样本集合 ,其中 .自编码神经网络是一种无监督学习算法,它使用了 ...

- [AI开发]基于DeepStream的视频结构化解决方案

视频结构化的定义 利用深度学习技术实时分析视频中有价值的内容,并输出结构化数据.相比数据库中每条结构化数据记录,视频.图片.音频等属于非结构化数据,计算机程序不能直接识别非结构化数据,因此需要先将这些 ...

- .NET Core开发日志——结构化日志

在.NET生态圈中,最早被广泛使用的日志库可能是派生自Java世界里的Apache log4net.而其后来者,莫过于NLog.Nlog与log4net相比,有一项较显著的优势,它支持结构化日志. 结 ...

- CMM模型,结构化开发方法和面向对象开发方法的比较,UML(统一建模语言),jackson开发方法

CMM模型 一.CMM简介 CMM,英文全称为Capability Maturity Model for Software,即:软件成熟度模型. CMM的核心是把软件开发视为一个过程.它是对于软件在定 ...

- [AI开发]视频结构化类应用的局限性

算法不是通用的,基于深度学习的应用系统不但做不到通用,即使对于同一类业务场景,还需要为每个场景做定制.特殊处理,这样才能有可能到达实用标准.这种局限性在计算机视觉领域的应用中表现得尤其突出,本文介绍基 ...

随机推荐

- 用vue-cli3搭建vue项目

1.在nodejs官网下载node安装包,并进行安装:http://nodejs.cn/download/,在环境变量进行配置,并添加node_global和node_cache路径. 2.在D盘新建 ...

- JavaScript 通过身份证号获取出生日期、年龄、性别 、籍贯

JavaScript 通过身份证号获取出生日期.年龄.性别 .籍贯(很全) 效果图: 示例代码: //由于没有写外部JS,所以代码比较长!!! <!DOCTYPE html PUBLIC &qu ...

- 【并发编程】Java中的锁有哪些?

0.死锁 两个或者两个以上的线程在执行过程中,由于竞争资源或者由于彼此通信而造成的一种阻塞现象,若无外力作用,他们都将无法让程序进行下去: 死锁条件: 不可剥夺条件: T1持有的资源无法被T2剥夺 请 ...

- hdu4503 概率

题意: 湫湫系列故事--植树节 Time Limit: 1000/500 MS (Java/Others) Memory ...

- 从苏宁电器到卡巴斯基第26篇:难忘的三年硕士时光 IV

录课,录课,还是录课 开题结束以后,已经是三月的下旬,当时我在考虑要不要回家,毕竟学校这里也没什么事了,我待在学校还得付出一定的花销.后来我考虑到在家的话,只有晚上才能够录课,而在学校的话,整个白天都 ...

- Linux提权之利用 /etc/passwd 文件

当我们获得了某个Linux服务器的低权限之后,我们想要对该低权限账号进行提权,以执行更多的操作. 接下来我们的提权是利用 /etc/passwd 文件的可写入权限,导致我们写入一个其他用户进去. 首先 ...

- node-全局对象

Node.js 全局对象 JavaScript 中有一个特殊的对象,称为全局对象(Global Object),它及其所有属性都可以在程序的任何地方访问,即全局变量. 全局对象与全局变量 global ...

- 消息队列RabbitMQ(二):RabbitMQ的系统架构概述

前言 RabbitMQ是基于AMQP协议的,要想深入理解RabbitMQ,就必须先了解AMQP是个什么东东? AMQP协议 AMQP即Advanced Message Queuing Protocol ...

- Flutter 2.2 现已发布!

在本次 Google I/O 2021 大会 上,我们正式发布了 Flutter 2.2.Flutter 2.2 是我们最新版的开源工具包,可让开发者立足单个平台构建适合任何设备的精美应用.Flutt ...

- JAVA 面试相关

1. int和Integer有什么区别? 答:Java是一个近乎纯洁的面向对象编程语言,但是为了编程的方便还是引入了基本数据类型,但是为了能够将这些基本数据类型当成对象操作,Java为每一个基本数据类 ...