Kafka 入门(一)--安装配置和 kafka-python 调用

一、Kafka 简介

1.基本概念

Kafka 是一个分布式的基于发布/订阅消息系统,主要应用于大数据实时处理领域,其官网是:http://kafka.apache.org/。Kafka 是一个分布式、支持分区的(Partition)、多副本的(Replica),基于 ZooKeeper 协调的发布/订阅消息系统。

Kafka 有以下三个基本概念:

- Kafka 作为一个集群运行在一个或多个服务器上;

- Kafka 集群存储的消息是以 Topic 为类别记录的;

- 每个消息是由一个 Key,一个 Value 和时间戳构成。

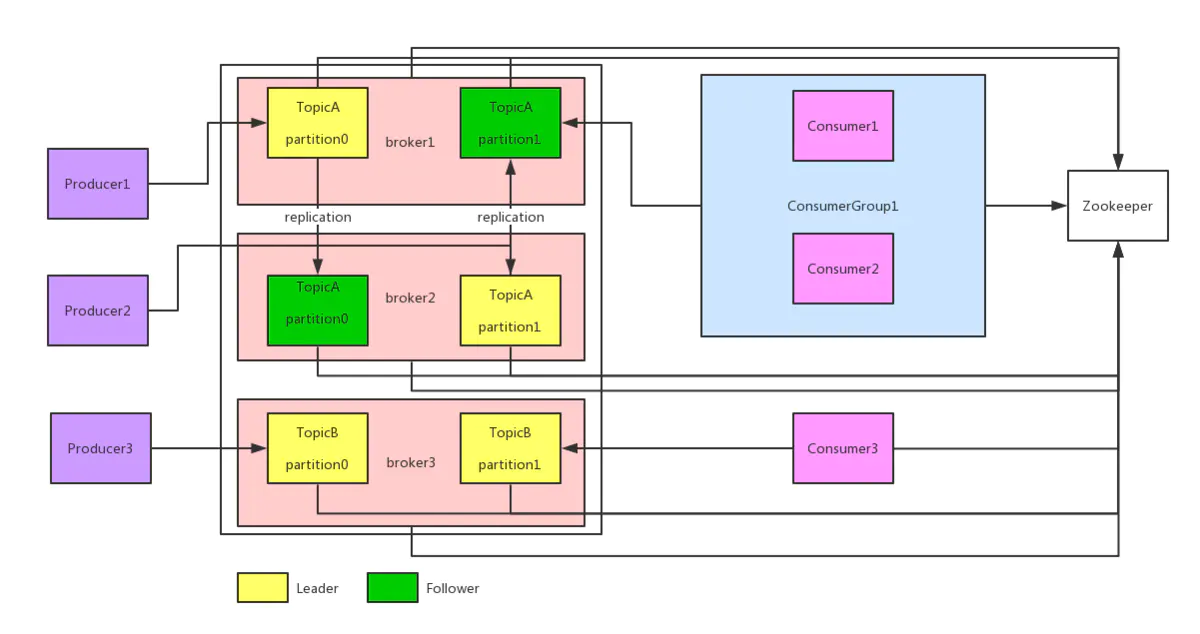

2.基本架构

Kafka 的基本架构图如下:

- Producer:生产者,就是向 Broker 发消息的客户端;

- Consumer:消费者,就是从 Broker 取消息的客户端;

- Consumer Group:消费者组,由多个消费者组成。组内每个消费者负责消费不同分区的数据,一个分区的数据只能由一个组内的消费者进行消费,组内消费者之间互不影响;

- Broker:一个 Kafka 服务器就是一个 Broker,一个集群由多个 Broker 组成;

- Topic:主题,可以理解为队列,生成者和消费者都是用的同一个队列;

- Partition:分区,为实现扩展性,一个大的 Topic 可以分散到多个 Broker 上,一个 Topic 可以分为多个 Partition;

- Replica:副本,保证集群中某个节点发生故障时,该节点上的数据不丢失。

二、Ubuntu 下安装 Kafka

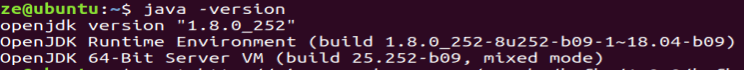

1.安装 Java

更新软件包

sudo apt-get update

安装 openjdk-8-jdk

sudo apt-get install openjdk-8-jdk

查看 Java 版本,检查是否安装成功

2.安装 ZooKeeper

1)安装

下载 ZooKeeper:http://mirrors.hust.edu.cn/apache/zookeeper/。

下载好之后解压(注意:3.5.5之后的版本应该下载文件名中带“bin”的压缩包),再执行如下命令:

sudo mv apache-zookeeper-3.5.8-bin /usr/local/zookeeper

cd /usr/local/zookeeper

cp conf/zoo_sample.cfg conf/zoo.cfg

其中有一些配置参数:

- tickTime:Zookeeper 使用的基本时间单元,默认值2000;

- initLimit:Zookeeper 中连接同步的最大时间,默认值为10;

- syncLimit:Zookeeper 中进行心跳检测的最大时间,默认值为5;

- dataDir:数据库更新事物保存的目录;

- clientPort:Zookeeper 服务监听的端口,默认值为2181。

2)配置

修改 /etc/profile 文件,增加如下内容:

export ZOOKEEPER_HOME=/usr/local/zookeeper/

export PATH=$PATH:$ZOOKEEPER_HOME/bin

更新环境变量

source /etc/profile

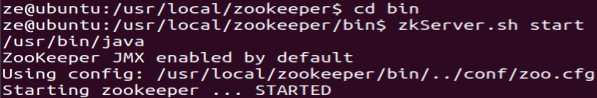

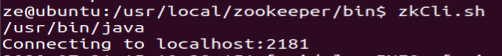

3)测试

首先进入 bin 目录,开启服务:

再启动 CLI 连接服务:

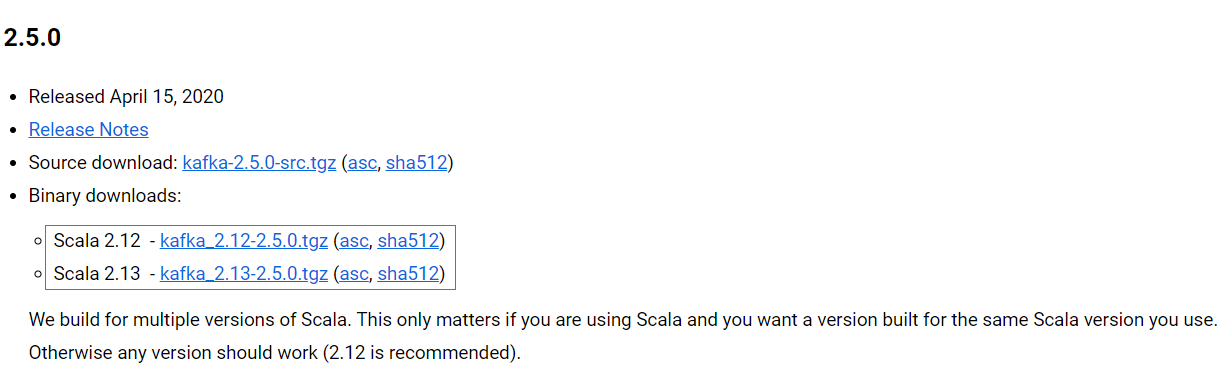

3.安装 Kafka

1)安装

下载 Kafka:http://kafka.apache.org/downloads。

下载好之后解压,再执行如下命令:

sudo mv kafka_2.13-2.5.0/ /usr/local/kafka

cd /usr/local/kafka

2)测试

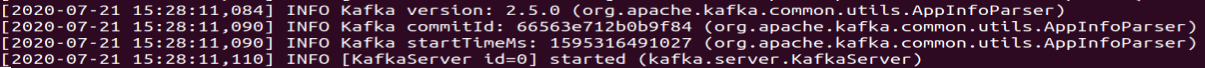

由于前面已经启动了 Zookeeper 服务,所以这里只需要执行如下命令来开启 Kafka 服务:

bin/kafka-server-start.sh config/server.properties

通过输出信息可以看到 Kafka 服务已经成功开启了,截图如下:

但这样开启之后是阻塞的了,我们可以在中间加一个“-daemon”即开一个守护进程来运行,则命令如下:

bin/kafka-server-start.sh -daemon config/server.properties

创建一个主题,用一个分区和一个副本创建一个名为“mytopic”的主题:

bin/kafka-topics.sh --create --zookeeper 127.0.0.1:2181 --replication-factor 1 --partitions 1 --topic mytopic

这样就已经创建成功了,然后可以使用如下命令查看主题:

bin/kafka-topics.sh --list --zookeeper 127.0.0.1:2181

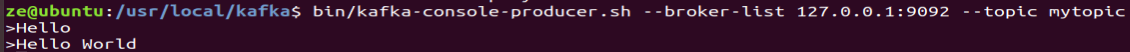

Kafka 有一个命令行服务端,它将从文件或标准输入中获取输入,并将其作为消息发送到 Kafka 集群。默认情况下,每行将作为单独的消息发送:

bin/kafka-console-producer.sh --broker-list 127.0.0.1:9092 --topic mytopic

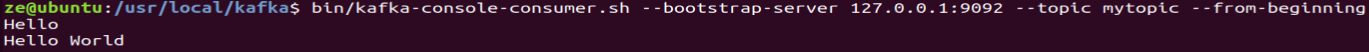

同样的,Kafka 还有一个命令行客户端,可以从 Kafka 集群中获取消息:

bin/kafka-console-consumer.sh --bootstrap-server 127.0.0.1:9092 --topic mytopic --from-beginning

三、kafka-python 使用

1.安装 kafka-python

pip3 install kafka-python

2.创建 Consumer

Consumer 消费者负责从 Kafka 中获取消息进行处理,需要实例化 KafkaConsumer 这个类。

from kafka import KafkaConsumer

consumer = KafkaConsumer("test", bootstrap_servers=["localhost:9092"])

for msg in consumer:

print(msg)

3.创建 Producer

Producer 生产者负责向 Kafka 生产和发送消息,需要实例化 KafkaProducer 这个类。

from kafka import KafkaProducer producer = KafkaProducer(bootstrap_servers="localhost:9092")

for i in range(10):

producer.send("test", "Hello {}".format(i).encode("utf-8"))

producer.close()

4.运行测试

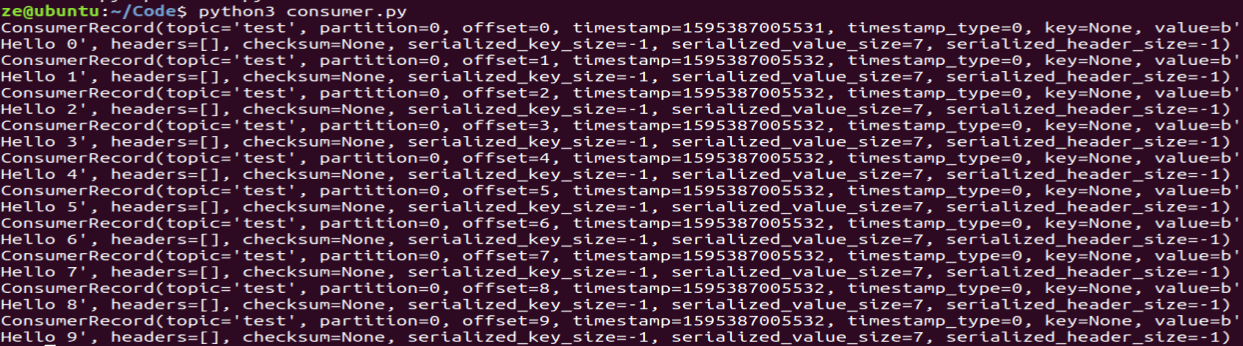

先运行消费者程序,再运行生产者程序,消费者一直在监听,等到生产者发送消息,消费者就把消息取出,运行结果如下:

可以看到其中每个消息都包含了主题、分区、消息内容、时间戳等信息。

Kafka 入门(一)--安装配置和 kafka-python 调用的更多相关文章

- 在Centos 7上安装配置 Apche Kafka 分布式消息系统集群

Apache Kafka是一种颇受欢迎的分布式消息代理系统,旨在有效地处理大量的实时数据.Kafka集群不仅具有高度可扩展性和容错性,而且与其他消息代理(如ActiveMQ和RabbitMQ)相比,还 ...

- (Linux环境Kafka集群安装配置及常用命令

Linux环境Kafka集群安装配置及常用命令 Kafka 消息队列内部实现原理 Kafka架构 一.下载Kafka安装包 二.Kafka安装包的解压 三.设置环境变量 四.配置kafka文件 4.1 ...

- kafka介绍及安装配置(windows)

Kafka介绍 Kafka是分布式的发布—订阅消息系统.它最初由LinkedIn(领英)公司发布,使用Scala和Java语言编写,与2010年12月份开源,成为Apache的顶级项目.Kafka是一 ...

- Kafka集群安装部署、Kafka生产者、Kafka消费者

Storm上游数据源之Kakfa 目标: 理解Storm消费的数据来源.理解JMS规范.理解Kafka核心组件.掌握Kakfa生产者API.掌握Kafka消费者API.对流式计算的生态环境有深入的了解 ...

- 【菜鸟入门】安装配置eclipse 并编写运行第一个Java程序

不得不吐槽一下,安装配置这eclipse真是太费劲了...下面总结一下,以便下次再安装 本人 win10系统,64位机 一.在官网下载eclipse安装包 文件名:eclipse-inst-win64 ...

- zookeeper和Kafka集群安装配置

3个虚拟机,首先关闭防火墙,在进行下面操作 一.java环境 yum list java* yum -y install java-1.8.0-openjdk* 查看Java版本 Java -vers ...

- kafka集群安装配置

1.下载安装包 2.解压安装包 3.进入到kafka的config目录修改server.properties文件 进入后显示如下: 修改log.dirs,基本上大部分都是默认配置 kafka依赖zoo ...

- Kafka入门(安装及使用)

Kafka是一种分布式的,基于发布/订阅的消息系统. Kafka的组成包括: Kafka将消息以topic为单位进行归纳. 将向Kafka topic发布消息的程序成为producers. 将预订to ...

- linux 安装配置 sublime 进行 python 开发

1. 下载sublime 地址:http://www.sublimetext.com/3 2. 解压出来,将sublime_text_3 文件夹的名字改为 sublime_text , 然后将 sub ...

- Redis安装配置及在Python上的应用

最近在使用Kazoo(开源电话系统) API时,一次请求的处理需要调用几次API,只为了得到一个name和id的对应关系,耗时非常大,开始想使用一种简单的实现,直接将对应关系保存到静态类的静态变量中, ...

随机推荐

- hashcode和==

public class Main { public static void main(String[] args) { Object o=new Object(); System.out.print ...

- android屏幕适配的全攻略2--支持手机各种屏幕密度dpi

如何为不同密度的屏幕提供不同的资源和使用密度独立的单位. 1 使用密度无关像素 坚决杜绝在布局文件中使用绝对像素来定位和设置大小.因为不同的屏幕有不同的像素密度,所以使用像素来设置控件大小是有问题的, ...

- jvm基础知识1

堆放实例对象,栈放实例对象的引用,方法区存储创建类的信息 上面堆和垃圾回收的关系,垃圾回收回收的是堆内存的数据,s0和s1区域, 例如现在我们要清除s0中的堆对象,将s0中正在运行的对象从s0区域移动 ...

- 且谈 Apache Spark 的 API 三剑客:RDD、DataFrame 和 Dataset

作者:Jules S. Damji 译者:足下 本文翻译自 A Tale of Three Apache Spark APIs: RDDs, DataFrames, and Datasets ,翻译已 ...

- 【Spring】原来SpringBoot是这样玩的

菜瓜:我自己去调Mvc的源码差点没给Spring的逻辑秀死...难受 水稻:那今天咱们看一个简单易用的SpringBoot吧 菜瓜:可以,这个我熟悉 水稻:熟悉? 菜瓜:当我没说,请开始你的表演 水稻 ...

- Oracle查询表空间使用率很慢

Oracle查询表空间使用率很慢 问题描述 执行查询表空间的语句,需要接近2min的时间才能执行完成. 以前也在其他客户的生产库遇到过一样的情况,当时是由于回收站的内容过多引起的. 不过这次的情况却不 ...

- Oracle Solaris 10图文安装

文章目录 1. 虚拟机软件 2. solaris 10镜像 3. 安装OS 4. 允许远程使用root用户登录SSH 5. bash配置 5.1. 修改bash 5.2. 修改提示符 6. CRT连接 ...

- 转载------一小时包教会 —— webpack 入门指南

本文写的蛮好,转载地址:http://www.w2bc.com/Article/50764 其他的地址: http://webpack.github.io/docs/usage-with-gulp.h ...

- vue.js之常操作(实例)

听说大家都开始用react.vue这些MVVM框架了,为了不落后,还是学学吧!(之前只对angular了解一点,时间一长,也忘得差不多了,所以学习vue相当于从小白开始) 从vue.js官网看一下,先 ...

- day14总结

装饰器 """1.什么是装饰器 器指的是工具/功能 装饰指的是为被装饰对象添加额外的功能 大白话:定义装饰器就是定义了一个函数,该函数就是用来为其他函数添加额外的功能的 ...