Spark 学习笔记之 union/intersection/subtract

union/intersection/subtract:

import org.apache.spark.SparkContext

import org.apache.spark.rdd.RDD

import org.apache.spark.sql.SparkSession object TransformationsDemo {

def main(args: Array[String]): Unit = {

val sparkSession = SparkSession.builder().appName("TransformationsDemo").master("local[1]").getOrCreate()

val sc = sparkSession.sparkContext

testUnion(sc)

testIntersection(sc)

testSubtract(sc) } private def testSubtract(sc: SparkContext) = {

val rdd1 = sc.parallelize(1 to 3, 1)

val rdd2 = sc.parallelize(3 to 5, 1)

//返回在当前RDD中出现,并且不在另一个RDD中出现的元素,不去重。

rdd1.subtract(rdd2).collect().foreach(println)

println(s"partitions: ${rdd1.subtract(rdd2, 1).partitions.size}")

println(s"partitions: ${rdd1.subtract(rdd2, 2).partitions.size}") val rdd3 = sc.parallelize(List(List(1, 2, 3), List(4, 5, 6)), 1)

val rdd4 = sc.parallelize(List(List(4, 5, 6), List(7, 8, 9)), 1)

rdd3.subtract(rdd4).collect().foreach(println)

} private def testIntersection(sc: SparkContext) = {

val rdd1 = sc.parallelize(1 to 2, 1)

val rdd2 = sc.parallelize(3 to 5, 1)

//返回两个RDD的交集,并且去重。

rdd1.intersection(rdd2).collect().foreach(println)

println(s"partitions: ${rdd1.intersection(rdd2, 1).partitions.size}")

println(s"partitions: ${rdd1.intersection(rdd2, 2).partitions.size}") val rdd3 = sc.parallelize(List(List(1, 2, 3), List(4, 5, 6)), 1)

val rdd4 = sc.parallelize(List(List(4, 5, 6), List(7, 8, 9)), 1)

rdd3.intersection(rdd4).collect().foreach(println)

} private def testUnion(sc: SparkContext) = {

val rdd1 = sc.parallelize(1 to 3, 1)

val rdd2 = sc.parallelize(3 to 5, 1)

//将两个RDD进行合并,不去重。

rdd1.union(rdd2).collect().foreach(println) val rdd3 = sc.parallelize(List(List(1, 2, 3), List(4, 5, 6)), 1)

val rdd4 = sc.parallelize(List(List(4, 5, 6), List(7, 8, 9)), 1)

rdd3.union(rdd4).collect().foreach(println)

} }

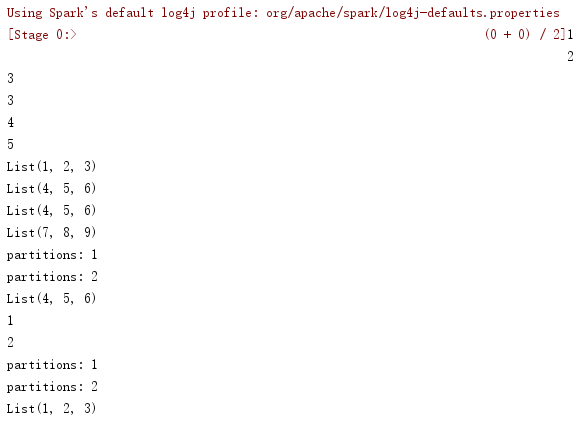

运行结果:

Spark 学习笔记之 union/intersection/subtract的更多相关文章

- Spark学习笔记3——RDD(下)

目录 Spark学习笔记3--RDD(下) 向Spark传递函数 通过匿名内部类 通过具名类传递 通过带参数的 Java 函数类传递 通过 lambda 表达式传递(仅限于 Java 8 及以上) 常 ...

- spark学习笔记总结-spark入门资料精化

Spark学习笔记 Spark简介 spark 可以很容易和yarn结合,直接调用HDFS.Hbase上面的数据,和hadoop结合.配置很容易. spark发展迅猛,框架比hadoop更加灵活实用. ...

- Spark学习笔记之SparkRDD

Spark学习笔记之SparkRDD 一. 基本概念 RDD(resilient distributed datasets)弹性分布式数据集. 来自于两方面 ① 内存集合和外部存储系统 ② ...

- Spark学习笔记2——RDD(上)

目录 Spark学习笔记2--RDD(上) RDD是什么? 例子 创建 RDD 并行化方式 读取外部数据集方式 RDD 操作 转化操作 行动操作 惰性求值 Spark学习笔记2--RDD(上) 笔记摘 ...

- Spark学习笔记2(spark所需环境配置

Spark学习笔记2 配置spark所需环境 1.首先先把本地的maven的压缩包解压到本地文件夹中,安装好本地的maven客户端程序,版本没有什么要求 不需要最新版的maven客户端. 解压完成之后 ...

- Spark学习笔记3(IDEA编写scala代码并打包上传集群运行)

Spark学习笔记3 IDEA编写scala代码并打包上传集群运行 我们在IDEA上的maven项目已经搭建完成了,现在可以写一个简单的spark代码并且打成jar包 上传至集群,来检验一下我们的sp ...

- Spark学习笔记-GraphX-1

Spark学习笔记-GraphX-1 标签: SparkGraphGraphX图计算 2014-09-29 13:04 2339人阅读 评论(0) 收藏 举报 分类: Spark(8) 版权声明: ...

- Spark学习笔记0——简单了解和技术架构

目录 Spark学习笔记0--简单了解和技术架构 什么是Spark 技术架构和软件栈 Spark Core Spark SQL Spark Streaming MLlib GraphX 集群管理器 受 ...

- Spark学习笔记1——第一个Spark程序:单词数统计

Spark学习笔记1--第一个Spark程序:单词数统计 笔记摘抄自 [美] Holden Karau 等著的<Spark快速大数据分析> 添加依赖 通过 Maven 添加 Spark-c ...

随机推荐

- xcode7中搭建python开发环境

1. 双击打开Xcode 2. 点击File->New->New Project 3. 在左边的面板选择Other,右边选择External Build Sytem,点击Next 4. 输 ...

- HDU-10240Max Sum Plus Plus+动态规划+滚动数组

Max Sum Plus Plus 题意:题意理解了老半天,这里是说在给定数列中,取m组子数列,不能有重复,使得这些子序列的和最大: 就比如m=2时候,1 /2/-4/5/6.可以不用拿-4的意思: ...

- 牛客多校第五场 E room 二分图匹配 KM算法模板

链接:https://www.nowcoder.com/acm/contest/143/E来源:牛客网 Nowcoder University has 4n students and n dormit ...

- CF991D Bishwock 第十七 贪心

Bishwock time limit per test 1 second memory limit per test 256 megabytes input standard input outpu ...

- ui、li模拟下拉框

转载:原文地址:https://www.jianshu.com/p/e303e0298e9e 效果图: HTML: <div class="rank_top"> < ...

- [译]Introduction to Concurrency in Spring Boot

当我们使用springboot构建服务的时候需要处理并发.一种错误的观念认为由于使用了Servlets,它对于每个请求都分配一个线程来处理,所以就没有必要考虑并发.在这篇文章中,我将提供一些建议,用于 ...

- (六十五)c#Winform自定义控件-思维导图/组织架构图(工业)

前提 入行已经7,8年了,一直想做一套漂亮点的自定义控件,于是就有了本系列文章. GitHub:https://github.com/kwwwvagaa/NetWinformControl 码云:ht ...

- Go语言基础之并发

并发是编程里面一个非常重要的概念,Go语言在语言层面天生支持并发,这也是Go语言流行的一个很重要的原因. Go语言中的并发编程 并发与并行 并发:同一时间段内执行多个任务(你在用微信和两个女朋友聊天) ...

- Mysql高手系列 - 第9篇:详解分组查询,mysql分组有大坑!

这是Mysql系列第9篇. 环境:mysql5.7.25,cmd命令中进行演示. 本篇内容 分组查询语法 聚合函数 单字段分组 多字段分组 分组前筛选数据 分组后筛选数据 where和having的区 ...

- Docker的优缺点

Docker解决的问题 由于不同的机器有不同的操作系统,以及不同的库和组件,将一个应用程序部署到多台机器上需要进行大量的环境配置操作.(例如经常出现的类似"在我的机器上就没问题"这 ...