【爬虫+数据清洗+可视化分析】Python舆情分析哔哩哔哩"狂飙"的评论

一、背景介绍

您好,我是@马哥python说,一枚10年程序猿。

2023开年这段时间,《狂飙》这部热播剧引发全民追剧,不仅全员演技在线,更是符合反黑主旋律,因此创下多个收视率记录!

基于此热门事件,我用python抓取了B站上千条评论,并进行可视化舆情分析,下面详细讲解代码。

二、爬虫代码

2.1 展示爬取结果

首先,看下部分爬取数据:

爬取字段含:视频链接、评论页码、评论作者、评论时间、IP属地、点赞数、评论内容。

2.2 爬虫代码讲解

导入需要用到的库:

import requests # 发送请求

import pandas as pd # 保存csv文件

import os # 判断文件是否存在

import time

from time import sleep # 设置等待,防止反爬

import random # 生成随机数

定义一个请求头:

# 请求头

headers = {

'authority': 'api.bilibili.com',

'accept': 'application/json, text/plain, */*',

'accept-language': 'zh-CN,zh;q=0.9,en;q=0.8,en-GB;q=0.7,en-US;q=0.6',

# 需定期更换cookie,否则location爬不到

'cookie': "需换成自己的cookie值",

'origin': 'https://www.bilibili.com',

'referer': 'https://www.bilibili.com/video/BV1FG4y1Z7po/?spm_id_from=333.337.search-card.all.click&vd_source=69a50ad969074af9e79ad13b34b1a548',

'sec-ch-ua': '"Chromium";v="106", "Microsoft Edge";v="106", "Not;A=Brand";v="99"',

'sec-ch-ua-mobile': '?0',

'sec-ch-ua-platform': '"Windows"',

'sec-fetch-dest': 'empty',

'sec-fetch-mode': 'cors',

'sec-fetch-site': 'same-site',

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/106.0.0.0 Safari/537.36 Edg/106.0.1370.47'

}

请求头中的cookie是个很关键的参数,如果不设置cookie,会导致数据残缺或无法爬取到数据。

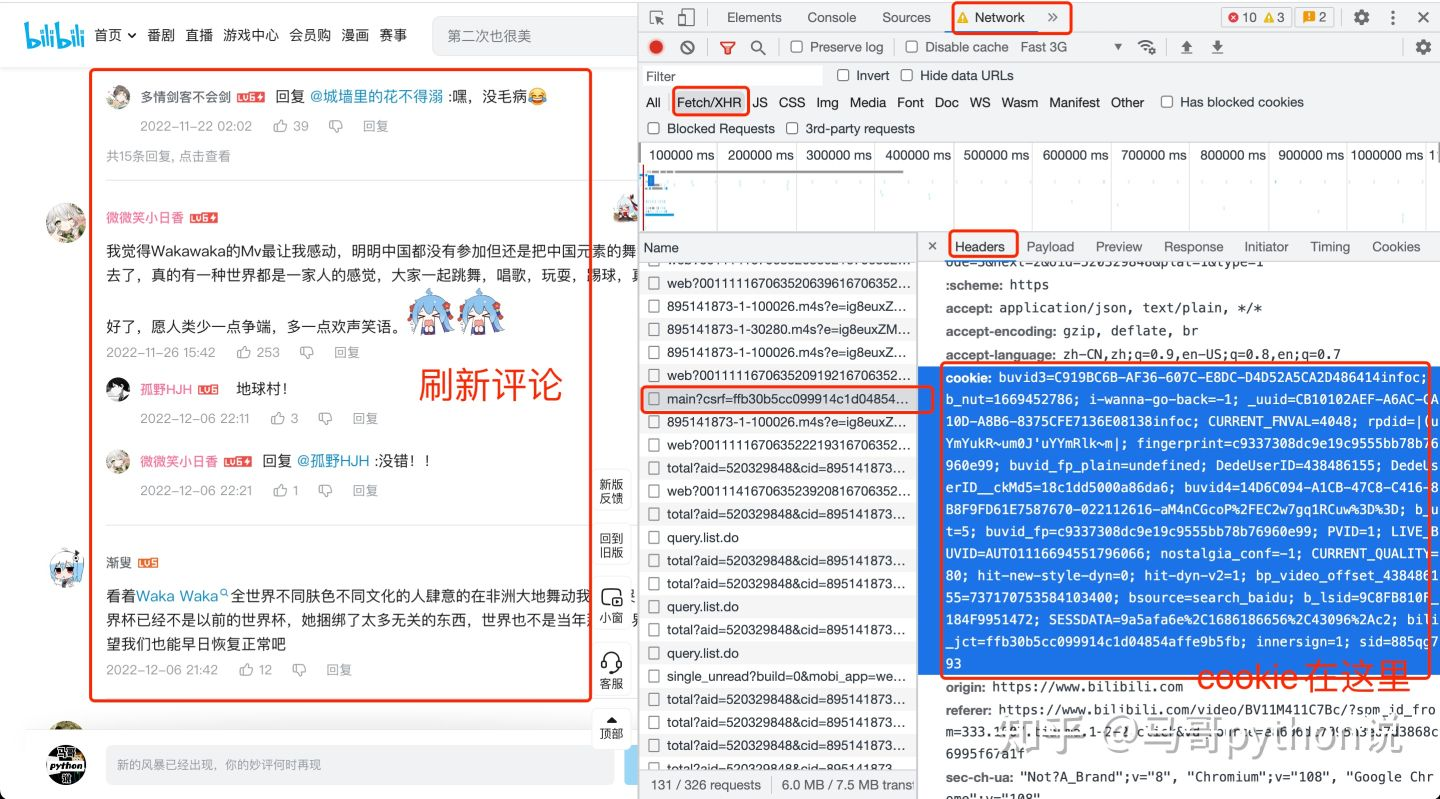

那么cookie如何获取呢?打开开发者模式,见下图:

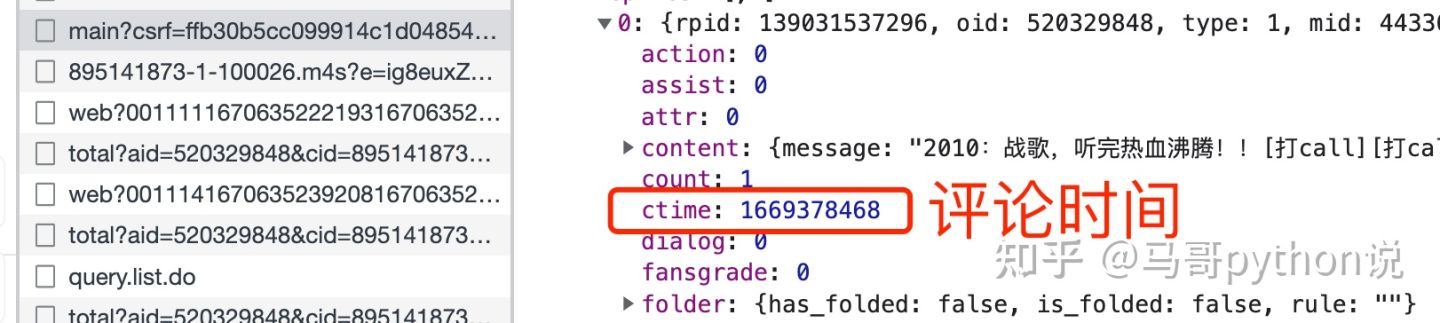

由于评论时间是个十位数:

所以开发一个函数用于转换时间格式:

def trans_date(v_timestamp):

"""10位时间戳转换为时间字符串"""

timeArray = time.localtime(v_timestamp)

otherStyleTime = time.strftime("%Y-%m-%d %H:%M:%S", timeArray)

return otherStyleTime

向B站发送请求:

response = requests.get(url, headers=headers, ) # 发送请求

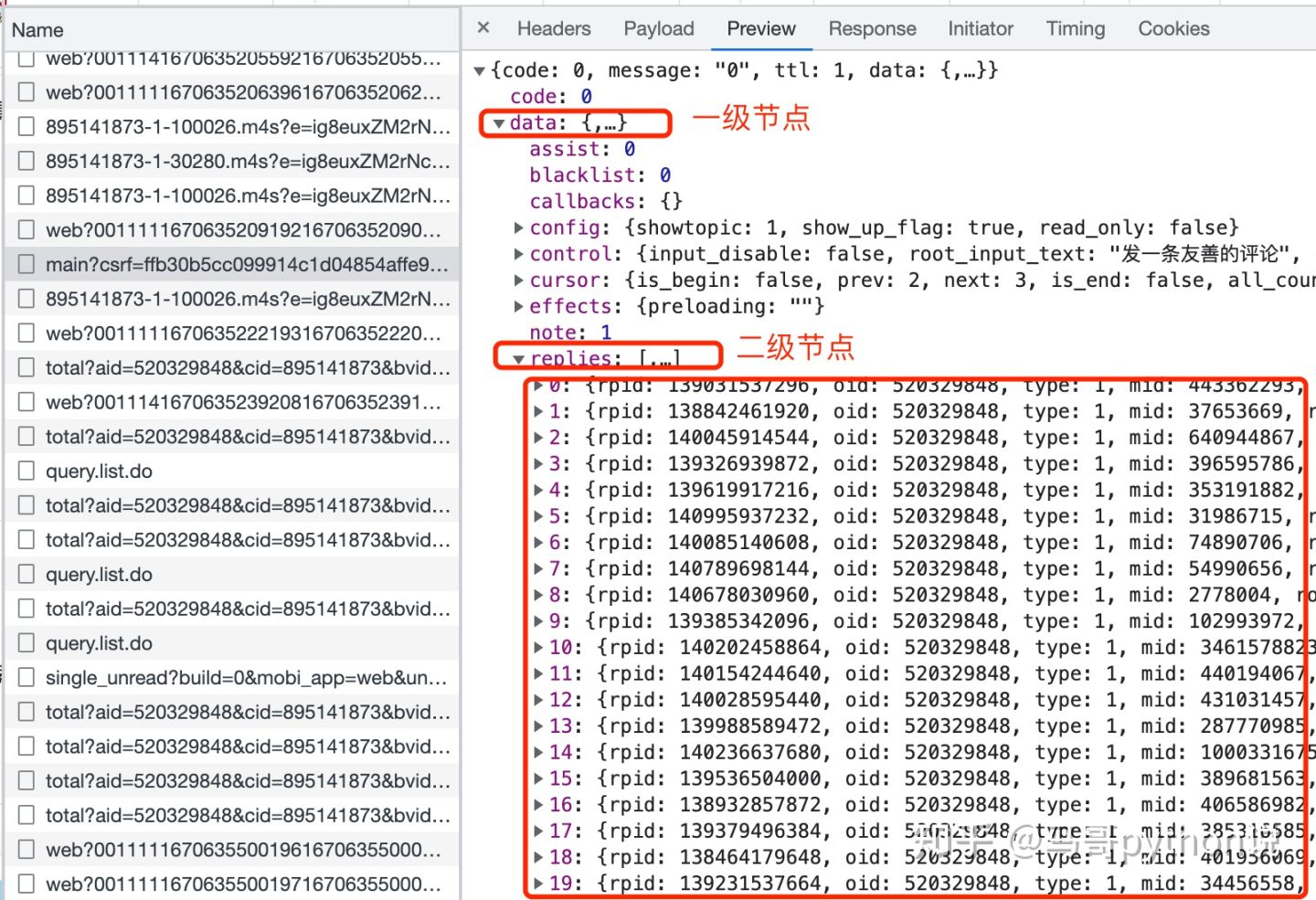

接收到返回数据了,怎么解析数据呢?看一下json数据结构:

0-19个评论,都存放在replies下面,replies又在data下面,所以,这样解析数据:

data_list = response.json()['data']['replies'] # 解析评论数据

这样,data_list里面就是存储的每条评论数据了。

接下来吗,就是解析出每条评论里的各个字段了。

我们以评论内容这个字段为例:

comment_list = [] # 评论内容空列表

# 循环爬取每一条评论数据

for a in data_list:

# 评论内容

comment = a['content']['message']

comment_list.append(comment)

其他字段同理,不再赘述。

最后,把这些列表数据保存到DataFrame里面,再to_csv保存到csv文件,持久化存储完成:

# 把列表拼装为DataFrame数据

df = pd.DataFrame({

'视频链接': 'https://www.bilibili.com/video/' + v_bid,

'评论页码': (i + 1),

'评论作者': user_list,

'评论时间': time_list,

'IP属地': location_list,

'点赞数': like_list,

'评论内容': comment_list,

})

# 把评论数据保存到csv文件

df.to_csv(outfile, mode='a+', encoding='utf_8_sig', index=False, header=header)

注意,加上encoding='utf_8_sig',否则可能会产生乱码问题!

下面,是主函数循环爬取部分代码:(支持多个视频的循环爬取)

# 随便找了几个"狂飙"相关的视频ID

bid_list = ['BV1Hx4y1E7QP', 'BV1Ev4y1r737', 'BV19x4y177ni']

# 评论最大爬取页(每页20条评论)

max_page = 50

# 循环爬取这几个视频的评论

for bid in bid_list:

# 输出文件名

outfile = 'b站评论_{}.csv'.format(now)

# 转换aid

aid = bv2av(bid=bid)

# 爬取评论

get_comment(v_aid=aid, v_bid=bid)

三、可视化代码

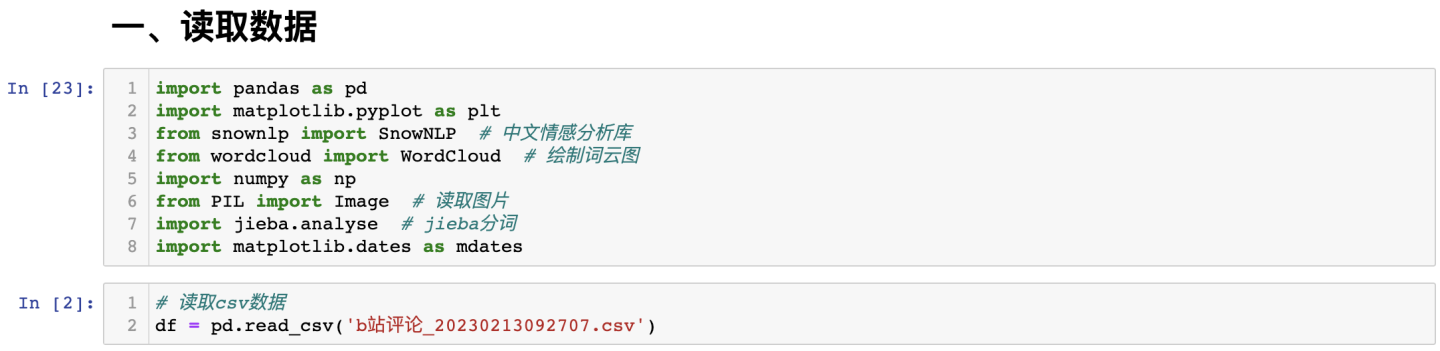

为了方便看效果,以下代码采用jupyter notebook进行演示。

3.1 读取数据

用read_csv读取刚才爬取的B站评论数据:

查看前3行及数据形状:

3.2 数据清洗

处理空值及重复值:

3.3 可视化

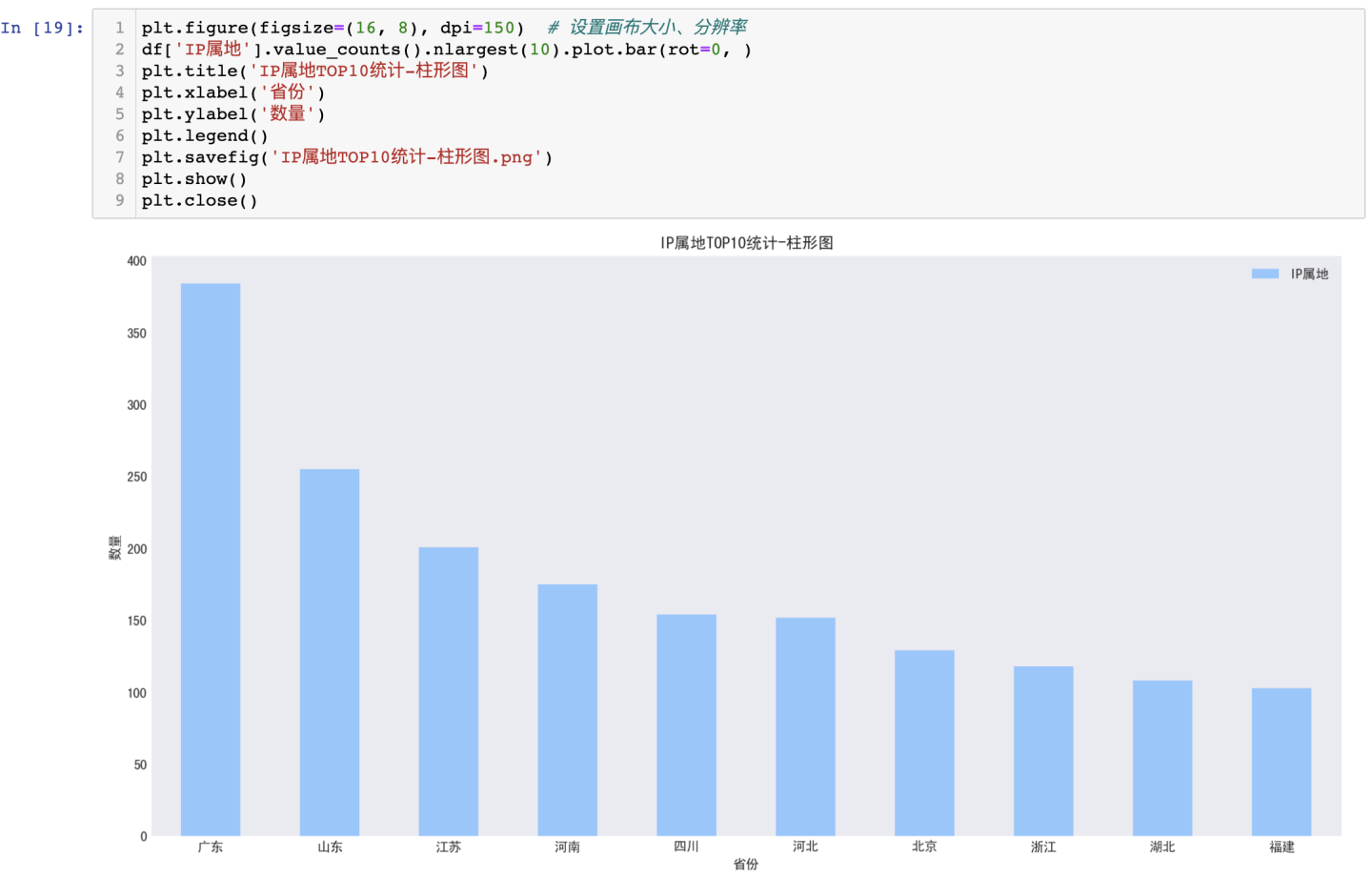

3.3.1 IP属地分析-柱形图

可得结论:TOP10地区中,评论里关注度最高为广东、山东、江苏等地区,其中,广东省的关注度最高。

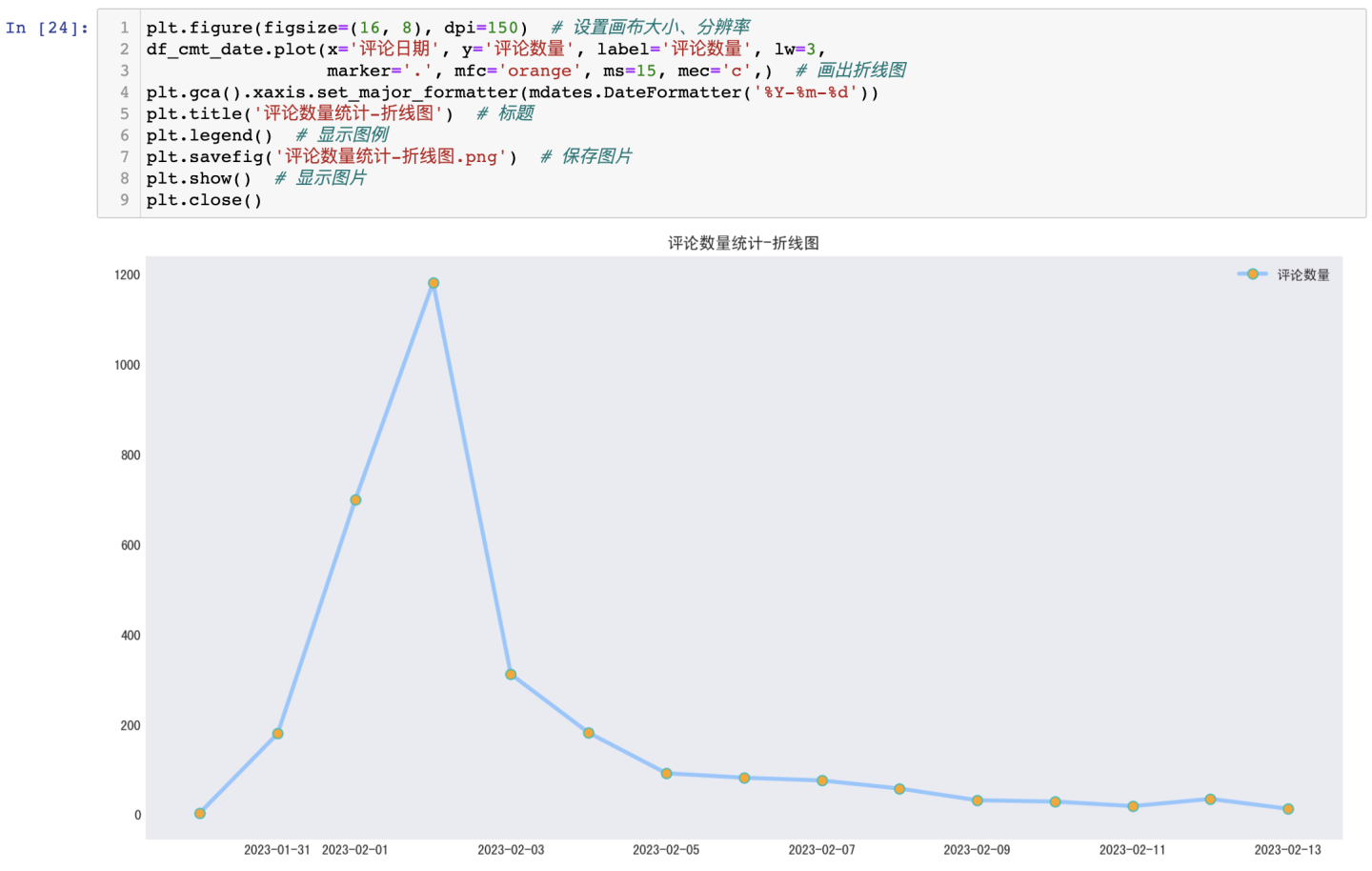

3.3.2 评论时间分析-折线图

分析出评论时间的分布情况:

可得结论:关于"狂飙"这个话题,在抓取到的数据范围内,2月2日的评论数据量最大,网友讨论最热烈,达到了将近1200的数量峰值。

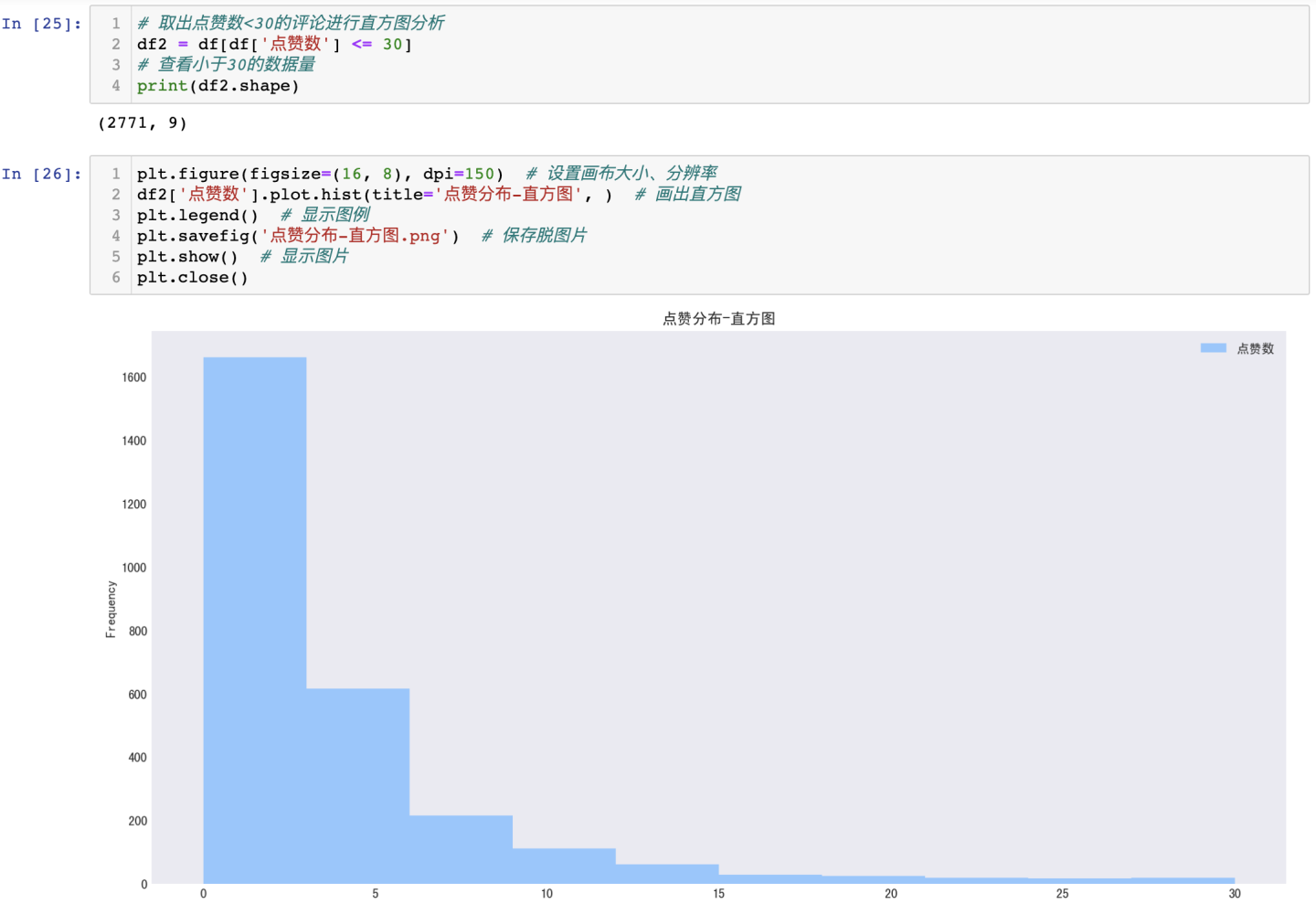

3.3.3 点赞数分布-直方图

由于点赞数大部分为0或个位数情况,个别点赞数到达成千上万,直方图展示效果不佳,因此,仅提取点赞数<30的数据绘制直方图。

可得结论:从直方图的分布来看,点赞数在0-3个的评论占据大多数,很少点赞数达到了上千上万的情况。证明网友对狂飙这部作品的态度分布比较均匀,没有出现态度非常聚集的评论内容。

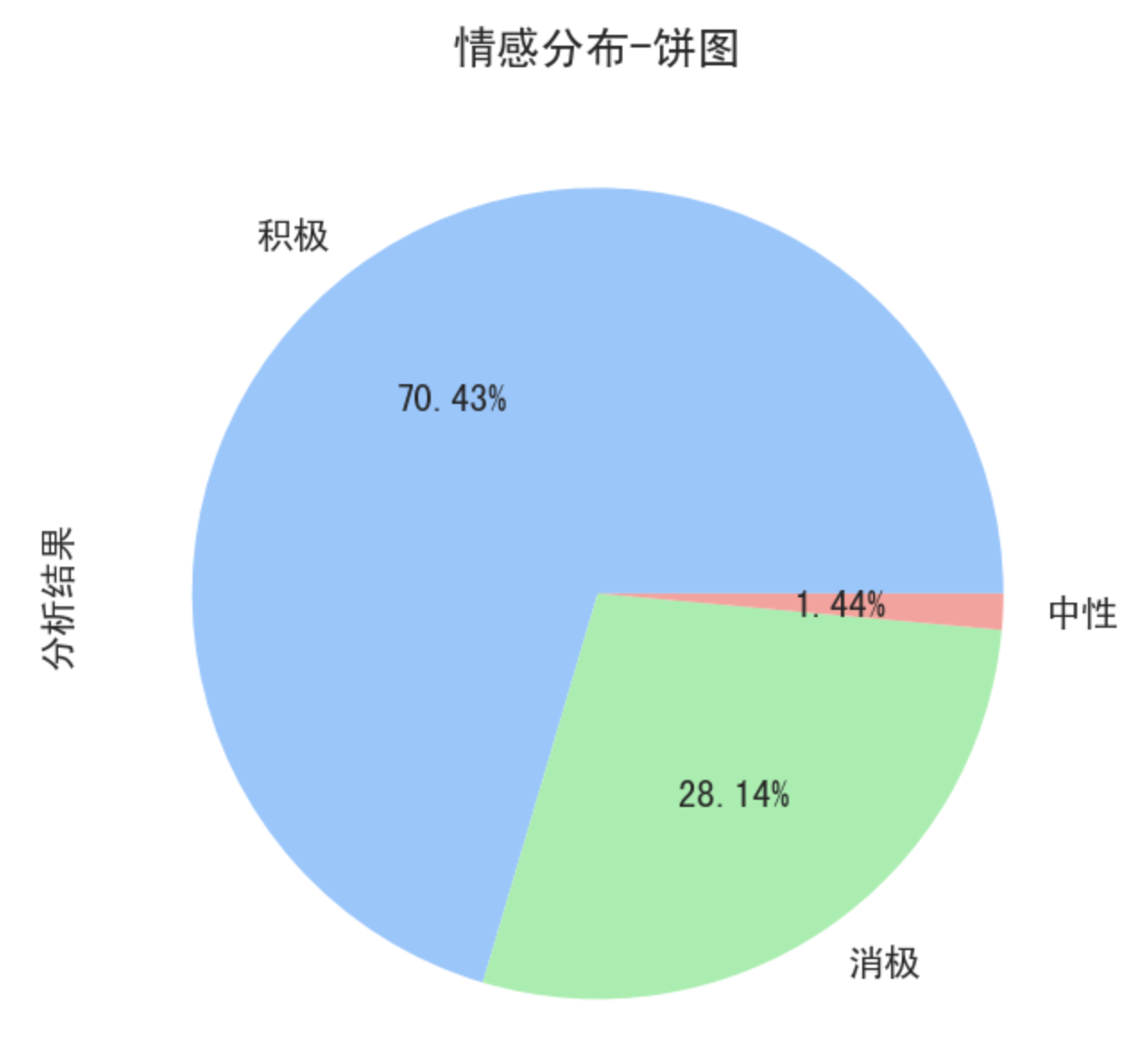

3.3.4 评论内容-情感分布饼图

针对中文评论数据,采用snownlp开发情感判定函数:

情感分布饼图,如下:

可得结论:关于狂飙这部电视剧,网友的评论情感以正面居多,占据了70.43%,说明这部电视剧获得了网友们很高的评价。

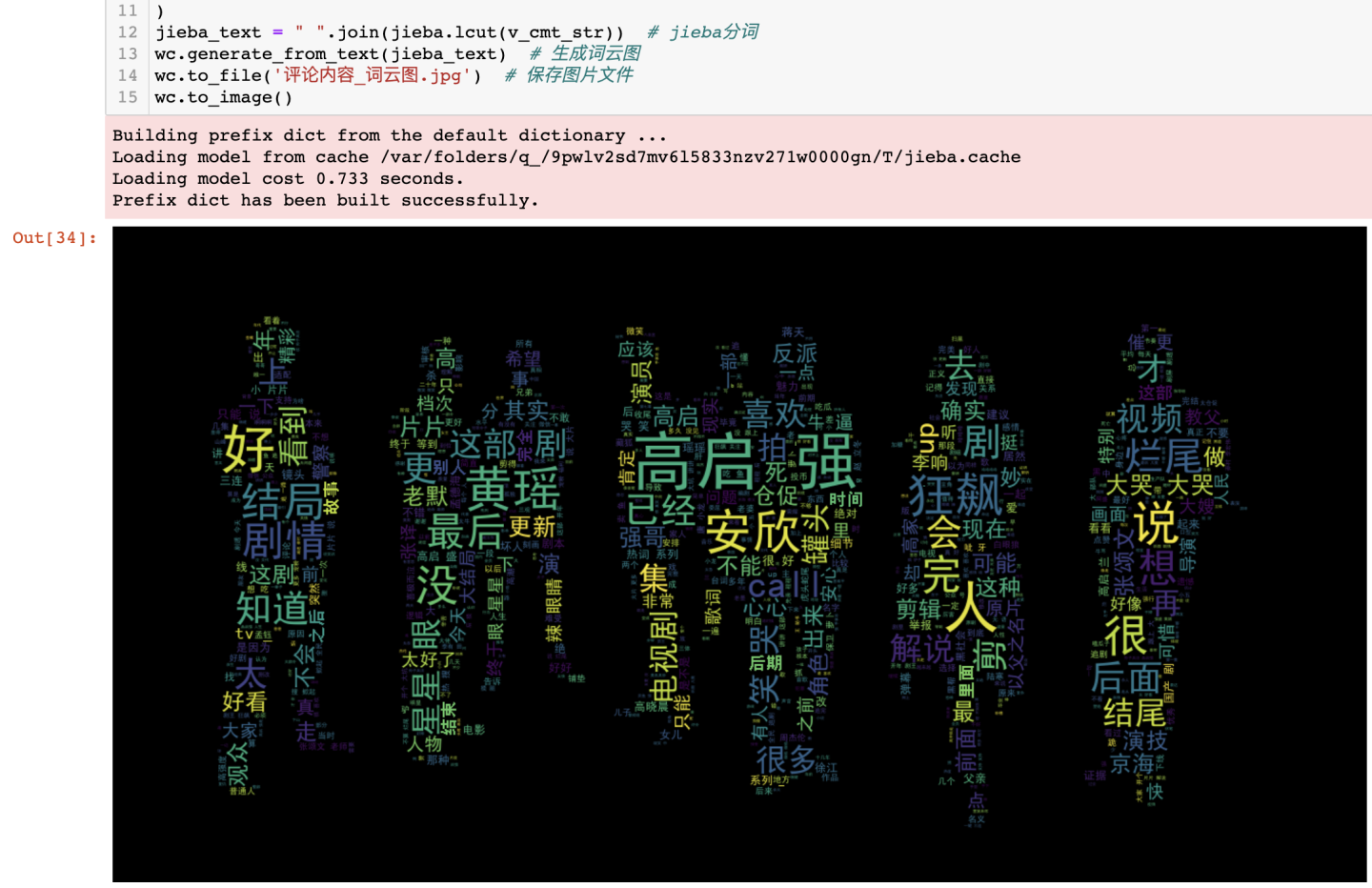

3.3.5 评论内容-词云图

除了哈工大停用词之外,还新增了自定义停用词:

jieba分词之后,对分词后数据进行绘制词云图:

可得结论:在词云图中,狂飙、高启强、黄瑶、安欣、结局等词汇较大,出现频率较高,反应出众多网友对狂飙这部电视剧的剧情讨论热度很高。

附原始背景图,可对比看:(需要先人物抠图)

四、演示视频

代码演示视频:

https://www.bilibili.com/video/BV1D8411T7dm

五、附完整源码

完整源码:【爬虫+数据清洗+可视化分析】舆情分析哔哩哔哩"狂飙"的评论

我是 @马哥python说 ,持续分享python源码干货中!

【爬虫+数据清洗+可视化分析】Python舆情分析哔哩哔哩"狂飙"的评论的更多相关文章

- 【爬虫+数据清洗+可视化分析】舆情分析哔哩哔哩"狂飙"的评论

目录 一.背景介绍 二.爬虫代码 2.1 展示爬取结果 2.2 爬虫代码讲解 三.可视化代码 3.1 读取数据 3.2 数据清洗 3.3 可视化 3.3.1 IP属地分析-柱形图 3.3.2 评论时间 ...

- 【爬虫+情感判定+Top10高频词+词云图】“谷爱凌”热门弹幕python舆情分析

一.背景介绍 最近几天,谷爱凌在冬奥会赛场上夺得一枚宝贵的金牌,为中国队贡献了自己的荣誉! 针对此热门事件,我用Python的爬虫和情感分析技术,针对小破站的弹幕数据,分析了众网友弹幕的舆论导向,下面 ...

- 【爬虫+情感判定+Top10高频词+词云图】“刘畊宏“热门弹幕python舆情分析

一.背景介绍 最近一段时间,刘畊宏真是火出了天际,引起一股全民健身的热潮,毕竟锻炼身体,是个好事! 针对此热门事件,我用Python的爬虫和情感分析技术,针对小破站的弹幕数据,分析了众多网友弹幕的舆论 ...

- 【爬虫+情感判定+Top10高频词+词云图】"王心凌"热门弹幕python舆情分析

目录 一.背景介绍 二.代码讲解-爬虫部分 2.1 分析弹幕接口 2.2 讲解爬虫代码 三.代码讲解-情感分析部分 3.1 整体思路 3.2 情感分析打标 3.3 统计top10高频词 3.4 绘制词 ...

- 金融量化分析-python量化分析系列之---使用python获取股票历史数据和实时分笔数据

财经数据接口包tushare的使用(一) Tushare是一款开源免费的金融数据接口包,可以用于获取股票的历史数据.年度季度报表数据.实时分笔数据.历史分笔数据,本文对tushare的用法,已经存在的 ...

- 基于flask框架的高校舆情分析系统

系统分析: 高校舆情分析拟实现如下功能,采集微博.贴吧.学校官网的舆情信息,对这些舆情进行数据分析.情感分析,提取关键词,生成词云分析,情感分析图,实时监测舆情动态. 系统设计: 前端:采用layui ...

- 爬虫综合大作业——网易云音乐爬虫 & 数据可视化分析

作业要求来自于https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3075 爬虫综合大作业 选择一个热点或者你感兴趣的主题. 选择爬取的对象 ...

- Python数据采集分析告诉你为何上海二手房你都买不起

感谢关注Python爱好者社区公众号,在这里,我们会每天向您推送Python相关的文章实战干货. 来吧,一起Python. 对商业智能BI.大数据分析挖掘.机器学习,python,R等数据领域感兴趣的 ...

- 【爬虫+数据分析+数据可视化】python数据分析全流程《2021胡润百富榜》榜单数据!

目录 一.爬虫 1.1 爬取目标 1.2 分析页面 1.3 爬虫代码 1.4 结果数据 二.数据分析 2.1 导入库 2.2 数据概况 2.3 可视化分析 2.3.1 财富分布 2.3.2 年龄分布 ...

- 如何进行python性能分析?

在分析python代码性能瓶颈,但又不想修改源代码的时候,ipython shell以及第三方库提供了很多扩展工具,可以不用在代码里面加上统计性能的装饰器,也能很方便直观的分析代码性能.下面以我自己实 ...

随机推荐

- SPEL表达式注入分析

环境依赖 <dependencies> <dependency> <groupId>org.springframework</groupId> < ...

- Avalonia的Window生命周期

Avalonia中的Window 在Avalonia中,Window是一个基本的UI元素,它代表了一个应用程序的窗口.每个Window都可以包含其他的UI元素,如按钮.文本框等,并可以响应各种用户输入 ...

- #直径#CF804D Expected diameter of a tree

题目 给一片森林,\(q\) 个询问,每个询问两个点, 问将这两个点所在的集合连接起来组成的新集合,它的最远两点的距离的期望值是多少. 分析 首先将以每个点为根的最大深度求出来,然后对于两棵树, 只有 ...

- 全平台GPU通用AI视频补帧超分教程

全平台GPU通用AI视频补帧超分教程 本教程只发布于https://www.cnblogs.com/Icys 注意:本教程需要一定的命令行和视频编码知识,请谨慎食用. 软件准备 realcugan-n ...

- 动态库 DLL 封装二:dll封装方法

例:我新建的工程是,带lib的MFC规则的DLL 主要有三个文件需要写东西 ( .h / .cpp / .def ) 示例: // a.h ...... #ifdef __cplusplus e ...

- js推送网页到扩展屏上

需求: 电脑上有两个屏幕,想在主屏上的网页中点击一个按钮,副屏就可以显示需要推送过去的网页 实现方法: 本方法使用的是js来实现的,亲测可行,支持火狐,但是不支持谷歌 demo: 主屏网页:1.htm ...

- MogDB/openGauss中merge的语法解析

MogDB/openGauss 中 merge 的语法解析 近期了解学习了 MogDB/openGauss 中 merge 的使用,merge 语法是根据源表对目标表进行匹配查询,匹配成功时更新,不成 ...

- 什么是coredump

什么是 coredump 介绍 在 Linux 开发中,我们经常听到程序员说我的程序 core 掉了,通常出现这类的问题是低级 bug 中的内存访问越界.使用空指针.堆栈溢出等情况.使程序运行过程中异 ...

- .NET Aspire预览5版本 发布

2024年4月11日发布了.NET Aspire预览5版本,这个版本引入了对AWS的支持,并对Azure功能进行了改进.重点内容包括拆分Aspire.Hosting和Aspire.Hosting.Az ...

- 【郑州轻工业大学】HarmonyOS宠物健康系统的开发分享

原文:https://mp.weixin.qq.com/s/upcS6PcMS7UBR5jgoP7eow,点击链接查看更多技术内容. 本期我们给大家带来的是家庭宠物健康监测系统开发者杨光的分享,希望能 ...