hive 存储格式及压缩

-- 设置参数

set hivevar:target_db_name=db_dw;

use ${hivevar:target_db_name}; -- 创建textfile表

create table file_format_textfile

row format delimited fields terminated by '\001'

stored as textfile

as

select * from smple_table; -- 测试各种压缩的orc表

create table file_format_orc_zlib

row format delimited fields terminated by '\001'

stored as orc tblproperties ("orc.compress"="ZLIB")

as

select * from file_format_textfile

; create table file_format_orc_snappy

row format delimited fields terminated by '\001'

stored as orc tblproperties ("orc.compress"="SNAPPY")

as

select * from file_format_orc_zlib

; create table file_format_orc_none

row format delimited fields terminated by '\001'

stored as orc tblproperties ("orc.compress"="NONE")

as

select * from file_format_orc_zlib

; create table file_format_orc_default

row format delimited fields terminated by '\001'

stored as orc

as

select * from file_format_orc_zlib

; -- 测试各种压缩的parquet表

create table file_format_parquet_zlib

row format delimited fields terminated by '\001'

stored as parquet tblproperties ("parquet.compress"="ZLIB")

as

select * from file_format_orc_zlib

; create table file_format_parquet_snappy

row format delimited fields terminated by '\001'

stored as parquet tblproperties ("parquet.compress"="SNAPPY")

as

select * from file_format_orc_zlib

; create table file_format_parquet_none

row format delimited fields terminated by '\001'

stored as parquet tblproperties ("parquet.compress"="NONE")

as

select * from file_format_orc_zlib

; create table file_format_parquet_default

row format delimited fields terminated by '\001'

stored as parquet

as

select * from file_format_orc_zlib

; -- 测试各种压缩的rcfile表(可能参数没生效,各种压缩后大小一致)

create table file_format_rcfile_zlib

row format delimited fields terminated by '\001'

stored as rcfile tblproperties ("rcfile.compress"="ZLIB")

as

select * from file_format_orc_zlib

; create table file_format_rcfile_snappy

row format delimited fields terminated by '\001'

stored as rcfile tblproperties ("rcfile.compress"="SNAPPY")

as

select * from file_format_orc_zlib

; create table file_format_rcfile_none

row format delimited fields terminated by '\001'

stored as rcfile tblproperties ("rcfile.compress"="NONE")

as

select * from file_format_orc_zlib

; create table file_format_rcfile_default

row format delimited fields terminated by '\001'

stored as rcfile

as

select * from file_format_orc_zlib

;

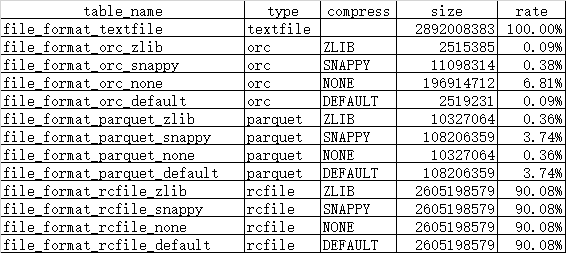

-- 查看各种压缩下的格式大小

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_textfile; dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_orc_zlib;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_orc_snappy;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_orc_none;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_orc_default; dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_parquet_zlib;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_parquet_snappy;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_parquet_none;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_parquet_default; dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_rcfile_zlib;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_rcfile_snappy;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_rcfile_none;

dfs -du -s /user/hive/warehouse/${hivevar:target_db_name}.db/file_format_rcfile_default;

-- 统计数据,原文件见文件中的附件

hive 存储格式及压缩的更多相关文章

- Hive存储格式之RCFile详解,RCFile的过去现在和未来

我在整理Hive的存储格式和压缩格式,本来打算一篇发出来,结果其中一小节就有很多内容,于是打算写成Hive存储格式和压缩格式系列. 本节主要讲一下Hive存储格式最早的典型的列式存储格式RCFile. ...

- Hive存储格式之ORC File详解,什么是ORC File

目录 概述 文件存储结构 Stripe Index Data Row Data Stripe Footer 两个补充名词 Row Group Stream File Footer 条纹信息 列统计 元 ...

- Hadoop、Hive【LZO压缩配置和使用】

目录 一.编译 二.相关配置 三.为LZO文件创建索引 四.Hive为LZO文件建立索引 1.hive创建的lzo压缩的分区表 2.给.lzo压缩文件建立索引index 3.读取Lzo文件的注意事项( ...

- Hive性能调优(一)----文件存储格式及压缩方式选择

合理使用文件存储格式 建表时,尽量使用 orc.parquet 这些列式存储格式,因为列式存储的表,每一列的数据在物理上是存储在一起的,Hive查询时会只遍历需要列数据,大大减少处理的数据量. 采用合 ...

- hive 存储格式对比

Apache Hive支持Apache Hadoop中使用的几种熟悉的文件格式,如TextFile,RCFile,SequenceFile,AVRO,ORC和Parquet格式. Cloudera I ...

- Hive(十一)【压缩、存储】

目录 一.Hadoop的压缩配置 1.MR支持的压缩编码 2.压缩参数配置 3.开启Mapper输出阶段压缩 4.开启Reduceer输出阶段 二.文件存储 1.列式存储和行式存储 2.TextFil ...

- hive 存储格式

hive有textFile,SequenceFile,RCFile三种文件格式. textfile为默认格式,建表时不指定默认为这个格式,导入数据时会直接把数据文件拷贝到hdfs上不进行处理. Seq ...

- hive表的存储格式; ORC格式的使用

hive表的源文件存储格式有几类: 1.TEXTFILE 默认格式,建表时不指定默认为这个格式,导入数据时会直接把数据文件拷贝到hdfs上不进行处理.源文件可以直接通过hadoop fs -cat 查 ...

- Hive文件存储格式和hive数据压缩

一.存储格式行存储和列存储 二.Hive文件存储格式 三.创建语句和压缩 一.存储格式行存储和列存储 行存储可以理解为一条记录存储一行,通过条件能够查询一整行数据. 列存储,以字段聚集存储,可以理解为 ...

随机推荐

- C++——const

参考:https://www.cnblogs.com/Forever-Kenlen-Ja/p/3776991.html ; //修饰变量,a不能该内容(更改为其他的值) int* const p = ...

- Ajax01 什么是ajax、获取ajax对象、ajax对象的属性和方法、编程步骤、缓存问题、乱码问题

目录 1 什么是ajax 2 获取ajax对象 3 ajax对象的属性和方法 4 使用ajax的编程步骤 5 缓存问题 6 乱码问题 1 什么是ajax ajax是一种用来改善用户体验的技术,其本质是 ...

- 算法Sedgewick第四版-第1章基础-020一按优先级计算表达式的值

/****************************************************************************** * Compilation: javac ...

- 8.View类

Basic Concepts 在Modle/View 结构中,View从Model中提取数据,并显示给用户.View显示数据的方式不一定与Model中数据排列方式相同,也可能与底层数据结构完 ...

- 数据结构_Summary

问题描述 可怜的 Bibi 丢了好几台手机以后,看谁都像是小偷,他已经在小本本上记下了他认为的各个地点的小偷数量.现在我们将 Bibi 的家附近的地形抽象成一棵有根树. 每个地点都是树上的一个节点,节 ...

- 多线程学习-基础(一)Thread和Runnable实现多线程

很久没记录一些技术学习过程了,这周周五的时候偶尔打开“博客园”,忽然让我产生一种重拾记录学习过程的想法,记录下学习研究过程的一点一滴,我相信,慢慢地就进步了!最近想学习一下多线程高并发,但是多线程在实 ...

- 算法导论 寻找第i小元素 9.2

PS1:如果单纯为做出这道题那么这个代价是O(nlgn),通过排序就可以了. 这里讨论的是O(n)的算法.那么来分析一下这个算法是如何做到O(n)的,算了不分析了,这个推到看起来太麻烦了.其实我想知道 ...

- Kinect插件使用

Kinect Scripts文件夹下所有managers(管理器)的用途: 这些在KinectScripts文件夹下的管理器都是组件,你可以根据你想实现的功能在项目中使用它. KinectManage ...

- P1579 哥德巴赫猜想(升级版)

程序是人类的财富!!11 ------------------------------------------- 题目链接:MIKU OK,Let's gi; -------------------- ...

- [SinGuLaRiTy] 2017 百度之星程序设计大赛-资格赛

[SinGuLaRiTy-1034] Copyright (c) SinGuLaRiTy 2017. All Rights Reserved. 度度熊保护村庄 Time Limit: 2000/10 ...