spark配置文件和执行部分代码

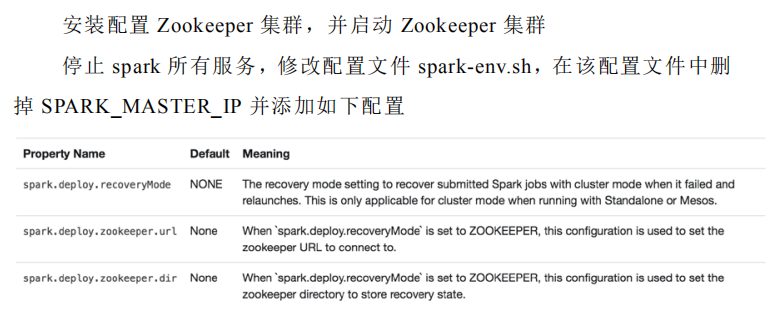

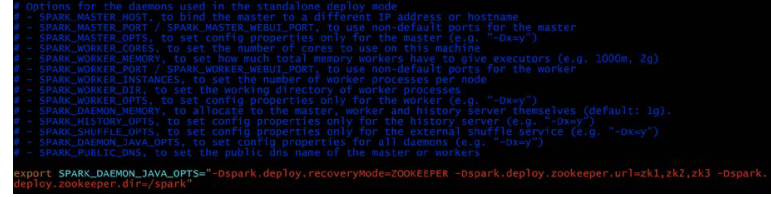

export SPARK_DAEMON_JAVA_OPTS="

-Dspark.deploy.recoveryMode=ZOOKEEPER

-Dspark.deploy.zookeeper.url=zk1,zk2,zk3

-Dspark.deploy.zookeeper.dir=/spark"

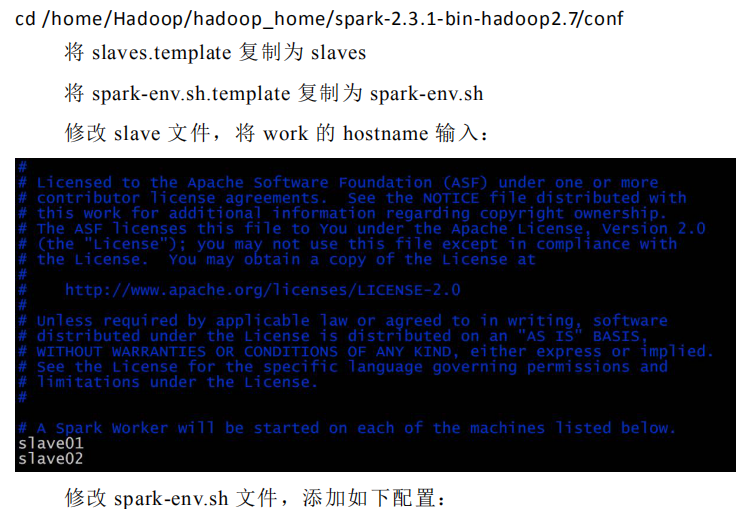

1.在 master01 节点上修改 slaves 配置文件内容指定 worker 节点

2.将配置文件同步到所有节点。

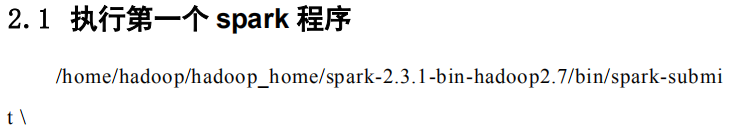

3.在 master01 上执行 sbin/start-all.sh 脚本,启动集群并启动第一个

master 节点,然后在 master02 上执行 sbin/start-master.sh 启动第二个 master

节点。

4.程序中 spark 集群的访问地址需要改成:

spark://master01:port1,master02:port2

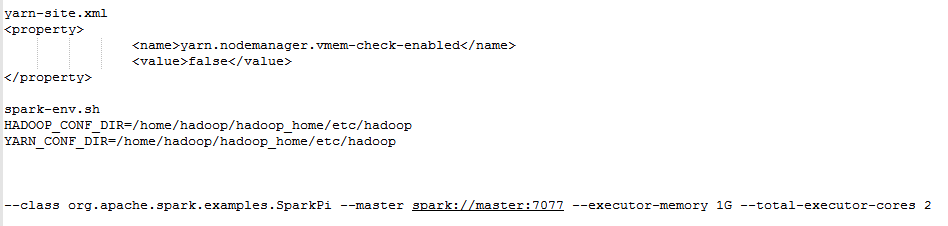

若想在集群上和yarn上运行,添加如下配置

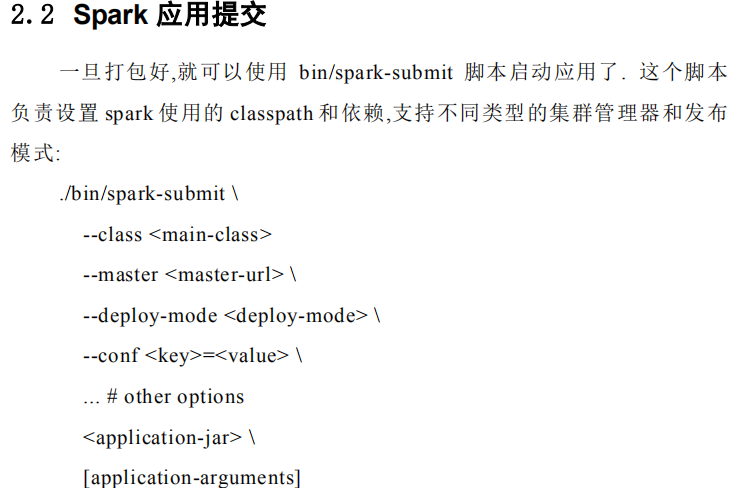

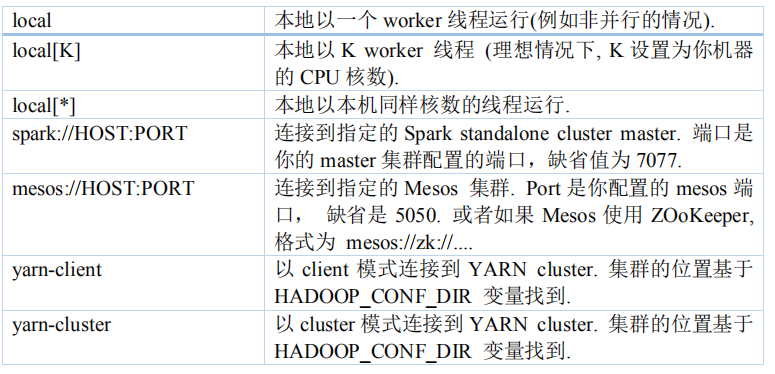

standalone client运行

spark-submit --master spark://master:7077 --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

standalone cluster运行

spark-submit --master spark://master:7077 --deploy-mode cluster --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

yarn client运行

spark-submit --master yarn --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

或者

spark-submit --master yarn --deploy-mode client --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

或者

spark-submit --master yarn-client --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

yarn cluster运行

spark-submit --master yarn-client --deploy-mode cluster --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

或者

spark-submit --master yarn-cluster --class org.apache.spark.examples.SparkPi /home/hadoop/hadoop_home/spark/examples/jars/spark-examples_2.11-2.3.1.jar 100

8080 是 Spark WEBUI 界面的端口,7077 是 Spark 任务提交的端口。

修改 master 的 WEBUI 端口:

修改 start-master.sh 即可。

spark配置文件和执行部分代码的更多相关文章

- 从源码剖析一个Spark WordCount Job执行的全过程

原文地址:http://mzorro.me/post/55c85d06e40daa9d022f3cbd WordCount可以说是分布式数据处理框架的”Hello World”,我们可以以它为 ...

- Spark性能调优之代码方面的优化

Spark性能调优之代码方面的优化 1.避免创建重复的RDD 对性能没有问题,但会造成代码混乱 2.尽可能复用同一个RDD,减少产生RDD的个数 3.对多次使用的RDD进行持久化(ca ...

- 【原创】大数据基础之Spark(3)Spark Thrift实现原理及代码实现

spark 2.1.1 一 启动命令 启动spark thrift命令 $SPARK_HOME/sbin/start-thriftserver.sh 然后会执行 org.apache.spark.de ...

- 大话Spark(3)-一图深入理解WordCount程序在Spark中的执行过程

本文以WordCount为例, 画图说明spark程序的执行过程 WordCount就是统计一段数据中每个单词出现的次数, 例如hello spark hello you 这段文本中hello出现2次 ...

- Spark源码执行逻辑分析【基于案例SparkPi】

一.案例SparkPi代码 package scala import org.apache.spark.sql.SparkSession import scala.math.random /** Co ...

- 大数据学习day34---spark14------1 redis的事务(pipeline)测试 ,2. 利用redis的pipeline实现数据统计的exactlyonce ,3 SparkStreaming中数据写入Hbase实现ExactlyOnce, 4.Spark StandAlone的执行模式,5 spark on yarn

1 redis的事务(pipeline)测试 Redis本身对数据进行操作,单条命令是原子性的,但事务不保证原子性,且没有回滚.事务中任何命令执行失败,其余的命令仍会被执行,将Redis的多个操作放到 ...

- Spring练习,使用Properties类型注入方式,注入MySQL数据库连接的基本信息,然后使用JDBC方式连接数据库,模拟执行业务代码后释放资源,最后在控制台输出打印结果。

相关 知识 >>> 相关 练习 >>> 实现要求: 使用Properties类型注入方式,注入MySQL数据库连接的基本信息,然后使用JDBC方式连接数据库,模拟执 ...

- Spark SQL底层执行流程详解

本文目录 一.Apache Spark 二.Spark SQL发展历程 三.Spark SQL底层执行原理 四.Catalyst 的两大优化 一.Apache Spark Apache Spark是用 ...

- Lua 学习笔记(七)编译、执行外部代码块

Lua称为解释型语言的原因:Lua允许在运行源代码之前,先将源代码预编译为一种中间形式.区别解释型语言的主要特征是在于编译器是否是语言运行时库的一部分,即有能力执行动态生成的代码.因为Lua中有dof ...

随机推荐

- Django Admin定制

Django内置的Admin是对于model中对应的数据表进行增删改查提供的组件,使用方式有: 依赖APP: django.contrib.auth django.contrib.contenttyp ...

- 黄聪:360浏览器、chrome开发扩展插件教程(2)为html添加行为

转载:http://www.cnblogs.com/walkingp/archive/2011/04/02/2002668.html 上一节我们已经讲了Chrome扩展的基础知识,并构建了基础的htm ...

- bzoj2783 树

第一行是两个整数N和S,其中N是树的节点数. 第二行是N个正整数,第i个整数表示节点i的正整数. 接下来的N-1行每行是2个整数x和y,表示y是x的儿子. 输出格式: 输出路径节点总和为S的路径数量. ...

- springboot 整合 elasticsearch

1引入jar包 <!--elasticsearch--> <dependency> <groupId>org.springframework.boot</gr ...

- [转]Spring 之 Log4j 的配置

- [C#]读文件

代码段来自 支付宝接口代码示例 /// <summary> /// 从文件读取公钥转公钥字符串 /// </summary> /// <param name=" ...

- EqualsBuilder 类的使用

apache的commons-lang包提供了一个EqualsBuilder类,提供了基本属性.数组.对象等比较操作的封装,可以辅助实现对象的equals(Object)方法. 这个类的使用比较简单, ...

- java8时间使用小结

//LocalDate代表一个IOS格式(yyyy-MM-dd)的日期 获取当前的日期: LocalDate localDate = LocalDate.now();//LocalDate: 表示没有 ...

- [代码]set容器查找操作使用

对于set容器来说,查找功能是该容器的主要优势,故针对该容器查找功能作一测试. 主要有如下API接口: 测试源码如下: #include<set> void test(){ set< ...

- Git----远程仓库之添加远程库02

现在的情景是,你已经在本地创建了一个Git仓库后,又想在GitHub上创建一个Git库,并且让这两个仓库进行远程同步,这样,GitHub上的仓库既可以作为备份,又可以让其他人通过该仓库来协作,真是一举 ...