elasticsearch使用ik中文分词器

elasticsearch使用ik中文分词器

一、背景

es自带了一堆的分词器,比如standard、whitespace、language(比如english)等分词器,但是都对中文分词的效果不太好,此处安装第三方分词器ik,来实现分词。

二、安装 ik 分词器

1、从 github 上找到和本次 es 版本匹配上的 分词器

# 下载地址

https://github.com/medcl/elasticsearch-analysis-ik/releases

2、使用 es 自带的插件管理 elasticsearch-plugin 来进行安装

- 直接从网络地址安装

cd /Users/huan/soft/elastic-stack/es/es02/bin

# 下载插件

./elasticsearch-plugin -v install https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.12.0/elasticsearch-analysis-ik-7.12.0.zip

# 查看插件是否下载成功

./elasticsearch-plugin list

- 从本地安装

cd /Users/huan/soft/elastic-stack/es/es02/bin

# 下载插件(file后面跟的是插件在本地的地址)

./elasticsearch-plugin install file:///path/to/plugin.zip

注意:

如果本地插件的路径中存在空格,需要使用双引号包装起来。

3、重启es

# 查找es进程

jps -l | grep 'Elasticsearch'

# 杀掉es进程

kill pid

# 启动es

/Users/huan/soft/elastic-stack/es/es01/bin/elasticsearch -d -p pid01

三、测试 ik 分词

ik分词器提供了2种分词的模式

ik_max_word: 将需要分词的文本做最小粒度的拆分,尽量分更多的词。ik_smart: 将需要分词的文本做最大粒度的拆分。

1、测试默认的分词效果

语句

GET _analyze

{

"analyzer": "default",

"text": ["中文分词语"]

}

结果

{

"tokens" : [

{

"token" : "中",

"start_offset" : 0,

"end_offset" : 1,

"type" : "<IDEOGRAPHIC>",

"position" : 0

},

{

"token" : "文",

"start_offset" : 1,

"end_offset" : 2,

"type" : "<IDEOGRAPHIC>",

"position" : 1

},

{

"token" : "分",

"start_offset" : 2,

"end_offset" : 3,

"type" : "<IDEOGRAPHIC>",

"position" : 2

},

{

"token" : "词",

"start_offset" : 3,

"end_offset" : 4,

"type" : "<IDEOGRAPHIC>",

"position" : 3

},

{

"token" : "语",

"start_offset" : 4,

"end_offset" : 5,

"type" : "<IDEOGRAPHIC>",

"position" : 4

}

]

}

可以看到默认的分词器,对中文的分词完全无法达到我们中文的分词的效果。

2、测试 ik_max_word 的分词效果

语句

GET _analyze

{

"analyzer": "ik_max_word",

"text": ["中文分词语"]

}

结果

{

"tokens" : [

{

"token" : "中文",

"start_offset" : 0,

"end_offset" : 2,

"type" : "CN_WORD",

"position" : 0

},

{

"token" : "分词",

"start_offset" : 2,

"end_offset" : 4,

"type" : "CN_WORD",

"position" : 1

},

{

"token" : "词语",

"start_offset" : 3,

"end_offset" : 5,

"type" : "CN_WORD",

"position" : 2

}

]

}

可以看到基于ik分词可以达到我们需要的分词效果。

3、测试 ik_smart 的分词效果

语句

GET _analyze

{

"analyzer": "ik_smart",

"text": ["中文分词语"]

}

结果

{

"tokens" : [

{

"token" : "中文",

"start_offset" : 0,

"end_offset" : 2,

"type" : "CN_WORD",

"position" : 0

},

{

"token" : "分",

"start_offset" : 2,

"end_offset" : 3,

"type" : "CN_CHAR",

"position" : 1

},

{

"token" : "词语",

"start_offset" : 3,

"end_offset" : 5,

"type" : "CN_WORD",

"position" : 2

}

]

}

4、自定义 ik 的启用词和停用词

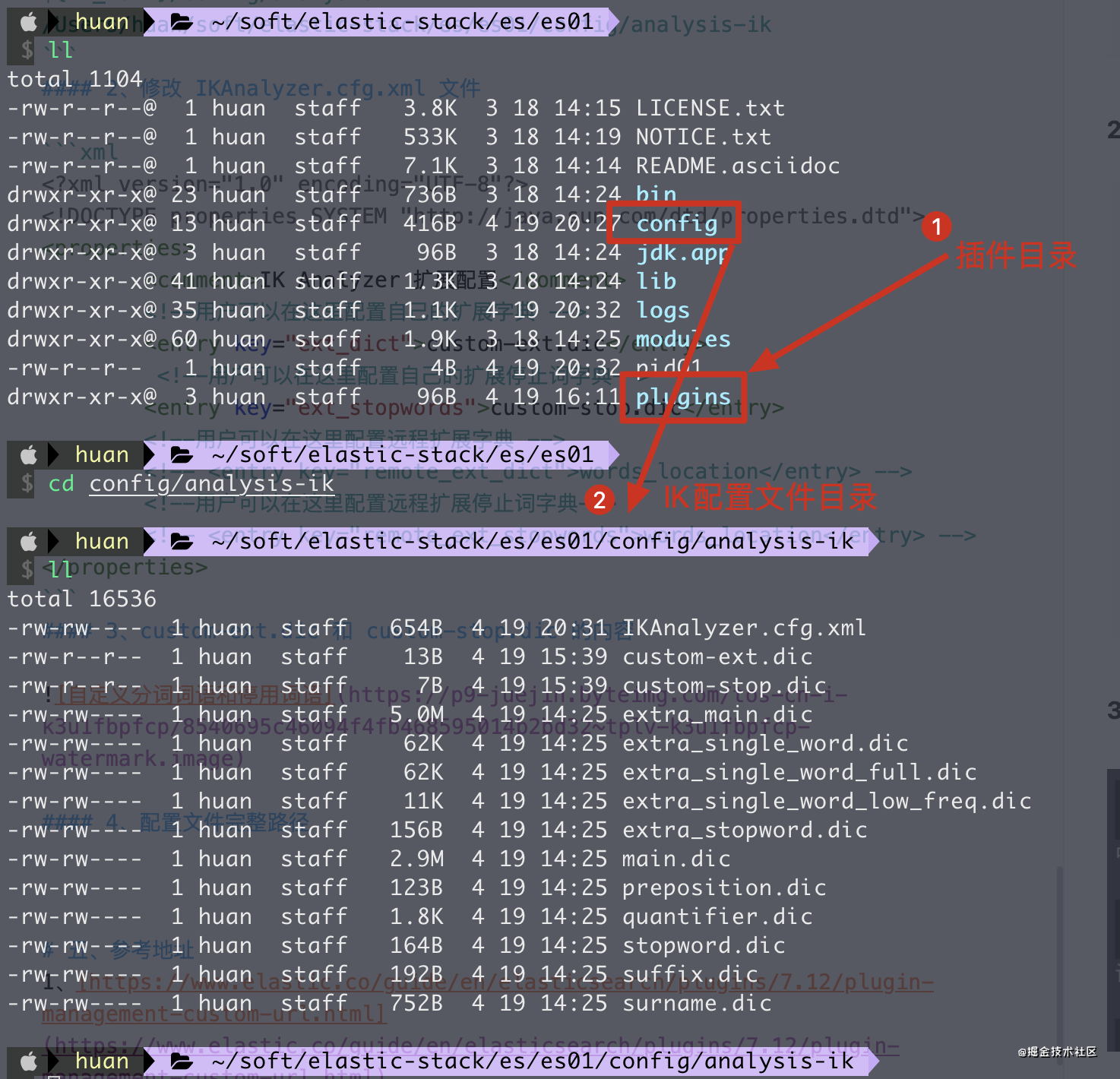

1、找到 ik 的配置目录

${IK_HOME}/config/analysis-ik

/Users/huan/soft/elastic-stack/es/es01/config/analysis-ik

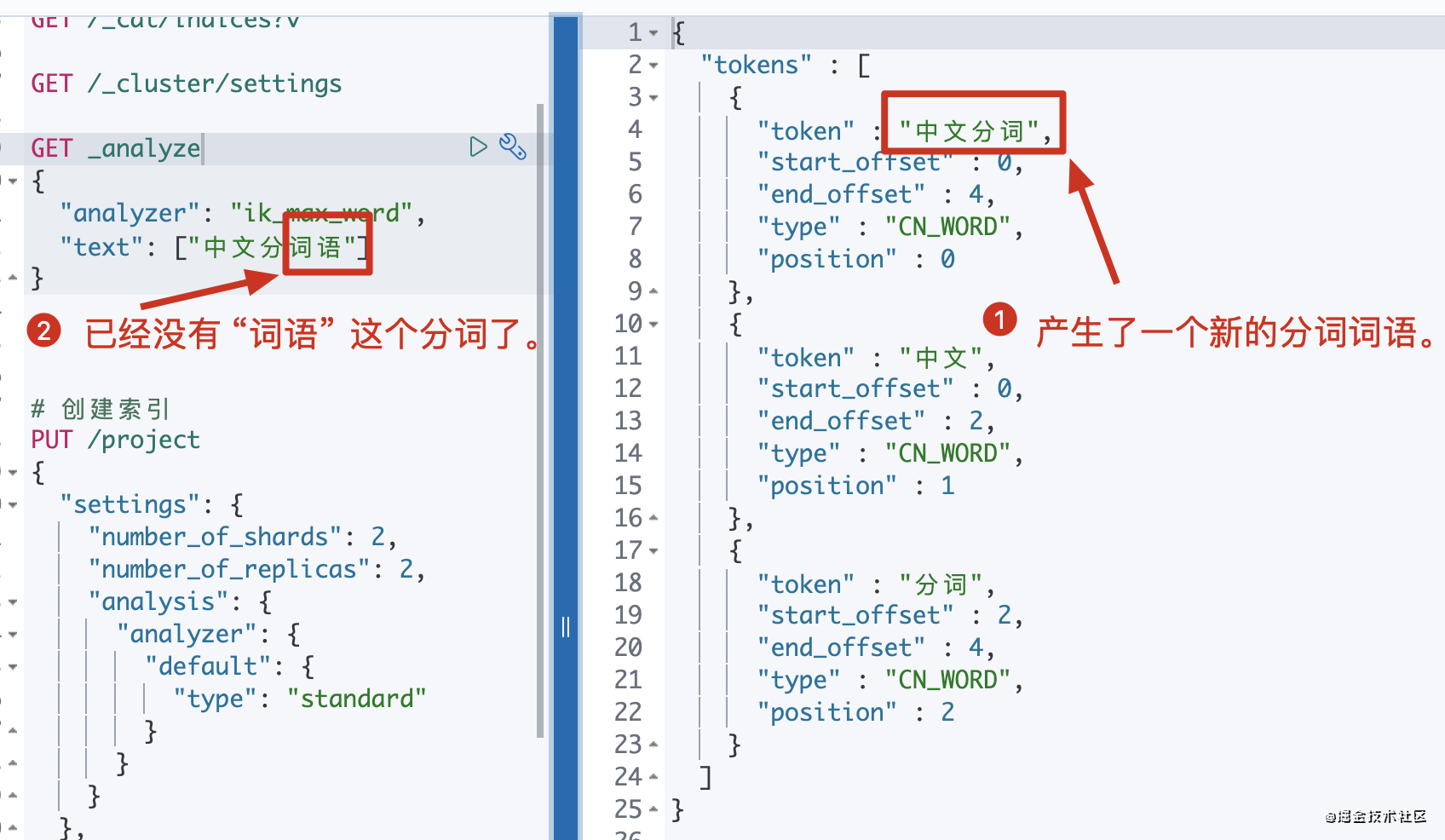

2、修改 IKAnalyzer.cfg.xml 文件

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典 -->

<entry key="ext_dict">custom-ext.dic</entry>

<!--用户可以在这里配置自己的扩展停止词字典-->

<entry key="ext_stopwords">custom-stop.dic</entry>

<!--用户可以在这里配置远程扩展字典 -->

<!-- <entry key="remote_ext_dict">words_location</entry> -->

<!--用户可以在这里配置远程扩展停止词字典-->

<!-- <entry key="remote_ext_stopwords">words_location</entry> -->

</properties>

3、custom-ext.dic 和 custom-stop.dic 的内容

注意:

1、自定义分词的文件必须是UTF-8的编码。

4、配置文件完整路径

5、查看分词结果

5、热更新IK分词

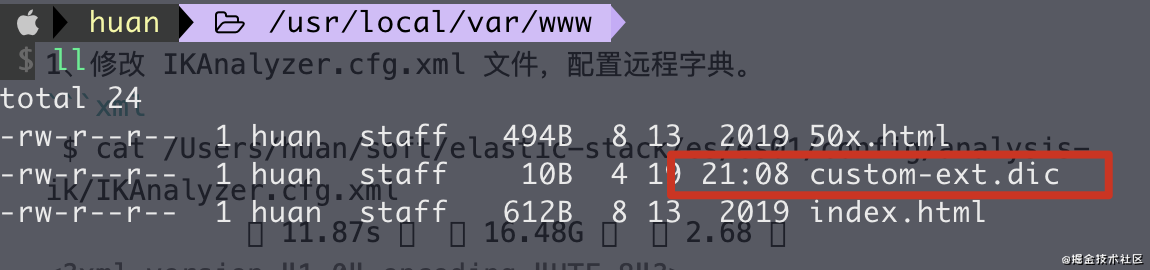

1、修改 IKAnalyzer.cfg.xml 文件,配置远程字典。

$ cat /Users/huan/soft/elastic-stack/es/es01/config/analysis-ik/IKAnalyzer.cfg.xml 11.87s 16.48G 2.68

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置远程扩展字典 -->

<entry key="remote_ext_dict">http://localhost:8686/custom-ext.dic</entry>

<!--用户可以在这里配置远程扩展停止词字典-->

<entry key="remote_ext_stopwords"></entry>

</properties>

注意:

1、此处的 custom-ext.dic 文件在下方将会配置到 nginx中,保证可以访问。

2、http 请求需要返回两个头部(header),一个是 Last-Modified,一个是 ETag,这两者都是字符串类型,只要有一个发生变化,该插件就会去抓取新的分词进而更新词库。

3、http 请求返回的内容格式是一行一个分词,换行符用 \n 即可。

4、在 nginx 的目录下放置一个 custom-ext.dic 文件

多次修改 custom-ext.dic 文件,可以看到分词的结果也会实时变化,如此就实现了分词的热更新。

五、参考地址

1、https://www.elastic.co/guide/en/elasticsearch/plugins/7.12/plugin-management-custom-url.html

2、https://github.com/medcl/elasticsearch-analysis-ik/releases

3、https://github.com/medcl/elasticsearch-analysis-ik

elasticsearch使用ik中文分词器的更多相关文章

- Elasticsearch:IK中文分词器

Elasticsearch内置的分词器对中文不友好,只会一个字一个字的分,无法形成词语,比如: POST /_analyze { "text": "我爱北京天安门&quo ...

- elasticsearch ik中文分词器安装

特殊说明:灰色文字用来辅助理解的. 安装IK中文分词器 我在百度上搜索了下,大多介绍的都是用maven打包下载下来的源码,这种方法也行,但是不够方便,为什么这么说? 首先需要安装maven吧?其次需要 ...

- ElasticSearch速学 - IK中文分词器远程字典设置

前面已经对”IK中文分词器“有了简单的了解: 但是可以发现不是对所有的词都能很好的区分,比如: 逼格这个词就没有分出来. 词库 实际上IK分词器也是根据一些词库来进行分词的,我们可以丰富这个词库. ...

- 搜索引擎ElasticSearch系列(五): ElasticSearch2.4.4 IK中文分词器插件安装

一:IK分词器简介 IK Analyzer是一个开源的,基于java语言开发的轻量级的中文分词工具包.从2006年12月推出1.0版开始, IKAnalyzer已经推出了4个大版本.最初,它是以开源 ...

- Kafka:ZK+Kafka+Spark Streaming集群环境搭建(十九)ES6.2.2 安装Ik中文分词器

注: elasticsearch 版本6.2.2 1)集群模式,则每个节点都需要安装ik分词,安装插件完毕后需要重启服务,创建mapping前如果有机器未安装分词,则可能该索引可能为RED,需要删除后 ...

- ES-Mac OS环境搭建-ik中文分词器

下载 从github下载ik中文分词器,点击地址,需要注意的是,ik分词器和elasticsearch版本必须一致. 安装 下载到本地并解压到elasticsearch中的plugins目录内即可. ...

- 30.IK中文分词器的安装和简单使用

在之前我们学的都是英文,用的也是英文的standard分词器.从这一节开始,学习中文分词器.中国人基本上都是中文应用,很少是英文的,而standard分词器是没有办法对中文进行合理分词的,只是将每个中 ...

- Solr学习笔记之2、集成IK中文分词器

Solr学习笔记之2.集成IK中文分词器 一.下载IK中文分词器 IK中文分词器 此文IK版本:IK Analyer 2012-FF hotfix 1 完整分发包 二.在Solr中集成IK中文分词器 ...

- 真分布式SolrCloud+Zookeeper+tomcat搭建、索引Mysql数据库、IK中文分词器配置以及web项目中solr的应用(1)

版权声明:本文为博主原创文章,转载请注明本文地址.http://www.cnblogs.com/o0Iris0o/p/5813856.html 内容介绍: 真分布式SolrCloud+Zookeepe ...

随机推荐

- Identity用户管理入门七(扩展用户字段)

在实际使用时会发现很多字段在IdentityUser中并不存在,比如增加生日,地址等字段,可在模型类中实现自己的模型并继承自IdentityUser,需要修改的代码为以下类 一.新增模型 using ...

- python库--pandas--写入文本文件

pandas.DataFrame.to_csv 参数 说明 path_or_buf=None 文件路径或对象, 若果为None, 则结果作为字符串返回 sep=',' 分隔符 na_rep='' 缺失 ...

- vue中如何深度监听一个对象?

大家都知道,Vue项目中对数据的监听,提供了一个很好的钩子watch,watch可以极其方便的监听我们常用数据类型值的变化,但通常当我们想监听一个对象中,某个属性值的变化时,很难达到我们预期的效果.那 ...

- [推荐]MyBatis 核心技术与面试 34 讲

MyBatis 核心技术与面试 34 讲 职业生涯中常被问到: 如何成为某方面的高手? 如何快速搞定某项技术? 我现在的水平处于什么阶段? -- 我暗暗想,我们从小学到中学到大学,经历了大考三六九.小 ...

- BZOJ_1008 越狱(快速幂)

http://www.lydsy.com/JudgeOnline/problem.php?id=1008 Description 监狱有连续编号为1...N的N个房间,每个房间关押一个犯人,有M种宗教 ...

- scrum项目冲刺_day07总结

摘要:今日完成任务. 1.短信服务正在进行 2.路线规划正在进行 总任务: 一.appUI页面(已完成) 二.首页功能: 1.图像识别功能(已完成) 2.语音识别功能(已完成) 3.垃圾搜索功能 4. ...

- 【Linux】LNMP1.6 环境报500错误解决方法

vi /usr/local/nginx/conf/fastcgi.conf 进入编辑fastcgi.conf 找到 fastcgi_param PHP_VALUE "open_base ...

- 网络协议之:WebSocket的消息格式

目录 简介 WebSocket的握手流程 webSocket的消息格式 Extensions和Subprotocols 总结 简介 我们知道WebSocket是建立在TCP协议基础上的一种网络协议,用 ...

- 华为云计算IE面试笔记-FusionSphere Openstack有哪些关键组件,各组件主要功能是什么?三种存储接入组件的差异有哪些?

1. Nova:在OpenStack环境中提供计算服务,负责计算实例(VM,云主机)生命周期的管理,包括生成.调度和回收.Nova不负责计算实例的告警上报(FC管). 2. Cinder:为计算实例提 ...

- javascript Date 日期格式化 formatDate, require.js 模块 支持全局js引入 / amd方式加载

* 引入AMD加载方式: require.js CDN https://cdn.bootcss.com/require.js/2.3.5/require.js * 创建模块文件./js/util/d ...