kdc 互信

环境:

29.3.203.53(sysops00065017) 部署KDC Namnode Datanode,KDC负责TESTA.COM域的认证

29.3.203.54(sysops00065018) 部署KDC Namnode Datanode,KDC负责TESTB.COM域的认证

确保两台机器能互相使用主机名ping通

一、

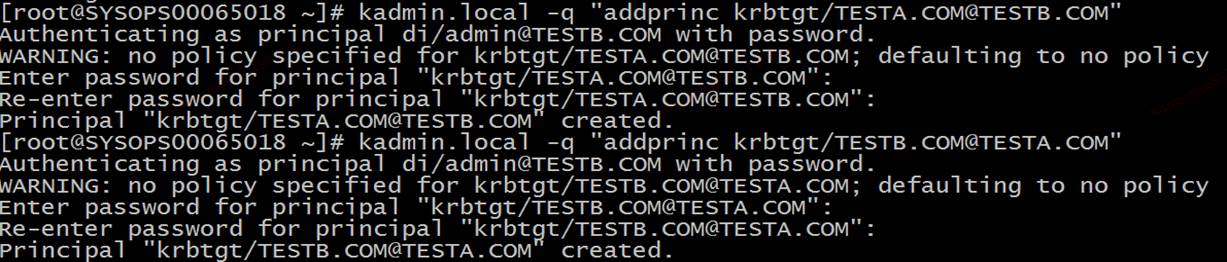

两台kdc都添加krbtgt/TESTA.COM@TESTB.COM和krbtgt/TESTB.COM@TESTA.COM

如果在TESTA.COM访问TESTB.COM上的服务,需要krbtgt/TESTB.COM@TESTA.COM

二、修改krb5.conf(红色为需要修改的地方)

TESTA.COM 29.3.203.53(sysops00065017)

[realms]

TESTA.COM = {

kdc = sysops00065017

admin_server = sysops00065017

master_kdc = sysops00065017

default_domain = .TESTA.COM

}

TESTB.COM = {

kdc = sysops00065018

admin_server = sysops00065018

master_kdc = sysops00065018

default_domain = .TESTB.COM

}

[domain_realm]

.testa.com = TESTA.COM

testa.com = TESTA.COM

.testb.com = TESTB.COM

testb.com = TESTB.COM

sysops00065017 = TESTA.COM

sysops00065018 = TESTB.COM

[capaths]

TESTA.COM = {

TESTB.COM = .

}

TESTB.COM 29.3.203.54(sysops00065018)

[realms]

TESTA.COM = {

kdc = sysops00065017

admin_server = sysops00065017

master_kdc = sysops00065017

default_domain = .TESTA.COM

}

TESTB.COM = {

kdc = sysops00065018

admin_server = sysops00065018

master_kdc = sysops00065018

default_domain = .TESTB.COM

}

[domain_realm]

.testb.com = TESTB.COM

testb.com = TESTB.COM

.testa.com = TESTA.COM

testa.com = TESTA.COM

sysops00065017 = TESTA.COM

sysops00065018 = TESTB.COM

[capaths]

TESTB.COM = {

TESTA.COM = .

}

三、修改core-site.xml(两个域都要配置)

<property>

<name>hadoop.security.auth_to_local</name>

<value>

RULE:[1:$1@$0](^.*@TESTA\.COM$)s/^(.*)@TESTA\.COM$/$1/g

RULE:[2:$1@$0](^.*@TESTA\.COM$)s/^(.*)@TESTA\.COM$/$1/g

RULE:[1:$1@$0](^.*@TESTB\.COM$)s/^(.*)@TESTB\.COM$/$1/g

RULE:[2:$1@$0](^.*@TESTB\.COM$)s/^(.*)@TESTB\.COM$/$1/g

DEFAULT

</value>

</property>

四、修改hdfs-site.xml(两个域都要配置)

<property>

<name>dfs.namenode.kerberos.principal.pattern</name>

<value>*</value>

</property>

五、 重启Namdnode\KDC服务

六、 测试

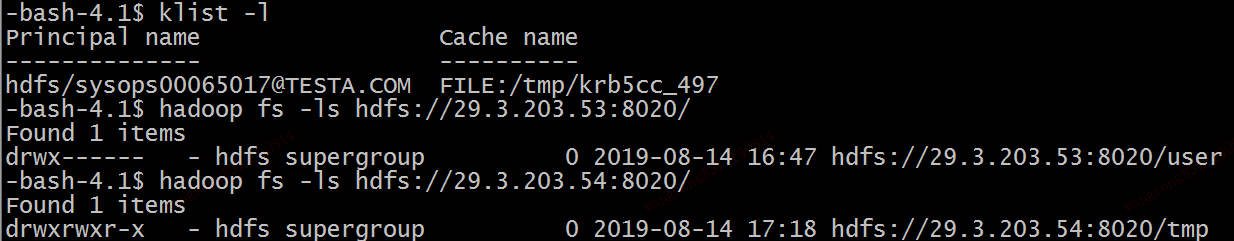

TESTA上使用hdfs/sysops00065017@TESTA.COM访问两个集群的文件:

其中TESTA的KDC日志显示

Aug 15 15:49:51 SYSOPS00065017 krb5kdc[9868](info): TGS_REQ (2 etypes {16 23}) 29.3.203.53: ISSUE: authtime 1565855227, etypes {rep=16 tkt=16 ses=16}, hdfs/sysops00065017@TESTA.COM for krbtgt/TESTB.COM@TESTA.COM

TESTB的KDC日志显示

Aug 15 15:49:50 SYSOPS00065018 krb5kdc[26655](info): TGS_REQ (2 etypes {16 23}) 29.3.203.53: ISSUE: authtime 1565855227, etypes {rep=16 tkt=16 ses=16}, hdfs/sysops00065017@TESTA.COM for hdfs/sysops00065018@TESTB.COM

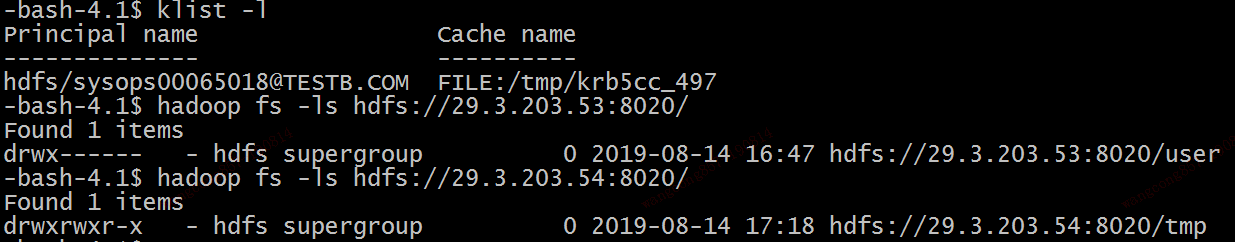

TESTB上使用hdfs/sysops00065018@TESTB.COM访问两个集群的文件:

其中TESTA的KDC日志显示

Aug 15 15:51:02 SYSOPS00065017 krb5kdc[9868](info): TGS_REQ (2 etypes {16 23}) 29.3.203.54: ISSUE: authtime 1565774273, etypes {rep=16 tkt=16 ses=16}, hdfs/sysops00065018@TESTB.COM for hdfs/sysops00065017@TESTA.COM

TESTB的KDC日志显示

Aug 15 15:51:01 SYSOPS00065018 krb5kdc[26655](info): TGS_REQ (2 etypes {16 23}) 29.3.203.54: ISSUE: authtime 1565774273, etypes {rep=16 tkt=16 ses=16}, hdfs/sysops00065018@TESTB.COM for krbtgt/TESTA.COM@TESTB.COM

kdc 互信的更多相关文章

- 配置两个Hadoop集群Kerberos认证跨域互信

两个Hadoop集群开启Kerberos验证后,集群间不能够相互访问,需要实现Kerberos之间的互信,使用Hadoop集群A的客户端访问Hadoop集群B的服务(实质上是使用Kerberos Re ...

- 配置两个不同kerberos认证中心的集群间的互信

两个Hadoop集群开启Kerberos验证后,集群间不能够相互访问,需要实现Kerberos之间的互信,使用Hadoop集群A的客户端访问Hadoop集群B的服务(实质上是使用Kerberos Re ...

- KDC添加加密

零售KDC管理的域为TESTA.COM 华为集群管理的域为hadoop.com (目前测试了hdfs cli,下午在UAT集群测试下distcp) 一. 零售KDC升级支持AES ...

- 记录一则Linux SSH的互信配置过程

需求:四台Linux主机,IP地址为192.168.10.10/11/12/13,配置登录用户的互信 1.各节点ssh-keygen生成RSA密钥和公钥 ssh-keygen -q -t rsa -N ...

- Linux快速配置集群ssh互信

之前在<记录一则Linux SSH的互信配置过程>.<Vertica 7.1安装最佳实践(RHEL6.4)>中,都分别提到了配置ssh互信的方法,本文在此基础上进一步整理配置s ...

- linux 互信不生效

版权声明:本文为博主原创文章,未经博主允许不得转载. 1. 操作系统版本 1)操作系统 cat /etc/issue cat /etc/issue CentOS release 6.6 (Final ...

- Linux多节点互信配置

SSH互信设置步骤: 1. 每个节点上分别生成自己的公钥和私钥 2. 将各节点的公钥文件汇总到一个总的认证文件authorized_keys中 3. 将这个包含了所有节点公钥的认证文件au ...

- linux配置ssh互信

公钥认证的基本思想: 对信息的加密和解密采用不同的key,这对key分别称作private key和public key,其中,public key存放在欲登录的服务器上,而private key为特 ...

- Linux 虚拟机和物理机配互信出现无法连接

配置文件位置:[root@hank-yoon data]# vi /etc/ssh/sshd_configPermitRootLogin yes 在物理机中,装完系统,默认情况下PermitRootL ...

随机推荐

- linux下mysql数据导入到redis

自Redis 2.6以上版本起,Redis支持快速大批量导入数据,即Pipe传输.通过将要导入的命令转换为Resp格式,然后通过MySQL的concat()来整理出最终导入的命令集合,以达到快速导入的 ...

- Spring ——获取IOC容器时,构造方法、set方法、类方法执行顺序

1,首先,我们在ApplicationContext.xml中会写下下面类的标示: <bean id="helloword" class="com.xt.frist ...

- [转载]Linux缓存机制

[转载]Linux缓存机制 来源:https://blog.csdn.net/weixin_38278334/article/details/96478405 linux下的缓存机制及清理buffer ...

- Springboot整合MybatisPlus

目录 1.pom文件 2.创建CodeGenerator.java 3.在application.yml中配置mybatis-plus 4.创建MybatisPlusConfig.java文件 其他 ...

- Google自动打印

浏览器打印功能,有很多小伙伴可能不太清楚,这里我们可以学习一下. 情景:开发一个需要打印小票的项目.(在订单页里,给客户添加一个打印的操作) 1.假设打印机已经连接好了 2.我们这一节用的浏览器是Go ...

- iTop4412开发板+虚拟机+tftp服务

感觉好坑啊 利用路由器+2根网线+tftp服务 首先是开发板,主机,虚拟机相互之间能ping通(坑), 关闭主机防火墙,防止被强 关闭虚拟机防火墙 虚拟机装上tftpd服务端(通过网上教程嘛) 是不是 ...

- scp上传文件到远程服务器

scp -P 22 E:/download/2028792_www.yeves.cn_nginx/cloud.pem root@ip:/usr/local/src

- 第二章、drf框架 - 请求模块 | 渲染模块 解析模块 | 异常模块 | 响应模块 (详细版)

目录 drf框架 - 请求模块 | 渲染模块 解析模块 | 异常模块 | 响应模块 Postman接口工具 drf框架 注册rest_framework drf框架风格 drf请求生命周期 请求模块 ...

- Spark集群任务提交流程----2.1.0源码解析

Spark的应用程序是通过spark-submit提交到Spark集群上运行的,那么spark-submit到底提交了什么,集群是怎样调度运行的,下面一一详解. 0. spark-submit提交任务 ...

- 设计模式之Template Method

1.设计模式的使用场景 模板方法模式(Template Method) 解释一下模板方法模式,就是指:一个抽象类中,有一个主方法,再定义1…n个方法,可以是抽象的,也可以是实际的方法,定义一个类,继承 ...