tensorflow学习笔记(3)前置数学知识

tensorflow学习笔记(3)前置数学知识

首先是神经元的模型

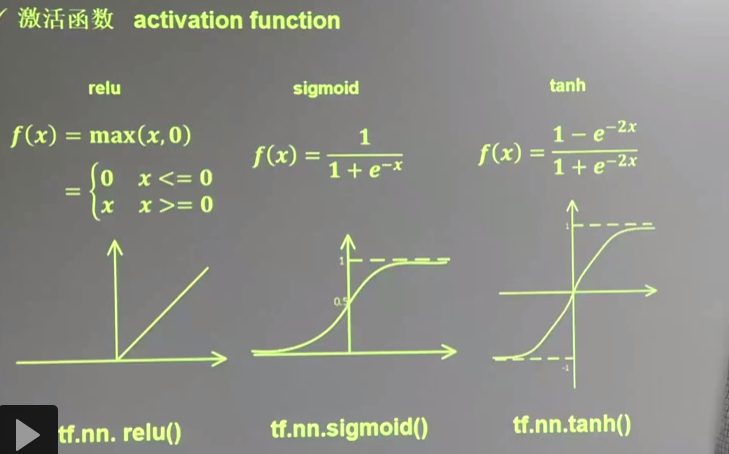

接下来是激励函数

神经网络的复杂度计算

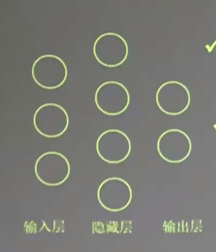

层数:隐藏层+输出层

总参数=总的w+b

下图为2层

如下图

w为3*4+4个 b为4*2+2

接下来是损失函数

主流的有均分误差,交叉熵,以及自定义

这里贴上课程里面的代码

# -*- coding: utf-8 -*-

"""

Created on Sat May 26 18:42:08 2018 @author: Administrator

""" import tensorflow as tf

import numpy as np

BATCH_SIZE=8

seed=23455 #基于seed产生随机数

rdm=np.random.RandomState(seed)

#初始化特征值为32个样本*2个特征值

#初始化标签

X=rdm.rand(32,2)

Y_=[[x1+x2+(rdm.rand()/10.0-0.05)] for (x1,x2) in X] #定义输入,参数和输出和传播过程

x=tf.placeholder(tf.float32,shape=(None,2))

y_=tf.placeholder(tf.float32,shape=(None,1))

w1=tf.Variable(tf.random_normal([2,1],stddev=1,seed=1))

y=tf.matmul(x,w1) #定义损失函数以及反向传播方法

loss_mse=tf.reduce_mean(tf.square(y_-y))

train_step=tf.train.GradientDescentOptimizer(0.01).minimize(loss_mse) #会话训练

with tf.Session() as sess:

init_op=tf.global_variables_initializer()

sess.run(init_op)

STEPS=20000

for i in range(STEPS):

start=(i*BATCH_SIZE)%32

end=(i*BATCH_SIZE)%32+BATCH_SIZE

#每次训练抽取start到end的数据

sess.run(train_step,feed_dict={x:X[start:end],y_:Y_[start:end]})

#每500次打印一次参数

if i%500==0:

print("在%d次迭代后,参数为"%(i))

print(sess.run(w1))

#输出训练后的参数

print("\n")

print("FINAL w1 is:",sess.run(w1))

自定义损失函数

loss=tf.reduce_sum(tf.where(tf.greater(y,y_),COST(y-y_),PROFIT(y_-y)))

中间的where是判断y是否大于y_

如图

tensorflow学习笔记(3)前置数学知识的更多相关文章

- 深度学习-tensorflow学习笔记(1)-MNIST手写字体识别预备知识

深度学习-tensorflow学习笔记(1)-MNIST手写字体识别预备知识 在tf第一个例子的时候需要很多预备知识. tf基本知识 香农熵 交叉熵代价函数cross-entropy 卷积神经网络 s ...

- 深度学习-tensorflow学习笔记(2)-MNIST手写字体识别

深度学习-tensorflow学习笔记(2)-MNIST手写字体识别超级详细版 这是tf入门的第一个例子.minst应该是内置的数据集. 前置知识在学习笔记(1)里面讲过了 这里直接上代码 # -*- ...

- TensorFlow学习笔记5-概率与信息论

TensorFlow学习笔记5-概率与信息论 本笔记内容为"概率与信息论的基础知识".内容主要参考<Deep Learning>中文版. \(X\)表示训练集的设计矩阵 ...

- Tensorflow学习笔记2019.01.03

tensorflow学习笔记: 3.2 Tensorflow中定义数据流图 张量知识矩阵的一个超集. 超集:如果一个集合S2中的每一个元素都在集合S1中,且集合S1中可能包含S2中没有的元素,则集合S ...

- tensorflow学习笔记(4)-学习率

tensorflow学习笔记(4)-学习率 首先学习率如下图 所以在实际运用中我们会使用指数衰减的学习率 在tf中有这样一个函数 tf.train.exponential_decay(learning ...

- tensorflow学习笔记——使用TensorFlow操作MNIST数据(2)

tensorflow学习笔记——使用TensorFlow操作MNIST数据(1) 一:神经网络知识点整理 1.1,多层:使用多层权重,例如多层全连接方式 以下定义了三个隐藏层的全连接方式的神经网络样例 ...

- tensorflow学习笔记——自编码器及多层感知器

1,自编码器简介 传统机器学习任务很大程度上依赖于好的特征工程,比如对数值型,日期时间型,种类型等特征的提取.特征工程往往是非常耗时耗力的,在图像,语音和视频中提取到有效的特征就更难了,工程师必须在这 ...

- TensorFlow学习笔记——LeNet-5(训练自己的数据集)

在之前的TensorFlow学习笔记——图像识别与卷积神经网络(链接:请点击我)中了解了一下经典的卷积神经网络模型LeNet模型.那其实之前学习了别人的代码实现了LeNet网络对MNIST数据集的训练 ...

- tensorflow学习笔记——使用TensorFlow操作MNIST数据(1)

续集请点击我:tensorflow学习笔记——使用TensorFlow操作MNIST数据(2) 本节开始学习使用tensorflow教程,当然从最简单的MNIST开始.这怎么说呢,就好比编程入门有He ...

随机推荐

- CF1066D Boxes Packing(二分答案)

题意描述: 你有$n$个物品,每个物品大小为$a_i$,$m$个盒子,每个盒子的容积为$k$.$Maksim$先生想把物品装入盒子中.对于每个物品,如果能被放入当前的盒子中,则放入当前盒子,否则换一个 ...

- show status 查看各种状态

要查看MySQL运行状态,要优化MySQL运行效率都少不了要运行show status查看各种状态,下面是参考官方文档及网上资料整理出来的中文详细解释: 如有问题,欢迎指正 状态名 作用域 详细解释 ...

- CentOS7安装.Net Core2.2

一.安装.Dotnet Core 2.2 Runtime Linux上运行Dotnet Core程序的前提是安装Dotnet Core Runtime .Net Core对不同的Linux版本提示了 ...

- 第3章 jQuery中的DOM操作

parent() .parents().closest() 区别示例: <!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitiona ...

- React基本语法

React 一.导入 0.局部安装 react 和 react-dom npm install --save-dev react react-dom 1.react ...

- 【Android】添加依赖包

貌似好像不知一种方法,以后有时间再研究,下面是其中的一种方法

- Python中常见的字典dict处理

#字典的赋值d = [{"dasda": 123, "gsgsg": 3344}, {"dasdz": 123, "gsksg&q ...

- Go Web Gin EasyUI 框架

项目结构 第三方: 1.gin微服务框架 2.EasyUI框架

- python--模块之基本

模块的概念: 在计算机程序开发过程中,随着程序代码越来越多,在一个文件里代码就会越来越长,不利于维护.为了编写可维护的代码,我们把很多函数分组,分别放到不同的文件里,这样每个文件包含的代码就相对较少. ...

- Django中的模型继承

1.使用最原始的方式继承 class Animal(models.Model): name = models.CharField(max_length=20) age = models.Integer ...