Apache Spark-1.0.1集群搭建

欢迎经验交流!本文Blog地址:http://www.cnblogs.com/fesh/p/3866791.html

Apache Spark a fast and general engine for large-scale data processing

Spark是一个高效的分布式计算系统,相比Hadoop,它在性能上比Hadoop要高100倍。Spark是发源于美国加州大学伯克利分校AMPLab的集群计算平台,它克服了MapReduce在迭代式计算和交互式计算方面的不足,通过引入RDD(Resilient Distributed Datasets)数据表示模型,能够很好地解决MapReduce不易解决的问题。相比于MapReduce,Spark能够充分利用内存资源提高计算效率。

一、基本环境

包含三个节点:

master(Ubuntu Desktop版本) 192.168.145.128

slave1(Ubuntu Server版本) 192.168.145.129

slave2(Ubuntu Server版本) 192.168.145.130

操作系统:Ubuntu14.04 x64

JDK版本:jdk1.8.0_11

Hadoop版本:Hadoop-2.2.0

Scala版本:2.10.4(官网要求2.10.X)

Spark版本:1.0.1

取得《Spark-1.0.1 的make-distribution.sh编译、SBT编译、Maven编译 三种编译方法》中编译好的 spark-1.0.1-bin-2.2.0.tgz

Hadoop-2.2.0集群的安装见http://www.cnblogs.com/fesh/p/3766656.html

Scala的安装见 http://www.cnblogs.com/fesh/p/3805611.html

(注:Scala在master节点上安装好后,直接用scp命令分发到slave1、slave2,并在slave1和slave2配置环境变量即可)

在master节点和slave1节点分别配置/etc/hosts和/etc/hostname:(下面这些应该在安装Hadoop集群时已经配置好了)

/etc/hosts

192.168.145.128 master

192.168.145.129 slave1

192.168.145.130 slave2

/etc/hostname (master)

master

/etc/hostname (slave1)

slave1

/etc/hostname (slave2)

slave2

二、Spark配置

1、master节点文件配置

在master节点:

解压spark-1.0.1-bin-2.2.0.tgz

tar -zxvf spark-1.0.-bin-2.2..tgz

在/etc/profile中配置环境变量

#Set SPARK_HOME

export SPARK_HOME=/home/fesh/spark-1.0.-bin-2.2.

export PATH=$PATH:$SPARK_HOME/bin

在spark-1.0.1-bin-2.2.0/conf下配置文件spark-env.sh和slaves:

cp spark-env.sh.template spark-env.sh

sudo gedit spark-env.sh

在文件spark-env.sh末尾添加:

export HADOOP_CONF_DIR=/home/fesh/hadoop-2.2./etc/hadoop

export JAVA_HOME=/usr/lib/jvm/jdk1..0_11

export SCALA_HOME=/home/fesh/scala-2.10.

export SPARK_MASTER_IP=master

export SPARK_WORKER_MEMORY=512M

export SPARK_EXECUTOR_MEMORY=512M export SPARK_EXECUTOR_INSTANCES= (下面这几项可以不配置,采用默认就可以了)

export SPARK_EXECUTOR_CORES=

export SPARK_DRIVER_MEMORY=512M

export SPARK_YARN_APP_NAME="spark 1.0.1"

在文件slaves中去掉localhohst并设置

master

slave1

slave2

2、分发文件

分发spark-1.0.1-bin-2.2.0文件到slave1节点

scp -r spark-1.0.-bin-2.2. slave1:~/

分发spark-1.0.1-bin-2.2.0文件到slave2节点

scp -r spark-1.0.1-bin-2.2.0 slave2:~/

三、启动Spark集群

首先启动Hadoop-2.2.0集群,然后在spark-1.0.1-bin-2.2.0根目录下启动Spark集群

sbin/start-all.sh

对于slave1节点

对于slave2节点

四、查看信息

1、进入Spark集群的Web页面

在master节点上,浏览器访问: http://master:8080

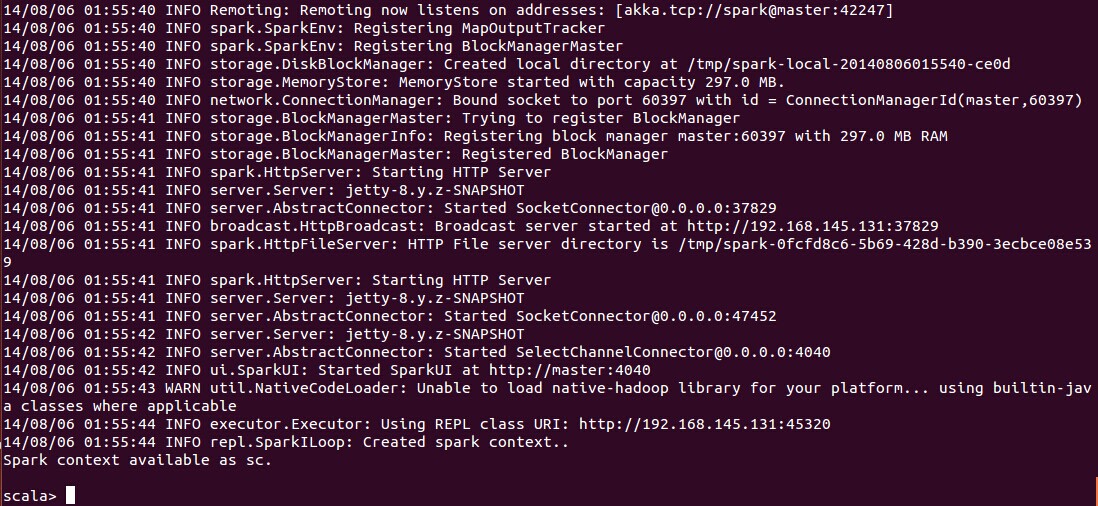

2、控制台查看

进入{SPARK_HOME}/bin目录,使用 spark-shell 控制台

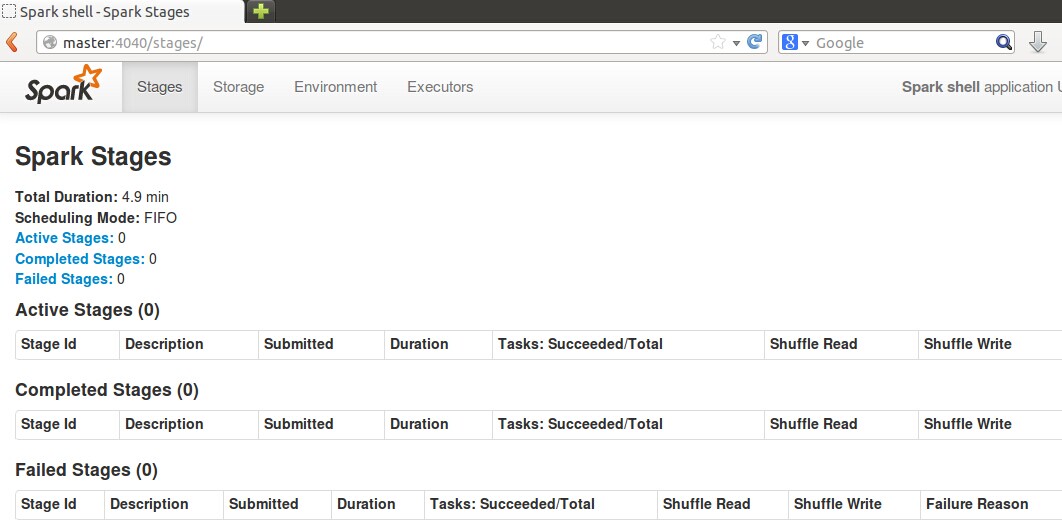

3、Web查看SparkUI

在master节点,浏览器进入 http://master:4040

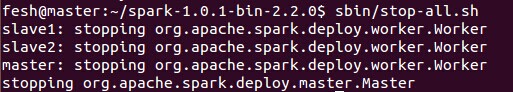

五、停止Spark集群

sbin/stop-all.sh

参考:

1、http://spark.apache.org/docs/latest/running-on-yarn.html

2、http://spark.apache.org/docs/latest/configuration.html

Apache Spark-1.0.1集群搭建的更多相关文章

- spark 2.0.2 集群搭建

由于之前已经搭建过hadoop相关环境,现在搭建spark的预备工作只有scala环境了 一,配置scala环境 1.解压tar包后,编辑/etc/profile 2.source /etc/prof ...

- 【原创 Hadoop&Spark 动手实践 5】Spark 基础入门,集群搭建以及Spark Shell

Spark 基础入门,集群搭建以及Spark Shell 主要借助Spark基础的PPT,再加上实际的动手操作来加强概念的理解和实践. Spark 安装部署 理论已经了解的差不多了,接下来是实际动手实 ...

- Redis 5.0.5集群搭建

Redis 5.0.5集群搭建 一.概述 Redis3.0版本之后支持Cluster. 1.1.redis cluster的现状 目前redis支持的cluster特性: 1):节点自动发现 2):s ...

- 大数据学习系列之七 ----- Hadoop+Spark+Zookeeper+HBase+Hive集群搭建 图文详解

引言 在之前的大数据学习系列中,搭建了Hadoop+Spark+HBase+Hive 环境以及一些测试.其实要说的话,我开始学习大数据的时候,搭建的就是集群,并不是单机模式和伪分布式.至于为什么先写单 ...

- CDH 6.0.1 集群搭建 「Before install」

从这一篇文章开始会有三篇文章依次介绍集群搭建 「Before install」 「Process」 「After install」 继上一篇使用 docker 部署单机 CDH 的文章,当我们使用 d ...

- HADOOP+SPARK+ZOOKEEPER+HBASE+HIVE集群搭建(转)

原文地址:https://www.cnblogs.com/hanzhi/articles/8794984.html 目录 引言 目录 一环境选择 1集群机器安装图 2配置说明 3下载地址 二集群的相关 ...

- Hadoop2.0 HA集群搭建步骤

上一次搭建的Hadoop是一个伪分布式的,这次我们做一个用于个人的Hadoop集群(希望对大家搭建集群有所帮助): 集群节点分配: Park01 Zookeeper NameNode (active) ...

- CDH 6.0.1 集群搭建 「After install」

集群搭建完成之后其实还有很多配置工作要做,这里我列举一些我去做的一些. 首先是去把 zk 的角色重新分配一下,不知道是不是我在配置的时候遗漏了什么在启动之后就有报警说目前只能检查到一个节点.去将 zk ...

- ubuntu18.04 flink-1.9.0 Standalone集群搭建

集群规划 Master JobManager Standby JobManager Task Manager Zookeeper flink01 √ √ flink02 √ √ flink03 √ √ ...

- java_redis3.0.3集群搭建

redis3.0版本之后支持Cluster,具体介绍redis集群我就不多说,了解请看redis中文简介. 首先,直接访问redis.io官网,下载redis.tar.gz,现在版本3.0.3,我下面 ...

随机推荐

- jquery中ajax方法返回的三种数据类型:text、json、xml;

1.当dataType:"text"时,处理页面用的是DBDA类中的Strquery()方法,所以返回的数据是下面这样的,所以要对返回来的数据用split根据“|”和“^”来分割, ...

- mysql source命令超大文件导入方法总结

本文章来给各位朋友介绍利用mysql source命令超大文件导入方法总结,下面收集了两种解决办法,一种是把数据库分文件导出然后再导入,另一种是修改my.ini配置文件,下面我一一给各位朋友介绍. 导 ...

- 《统计推断(Statistical Inference)》读书笔记——第4章 统计分布族

数据分析工作中最常和多维随机变量打交道,第四章介绍了多维随机变量的基本知识,其中核心概念是条件分布和条件概率.条件分布和条件概率可以抽象出条件期望的概念,在随机分析的研究中,理解随机积分和鞅理论和关键 ...

- 论文笔记之: Hierarchical Convolutional Features for Visual Tracking

Hierarchical Convolutional Features for Visual Tracking ICCV 2015 摘要:跟卢湖川的那个文章一样,本文也是利用深度学习各个 layer ...

- MFC CPtrLink的使用

if (!m_SALink.IsEmpty()) { POSITION pos = m_SALink.GetHeadPosition(); for (int j = 0; j < m_SALin ...

- 20151215单选按钮列表,复选框列表:CheckBoxList

单选框:RadioButton GroupName:组名,如果要实现单选效果每个单选按钮的组名必须一样 是否被选中 RadioButton.checked 单选按钮列表:RadioButtonList ...

- python-RabbitMQ基础篇

一.RabbitMQ简单介绍 RabbitMQ是一个在AMQP基础上完整的,可复用的企业消息系统.他遵循Mozilla Public License开源协议. MQ全称为Message Queue, ...

- MySQL性能优化总结(转)https://yq.aliyun.com/articles/24249

摘要: 一.MySQL的主要适用场景 1.Web网站系统 2.日志记录系统 3.数据仓库系统 4.嵌入式系统 二.MySQL架构图: 三.MySQL存储引擎概述 1)MyISAM存储引擎 MyIS ...

- 一、Spring——IoC

IOC概述 Spring中IOC的概念,控制反转概念其实包含两个层面的意思,"控制"是接口实现类的选择控制权:而"反转"是指这种选择控制权从调用者转移到外部第三 ...

- bzoj2518: [Shoi2010]滚动的正四面体

Description 正四面体总共有4个面,每个面都是一个正三角形.现在把它的一个面标记上字母A,如图 3中所示,A标记在底面上: 于是,这个正四面体的滚动过程就可以用一个只包含“L”“R”“B”的 ...