Spark文档阅读之二:Programming Guides - Quick Start

Quick Start: https://spark.apache.org/docs/latest/quick-start.html

一、最简单的Spark Shell交互分析

scala> val textFile = spark.read.textFile("README.md") # 构建一个Dataset

textFile: org.apache.spark.sql.Dataset[String] = [value: string]

scala> textFile.count() # Dataset的简单计算

res0: Long =

scala> val linesWithSpark = textFile.filter(line => line.contain("Spark")) # 由现有Dataset生成新Dataset

res1: org.apache.spark.sql.Dataset[String] = [value: string]

# 等价于:

# res1 = new Dataset()

# for line in textFile:

# if line.contain("Spark"):

# res1.append(line)

# linesWithSpark = res1

scala> linesWithSpark.count()

res2: Long =

# 可以将多个操作串行起来

scala> textFile.filter(line => line.contain("Spark")).count()

res3: Long =

进一步的Dataset分析:

scala> textFile.map(line => line.split(" ").size).reduce((a,b) => if (a > b) a else b)

res12: Int =

# 其实map和reduce就是两个普通的算子,不要被MapReduce中一个map配一个reduce、先map后reduce的思想所束缚

# map算子就是对Dataset的元素X计算fun(X),并且将所有f(X)作为新的Dataset返回

# reduce算子其实就是通过两两计算fun(X,Y)=Z,将Dataset中的所有元素归约为1个值

# 也可以引入库进行计算

scala> import java.lang.Math

import java.lang.Math

scala> textFile.map(line => line.split(" ").size).reduce((a, b) => Math.max(a, b))

res14: Int =

# 还可以使用其他算子

scala> val wordCounts = textFile.flatMap(line => line.split(" ")).groupByKey(identity).count()

# flatMap算子也是对Dataset的每个元素X执行fun(X)=Y,只不过map的res是

# res.append(Y),如[[Y11, Y12], [Y21, Y22]],结果按元素区分

# 而flatMap是

# res += Y,如[Y11, Y12, Y21, Y22],各元素结果合在一起

# groupByKey算子将Dataset的元素X作为参数传入进行计算f(X),并以f(X)作为key进行分组,返回值为KeyValueGroupedDataset类型

# 形式类似于(key: k; value: X1, X2, ...),不过KeyValueGroupedDataset不是一个Dataset,value列表也不是一个array

# 注意:这里的textFile和textFile.flatMap都是Dataset,不是RDD,groupByKey()中可以传func;如果以sc.textFile()方法读文件,得到的是RDD,groupByKey()中间不能传func

# identity就是函数 x => x,即返回自身的函数

# KeyValueGroupedDataset的count()方法返回(key, len(value))列表,结果是Dataset类型

scala> wordCounts.collect()

res37: Array[(String, Long)] = Array((online,), (graphs,), ...

# collect操作:将分布式存储在集群上的RDD/Dataset中的所有数据都获取到driver端

数据的cache:

scala> linesWithSpark.cache() # in-memory cache,让数据在分布式内存中缓存

res38: linesWithSpark.type = [value: string] scala> linesWithSpark.count()

res41: Long =

二、最简单的独立Spark任务(spark-submit提交)

import org.apache.spark.sql.SparkSession

object SimpleApp {

def main(args: Array[String]) {

val logFile = "/Users/dxm/work-space/spark-2.4.5-bin-hadoop2.7/README.md"

val spark = SparkSession.builder.appName("Simple Application").getOrCreate()

val logData = spark.read.textFile(logFile).cache()

val numAs = logData.filter(line => line.contains("a")).count() # 包含字母a的行数

val numBs = logData.filter(line => line.contains("b")).count() # 包含字母b的行数

println(s"Lines with a: $numAs, Lines with b: $numBs")

spark.stop()

}

}

2)编写sbt依赖文件build.sbt

name := "Simple Application" version := "1.0" scalaVersion := "2.12.10" libraryDependencies += "org.apache.spark" %% "spark-sql" % "2.4.5"

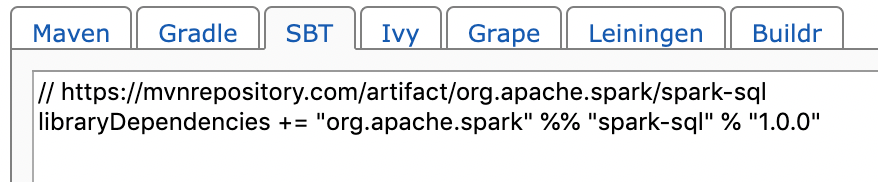

其中,"org.apache.spark" %% "spark-sql" % "2.4.5"这类库名可以在网上查到,例如https://mvnrepository.com/artifact/org.apache.spark/spark-sql_2.10/1.0.0

$ find .

.

./build.sbt

./src

./src/main

./src/main/scala

./src/main/scala/SimpleApp.scala

sbt目录格式要求见官方文档 https://www.scala-sbt.org/1.x/docs/Directories.html

src/

main/

resources/

<files to include in main jar here>

scala/

<main Scala sources>

scala-2.12/

<main Scala 2.12 specific sources>

java/

<main Java sources>

test/

resources

<files to include in test jar here>

scala/

<test Scala sources>

scala-2.12/

<test Scala 2.12 specific sources>

java/

<test Java sources>

使用sbt打包

# 打包

$ sbt package

...

[success] Total time: s (:), completed -- ::

# jar包位于 target/scala-2.12/simple-application_2.-1.0.jar

4)提交并执行Spark任务

$ bin/spark-submit --class "SimpleApp" --master spark://xxx:7077 ../scala-tests/SimpleApp/target/scala-2.12/simple-application_2.12-1.0.jar

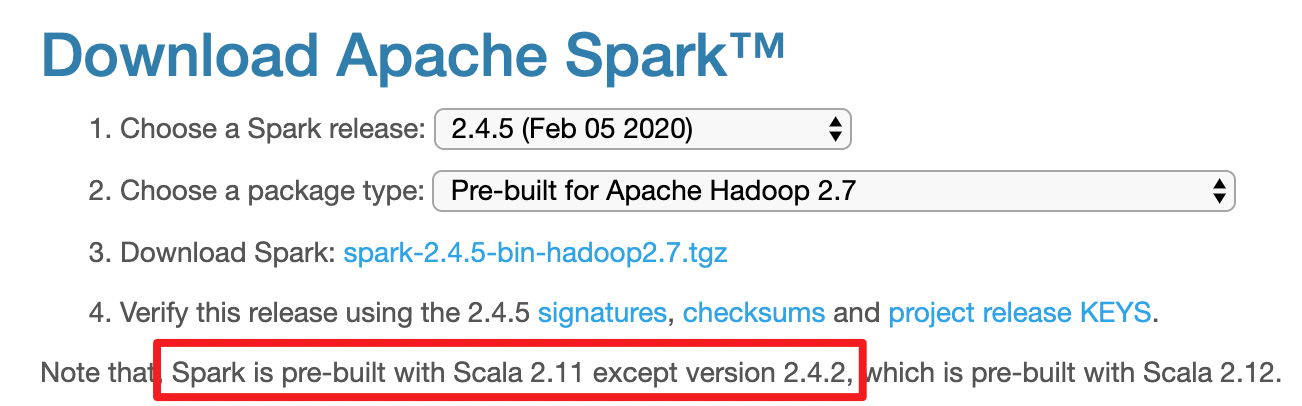

# 报错:Caused by: java.lang.ClassNotFoundException: scala.runtime.LambdaDeserialize

# 参考:https://stackoverflow.com/questions/47172122/classnotfoundexception-scala-runtime-lambdadeserialize-when-spark-submit

# 这是spark版本和scala版本不匹配导致的

查询spark所使用的scala的版本

$ bin/spark-shell --master spark://xxx:7077 scala> util.Properties.versionString

res0: String = version 2.11.

$ bin/spark-submit --class "SimpleApp" --master spark://xxx:7077 ../scala-tests/SimpleApp/target/scala-2.11/simple-application_2.11-1.0.jar

Lines with a: , Lines with b:

Spark文档阅读之二:Programming Guides - Quick Start的更多相关文章

- Spring 4.3.11.RELEASE文档阅读(二):Core Technologies_IOC

在看这部分内容的时候,想了一些问题: 容器: 1,什么是容器 用来包装或装载物品的贮存器 2,容器能做什么 包装或装载物品 3,为什么需要容器 为什么要使用集装箱?如果没有容器会是什么样? 4,常见的 ...

- Spark文档阅读之一:Spark Overview

Document: https://spark.apache.org/docs/latest/index.html 版本:2.4.5 1. spark的几种执行方式 1)交互式shell:bin/ ...

- Spring 4.3.11.RELEASE文档阅读(二):Core Technologies_AOP

虽然并不是每个问题都有答案,但我想了很多问题.so, just write it down , maybe one day...... AOP: 1,AOP是啥 2,AOP思想是怎么产生的 3,AOP ...

- 转:苹果Xcode帮助文档阅读指南

一直想写这么一个东西,长期以来我发现很多初学者的问题在于不掌握学习的方法,所以,Xcode那么好的SDK文档摆在那里,对他们也起不到什么太大的作用.从论坛.微博等等地方看到的初学者提出的问题,也暴露出 ...

- Node.js的下载、安装、配置、Hello World、文档阅读

Node.js的下载.安装.配置.Hello World.文档阅读

- 我的Cocos Creator成长之路1环境搭建以及基本的文档阅读

本人原来一直是做cocos-js和cocos-lua的,应公司发展需要,现转型为creator.会在自己的博客上记录自己的成长之路. 1.文档阅读:(cocos的官方文档) http://docs.c ...

- Keras 文档阅读笔记(不定期更新)

目录 Keras 文档阅读笔记(不定期更新) 模型 Sequential 模型方法 Model 类(函数式 API) 方法 层 关于 Keras 网络层 核心层 卷积层 池化层 循环层 融合层 高级激 ...

- Django文档阅读-Day1

Django文档阅读-Day1 Django at a glance Design your model from djano.db import models #数据库操作API位置 class R ...

- Django文档阅读-Day2

Django文档阅读 - Day2 Writing your first Django app, part 1 You can tell Django is installed and which v ...

随机推荐

- SPOJ-PGCD Primes in GCD Table

题目链接:https://vjudge.net/problem/SPOJ-PGCD 题目大意: 给定 \(N\) 和 \(M\),求满足 \((1 \le x \le N), (1 \le y \le ...

- Code Your First API With Node.js and Express: Set Up the Server

How to Set Up an Express API Server in Node.js In the previous tutorial, we learned what the REST ar ...

- .NET Core HttpClientFactory+Consul实现服务发现

前言 上篇文章.NET Core HttpClient+Consul实现服务发现提到过,HttpClient存在套接字延迟释放的问题,高并发情况导致端口号被耗尽引起服务器拒绝服务的问题.好在微软意识到 ...

- NPM——常用命令

npm init //创建一个package.json | npm init -y //快速全部以默认的方式生成一个package.json ,-y是-yes的缩写 以下方式可按回车默认 name 项 ...

- python报错2

缩进导致的报错 IndentationError: unindent does not match any outer indentation level NameError 命名错误 原因是: na ...

- 设计并测试Trapezium类 代码参考

#include <iostream> using namespace std; class Trapezium { private: int x1,y1,x2,y2,x3,y3,x4,y ...

- 透过 NestedScrollView 源码解析嵌套滑动原理

NestedScrollView 是用于替代 ScrollView 来解决嵌套滑动过程中的滑动事件的冲突.作为开发者,你会发现很多地方会用到嵌套滑动的逻辑,比如下拉刷新页面,京东或者淘宝的各种商品页面 ...

- Rocket - diplomacy - LazyModule

https://mp.weixin.qq.com/s/FBU8fE4u9-UK6mRGQOlvbQ 介绍LazyModule的实现. 1. children LazyModu ...

- Java实现 蓝桥杯 算法提高 因式分解

算法提高 8-1因式分解 时间限制:10.0s 内存限制:256.0MB 提交此题 问题描述 设计算法,用户输入合数,程序输出若个素数的乘积.例如,输入6,输出23.输入20,输出22*5. 样例 与 ...

- Java实现 蓝桥杯VIP 算法提高 任意年月日历输出

算法提高 任意年月日历输出 时间限制:1.0s 内存限制:512.0MB 已知2007年1月1日为星期一. 设计一函数按照下述格式打印2007年以后(含)某年某月的日历,2007年以前的拒绝打印. 为 ...