TensorFlow NormLization

local_response_normalization

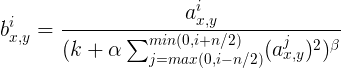

local_response_normalization出现在论文”ImageNet Classification with deep Convolutional Neural Networks”中,论文中说,这种normalization对于泛化是有好处的.

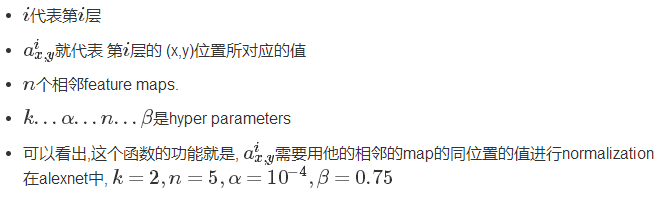

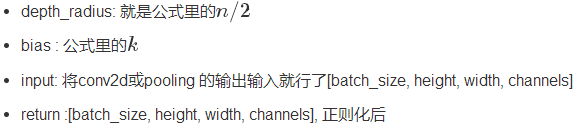

经过了一个conv2d或pooling后,我们获得了[batch_size, height, width, channels]这样一个tensor.现在,将channels称之为层,不考虑batch_size

tf.nn.local_response_normalization(input, depth_radius=None, bias=None, alpha=None, beta=None, name=None)

'''

Local Response Normalization.

The 4-D input tensor is treated as a 3-D array of 1-D vectors (along the last dimension), and each vector is normalized independently. Within a given vector, each component is divided by the weighted, squared sum of inputs within depth_radius. In detail,

'''

"""

input: A Tensor. Must be one of the following types: float32, half. 4-D.

depth_radius: An optional int. Defaults to 5. 0-D. Half-width of the 1-D normalization window.

bias: An optional float. Defaults to 1. An offset (usually positive to avoid dividing by 0).

alpha: An optional float. Defaults to 1. A scale factor, usually positive.

beta: An optional float. Defaults to 0.5. An exponent.

name: A name for the operation (optional).

"""

举例子:

import tensorflow as tf a = tf.constant([

[[1.0, 2.0, 3.0, 4.0],

[5.0, 6.0, 7.0, 8.0],

[8.0, 7.0, 6.0, 5.0],

[4.0, 3.0, 2.0, 1.0]],

[[4.0, 3.0, 2.0, 1.0],

[8.0, 7.0, 6.0, 5.0],

[1.0, 2.0, 3.0, 4.0],

[5.0, 6.0, 7.0, 8.0]]

])

#reshape a,get the feature map [batch:1 height:2 width:2 channels:8]

a = tf.reshape(a, [1, 2, 2, 8]) normal_a=tf.nn.local_response_normalization(a,2,0,1,1)

with tf.Session() as sess:

print("feature map:")

image = sess.run(a)

print (image)

print("normalized feature map:")

normal = sess.run(normal_a)

print (normal)

feature map:

[[[[ 1. 2. 3. 4. 5. 6. 7. 8.]

[ 8. 7. 6. 5. 4. 3. 2. 1.]] [[ 4. 3. 2. 1. 8. 7. 6. 5.]

[ 1. 2. 3. 4. 5. 6. 7. 8.]]]]

normalized feature map:

[[[[ 0.07142857 0.06666667 0.05454545 0.04444445 0.03703704 0.03157895

0.04022989 0.05369128]

[ 0.05369128 0.04022989 0.03157895 0.03703704 0.04444445 0.05454545

0.06666667 0.07142857]] [[ 0.13793103 0.10000001 0.0212766 0.00787402 0.05194805 0.04

0.03448276 0.04545454]

[ 0.07142857 0.06666667 0.05454545 0.04444445 0.03703704 0.03157895

0.04022989 0.05369128]]]]

这里我取了n/2=2,k=0,α=1,β=1,举个例子,比如对于一通道的第一个像素“1”来说,我们把参数代人公式就是1/(1^2+2^2+3^2)=0.07142857,对于四通道的第一个像素“4”来说,公式就是4/(2^2+3^2+4^2+5^2+6^2)=0.04444445,以此类推

注意:这里的feature_map为【1,2,2,8】,其中1代表图像的数量,2X2代表图像的长宽,8代表图像的层数(map),NRL主要是利用map去计算,然后计算的值为图像的长宽(像素),与图像的数量无关!

我们可以这么理解,feature_map分割为直观的图像,第一个通道[1,8,4,1],第二个通道[2,7,3,2],第三个通道[3,6,2,3],以此类推。。。

那么求解的过程和上面就一一对应了,其中在边角达不到n的时候,那就省略。

能感觉到这种方法不好吗?效果肯定有的,因为对像素归一化了,有利于计算。但是对于一整幅图像来说反而没有什么太大的作用,因为归一化的种类不同,造成部分特征体现不出来,有时候反而不好。

batch_normalization

为什么有batch?上面结尾已经做了初步分析,也已经大概引出来对批量的图像做归一化,对单个图像做的归一化效果不好!

可以看出,batch_normalization之后,数据的维数没有任何变化,只是数值发生了变化

OutOut作为下一层的输入

函数:

tf.nn.batch_normalization()

def batch_normalization(x,

mean,

variance,

offset,

scale,

variance_epsilon,

name=None):

Args:

- x: Input

Tensorof arbitrary dimensionality. - mean: A mean

Tensor. - variance: A variance

Tensor. - offset: An offset

Tensor, often denoted ββ in equations, or None. If present, will be added to the normalized tensor. - scale: A scale

Tensor, often denoted γγ in equations, orNone. If present, the scale is applied to the normalized tensor. - variance_epsilon: A small float number to avoid dividing by 0.

- name: A name for this operation (optional).

- Returns: the normalized, scaled, offset tensor.

对于卷积,x:[bathc,height,width,depth]

对于卷积,我们要feature map中共享 γiγi 和 βiβi ,所以 γ,βγ,β的维度是[depth]

现在,我们需要一个函数 返回mean和variance, 看下面.

tf.nn.moments()

def moments(x, axes, shift=None, name=None, keep_dims=False):

# for simple batch normalization pass `axes=[0]` (batch only):

对于卷积的batch_normalization, x 为[batch_size, height, width, depth],axes=[0,1,2],就会输出(mean,variance), mean 与 variance 均为标量。

参考:

https://blog.csdn.net/mao_xiao_feng/article/details/53488271

https://www.jianshu.com/p/c06aea337d5d

https://blog.csdn.net/u012436149/article/details/52985303

TensorFlow NormLization的更多相关文章

- Tensorflow&CNN:验证集预测与模型评价

版权声明:本文为博主原创文章,转载 请注明出处:https://blog.csdn.net/sc2079/article/details/90480140 - 写在前面 本科毕业设计终于告一段落了.特 ...

- Tensorflow&CNN:裂纹分类

版权声明:本文为博主原创文章,转载 请注明出处:https://blog.csdn.net/sc2079/article/details/90478551 - 写在前面 本科毕业设计终于告一段落了.特 ...

- Tensorflow 官方版教程中文版

2015年11月9日,Google发布人工智能系统TensorFlow并宣布开源,同日,极客学院组织在线TensorFlow中文文档翻译.一个月后,30章文档全部翻译校对完成,上线并提供电子书下载,该 ...

- tensorflow学习笔记二:入门基础

TensorFlow用张量这种数据结构来表示所有的数据.用一阶张量来表示向量,如:v = [1.2, 2.3, 3.5] ,如二阶张量表示矩阵,如:m = [[1, 2, 3], [4, 5, 6], ...

- 用Tensorflow让神经网络自动创造音乐

#————————————————————————本文禁止转载,禁止用于各类讲座及ppt中,违者必究————————————————————————# 前几天看到一个有意思的分享,大意是讲如何用Ten ...

- tensorflow 一些好的blog链接和tensorflow gpu版本安装

pading :SAME,VALID 区别 http://blog.csdn.net/mao_xiao_feng/article/details/53444333 tensorflow实现的各种算法 ...

- tensorflow中的基本概念

本文是在阅读官方文档后的一些个人理解. 官方文档地址:https://www.tensorflow.org/versions/r0.12/get_started/basic_usage.html#ba ...

- kubernetes&tensorflow

谷歌内部--Borg Google Brain跑在数十万台机器上 谷歌电商商品分类深度学习模型跑在1000+台机器上 谷歌外部--Kubernetes(https://github.com/kuber ...

- tensorflow学习

tensorflow安装时遇到gcc: error trying to exec 'as': execvp: No such file or directory. 截止到2016年11月13号,源码编 ...

随机推荐

- java课堂笔记2

- python中字符串方法总结

定义一个空字符串: a=' '; s.strip() #去空格 s.upper()#全部转换成大写: s.lower()# 全部转换成小写: s.isdigit()#判断字符串是否只有数字组成:返回t ...

- 垃圾收集器(GC)

堆分区:所有new的对象都会存放在堆中 > 新生代(Young Generation):存放生命周期短的对象,具体还分为Eden和Survivor两个区,其中Survivor分为Fro ...

- SpringMvc开发报找不到springmvc配置文件

param-name标签属性值必须为contextConfigLocation

- eclipse工具类及插件(svn的安装)

(摘抄原文)https://blog.csdn.net/nzzl54/article/details/80768838

- 云硬盘性能测试工具FIO介绍

一.云硬盘的性能衡量指标 云硬盘的性能指标一般通过以下几个指标进行衡量 IOPS:每秒的读写次数,单位为次(计数).存储设备的底层驱动类型决定了不同的IOPS 总IOPS:每秒执行的I/O操作总次数 ...

- Js 编程题汇总

Coding题: 1. 预测以下代码的输出结果: var Foo = function(a) { function bar() { console.log(a); }; this.baz = func ...

- 创建ApplicationContext与BeanFactory时的区别-Spring源码学习之容器的基本实现

传送门 可以加载XML两种方法 使用 BeanFactory 加载 XML BeanFactory bf = new XmlBeanFactory(new ClassPathResource(&quo ...

- 前端基础----CSS语法、CSS四种引入方式、CSS选择器、CSS属性操作

一.CSS语法 CSS 规则由两个主要的部分构成:选择器,以及一条或多条声明. 例如: h1 {color:red; font-size:14px;} 二.CSS四种引入方式 1,行内式 行内式是在标 ...

- 学习笔记TF043:TF.Learn 机器学习Estimator、DataFrame、监督器Monitors

线性.逻辑回归.input_fn()建立简单两个特征列数据,用特证列API建立特征列.特征列传入LinearClassifier建立逻辑回归分类器,fit().evaluate()函数,get_var ...