requests模块demo

import urllib.request

import requests

from requests.auth import HTTPBasicAuth

from requests.auth import HTTPDigestAuth

import json base_url = 'http://httpbin.org' # 发送get请求

r = requests.get(base_url+'/get')

print(r.status_code) #发送post请求

r = requests.post(base_url+'/post')

print(r.status_code) #发送put请求

r = requests.put(base_url+'/put')

print(r.status_code) #发送delete请求

r = requests.delete(base_url+'/delete')

print(r.status_code) # 发送get请求 传递url参数

param_data={'user':'zxw123','password':''}

r = requests.get(base_url+'/get',params=param_data)

print(r.url)

print(r.status_code)

resonponse = urllib.request.urlopen("http://baidu.com")

html= resonponse

print(html) # post传递body参数

from_data={'user':'zxw123','password':''}

r = requests.post(base_url+'/post',data = from_data)

print(r.status_code)

print(r.text) # 请求头定制 将dict传递给header

from_data={'user':'zxw123','password':''}

header={'user-agent': 'Mozilla/5.0'}

r = requests.post(base_url+'/post',data = from_data,headers = header)

print(r.status_code)

print(r.text) # 响应内容

from_data={'user':'zxw123','password':''}

header={'user-agent': 'Mozilla/5.0'}

r = requests.post(base_url+'/post',data = from_data,headers = header)

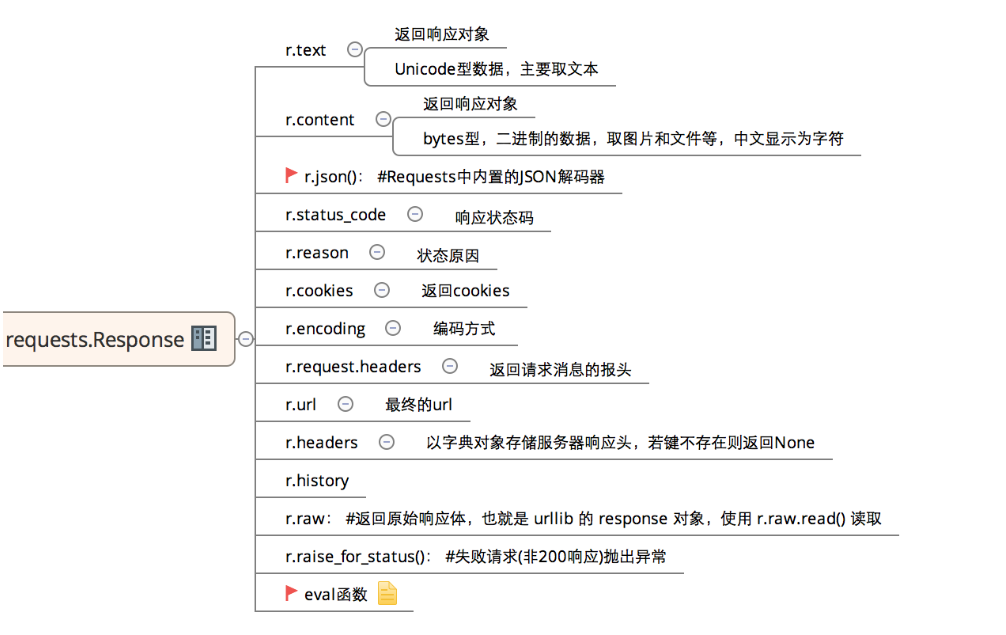

# 响应状态码

print(r.status_code)

# 响应内容

print(r.text)

# 响应内容以json格式

print(r.json())

# 响应头信息

print(r.headers) # 设置cookie cookie={'uesr':'beijing'}

r=requests.get(base_url+'/cookies',cookies = cookie)

print(r.text) # 获取cookie

# 请求百度首页,获取cookie

r = requests.get('http://baidu.com')

print(type(r.cookies))

print(r.cookies)

for key,value in r.cookies.items():

print(key+':'+value) # 超时

# 设定timeout超时之后停止响应,防止请求没有响应而一直处于等待状态

cookie={'uesr':'beijing'}

r=requests.get(base_url+'/cookies',cookies = cookie,timeout = 10)

print(r.text) # 文件上传 参数files

file={'file':open('zxw_logo.png','rb')}

r = requests.post(base_url+'/post',files=file)

print(r.text) # session(会话)

# 接口之间经常有依赖关系,在没有session保存机制的情况下,第二个接口无法获取第一个接口的cookie值 # 设置cookie

r = requests.get(base_url+'/cookies/set/user/51zxw')

print(r.text) # 获取cookie

r = requests.get(base_url+'/cookies')

print(r.text) # 加入session之后,可以模拟同一对话而不用担心cookies问题,通常用于模拟成功登陆之后进行下一步操作

s = requests.Session()

# 设置cookie

r=s.get(base_url+'/cookies/set/user/51zxw')

print(r.text) # 获取cookie

r =s.get(base_url+'/cookies')

print(r.text) # ssl验证默认开启,验证失败会抛出SSLError

# r = requests.get('https://www.12306.cn')

# 关闭ssl验证

r=requests.get('https://www.12306.cn',verify=False)

print(r.text) # 身份认证 BasicAuth

r = requests.get(base_url+'/basic-auth/51zxw/8888',auth=HTTPBasicAuth('51zxw',''))

print(r.text) # 身份认证 DigestAuth

r = requests.get(base_url+'/digest-auth/auth/heiheiehi/23333',auth=HTTPDigestAuth('heiheihei',''))

print(r.text) # # 代理设置

proxies = {'http':'http://219.142.132.146:4065'}

r = requests.get(base_url+'/get',proxies=proxies)

print(r.text) # 流式请求, 接口返回多个结果 r = requests.get(base_url+'/stream/10',stream = True)

# 如果响应内容没有设置编码,则默认为utf-8

if r.encoding is None:

r.encoding='utf-8'

# 对响应结果进行迭代处理

for line in r.iter_lines(decode_unicode=True):

if line:

data=json.loads(line)

print(data['id'])

requests模块demo的更多相关文章

- 爬虫 requests 模块

requests 模块 介绍 使用requests可以模拟浏览器的请求, 比起之前用到的urllib,requests模块的api更加便捷(本质就是封装了urllib3) ps: requests库发 ...

- 爬虫第三篇:requests模块

requests模块其实就是对urllib.request模块的进步一不优化,提供了很多可选的参数,同时简化了操作.下面我还是贴上具体操作的代码. requests GET请求 GET请求html文件 ...

- 爬虫4:pdf页面+pdfminer模块+demo

本文介绍下pdf页面的爬取,需要借助pdfminer模块 demo一般流程: 1)设置url url = 'http://www.------' + '.PDF' 2)requests模块获取url ...

- 爬虫requests模块 1

让我们从一些简单的示例开始吧. 发送请求¶ 使用 Requests 发送网络请求非常简单. 一开始要导入 Requests 模块: >>> import requests 然后,尝试 ...

- requests 模块

发送请求 使用Requests发送网络请求非常简单. 一开始要导入Requests模块: >>> import requests 然后,尝试获取某个网页.本例子中,我们来获取Gith ...

- requests模块--python发送http请求

requests模块 在Python内置模块(urllib.urllib2.httplib)的基础上进行了高度的封装,从而使得Pythoner更好的进行http请求,使用Requests可以轻而易举的 ...

- Python requests模块学习笔记

目录 Requests模块说明 Requests模块安装 Requests模块简单入门 Requests示例 参考文档 1.Requests模块说明 Requests 是使用 Apache2 Li ...

- Python高手之路【八】python基础之requests模块

1.Requests模块说明 Requests 是使用 Apache2 Licensed 许可证的 HTTP 库.用 Python 编写,真正的为人类着想. Python 标准库中的 urllib2 ...

- Python requests模块

import requests 下面就可以使用神奇的requests模块了! 1.向网页发送数据 >>> payload = {'key1': 'value1', 'key2': [ ...

随机推荐

- Azure通过Vnet Peering和用户自定义路由(UDR)实现hub-spoken连接

Azure的Vnet Peering可以把Azure中不同的Vnet连接起来的技术.底层是通过对NVGRE的租户标签进行修改,实现了不同租户间的互通.这种技术非常类似传统网络中MPLS/VPN不同租户 ...

- Spring学习九 Servlet相关

servlet作用: 它驻留在 Web 服务器上,处理新来的请求和输出的响应.它与表示无关,实际上也不它应该与表示有关. 作为一名专业编程人员,您碰到的大多数 Java servlet 都是为响应 W ...

- Task用法(2)-任务等待wait

1.Wait 用法 默认情况下,Task 是有线程池中的异步线程执行,是否执行完成,可以通过Task的的属性IsCompleted 来判断, 如果想在子线程工作完成之后,在进行后续主线程工作可以 ...

- c++ 插入排序算法

第一.算法描述 直插排序很容易理解,在我们打扑克牌的时候,每一次摸完牌,都会按数字大小或者花色,插入到合适的位置,直到摸完最后一张牌,我们手中的牌已经按大小顺序排列好了.这整个过程就是一个 ...

- Celery-4.1 用户指南: Periodic Tasks (定时任务)

简介 celery beat 是一个调度器:它以常规的时间间隔开启任务,任务将会在集群中的可用节点上运行. 默认情况下,入口项是从 beat_schedule 设置中获取,但是自定义的存储也可以使用, ...

- Oracle Sql中输入特殊字符 转义字符

1.单引号,出现在单引号对中的'号必须成对出现,每对代表一个', 例如select '''' from dual; 结果:' 前后两个'代表正常字符串,中间两个''代表一个',此语句输出结果只有一个'

- oracle 在xml中批量插入,批量修改及多组条件查询

最近公司用ibatis开发项目,本来可以用存储过程处理批量插入,批量修改及多组条件查询:但由于使用模块相对较小,暂时就在xml中配置,以前没有在xml做过类似处理,有必要记录一下:好了,代码如下: & ...

- DAY10-MYSQL完整性约束

一 介绍 约束条件与数据类型的宽度一样,都是可选参数 作用:用于保证数据的完整性和一致性主要分为: PRIMARY KEY (PK) 标识该字段为该表的主键,可以唯一的标识记录 FOREIGN KEY ...

- Pandoc+markdown生成slides

Pandoc+markdown生成slides 参考:http://blog.csdn.net/pizi0475/article/details/50955900 1.安装 http://pandoc ...

- ms project展开和折叠任务

1.视图——大纲——显示子任务 2.视图——大纲——隐藏子任务