Task3.特征选择

参考:https://www.jianshu.com/p/f3b92124cd2b

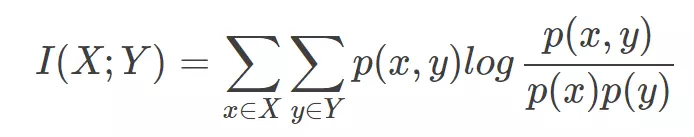

互信息

衡量两个随机变量之间的相关性,两个随机变量相关信息的多少。

随机变量就是随机试验结果的量的表示,可以理解为按照某个概率分布进行取值的变量,比如袋子里随机抽取一个小球就是一个随机变量,互信息就是对x和y所有可能

的取值的点互信息的加权和。

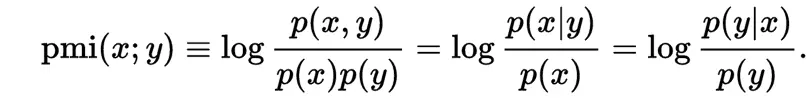

点的互信息PMI从互信息中衍生出来的

PMI用来衡量两个事物之间的相关性,公式

在概率论中,当p(x,y) = p(x) * p(y)我们说x于y相互独立。当概率加上log后,就变成了信息量。

例子:

衡量like这个词的极性(为正向情感还是负向情感),提前调一个正向情感的词如nice,算nice和like的PMI

PMI(like,nice) = log(p(like,nice)/p(like)p(nice))。PMI越大表示两个词的相关性就越大,nice的正向情感就越明显。

编程求解互信息:

from sklearn import metrics as mr

mr.mutual_info_score([1,2,3,4],[4,3,2,1])

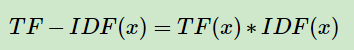

tf-idf

tf:Term Frequency 词频

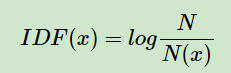

idf: Inverse Document Frequency逆文档频率

在开始,我们用词频来衡量一个词的重量程度,这一点是不科学的,如进行简历筛选时,大部分人都有的技能并不是HR想要寻找的,反而是那些出现频率低的。

所以就出现了idf。

N代表语料库中文本的总数,N(x)代表语料库中包含x的文本数目。可见出现的频率越低,IDF值越大。

避免0概率事件,我们要进行平滑。

右边+1是为了避免该词在所有文本中都出现过,(N(x) = N ,log1=0)。

TF(x)指词在当前文本中的词频。

利用sklearn进行统计tfidf值

from sklearn.feature_extraction.text import TfidfVectorizer

corpus = [

'this is the first document',

'this is the second second document',

'and the third one',

'is this the first document'

]

tfidf = TfidfVectorizer()

res = tfidf.fit_transform(corpus)

print(res)

(0, 8) 0.4387767428592343

(0, 3) 0.4387767428592343

(0, 6) 0.35872873824808993

(0, 2) 0.5419765697264572

(0, 1) 0.4387767428592343

(1, 8) 0.27230146752334033

(1, 3) 0.27230146752334033

(1, 6) 0.2226242923251039

(1, 1) 0.27230146752334033

(1, 5) 0.8532257361452784

(2, 6) 0.2884767487500274

(2, 0) 0.5528053199908667

(2, 7) 0.5528053199908667

(2, 4) 0.5528053199908667

(3, 8) 0.4387767428592343

(3, 3) 0.4387767428592343

(3, 6) 0.35872873824808993

(3, 2) 0.5419765697264572

(3, 1) 0.4387767428592343

输出结果为:(文本id,词id)tfidf值

Task3.特征选择的更多相关文章

- 挑子学习笔记:特征选择——基于假设检验的Filter方法

转载请标明出处: http://www.cnblogs.com/tiaozistudy/p/hypothesis_testing_based_feature_selection.html Filter ...

- 用信息值进行特征选择(Information Value)

Posted by c cm on January 3, 2014 特征选择(feature selection)或者变量选择(variable selection)是在建模之前的重要一步.数据接口越 ...

- MIL 多示例学习 特征选择

一个主要的跟踪系统包含三个成分:1)外观模型,通过其可以估计目标的似然函数.2)运动模型,预测位置.3)搜索策略,寻找当前帧最有可能为目标的位置.MIL主要的贡献在第一条上. MIL与CT的不同在于后 ...

- 【转】[特征选择] An Introduction to Feature Selection 翻译

中文原文链接:http://www.cnblogs.com/AHappyCat/p/5318042.html 英文原文链接: An Introduction to Feature Selection ...

- 单因素特征选择--Univariate Feature Selection

An example showing univariate feature selection. Noisy (non informative) features are added to the i ...

- 主成分分析(PCA)特征选择算法详解

1. 问题 真实的训练数据总是存在各种各样的问题: 1. 比如拿到一个汽车的样本,里面既有以“千米/每小时”度量的最大速度特征,也有“英里/小时”的最大速度特征,显然这两个特征有一个多余. 2. 拿到 ...

- 干货:结合Scikit-learn介绍几种常用的特征选择方法

原文 http://dataunion.org/14072.html 主题 特征选择 scikit-learn 作者: Edwin Jarvis 特征选择(排序)对于数据科学家.机器学习从业者来说非 ...

- 【Machine Learning】wekaの特征选择简介

看过这篇博客的都应该明白,特征选择代码实现应该包括3个部分: 搜索算法: 评估函数: 数据: 因此,代码的一般形式为: AttributeSelection attsel = new Attribut ...

- weka特征选择(IG、chi-square)

一.说明 IG是information gain 的缩写,中文名称是信息增益,是选择特征的一个很有效的方法(特别是在使用svm分类时).这里不做详细介绍,有兴趣的可以googling一下. chi-s ...

随机推荐

- 关闭Linux无用端口

关闭系统不必要的端口,增强系统安全,此处以关闭111端口为例进行说明. 1).查看本机正在监听的端口: [root@b ~]# netstat -tlnup Active Internet conne ...

- 【SQL SERVER】 搭建AlwaysON高可用组

项目需要保障数据的高可用,于是可选的方案无非是Oracle集群. 传统的主从+心跳切换访问点以及SQL Server AlwaysOn这类方案.(//经验不多,了解和实践过的方案就这类,轻拍) Ora ...

- 关于 token

用户在浏览器做一系列操作,后台服务怎么判断这些操作是来自同一个用户? 1. seesion 用户登录后,后台生成 sessionid 返回给浏览器,浏览器的每次请求带上 sessionid,后台关联 ...

- debian sftp/ssh

检查是否安装poenssh dpkg --get-selections | grep openssh 如下表示已经安装

- Android Bitmap变迁与原理解析(4.x-8.x)

App开发不可避免的要和图片打交道,由于其占用内存非常大,管理不当很容易导致内存不足,最后OOM,图片的背后其实是Bitmap,它是Android中最能吃内存的对象之一,也是很多OOM的元凶,不过,在 ...

- Appium-入门实例1

参考:(https://blog.csdn.net/zh175578809/article/details/76862590) 第一步:启动虚拟设备 在运行App之前,首先需要创建一个Android模 ...

- linux下mysql 5.7编写存储过程一直报错说Mysql server version for the right syntax

首先看下可以正确执行的. 再来看保存时提示出错的 我唯一的区别就是在传参的类型那里有了变化,然而,报错如下 难道是我的类型不支持了吗,最后在一个无意识操作下,直接在类型里面限定长度. 可以运行啦.经过 ...

- 应用安全-CTF-格式串漏洞

主要影响c库中print家族函数 - > printf,sprintf,fprintf等 利用: SIP请求URI中格式串

- Mac入门--安装PHP扩展redis,swoole

1 php7以下可以通过pecl安装PHP扩展 安装redis扩展 pecl install redis 安装swoole扩展 pecl install swoole 2 PHP7以上通过源码编译安装 ...

- 【洛谷p3956】棋盘

日常blog(✧◡✧) 棋盘[题目链接] 算法: 然后这是2017普及组: first.关于颜色处理:让c[i][j]=color+1:这样无色=0,红色=1,黄色=2: 然后其实是记忆化,将记答案的 ...