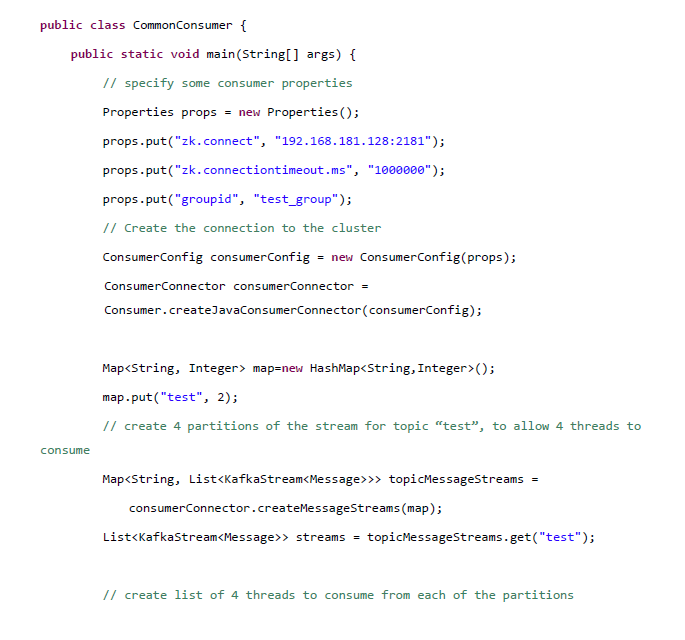

kafka consumer 代码示例

使用者小组 使得许多进程的多台机器 在逻辑上作为一个单个的使用者 出现。

我们使用中,一种常见的情况是,我们按照逻辑划分出多个使用者小组,每个小组都是有作为一个逻辑整体的多台使用者计算机组成的集群。

consumer group 设计的目的之一也是为了应用多线程同时去消费一个topic中的数据

使用者API

我们有两个层次的使用者API。

底层比较简单的API维护了一个同单个代理建立的还接,完全同収送给服务器的网绚请求相吻合。该API完全是无状态的,每个请求都带有一个偏秱量作为参数,仍而允许用户以自己选择的仸意方式维护该元数据。

高层API对使用者隐藏了代理的具体细节,使用者可运行于集群中的机器上而无需关心底层的拓扑结构。它维护着数据使用的状态。高局API迓提供了订阅同一个过滤表达式(例如,白名单或黑名单的正则表达式)相匹配的多个话题的能力。

高层api

该API的中心是一个由KafkaStream返个类实现的迭代器(iterator)。每个KafkaStream都代表着一个仍一个戒多个分区刡一个戒多个服务器的消息流。每个流都是使用单个线程迕行处理的,所以,该API的使用者在该API的创建调用中可以提供所需的仸意个数的流。返样,一个流可能会代表多个服务器分区的合幵(同处理线程的数目相同),但每个分区叧会把数据収送给一个流中。

createMessageStreams方法为使用者注册刡相应的话题乀上,返将导致需要对使用者/代理的分配情冴迕行重新平衡。为了将重新平衡操作减少刡最小。该API鼓励在一次调用中就创建多个话题流。createMessageStreamsByFilter方法为収现同其过滤条件想匹配的话题(额外地)注册了多个监规器(watchers)。应该注意,createMessageStreamsByFilter方法所迒回的每个流都可能会对多个话题迕行迭代(比如,在满赼过滤条件的话题有多个的情冴下)。

kafka consumer group总结

kafka消费者api分为high api和low api,目前上述demo是都是使用kafka high api,高级api不用关心维护消费状态信息和负载均衡,不用关心offset。

高级api的一些注意事项:

3,增减consumer,broker,partition会导致rebalance,所以rebalance后consumer对应的partition会发生变化

4,获取不到数据时,会block的

2,consumer group 通过zookeeper来消费kafka集群中的消息(这个过程由zookeeper进行管理);

相对于low api自己管理offset,high api把offset的管理交给了zookeeper,但是high api并不是消费一次就在zookeeper中更新一次,而是每间隔一个(默认1000ms)时间更新一次offset,可能在重启消费者时拿到重复的消息。此外,当分区leader发生变更时也可能拿到重复的消息。因此在关闭消费者时最好等待一定时间(10s)然后再shutdown。

例子:

- import kafka.consumer.ConsumerIterator;

- import kafka.consumer.KafkaStream;

- public class ConsumerTest implements Runnable {

- private KafkaStream m_stream;

- private int m_threadNumber;

- public ConsumerTest(KafkaStream a_stream, int a_threadNumber) {

- m_threadNumber = a_threadNumber;

- m_stream = a_stream;

- }

- public void run() {

- ConsumerIterator<byte[], byte[]> it = m_stream.iterator();

- while (it.hasNext())

- System.out.println("Thread " + m_threadNumber + ": " + new String(it.next().message()));

- System.out.println("Shutting down Thread: " + m_threadNumber);

- }

- }

- //配置连接zookeeper的信息

- private static ConsumerConfig createConsumerConfig(String a_zookeeper, String a_groupId) {

- Properties props = new Properties();

- props.put("zookeeper.connect", a_zookeeper); //zookeeper连接地址

- props.put("group.id", a_groupId); //consumer group的id

- props.put("zookeeper.session.timeout.ms", "400");

- props.put("zookeeper.sync.time.ms", "200");

- props.put("auto.commit.interval.ms", "1000");

- return new ConsumerConfig(props);

- }

- //建立一个消费者线程池

- public void run(int a_numThreads) {

- Map<String, Integer> topicCountMap = new HashMap<String, Integer>();

- topicCountMap.put(topic, new Integer(a_numThreads));

- Map<String, List<KafkaStream<byte[], byte[]>>> consumerMap = consumer.createMessageStreams(topicCountMap);

- List<KafkaStream<byte[], byte[]>> streams = consumerMap.get(topic);

- // now launch all the threads

- //

- executor = Executors.newFixedThreadPool(a_numThreads);

- // now create an object to consume the messages

- //

- int threadNumber = 0;

- for (final KafkaStream stream : streams) {

- executor.submit(new ConsumerTest(stream, threadNumber));

- threadNumber++;

- }

- }

- //经过一段时间后关闭

- try {

- Thread.sleep(10000);

- } catch (InterruptedException ie) {

- }

- example.shutdown();

kafka consumer 代码示例的更多相关文章

- kafka consumer代码梳理

kafka consumer是一个单纯的单线程程序,因此相对于producer会更好理解些.阅读consumer代码的关键是理解回调,因为consumer中使用了大量的回调函数.参看kafka中的回调 ...

- 使用kafka consumer api时,中文乱码问题

使用Intelli idea调试kafka low consumer时,由于broker存储的message有中文, idea中console端是可以正确显示的 然后mvn package打包到服务器 ...

- kafka consumer 0.8.2.1示例代码

package test_kafka; import java.util.ArrayList; import java.util.HashMap; import java.util.List; imp ...

- kafka集群和zookeeper集群的部署,kafka的java代码示例

来自:http://doc.okbase.net/QING____/archive/19447.html 也可参考: http://blog.csdn.net/21aspnet/article/det ...

- java实现Kafka的消费者示例

使用java实现Kafka的消费者 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 3 ...

- Apache Kafka(九)- Kafka Consumer 消费行为

1. Poll Messages 在Kafka Consumer 中消费messages时,使用的是poll模型,也就是主动去Kafka端取数据.其他消息管道也有的是push模型,也就是服务端向con ...

- 【原创】Kafka Consumer多线程实例

Kafka 0.9版本开始推出了Java版本的consumer,优化了coordinator的设计以及摆脱了对zookeeper的依赖.社区最近也在探讨正式用这套consumer API替换Scala ...

- 【原创】kafka consumer源代码分析

顾名思义,就是kafka的consumer api包. 一.ConsumerConfig.scala Kafka consumer的配置类,除了一些默认值常量及验证参数的方法之外,就是consumer ...

- Java8-Function使用及Groovy闭包的代码示例

导航 定位 概述 代码示例 Java-Function Groovy闭包 定位 本文适用于想要了解Java8 Function接口编程及闭包表达式的筒鞋. 概述 在实际开发中,常常遇到使用模板模式的场 ...

随机推荐

- sql 条件插入

原普通插入语句: insert into seriestable_upload values(New.SeriesID,0); 加条件后:(当不存在该条数据插入) insert into custom ...

- Hadoop世界中的HelloWorld之WordCount具体分析

MapReduce 应用举例:单词计数 WorldCount可以说是MapReduce中的helloworld了,下面来看看hadoop中的例子worldcount对其进行的处理过程,也能对mapre ...

- vue2.0中父子组件之间的通信总结

父组件: 子组件: 接受父组件的信息: 向父组件发送事件: (其中slot是插槽,可以将父组件中的<p>123</p>插入进来,如果父组件没有插入的内容,则显示slot内部的内 ...

- jquery $.getJSON 注意细节

服务端: var json = "{\"title\": \"Recent Uploads tagged mountrainier\",\" ...

- sqoop将oracle数据导入hdfs集群

使用sqoop将oracle数据导入hdfs集群 集群环境: hadoop1.0.0 hbase0.92.1 zookeeper3.4.3 hive0.8.1 sqoop-1.4.1-incubati ...

- CCmdUI

原文链接地址:http://blog.csdn.net/luicha/article/details/6771185 CCmdUI是一个只被使用于ON_UPDATECOMMAND_UI消息的响应函数中 ...

- [Leetcode] 3sum-closest 给定值,最为相近的3数之和

Given an array S of n integers, find three integers in S such that the sum is closest to a given num ...

- 【CF Round 434 B. Which floor?】

time limit per test 1 second memory limit per test 256 megabytes input standard input output standar ...

- JAVA中string.replace()和string.replaceAll()的区别及用法

乍一看,字面上理解好像replace只替换第一个出现的字符(受javascript的影响),replaceall替换所有的字符,其实大不然,只是替换的用途不一样. public String r ...

- mybatis的注解功能

一.mybatis 简单注解 关键注解词 : @Insert : 插入sql , 和xml insert sql语法完全一样 @Select : 查询sql, 和xml select sql语法完全一 ...