python 爬取链家

import json import requests

from lxml import etree

from time import sleep url = "https://sz.lianjia.com/ershoufang/rs/"

headers = {

"User-Agent":"",

"Refer":"https://sz.lianjia.com/ershoufang/pg2/"

}

resp = requests.get(url,headers=headers) base_url = "https://sz.lianjia.com/ershoufang/pg{}/"

html = etree.HTML(resp.text)

data = html.xpath('//*[@id="content"]//div[@class="page-box fr"]/div/@page-data')

data = json.loads(data[0])

totalPage = data['totalPage']

curPage = data['curPage'] def get_data(url):

list = []

resp = requests.get(url, headers=headers)

html = etree.HTML(resp.text)

ul = html.xpath('.//ul[@class="sellListContent"]/li')

for li in ul:

face = li.xpath('./a/img/@src')

title = li.xpath('.//div[@class="title"]/a/text()')

position = li.xpath('.//div[@class="positionInfo"]/a/text()')

house_info = li.xpath('.//div[@class="houseInfo"]/text()')

follow_info = li.xpath('.//div[@class="followInfo"]/text()')

price = li.xpath('.//div[@class="priceInfo"]/div[@class="totalPrice"]/span/text()')

unit_price = li.xpath('.//div[@class="priceInfo"]/div[@class="unitPrice"]/span/text()')

tag = li.xpath('.//div[@class="tag"]//span/text()')

content = {}

content["face"] = face[0]

content["title"] = title[0]

content["position"] = position[0]

content["house_info"] = house_info[0]

content["follow_info"] = follow_info[0]

content["price"] = price[0]

content["unit_price"] = unit_price[0]

if len(tag) >=1 and tag[0] is not None:

content['tag'] = tag[0]

list.append(content)

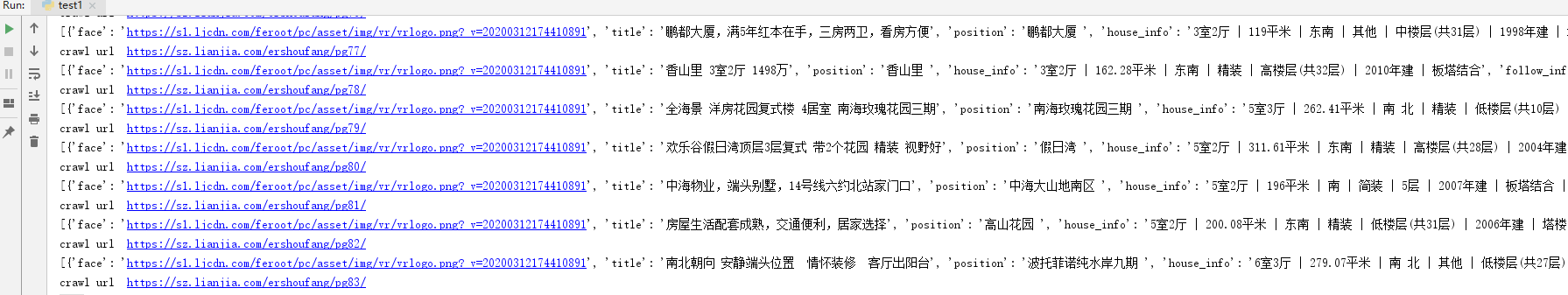

return list totalList = []

for i in range(1,totalPage+1):

url = base_url.format(i)

print("crawl url " + url)

cur_list = get_data(url)

print(cur_list)

totalList = totalList + cur_list url = base_url.format(1) print(totalList)

python 爬取链家的更多相关文章

- Python爬取链家二手房源信息

爬取链家网站二手房房源信息,第一次做,仅供参考,要用scrapy. import scrapy,pypinyin,requests import bs4 from ..items import L ...

- 适合初学者的Python爬取链家网教程

前言 文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者: TinaLY PS:如有需要Python学习资料的小伙伴可以加点击下 ...

- python爬取链家二手房信息,确认过眼神我是买不起的人

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,如有问题请及时联系我们以作处理. PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行获取 python免费学习资 ...

- Python爬虫项目--爬取链家热门城市新房

本次实战是利用爬虫爬取链家的新房(声明: 内容仅用于学习交流, 请勿用作商业用途) 环境 win8, python 3.7, pycharm 正文 1. 目标网站分析 通过分析, 找出相关url, 确 ...

- Python的scrapy之爬取链家网房价信息并保存到本地

因为有在北京租房的打算,于是上网浏览了一下链家网站的房价,想将他们爬取下来,并保存到本地. 先看链家网的源码..房价信息 都保存在 ul 下的li 里面 爬虫结构: 其中封装了一个数据库处理模 ...

- python爬虫:爬取链家深圳全部二手房的详细信息

1.问题描述: 爬取链家深圳全部二手房的详细信息,并将爬取的数据存储到CSV文件中 2.思路分析: (1)目标网址:https://sz.lianjia.com/ershoufang/ (2)代码结构 ...

- python爬虫:利用BeautifulSoup爬取链家深圳二手房首页的详细信息

1.问题描述: 爬取链家深圳二手房的详细信息,并将爬取的数据存储到Excel表 2.思路分析: 发送请求--获取数据--解析数据--存储数据 1.目标网址:https://sz.lianjia.com ...

- Python——Scrapy爬取链家网站所有房源信息

用scrapy爬取链家全国以上房源分类的信息: 路径: items.py # -*- coding: utf-8 -*- # Define here the models for your scrap ...

- Scrapy实战篇(一)之爬取链家网成交房源数据(上)

今天,我们就以链家网南京地区为例,来学习爬取链家网的成交房源数据. 这里推荐使用火狐浏览器,并且安装firebug和firepath两款插件,你会发现,这两款插件会给我们后续的数据提取带来很大的方便. ...

随机推荐

- adb无线连接android手机进行调式,无需获得root权限

利用adb无线连接android手机进行调式 无需获得root权限 转载来自CSDN https://blog.csdn.net/lnking1992/article/details/5346518 ...

- 安卓自动化测试工具Monkey简单使用

一.首先安装adb 地址:http://www.downza.cn/soft/219906.html安装到D盘下,安装的过程中自己注意下不要安装上全家桶.找到这个压缩包:解压到当前文件夹: 二.将ad ...

- Robotframework自动化2-Windows环境搭建

前言 上节主要介绍了部分的robotframework搭建,如果想运行APP的话,还需要进一步配置环境. 需要安装的软件 1.Android-sdk-windows 2.JDK 3.Appium-de ...

- Linux 【Shell脚本经典案例】

Shell 简介 hell是linux的一外壳,它包在linux内核的外面,为用户和内核之间的交互提供了一个接口 当用户下达指令给操作系统的时候,实际上是把指令告诉shell,经过shell解释,处理 ...

- 每日一道 LeetCode (48):最长回文子串

每天 3 分钟,走上算法的逆袭之路. 前文合集 每日一道 LeetCode 前文合集 代码仓库 GitHub: https://github.com/meteor1993/LeetCode Gitee ...

- Burger King使用RayOnSpark进行基于实时情景特征的快餐食品推荐

作者:Luyang Wang, Kai Huang, Jiao Wang, Shengsheng Huang, Jason Dai 基于深度学习的推荐模型已广泛应用于各种电商平台中,为用户提供推荐.目 ...

- Linux入门到实战

关注公众号 cxytester 获取第一手资讯. 1. 全是干货-Linux命令大全 1.1 线上查询及帮助(1个) help 1.2 文件目录及操作(12个) ls tree pwd mkdir r ...

- netty之pipeline

转载自https://blog.csdn.net/zxhoo/article/details/17264263 Netty4学习笔记(1)-- ChannelPipeline Netty4Netty是 ...

- JVM学习(三)JVM垃圾回收

一.引用的分类 在了解JVM垃圾回收机制之前,了解一下对象的引用类型是非常必要的. 强引用:GC时不会被回收 软引用:描述有用但不是必须的对象,在发生内存溢出异常之前被回收 弱引用:描述有用但不是必须 ...

- Android如何使用注解进行代码检查

原文首发于微信公众号:躬行之(jzman-blog),欢迎关注交流! Android Studio 内置了代码检查工具 Lint,可在菜单栏选择 Analyze > Inspect Code 执 ...