mapreduce分区

本次分区是采用项目垃圾分类的csv文件,按照小于4的分为一个文件,大于等于4的分为一个文件

源代码:

PartitionMapper.java:

package cn.idcast.partition; import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper; import java.io.IOException;

/*

K1:行偏移量 LongWritable

v1:行文本数据 Text k2:行文本数据 Text

v2:NullWritable

*/ public class PartitionMapper extends Mapper<LongWritable,Text, Text, NullWritable> {

//map方法将v1和k1转为k2和v2

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

context.write(value,NullWritable.get());

}

}

PartitionerReducer.java:

package cn.idcast.partition; import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException; /*

k2: Text

v2: NullWritable k3: Text

v3: NullWritable

*/

public class PartitionerReducer extends Reducer<Text, NullWritable,Text, NullWritable> {

@Override

protected void reduce(Text key, Iterable<NullWritable> values, Context context) throws IOException, InterruptedException {

context.write(key,NullWritable.get());

}

}

MyPartitioner.java:

package cn.idcast.partition; import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner; public class MyPartitioner extends Partitioner<Text, NullWritable> {

/*

1:定义分区规则

2:返回对应的分区编号 */

@Override

public int getPartition(Text text, NullWritable nullWritable, int numPartitions) {

//1:拆分行文本数据(k2),获取垃圾分类数据的值

String[] split = text.toString().split(",");

String numStr=split[1]; //2:判断字段与15的关系,然后返回对应的分区编号

if(Integer.parseInt(numStr)>=4){

return 1;

}

else{

return 0;

}

}

}

JobMain.java:

package cn.idcast.partition; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.TextInputFormat;

import org.apache.hadoop.mapreduce.lib.output.TextOutputFormat;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner; import java.net.URI; public class JobMain extends Configured implements Tool {

@Override

public int run(String[] args) throws Exception {

//1:创建Job任务对象

Job job = Job.getInstance(super.getConf(), "partition_mapreduce");

//如果打包运行出错,则需要加该配置

job.setJarByClass(cn.idcast.mapreduce.JobMain.class);

//2:对Job任务进行配置(八个步骤)

//第一步:设置输入类和输入的路径

job.setInputFormatClass(TextInputFormat.class);

TextInputFormat.addInputPath(job,new Path("hdfs://node1:8020/input"));

//第二部:设置Mapper类和数据类型(k2和v2)

job.setMapperClass(PartitionMapper.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(NullWritable.class);

//第三步:指定分区类

job.setPartitionerClass(MyPartitioner.class);

//第四、五、六步

//第七步:指定Reducer类和数据类型(k3和v3)

job.setReducerClass(PartitionerReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(NullWritable.class);

//设置ReduceTask的个数

job.setNumReduceTasks(2);

//第八步:指定输出类和输出路径

job.setOutputFormatClass(TextOutputFormat.class);

Path path=new Path("hdfs://node1:8020/out/partition_out");

TextOutputFormat.setOutputPath(job,path);

//获取FileSystem

FileSystem fs = FileSystem.get(new URI("hdfs://node1:8020/partition_out"),new Configuration());

//判断目录是否存在

if (fs.exists(path)) {

fs.delete(path, true);

System.out.println("存在此输出路径,已删除!!!");

}

//3:等待任务结束

boolean bl = job.waitForCompletion(true);

return bl?0:1;

} public static void main(String[] args) throws Exception {

Configuration configuration = new Configuration();

//启动一个job任务

int run = ToolRunner.run(configuration, new JobMain(), args);

System.exit(run);

}

}

在hadoop或者本地运行结果:

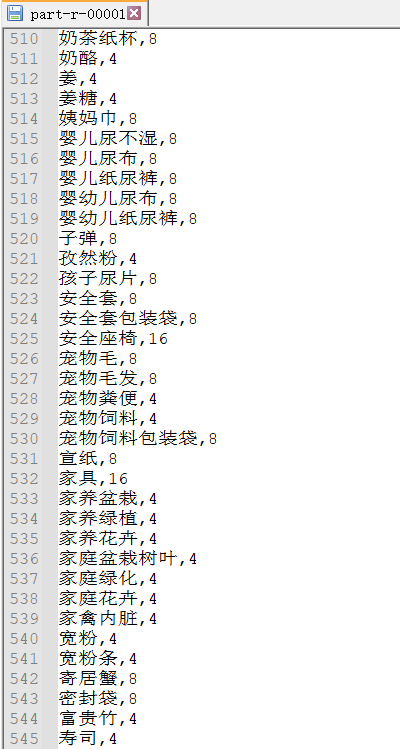

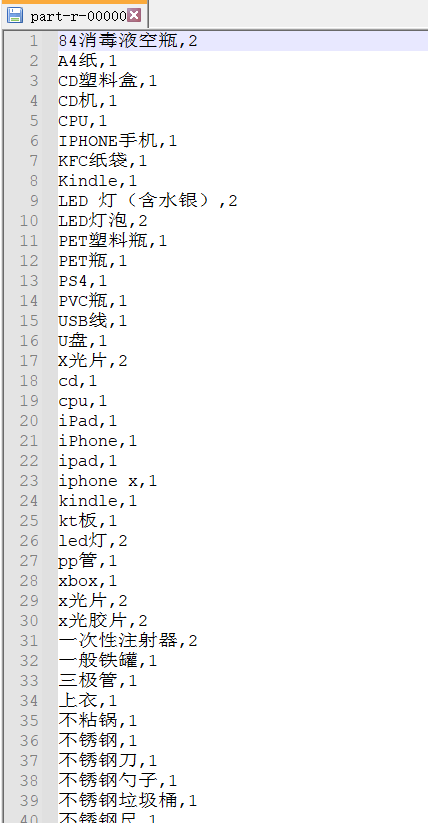

1.均为4-16的文件

2.均为1-3的文件

mapreduce分区的更多相关文章

- Hadoop Mapreduce分区、分组、二次排序过程详解[转]

原文地址:Hadoop Mapreduce分区.分组.二次排序过程详解[转]作者: 徐海蛟 教学用途 1.MapReduce中数据流动 (1)最简单的过程: map - reduce (2) ...

- hadoop2.2.0 MapReduce分区

package com.my.hadoop.mapreduce.partition; import java.util.HashMap;import java.util.Map; import org ...

- Hadoop Mapreduce分区、分组、二次排序

1.MapReduce中数据流动 (1)最简单的过程: map - reduce (2)定制了partitioner以将map的结果送往指定reducer的过程: map - partiti ...

- MapReduce分区和排序

一.排序 排序: 需求:根据用户每月使用的流量按照使用的流量多少排序 接口-->WritableCompareable 排序操作在hadoop中属于默认的行为.默认按照字典殊勋排序. 排序的分类 ...

- MapReduce分区的使用(Partition)

MapReduce中的分区默认是哈希分区,根据map输出key的哈希值做模运算,如下 int result = key.hashCode()%numReduceTask; 如果我们需要根据业务需求来将 ...

- Hadoop Mapreduce分区、分组、二次排序过程详解

转载:http://blog.tianya.cn/m/post.jsp?postId=53271442 1.MapReduce中数据流动 (1)最简单的过程: map - reduce (2)定制了 ...

- MapReduce分区数据倾斜

什么是数据倾斜? 数据不可避免的出现离群值,并导致数据倾斜,数据倾斜会显著的拖慢MR的执行速度 常见数据倾斜有以下几类 1.数据频率倾斜 某一个区域的数据量要远远大于其他区域 2.数据大小倾斜 ...

- YARN集群的mapreduce测试(五)

将user表计算后的结果分区存储 测试准备: 首先同步时间,然后master先开启hdfs集群,再开启yarn集群:用jps查看: master上: 先有NameNode.SecondaryNameN ...

- spark shuffle:分区原理及相关的疑问

一.分区原理 1.为什么要分区?(这个借用别人的一段话来阐述.) 为了减少网络传输,需要增加cpu计算负载.数据分区,在分布式集群里,网络通信的代价很大,减少网络传输可以极大提升性能.mapreduc ...

随机推荐

- JZ-052-正则表达式匹配

正则表达式匹配 题目描述 请实现一个函数用来匹配包括'.'和''的正则表达式.模式中的字符'.'表示任意一个字符,而''表示它前面的字符可以出现任意次(包含0次). 在本题中,匹配是指字符串的所有字符 ...

- LeetCode-098-验证二叉搜索树

验证二叉搜索树 题目描述:给定一个二叉树,判断其是否是一个有效的二叉搜索树. 假设一个二叉搜索树具有如下特征: 节点的左子树只包含小于当前节点的数. 节点的右子树只包含大于当前节点的数. 所有左子树和 ...

- Flutter ChartSpace:通过跨端 Canvas 实现图表库

基于Flutter 的图形语法库,通过跨端 Canvas ,将基于 Javascript 的图形语法库 ChartSpace 扩展至 Flutter 端 作者:字节跳动终端技术--胡珀 背景 数据平台 ...

- largebin attack

largebin attack 由这个名字就可以看出是对 largebin 进行的操作,需要的条件是存在 UAF 或者可以构造出 UAF.实现的功能是: 1.任意地址写入一个大数字 2.实现任意地址分 ...

- Airtest安装与简介

一:简介 什么是Airtest 网易的airtest其实是个测试套件,由Airtest框架.poco框架.airtestIDE 组成. Airtest框架 基于图像识别的自动化测试框架,是网易自己团队 ...

- 理解 MVCC

MongoDB.MySQL.Oracle.PostgreSQL 等事务型数据库都有 mvcc 的概念. MVCC: 即多版本并发控制,主要是为了提高数据库的读写性能,让数据库在读写的时候不用去加锁.m ...

- ActiveMQ 笔记—01

- Linux项目部署 jdk tomcat 安装配置 linux下 failed connect to localhost:8080;Connection refused

ONBOOT=yes 5.安装wget (1)安装 yum -y install wget (2) 查看版本 wget --version或 wget -V 一.安装jdk 配置 (1)安 ...

- MyEclipse 05_连接mysql数据库进行增删改查

例子: 1.在数据库中建立如下表 2. 在MyEclipse里按本主博客文MyEclipse 03_jdbc连接数据库,注意数据库名要一致 运行后在Navicat里如下: 代码如下: package ...

- python3生成10个成绩列表,求其平均分

import random alist = [random.randint(45,101) for _ in range(10)] #在[45.101)之间生成10个随机数 print(alist) ...