Hadoop spark mongo复制集

启动hadoop

cd /usr/local/hadoop/hadoop

$hadoop namenode -format # 启动前格式化namenode

$./sbin/start-all.sh

检查是否启动成功

[hadoop@hadoop1 hadoop]$ jps

16855 NodeManager

16999 Jps

16090 NameNode

16570 ResourceManager

16396 SecondaryNameNode

[hadoop@hadoop1 hadoop]$

/usr/local/hadoop/hadoop

[hadoop@hadoop2 hadoop]$ jps

1378 NodeManager

1239 DataNode

1528 Jps

[hadoop@hadoop2 hadoop]$ 停止

$./sbin/stop-all.sh 启动spark

cd /usr/local/hadoop/spark/

./sbin/start-all.sh 检查是否启动成功

[hadoop@hadoop1 spark]$ jps

16855 NodeManager

17223 Master

17447 Jps

17369 Worker

16090 NameNode

16570 ResourceManager

16396 SecondaryNameNode

[hadoop@hadoop1 spark]$

[hadoop@hadoop2 spark]$ jps

1378 NodeManager

1239 DataNode

2280 Worker

2382 Jps

[hadoop@hadoop2 spark]$ 停止

$./sbin/stop-all.sh

pyspark_mongo复制集_hdfs_hbase 启动mongo复制集

[

/usr/local/mongodb/安装后,初始化

mkdir -p /mnt/mongodb_data/{data,log};

mkdir conf/;

vim /usr/local/mongodb/conf/mongod.conf; [

mv /mnt/mongodb_data/data /mnt/mongodb_data/data$(date +"%Y%m%d_%H%I%S"); mkdir /mnt/mongodb_data/data;

]

``

bind_ip=0.0.0.0

port=

dbpath=/mnt/mongodb_data/data

logpath=/mnt/mongodb_data/log/mongod.log

pidfilepath=/usr/local/mongodb/mongo.pid

fork=true

logappend=true scp /usr/local/mongodb/conf/mongod.conf root@hadoop2:/usr/local/mongodb/conf/; 启动服务

/usr/local/mongodb/bin/mongod -f /usr/local/mongodb/conf/mongod.conf

进入读写窗设置admin账号

/usr/local/mongodb/bin/mongo

use admin;

db.createUser(

{

user: "admin",

pwd: "admin123",

roles: [ { role: "userAdminAnyDatabase", db: "admin" } ,"clusterAdmin"]

}

); 检验是否添加成功

db.getUsers()

关闭服务mongod

db.shutdownServer()

退出mongo

exit 对配置文件加入ip限制和复制集配置

vim /usr/local/mongodb/conf/mongod.conf;

replSet=repl_test

keyFile=/usr/local/mongodb/conf/keyFile

shardsvr=true

directoryperdb=true /usr/local/mongodb/bin/mongod -f /usr/local/mongodb/conf/mongod.conf

进入任一节点mongo窗,进入读写

/usr/local/mongodb/bin/mongo

use admin;

db.auth("admin","admin123");

设置复制集

rs.status();

rs.();

rs.status();

rs.add("hadoop2:27017");

rs.status();

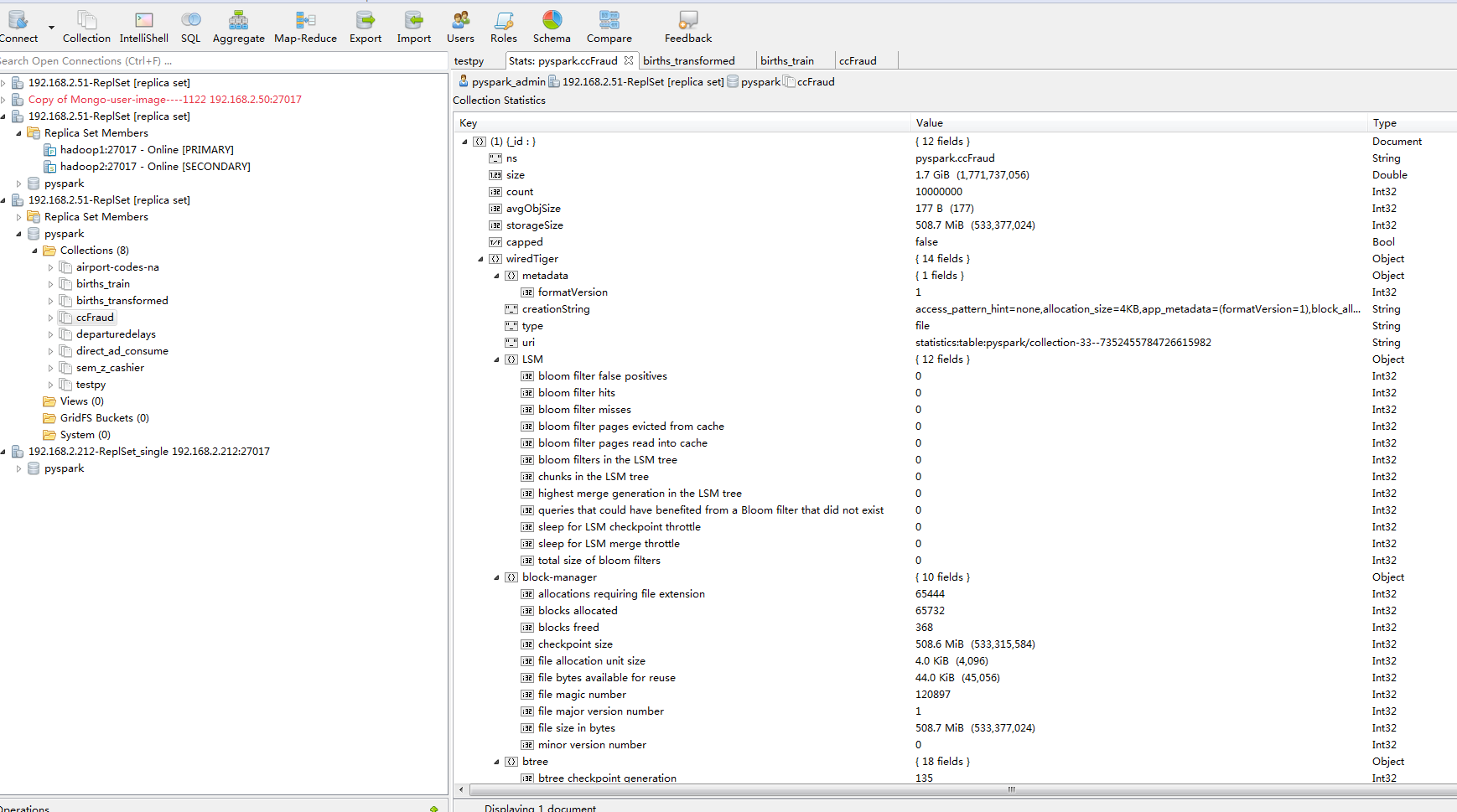

复制集无误后,库表、角色、用户设计; use pyspark;

db.createUser(

{

user: "pyspark_admin",

pwd: "admin123",

roles: [ "readWrite", "dbAdmin" ]

}

);

db.getRoles();

db.getUsers(); db.auth("pyspark_admin","admin123");

show collections;

db.createCollection('direct_ad_consume');

db.createCollection('sem_z_cashier');

show collections; db.createCollection('testpy');

db.createCollection('departuredelays');

db.createCollection('airport-codes-na'); db.createCollection('ccFraud'); db.sem_z_cashier.drop();

] spark数据源;

单个大文件hdfs、hbase

序列化文件mongo复制集,可以考虑spark-mongo组件 执行spark

cd /usr/local/hadoop/ 启动hadoop

cd /usr/local/hadoop/hadoop

$hadoop namenode -format # 启动前格式化namenode

$./sbin/start-all.sh

检查是否启动成功

[hadoop@hadoop1 hadoop]$ jps

NodeManager

Jps

NameNode

ResourceManager

SecondaryNameNode

[hadoop@hadoop1 hadoop]$

/usr/local/hadoop/hadoop

[hadoop@hadoop2 hadoop]$ jps

NodeManager

DataNode

Jps

[hadoop@hadoop2 hadoop]$ 停止

$./sbin/stop-all.sh 启动spark

cd /usr/local/hadoop/spark/

./sbin/start-all.sh 检查是否启动成功

[hadoop@hadoop1 spark]$ jps

NodeManager

Master

Jps

Worker

NameNode

ResourceManager

SecondaryNameNode

[hadoop@hadoop1 spark]$

[hadoop@hadoop2 spark]$ jps

NodeManager

DataNode

Worker

Jps

[hadoop@hadoop2 spark]$ 停止

$./sbin/stop-all.sh

Hadoop spark mongo复制集的更多相关文章

- mongo复制集脑裂问题如何处理

mongo replication 脑裂问题如何处理: 一.问题描述:一套mongo replication有4个节点.1个仲裁节点.在停止实例(或实例毁坏)的时候,导致所有节点都变为SECONDAR ...

- mongo 复制集命令

1.登录primary2.use admin >rs.add("new_node:port") 或 rs.add({"_id":4,"host& ...

- mongo复制集、分片集(亲测)

1.1 架构思路: 192.168.50.131 192.168.50.131 192.168.50.132 mongos mongos mongos ...

- 单机Mongo复制集安装配置(数据库版本:4.x)

官方文档: https://docs.mongodb.com/manual/tutorial/deploy-replica-set-with-keyfile-access-control/#dep ...

- hadoop - spark on yarn 集群搭建

一.环境准备 1. 机器: 3 台虚拟机 机器 角色 l-qta3.sp.beta.cn0 NameNode,ResourceManager,spark的master l-querydiff1.sp ...

- 工作中Hadoop,Spark,Phoenix,Impala 集群中遇到坑及解决方案

1.HDFS 修复 问题描述:其他部门在yarn平台上跑spark 程序错误的生成了海量的不到100K的小文件,导致namenode压力过大,其中一个namenode宕机后,没有及时发现 使得edit ...

- MongoDB复制集搭建(3.4.17版)

==版本== mongodb-linux-x86_64-rhel70-3.4.17.tgz ==准备== 3个节点,我这里的IP及hostname分别是: 10.11.2.52 dscn49 10.1 ...

- docker添加mongo4.0.3并配置复制集

1.创建docker 具体略过 自行百度 2.创建数据持久化目录文件(/data/mongo0是个例子 命名随意) 拉取mongo docker pull mongo:4.0.3 3.启动容器 do ...

- Hadoop+Spark:集群环境搭建

环境准备: 在虚拟机下,大家三台Linux ubuntu 14.04 server x64 系统(下载地址:http://releases.ubuntu.com/14.04.2/ubuntu-14.0 ...

随机推荐

- 九度oj 题目1125:大整数的因子

题目描述: 已知正整数k满足2<=k<=9,现给出长度最大为30位的十进制非负整数c,求所有能整除c的k. 输入: 若干个非负整数c,c的位数<=30每行一个c,当c=-1时中止 ( ...

- LINQ学习笔记 Join 与 Group join

LINQ中的Join对应T-SQL中的内连接,并无左连接的方法,当然也没有右连接. 要达成Left join必须依靠GroupJoin来完成. GroupJoin顾名思义就是先集团在做加入,加入的不同 ...

- iOS学习笔记06-手势识别

一.UIGestureRecognizer简单介绍 我们已经学习了触摸事件处理,但触摸事件处理起来很麻烦,每个触摸事件处理都需要实现3个touches方法,比较繁琐,实际上我们可以使用更加简单的触摸事 ...

- 【Luogu】P2422良好的感觉(单调栈)

题目链接 写代码能力需要极大提升.我在五分钟之内想到了单调栈,然后花了一个小时的时间去看我单调队列为啥写错了…… 首先这题需要转换自己的思维.枚举所有“最小点”,然后看它往左往右最大能扩展多少. 维护 ...

- HDU 4341 Gold miner(分组背包)

题目链接 Gold miner 目标是要在规定时间内获得的价值总和要尽可能大. 我们先用并查集把斜率相同的物品分在同一个组. 这些组里的物品按照y坐标的大小升序排序. 如果组内的一个物品被选取了,那该 ...

- 解密优秀博士成长史 ——微软亚洲研究院首届博士生学术论坛Panel讨论经验总结

编者按:有人说“一入博门深似海”,读博前应该做好哪些准备?作为一名博士生,应该有怎样的学术或职业规划?导师还是老板?怎样在师生关系上做到双赢?你是导师心目中优秀的博士生吗?相信以上问题在很多同学心中萦 ...

- centos 7 卸載 mysql

跟網上文章,安裝了一個mysqlwget http://repo.mysql.com/mysql-community-release-el7-5.noarch.rpm 記下卸載過程: 首先执行查看命令 ...

- SQL ORDER BY 关键字

SQL ORDER BY 关键字 ORDER BY 关键字用于对结果集进行排序. SQL ORDER BY 关键字 ORDER BY 关键字用于对结果集按照一个列或者多个列进行排序. ORDER BY ...

- C语言宏定义技巧——多次包括头文件内容不同

1. 头文件定义例如以下: /* declears in "funcs.h" */ FUNC_1(ID_FUN1_001) FUNC_1(ID_FUN1_002) FUNC_2( ...

- 生成可重集的排序 (白书P184)

#include<iostream> #include<cstdio> #include<cstring> #include<algorithm> us ...