基于ELK的传感器数据分析练习

Sensor Data Analytics Application

本案例参考自https://github.com/pranav-shukla/learningelasticstack/tree/master/chapter-10

ELK版本为5.6.12

数据构成

下面是sql的三个表通过关联sensorType得出的数据

| sensorType | customer | department | buildingName | room | floor | locationOnFloor | latitude | longitude |

|---|---|---|---|---|---|---|---|---|

| Temperature | Abc Labs | R & D | 222 Broadway | 101 | Floor1 | C-101 | 40.710936 | -74.0085 |

下面是sensor数据

| sensor_id | time | value |

|---|---|---|

| 1 | 1511935948000 | 21.89 |

在导入elasticsearch前把上面两种数据进行整合,即一条数据包含上面12个field。

数据模型设计

mysql表数据脚本可以到之前提到的GitHub下载。

POST _template/sensor_data_template

{

"template" : "sensor_data*", # 这里6.0可能不一样

"settings": {

"number_of_replicas": "1",

"number_of_shards": "5"

},

"mappings": {

"doc": {

"properties": {

"sensorId": {

"type": "integer"

},

"sensorType": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"customer": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"department": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"buildingName": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"room": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"floor": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"locationOnFloor": {

"type": "keyword",

"fields": {

"analyzed": {

"type": "text"

}

}

},

"location": {

"type": "geo_point"

},

"time": {

"type": "date"

},

"reading": {

"type": "double"

}

}

}

}

}

Logstash配置

下面logstash配置会从sensor_data_http_input获取数据,然后filter从mysql中拉去信息来补充数据,成为lookupResult field,这需要mutate来展开,最后删除三个多余的fields。

jdbc_streaming插件的安装

./bin/logstash-plugin install logstash-filter-jdbc_streaming

input {

http {

host => "localhost"

port => 8080

id => "sensor_data_http_input"

user => "sensor_data"

password => "sensor_data"

}

}

filter {

jdbc_streaming {

jdbc_driver_library => "/Users/flyang/Documents/big_data/hive-1.1.0-cdh5.11.2/lib/mysql-connector-java-5.1.46.jar"

jdbc_driver_class => "com.mysql.jdbc.Driver"

jdbc_connection_string => "jdbc:mysql://localhost:3306/sensor_metadata"

jdbc_user => "root"

jdbc_password => "password"

statement => "select st.sensor_type as sensorType, l.customer as customer, l.department as department, l.building_name as buildingName, l.room as room, l.floor as floor, l.location_on_floor as locationOnFloor, l.latitude, l.longitude from sensors s inner join sensor_type st on s.sensor_type_id=st.sensor_type_id inner join location l on s.location_id=l.location_id where s.sensor_id= :sensor_identifier"

parameters => { "sensor_identifier" => "sensor_id"}

target => lookupResult

}

mutate {

rename => {"[lookupResult][0][sensorType]" => "sensorType"}

rename => {"[lookupResult][0][customer]" => "customer"}

rename => {"[lookupResult][0][department]" => "department"}

rename => {"[lookupResult][0][buildingName]" => "buildingName"}

rename => {"[lookupResult][0][room]" => "room"}

rename => {"[lookupResult][0][floor]" => "floor"}

rename => {"[lookupResult][0][locationOnFloor]" => "locationOnFloor"}

add_field => {

"location" => "%{lookupResult[0]latitude},%{lookupResult[0]longitude}"

}

remove_field => ["lookupResult", "headers", "host"]

}

}

output {

elasticsearch {

hosts => ["localhost:9200"]

index => "sensor_data-%{+YYYY.MM.dd}"

}

}

测试代码

将上面的output换成

output {stdout {} }

发送信息到logstash的监听端口

curl -XPOST -u sensor_data:sensor_data --header "Content-Type:application/json" "http://localhost:8080/" -d '{"sensor_id":1,"time":1512102540000,"reading":16.24}'

搭建好Logstash后通过脚本发送数据到elasticsearch后就可以使用Kibana进行分析了。

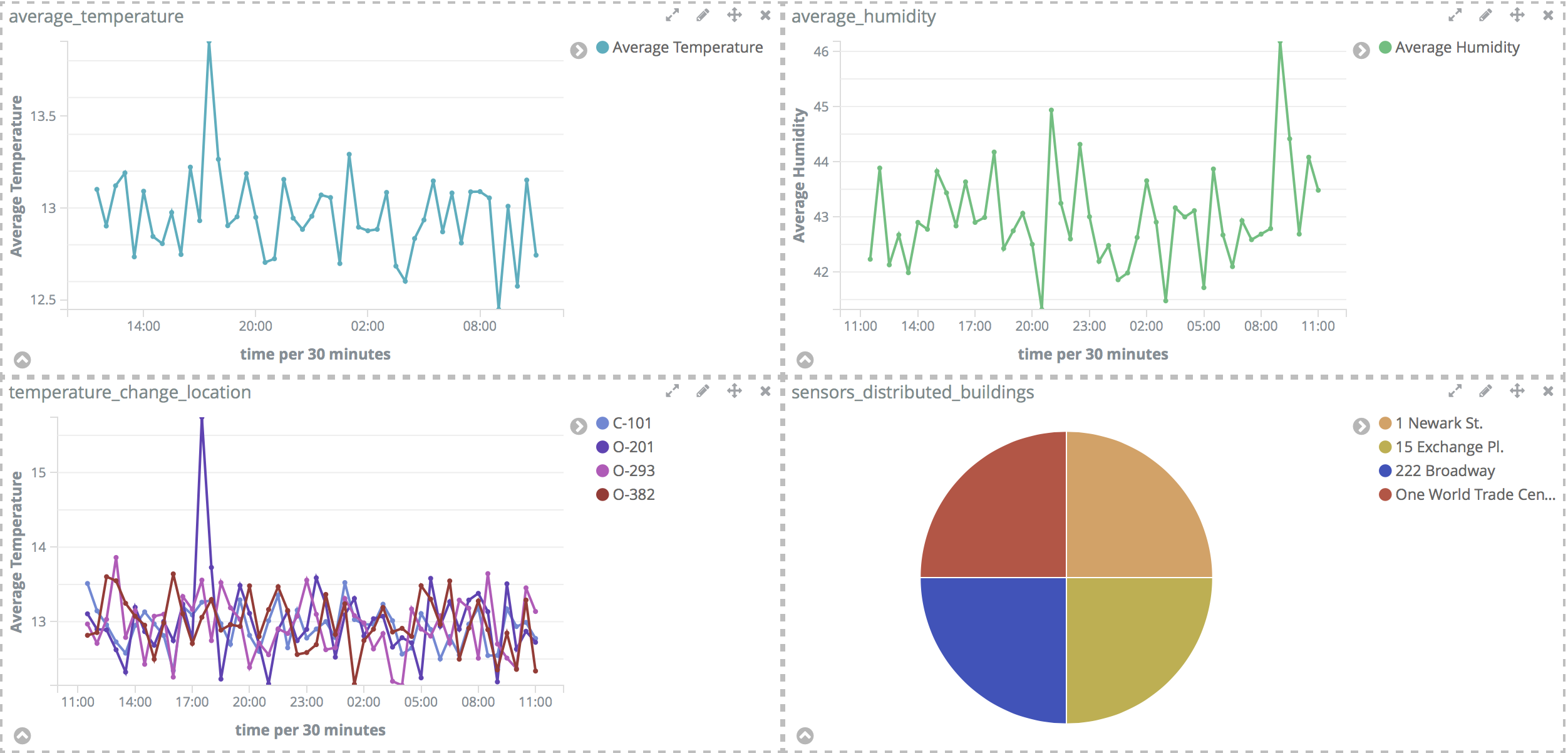

Kibana可视化

打开kibana,在management中新增index pattern:sensor_data*,选择Time Filter field name为time。下面是目标:

- How does the average temperature/humidity change over time?

- How do temperature change at each location over time?

- Can I visualize temperature and humidity over a map?(地图精度有限)

- How are the sensors distributed across buildings?

基于ELK的传感器数据分析练习的更多相关文章

- 基于ELK的简单数据分析

原文链接: http://www.open-open.com/lib/view/open1455673846058.html 环境 CentOS 6.5 64位 JDK 1.8.0_20 Elasti ...

- HDInsight-Hadoop现实(两)传感器数据分析

HDInsight-Hadoop现实(两)传感器数据分析 简要 现在,含传感器非常个人和商用设备收集来自物理世界的信息.例如.大多数手机都有 GPS.健身器材可以跟踪的步骤,你去数,恒温控制器可以监视 ...

- 基于ELK进行邮箱访问日志的分析

公司希望能够搭建自己的日志分析系统.现在基于ELK的技术分析日志的公司越来越多,在此也记录一下我利用ELK搭建的日志分析系统. 系统搭建 系统主要是基于elasticsearch+logstash+f ...

- (数据科学学习手札74)基于geopandas的空间数据分析——数据结构篇

本文对应代码已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 geopandas是建立在GEOS.GDAL.P ...

- (数据科学学习手札75)基于geopandas的空间数据分析——坐标参考系篇

本文对应代码已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 在上一篇文章中我们对geopandas中的数据结 ...

- (数据科学学习手札77)基于geopandas的空间数据分析——文件IO

本文对应代码和数据已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 在上一篇文章中我们对geopandas中的 ...

- (数据科学学习手札78)基于geopandas的空间数据分析——基础可视化

本文对应代码和数据已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 通过前面的文章,我们已经对geopanda ...

- (数据科学学习手札79)基于geopandas的空间数据分析——深入浅出分层设色

本文对应代码和数据已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 通过前面的文章,我们已经对geopanda ...

- (数据科学学习手札82)基于geopandas的空间数据分析——geoplot篇(上)

本文示例代码和数据已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 在前面的基于geopandas的空间数据分 ...

随机推荐

- insert,extend

#insert s = ['8','9','sfd',('45','00'),{'01':'56'}] s0 = [] while 1 : extend = input("请输入要添加的内容 ...

- FPGA学习笔记(八)—— 状态机设计实例之独立按键消抖

###### [该随笔中部分内容转载自小梅哥] ######### 独立按键消抖自古以来在单片机和FPGA中都是个不可避免的问题,首先,解释一下什么叫做按键抖动,如图,按键在按下和松开的那个瞬间存在大 ...

- Jmeter关联,正则表达式提取器使用1

Jmeter关联,正则表达式提取器使用 一.Jmeter关联的方式: Jmeter中关联可以在需要获取数据的请求上 右键-->后置处理器 选择需要的关联方式,如下图有很多种方法可以提取动态 ...

- JavaEE JDBC 了解JNDI

了解JNDI @author ixenos Web与企业应用中的连接管理 1. 数据库连接方式: (1)使用配置文件 (2)使用JNDI 2. 在Web或企业环境中部署 JDBC应用时,数据库连接管理 ...

- HDU 1525 Euclid Game

题目大意: 给定2个数a , b,假定b>=a总是从b中取走一个a的整数倍,也就是让 b-k*a(k*a<=b) 每人执行一步这个操作,最后得到0的人胜利结束游戏 (0,a)是一个终止态P ...

- poj 1330lca模板题离线算法

#include<iostream> #include<vector> using namespace std; const int MAX=10001; int pre[MA ...

- [K/3Cloud] 创建一个单据转换插件

概念: 创建一个业务单据转换插件,在单据转换的各个时点干预单据转换的相关逻辑控制. 示例: 新建一个类,继承自单据转换插件基类Kingdee.BOS.Core.Metadata.ConvertElem ...

- Thinkphp5.0 的视图view的比较标签

Thinkphp5.0 的视图view的比较标签 {eq name="a" value="10"} <p>相等</p> {else/} ...

- 组队训练1 回放(转载至cxhscst2's blog)

第一场组队训练……意料之中的爆炸. 开场先看题,H是斐波那契水题,qw把H切了. 同时czy看I题(排列),cst继续读其他题. czy尝试交I,PE. cst发现K是水题. cst上来敲K,WA ...

- sql将日期按照年月分组并统计数量

SELECT DATE_FORMAT(releaseDate,"%Y年%m月") AS dates,COUNT(*) FROM t_diary GROUP BY DATE_FORM ...