使用Scrapy自带的ImagesPipeline下载图片,并对其进行分类。

ImagesPipeline是scrapy自带的类,用来处理图片(爬取时将图片下载到本地)用的。

优势:

- 将下载图片转换成通用的JPG和RGB格式

- 避免重复下载

- 缩略图生成

- 图片大小过滤

- 异步下载

- ......

工作流程:

- 爬取一个Item,将图片的URLs放入

image_urls字段 - 从

Spider返回的Item,传递到Item Pipeline - 当

Item传递到ImagePipeline,将调用Scrapy 调度器和下载器完成image_urls中的url的调度和下载。 - 图片下载成功结束后,图片下载路径、url和校验和等信息会被填充到images字段中。

实现方式:

- 自定义pipeline,优势在于可以重写ImagePipeline类中的实现方法,可以根据情况对照片进行分类;

- 直接使用ImagePipeline类,简单但不够灵活;所有的图片都是保存在full文件夹下,不能进行分类

实践:爬取http://699pic.com/image/1/这个网页下的前四个图片集(好进行分类演示)

这里使用方法一进行实现:

步骤一:建立项目与爬虫

1.创建工程:scrapy startproject xxx(工程名)

2.创建爬虫:进去到上一步创建的目录下:scrapy genspider xxx(爬虫名) xxx(域名)

步骤二:创建start.py

from scrapy import cmdline

cmdline.execute("scrapy crawl 699pic(爬虫名)".split(" "))

步骤三:设置settings

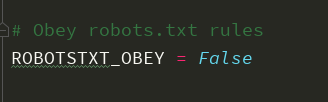

1.关闭机器人协议,改成False

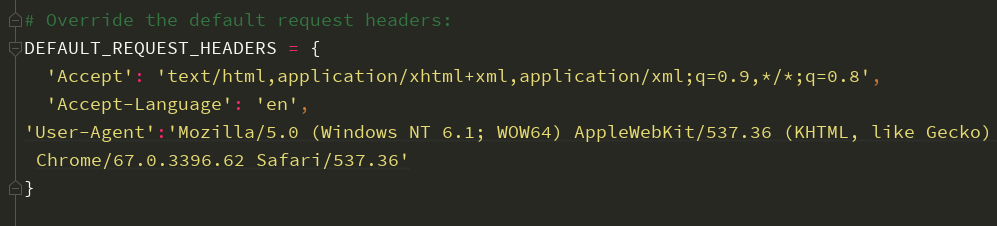

2.设置headers

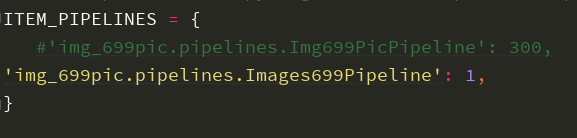

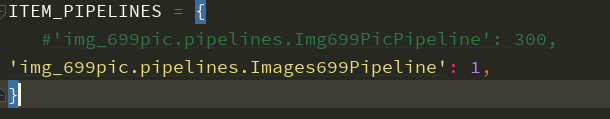

3.打开ITEM_PIPELINES

将项目自动生成的pipelines注释掉,黄色部分是下面步骤中自己写的pipeline,这里先不写。

步骤四:item

class Img699PicItem(scrapy.Item):

# 分类的标题

category=scrapy.Field()

# 存放图片地址

image_urls=scrapy.Field()

# 下载成功后返回有关images的一些相关信息

images=scrapy.Field()

步骤五:写spider

import scrapy

from ..items import Img699PicItem

import requests

from lxml import etree class A699picSpider(scrapy.Spider):

name = '699pic'

allowed_domains = ['699pic.com']

start_urls = ['http://699pic.com/image/1/']

headers={

'User-Agent':'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/67.0.3396.62 Safari/537.36'

} def parse(self, response):

divs=response.xpath("//div[@class='special-list clearfix']/div")[0:4]

for div in divs:

category=div.xpath("./a[@class='special-list-title']//text()").get().strip()

url=div.xpath("./a[@class='special-list-title']/@href").get().strip()

image_urls=self.parse_url(url)

item=Img699PicItem(category=category,image_urls=image_urls)

yield item def parse_url(self,url):

response=requests.get(url=url,headers=self.headers)

htmlElement=etree.HTML(response.text)

image_urls=htmlElement.xpath("//div[@class='imgshow clearfix']//div[@class='list']/a/img/@src")

return image_urls

步骤六:pipelines

import os

from scrapy.pipelines.images import ImagesPipeline

from . import settings class Img699PicPipeline(object):

def process_item(self, item, spider):

return item class Images699Pipeline(ImagesPipeline):

def get_media_requests(self, item, info):

# 这个方法是在发送下载请求之前调用的,其实这个方法本身就是去发送下载请求的

request_objs=super(Images699Pipeline, self).get_media_requests(item,info)

for request_obj in request_objs:

request_obj.item=item

return request_objs def file_path(self, request, response=None, info=None):

# 这个方法是在图片将要被存储的时候调用,来获取这个图片存储的路径

path=super(Images699Pipeline, self).file_path(request,response,info)

category=request.item.get('category')

image_store=settings.IMAGES_STORE

category_path=os.path.join(image_store,category)

if not os.path.exists(category_path):

os.makedirs(category_path)

image_name=path.replace("full/","")

image_path=os.path.join(category_path,image_name)

return image_path

步骤七:返回到settings中

1.将黄色部分填上

2.存放图片的总路径

IMAGES_STORE=os.path.join(os.path.dirname(os.path.dirname(__file__)),'images')

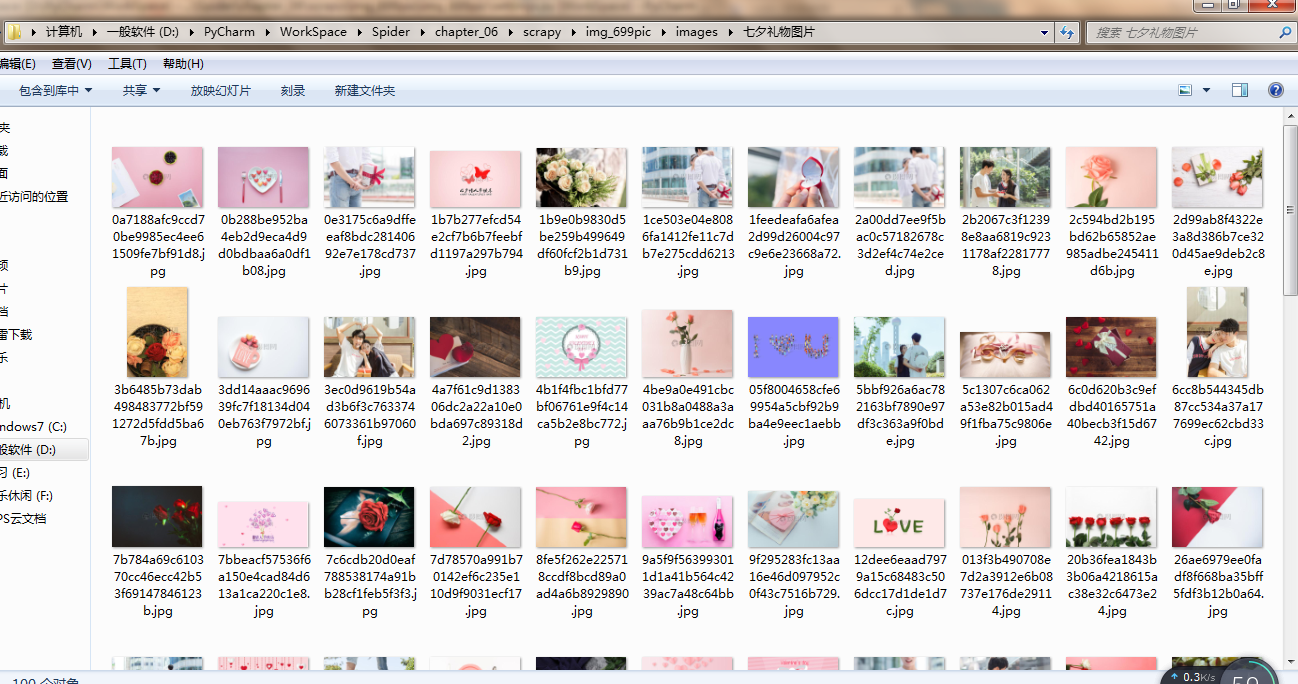

最终结果:

使用Scrapy自带的ImagesPipeline下载图片,并对其进行分类。的更多相关文章

- 通过scrapy内置的ImagePipeline下载图片到本地、并提取本地保存地址

1.通过scrapy内置的ImagePipeline下载图片到本地 2.获取图片保存本地的地址 1.通过scrapy内置的ImagePipeline下载图片到本地 1)在settings.py中打开 ...

- Scrapy框架学习 - 使用内置的ImagesPipeline下载图片

需求分析需求:爬取斗鱼主播图片,并下载到本地 思路: 使用Fiddler抓包工具,抓取斗鱼手机APP中的接口使用Scrapy框架的ImagesPipeline实现图片下载ImagesPipeline实 ...

- 使用 Scrapy 的 ImagesPipeline 下载图片

下载 百度贴吧-动漫壁纸吧 所有图片 定义item Spider spider 只需要得到图片的url,必须以列表的形式给管道处理 class PictureSpiderSpider(scrapy.S ...

- (二)scrapy 中如何自定义 pipeline 下载图片

这里以一个很简单的小爬虫为例,爬取 壹心理 网站的阅读页面第一页的所有文章及其对应的图片,文章页面如下: 创建项目 首先新建一个 scrapy 项目,安装好相关依赖(步骤可参考:scrapy 安装及新 ...

- scrapy 在爬取过程中抓取下载图片

先说前提,我不推荐在sarapy爬取过程中使用scrapy自带的 ImagesPipeline 进行下载,是在是太耗时间了 最好是保存,在使用其他方法下载 我这个是在 https://blog.csd ...

- scrapy中的ImagePipeline下载图片到本地、并提取本地的保存地址

通过scrapy内置到ImagePipeline下载图片到本地 在settings中打开 ITEM_PIPELINES的注释,并在这里面加入 'scrapy.pipelines.images.Imag ...

- 使用官方组件下载图片,保存到MySQL数据库,保存到MongoDB数据库

需要学习的地方,使用官方组件下载图片的用法,保存item到MySQL数据库 需要提前创建好MySQL数据库,根据item.py文件中的字段信息创建相应的数据表 1.items.py文件 from sc ...

- 使用scrapy框架爬取图片网全站图片(二十多万张),并打包成exe可执行文件

目标网站:https://www.mn52.com/ 本文代码已上传至git和百度网盘,链接分享在文末 网站概览 目标,使用scrapy框架抓取全部图片并分类保存到本地. 1.创建scrapy项目 s ...

- 用Scrapy爬虫下载图片(豆瓣电影图片)

用Scrapy爬虫的安装和入门教程,这里有,这篇链接的博客也是我这篇博客的基础. 其实我完全可以直接在上面那篇博客中的代码中直接加入我要下载图片的部分代码的,但是由于上述博客中的代码已运行,已爬到快九 ...

随机推荐

- Android学习笔记_6_保存文件到SDCard

一.加入访问sdcard的权限 Environment.getExternalStorageState()方法用于获取SDCard的状态,如果手机装有SDCard,并且可以进行读写,那么方法返回的状态 ...

- 表达式过滤器 lowercase

<!DOCTYPE html><html><head><meta http-equiv="Content-Type" content=&q ...

- js面向对象编程——创建对象

JavaScript对每个创建的对象都会设置一个原型,指向它的原型对象. 当我们用obj.xxx访问一个对象的属性时,JavaScript引擎先在当前对象上查找该属性,如果没有找到,就到其原型对象上找 ...

- Mysql jar包

密码cngb https://pan.baidu.com/share/init?surl=bSGA6T-LTwjx-qaNAiipCA

- ios应用数据存储方式(归档) - 转

一.简单说明 1.在使用plist进行数据存储和读取,只适用于系统自带的一些常用类型才能用,且必须先获取路径相对麻烦. 2.偏好设置(将所有的东西都保存在同一个文件夹下面,且主要用于存储应用的设置 ...

- Object C学习笔记20-结构体(转)

在学习Object C中的过程中,关于struct的资料貌似非常少,查阅了C方面的资料总结了一些学习心得! 一. 定义结构 结构体是一种数据类型的组合和数据抽象.结构体的定义语法如下: struct ...

- 小a和uim之大逃离(dp)

题目背景 小a和uim来到雨林中探险.突然一阵北风吹来,一片乌云从北部天边急涌过来,还伴着一道道闪电,一阵阵雷声.刹那间,狂风大作,乌云布满了天空,紧接着豆大的雨点从天空中打落下来,只见前方出现了一个 ...

- Java基础题:集合、String、性能、线程

转载自:Java基础题 https://yq.aliyun.com/articles/601786?utm_content=m_1000001149

- 03 mysql补充 (进阶)

增加字段 alter table tb1 add age int first; 增加到第一 alter table tb1 add sex int after id; # 改变位置,id是字段名字 a ...

- FPGA算法学习(1) -- Cordic(圆周系统之向量模式)

旋转模式用来解决三角函数,实现极坐标到直角坐标的转换,基础理论请参考Cordic算法--圆周系统之旋转模式.那么,向量模式则用来解决反三角函数的问题,体现的应用主要是直角坐标向极坐标转换,即已知一点的 ...