ELK日志分析系统(2)-logspout收集容器日志

1. 概述

安装了ELK之后,就是要考虑怎么获取log数据了。

收集log数据的方式有很多种:

1). beats采集数据发布到logstash

2). Filebeat采集数据发布到logstash

3). logspout, 自动把docker下的所有容器的所有日志发布到logstash

4). python logstash库直接发布日志到logstash

5). 原始容器日志记录的目录作为一个卷(volume),并且让其他容器使用--volumes-from选项来继承这个卷

6). 容器日志docker run --log-driver=syslog --log-opt syslog-address=tcp://:5000

考虑到4-6多多少少都要修改业务代码,不够逻辑分离,暂时不考虑;1-2研究了下安装比3麻烦,所以最后采用3的方式来收集容器日志

2. 服务管理

2.1. github地址

https://github.com/gliderlabs/logspout

2.1. docker部署

sudo docker run -d --name="logspout" --volume=/var/run/docker.sock:/var/run/docker.sock --volume=/etc/hostname:/etc/host_hostname:ro --publish=192.168.1.165:8000:80 -e LOGSPOUT=ignore gliderlabs/logspout syslog+tcp://192.168.1.165:5001

本身的日志是没有意义的,所以这边会禁止logspout, -e LOGSPOUT=ignore

收集到的日志会转发到logstash的5001端口:syslog+tcp://192.168.1.165:5001

logspout支持查看所有收集到的日志,地址是:http://192.168.1.165:8000/logs

查看容器:

b929e22ee74c gliderlabs/logspout "/bin/logspout syslo…" 2 days ago Up 31 hours 192.168.1.165:8000->80/tcp logspout

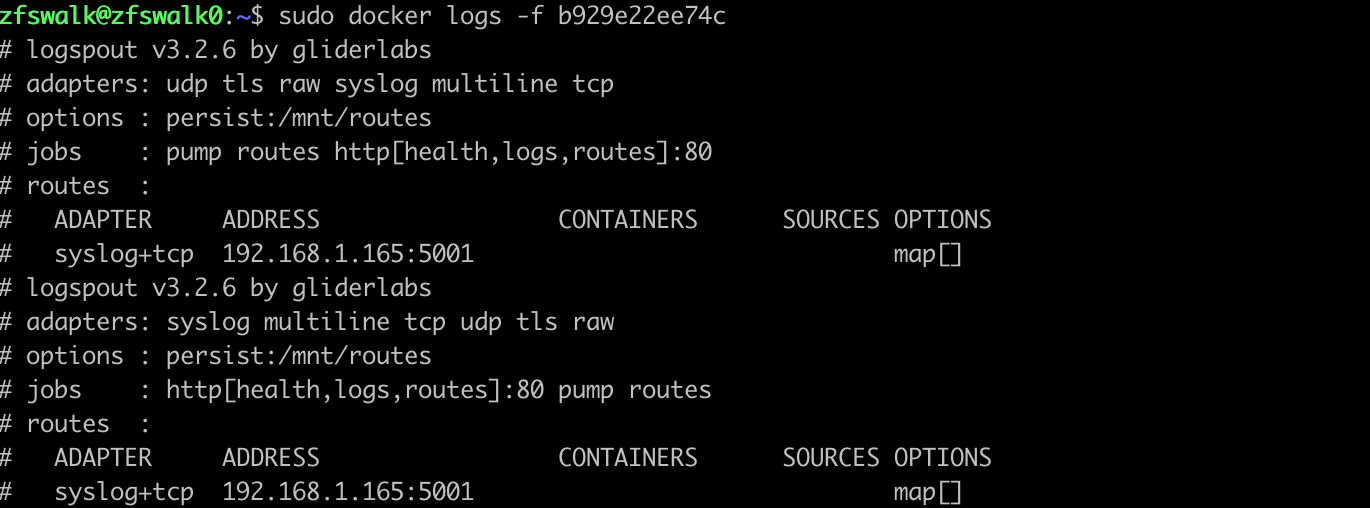

查看容器日志:

3. logspout忽略设置

只要安装了logspout,那么这个主机上面的所有容器的日志都会被收集,如果想日志不被收集给容器设置环境变量LOGSPOUT=ignore

3.1. docker部署

sudo docker run -d -e LOGSPOUT=ignore xxxxxx

3.2. docker-compose部署

services:

elasticsearch:

build:

context: elasticsearch/

args:

ELK_VERSION: $ELK_VERSION

volumes:

- type: bind

source: ./elasticsearch/config/elasticsearch.yml

target: /usr/share/elasticsearch/config/elasticsearch.yml

read_only: true

- type: volume

source: elasticsearch

target: /usr/share/elasticsearch/data

ports:

- "9200:9200"

- "9300:9300"

environment:

ES_JAVA_OPTS: "-Xms1g -Xmx3g"

ELASTIC_PASSWORD: changeme

LOGSPOUT: ignore

networks:

- elk

ELK日志分析系统(2)-logspout收集容器日志的更多相关文章

- centos7搭建EFK日志分析系统

前言 EFK可能都不熟悉,实际上EFK是大名鼎鼎的日志系统ELK的一个变种 在没有分布式日志的时候,每次出问题了需要查询日志的时候,需要登录到Linux服务器,使用命令cat -n xxxx|grep ...

- docker:搭建ELK 开源日志分析系统

ELK 是由三部分组成的一套日志分析系统, Elasticsearch: 基于json分析搜索引擎,Elasticsearch是个开源分布式搜索引擎,它的特点有:分布式,零配置,自动发现,索引自动分片 ...

- [原创]ubuntu14.04部署ELK+redis日志分析系统

ubuntu14.04部署ELK+redis日志分析系统 [环境] host1:172.17.0.4 搭建ELK+redis服务 host2:172.17.0.3 搭建logstash+nginx服务 ...

- Kubernetes部署ELK并使用Filebeat收集容器日志

本文的试验环境为CentOS 7.3,Kubernetes集群为1.11.2,安装步骤参见kubeadm安装kubernetes V1.11.1 集群 1. 环境准备 Elasticsearch运行时 ...

- ELK日志分析系统简单部署

1.传统日志分析系统: 日志主要包括系统日志.应用程序日志和安全日志.系统运维和开发人员可以通过日志了解服务器软硬件信息.检查配置过程中的错误及错误发生的原因.经常分析日志可以了解服务器的负荷,性能安 ...

- Rsyslog+ELK日志分析系统

转自:https://www.cnblogs.com/itworks/p/7272740.html Rsyslog+ELK日志分析系统搭建总结1.0(测试环境) 因为工作需求,最近在搭建日志分析系统, ...

- Rsyslog+ELK日志分析系统搭建总结1.0(测试环境)

因为工作需求,最近在搭建日志分析系统,这里主要搭建的是系统日志分析系统,即rsyslog+elk. 因为目前仍为测试环境,这里说一下搭建的基础架构,后期上生产线再来更新最后的架构图,大佬们如果有什么见 ...

- 十分钟搭建和使用ELK日志分析系统

前言 为满足研发可视化查看测试环境日志的目的,准备采用EK+filebeat实现日志可视化(ElasticSearch+Kibana+Filebeat).题目为“十分钟搭建和使用ELK日志分析系统”听 ...

- ELK日志分析系统-Logstack

ELK日志分析系统 作者:Danbo 2016-*-* 本文是学习笔记,参考ELK Stack中文指南,链接:https://www.gitbook.com/book/chenryn/kibana-g ...

随机推荐

- 自古逢秋悲寂寥,奈何今秋热成雕?Python使用Pyecharts统计全国温度Top10并绘图

秋词-刘禹锡 自古逢秋悲寂寥, 我言秋日胜春朝. 晴空一鹤排云上, 便引诗情到碧霄. 古人谈及秋天,都是悲凉寂寥,那么-.我好想回到古代的秋天啊!明明到了秋天,为什么最近的气温比夏天还热. 之前做天气 ...

- Python之HTTP协议

HTTP协议,又称超文本传输协议,主要用于浏览器与服务器之间的通信. HTTP 协议的制作者是蒂姆·伯纳斯-李,1991年设计出来的,HTTP 协议设计之前目的是传输网页数据的,现在允许传输任意类型的 ...

- Android 中的Activity、Window、View之间的关系

一.概述 Activity 可以说是应用程序的载体(也可以理解为界面的载体,但是不界面),用户能够在上面绘制界面(Activity本身不绘制界面),并提供用户处理事件的API,维护应用程序的生命周 ...

- eclipse svn 问题记录

1. 标记为合并,则是 舍弃的是资源库中的文件:覆盖,则是 舍弃本地文件

- iOS导出远程推送所需要的P12 或pem文件

http://www.saitjr.com/ios/ios-export-remote-notification-p12-pem-file.html iOS导出远程推送所需要的P12 或pem文件 h ...

- Geoserver2.15.1 配置自带 GeoWebCache 插件发布 ArcGIS Server 瓦片(附配置好的 Geoserver2.15.1 下载)

之前写过一篇关于 Geoserver2.8.5 版本的部署配置发布 ArcGIS Server 瓦片点击查看,那是下载 Geoserver2.8.5 源码编译,重新打包 jar 来部署配置思路的,版本 ...

- 2019CCPC秦皇岛D题 Decimal

Decimal Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 131072/131072 K (Java/Others)Total S ...

- html小工具——文章注释编辑器

在网上阅读文章时,读者时常会想针对某段文字写一些自己的感想,可惜大部分阅读网站并不提供这样的功能,读者往往只能将文本复制到本地或在线的编辑器中编辑注释,之后如果想在其他地方回顾这些注释也必须先本地安装 ...

- ssh jail

useradd -s /sbin/nologin -M updateuserpasswd updateusermkdir /home/updatechown root:root /home/updat ...

- PHP函数CURL分别以GET、POST方式请求HTTPS协议接口api

1.curl以GET方式请求https协议接口 function curl_get_https($url){ $curl = curl_init(); // 启动一个CURL会话 curl_setop ...