Scrapy项目创建以及目录详情

Scrapy项目创建已经目录详情

一、新建项目(scrapy startproject)

- 在开始爬取之前,必须创建一个新的Scrapy项目。进入自定义的项目目录中,运行下列命令:

PS C:\scrapy> scrapy startproject sp1

You can start your first spider with:

cd sp1

scrapy genspider example example.com

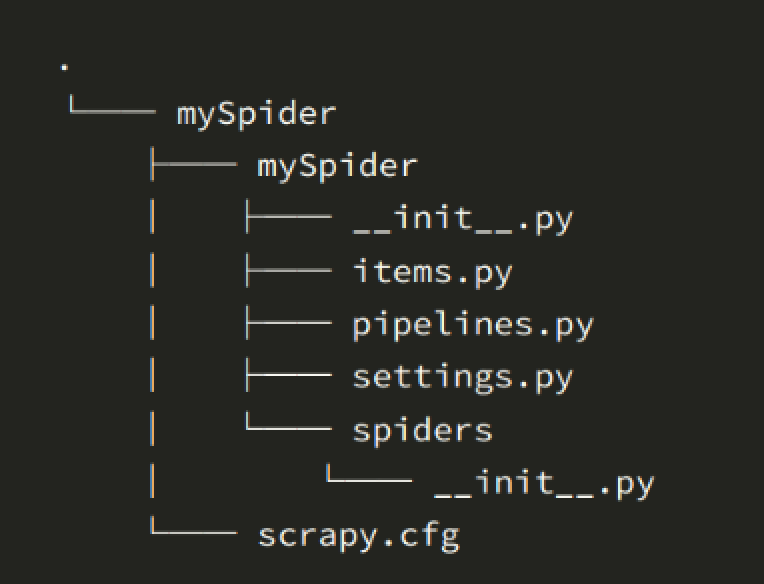

- scrapy.cfg # 项目的配置文件

- sp1/ # 项目的Python模块,将会从这里引用代码

- sp1/items.py # 项目的目标文件

- sp1/pipelines.py # 项目的管道文件用于文件持久化

- sp1/settings.py # 项目的设置文件

- sp1/middlewares.py # 中间件

- sp1/spiders/ # 存储爬虫代码目录

settings.py内容详情

settings.py

# 项目名

BOT_NAME = 'sp1'

# 爬虫所在的位置

SPIDER_MODULES = ['sp1.spiders']

NEWSPIDER_MODULE = 'sp1.spiders'

# 爬虫是否遵循 robots 协议

ROBOTSTXT_OBEY = False

# 爬虫的并发量 默认 16 个

# CONCURRENT_REQUESTS = 32

# 下载延时 3 s

#DOWNLOAD_DELAY = 3

# 是否禁用cookies 默认不禁用

#COOKIES_ENABLED = False # 表示为禁用

# 请求包头

DEFAULT_REQUEST_HEADERS = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/64.0.3282.186 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

# 语言可以关闭,按照服务器返回值为准

# 'Accept-Language': 'en',

}

# 下载中间件,值越小优先级越高

DOWNLOADER_MIDDLEWARES = {

'sp1.middlewares.Sp1DownloaderMiddleware': 543,

}

# 下载后的数据如何处理,存储过程

ITEM_PIPELINES = {

'sp1.pipelines.FilePipeline': 300,

}

创建一个爬虫文件

在当前目录下输入命令,将在sp1/spider目录下创建一个名为itcast的爬虫,并指定爬取域的范围:

PS C:\scrapy> cd sp1

# scrapy genspider关键字 chouti 爬虫名 chouti.com 一般指定站点域名

PS C:\scrapy\sp1> scrapy genspider chouti chouti.com

Created spider 'chouti' using template 'basic' in module:

sp1.spiders.chouti

通过pycharm调试scrapy项目

1.使用pycharm打开项目

2.在项目等级目录创建main.py

from scrapy.cmdline import execute

import sys

import os

BASE_DIR = os.path.dirname(os.path.abspath(__file__))

print(BASE_DIR)

execute(["scrapy","crawl","chouti"])

Scrapy项目创建以及目录详情的更多相关文章

- Python Scrapy项目创建(基础普及篇)

在使用Scrapy开发爬虫时,通常需要创建一个Scrapy项目.通过如下命令即可创建 Scrapy 项目: scrapy startproject ZhipinSpider 在上面命令中,scrapy ...

- IDEA中Java项目创建lib目录并生成依赖

首先介绍说明一下idea在创建普通的Java项目,是没有lib文件夹的,下面我来带大家来创建一下1.右键点击项目,创建一个普通的文件夹 2.取名为lib 3.把项目所需的jar包复制到lib文件夹下 ...

- 创建第一个Scrapy项目

d:进入D盘 scrapy startproject tutorial建立一个新的Scrapy项目 工程的目录结构: tutorial/ scrapy.cfg # 部署配置文件 tutorial/ # ...

- Scrapy项目结构分析和工作流程

新建的空Scrapy项目: spiders目录: 负责存放继承自scrapy的爬虫类.里面主要是用于分析response并提取返回的item或者是下一个URL信息,每个Spider负责处理特定的网站或 ...

- 【pycharm基本操作】项目创建、切换、运行、字体颜色设置,常见包的安装步骤

创建新项目 退出项目 怎样区别虚拟环境和系统环境? 虚拟环境和系统环境切换:进入项目切换解释器 切换项目 创建python目录和文件 代码运行方式一: 还可以这样执行代码方式二: 文件的剪切.复制.删 ...

- pycharm创建scrapy项目教程及遇到的坑

最近学习scrapy爬虫框架,在使用pycharm安装scrapy类库及创建scrapy项目时花费了好长的时间,遇到各种坑,根据网上的各种教程,花费了一晚上的时间,终于成功,其中也踩了一些坑,现在整理 ...

- eclipse创建scrapy项目

1. 您必须创建一个新的Scrapy项目. 进入您打算存储代码的目录中(比如否F:/demo),运行下列命令: scrapy startproject tutorial 2.在eclipse中创建一个 ...

- Python -- Scrapy 框架简单介绍(Scrapy 安装及项目创建)

Python -- Scrapy 框架简单介绍 最近在学习python 爬虫,先后了解学习urllib.urllib2.requests等,后来发现爬虫也有很多框架,而推荐学习最多就是Scrapy框架 ...

- Scrapy库安装和项目创建

Scrapy是一个流行的网络爬虫框架,从现在起将陆续记录Python3.6下Scrapy整个学习过程,方便后续补充和学习.本文主要介绍scrapy安装.项目创建和测试基本命令操作 scrapy库安装 ...

随机推荐

- listView从底部回到顶部代码实现

可用如下方法: 1.平滑的回到顶部,但是会划过中间的每一页 mListView.getRefreshableView().smoothScrollToPosition(0); 2.直接跳到顶部 if ...

- 3. Python 字典 常用办法总结

Python字典客储存任意类型的对象,如字符串.数字.元祖.列表.字典.bool等. 优点:取值方便,速度快 1.创建字典 字典由键(key)和对应值(value)成对组成. 字典也被称作关联数组或哈 ...

- 【转】Python之mmap内存映射模块(大文本处理)说明

[转]Python之mmap内存映射模块(大文本处理)说明 背景: 通常在UNIX下面处理文本文件的方法是sed.awk等shell命令,对于处理大文件受CPU,IO等因素影响,对服务器也有一定的压力 ...

- linux驱动 之 module_init解析 (上)【转】

转自:https://blog.csdn.net/Richard_LiuJH/article/details/45669207 版权声明:本文为博主原创文章,未经博主允许不得转载. https://b ...

- Linux内存分配小结--malloc、brk、mmap【转】

转自:https://blog.csdn.net/gfgdsg/article/details/42709943 http://blog.163.com/xychenbaihu@yeah/blog/s ...

- Windows PowerShell 入門(10)-デバッグ編

対象読者 Windows PowerShellでコマンドレット操作ができる方 何らかのプログラミング経験があればなお良い 必要環境 Windows PowerShell デバッグメッセージの出力 Po ...

- 计算机中内存、cache和寄存器之间的关系及区别

1. 寄存器是中央处理器内的组成部份.寄存器是有限存贮容量的高速存贮部件,它们可用来暂存指令.数据和位址.在中央处理器的控制部件中,包含的寄存 器有指令寄存器(IR)和程序计数器(PC).在中央处理器 ...

- 016_把普通用户免秘钥加入root用户的几种方式

一.第一种方式. (1) [root@infra-jyallkv-tikv-pps-7 ~]# tail /etc/sudoers## Allows members of the users grou ...

- Linux查看所有用户和组信息

主要通过以下两个命令: cat /etc/passwd cat /etc/group 步骤一:cat /etc/passwd查看所有的用户信息,详情如下图: 步骤2:cat /etc/passwd|g ...

- jetty去掉项目名称访问

对于web项目,访问路径是否包含项目名称等修改访问路径的配置方式: 我所使用的是maven进行管理,只需要在pom.xml中进行如下配置 <!-- jetty插件 jetty:run--> ...