Spark-寒假-实验4

1.spark-shell 交互式编程

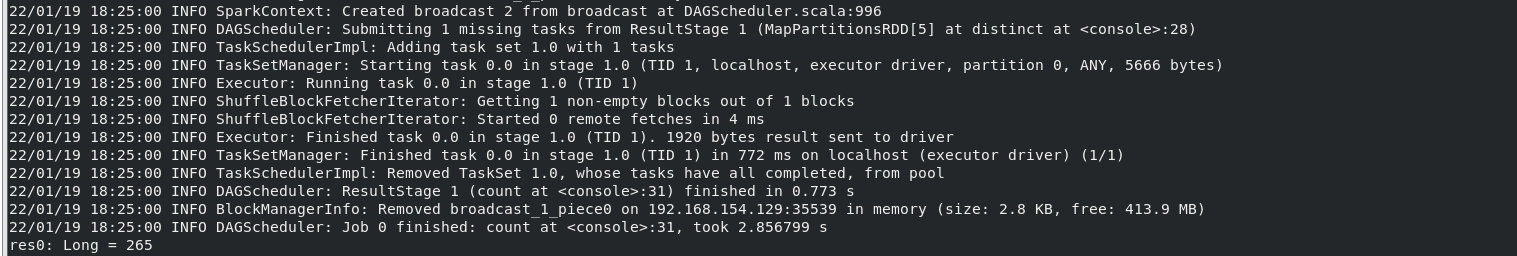

(1)该系总共有多少学生;

执行命令:

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var par=tests.map(row=>row.split(",")(0))

var distinct_par=par.distinct()

distinct_par.count

结果:

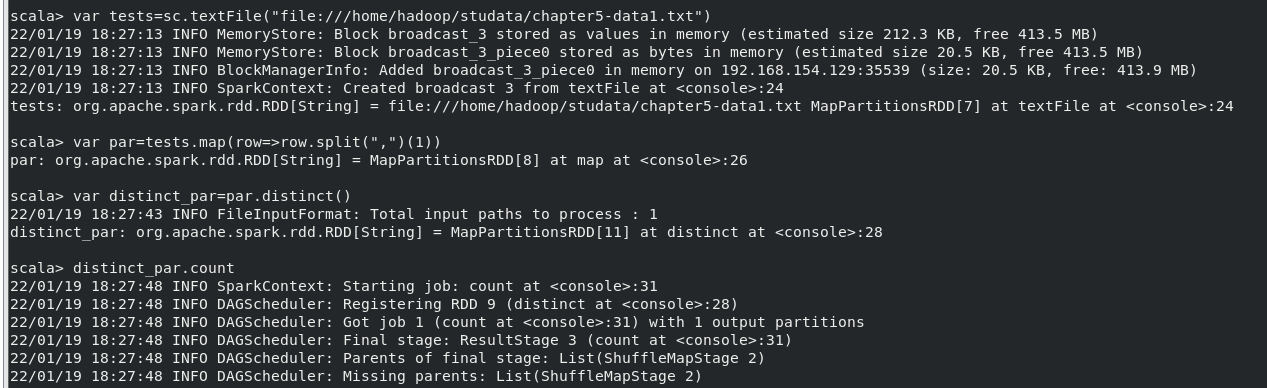

(2)该系共开设来多少门课程;

执行命令:

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var par=tests.map(row=>row.split(",")(1))

var distinct_par=par.distinct()

distinct_par.count

结果:

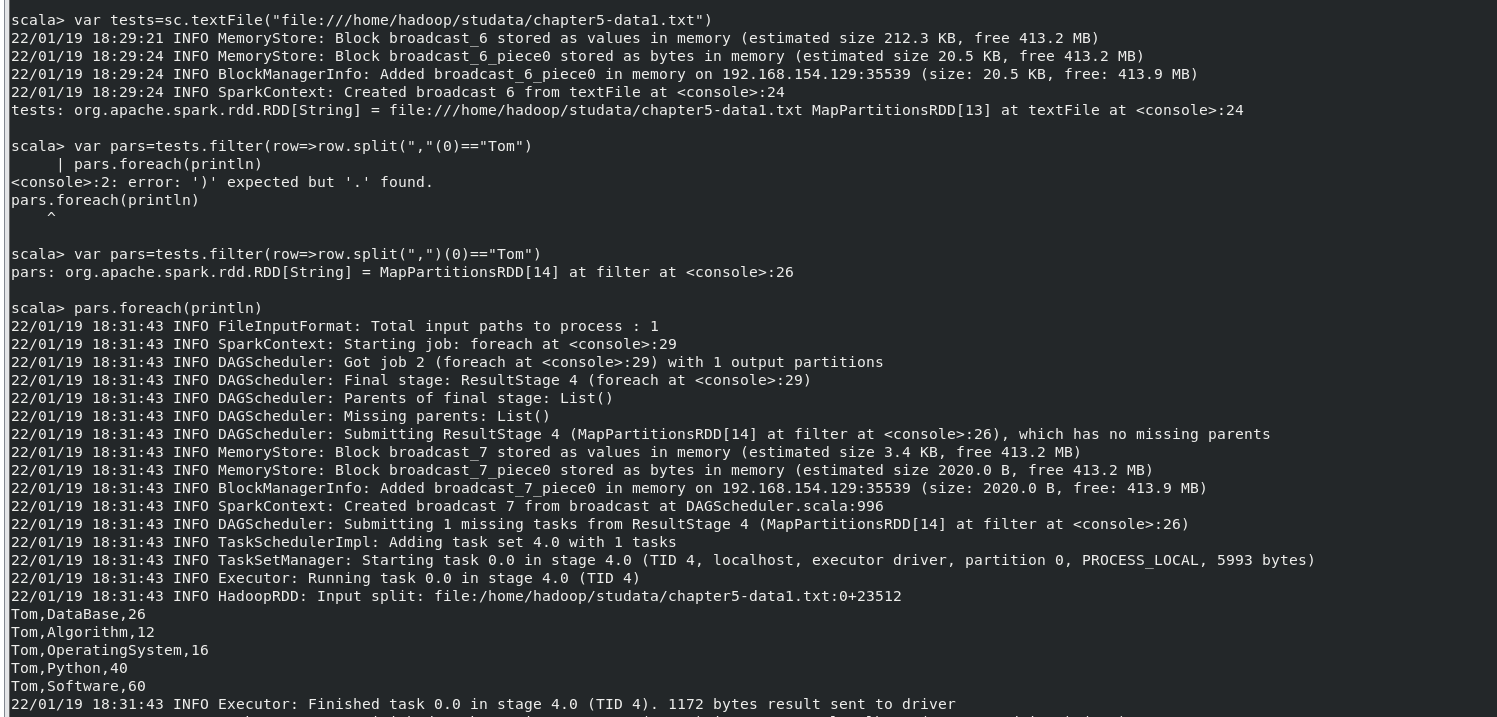

(3)Tom 同学的总成绩平均分是多少;

执行命令:

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var pars=tests.filter(row=>row.split(",")(0)=="Tom")

pars.foreach(println)

结果:

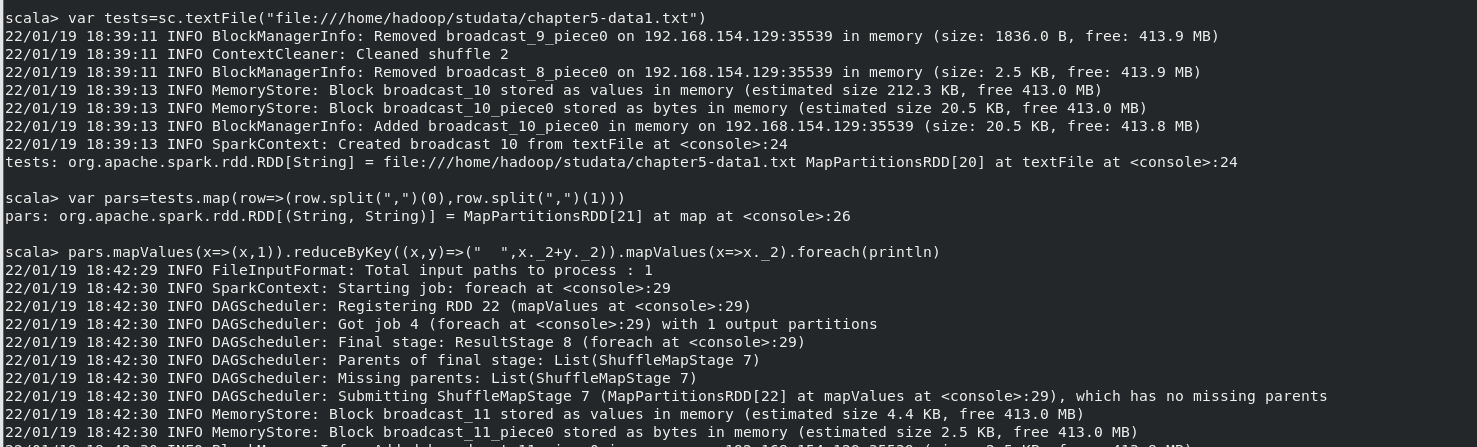

(4)求每名同学的选修的课程门数;

执行命令:

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var pars=tests.map(row=>(row.split(",")(0),row.split(",")(1)))

pars.mapValues(x=>(x,1)).reduceByKey((x,y)=>(" ",x._2+y._2)).mapValues(x=>x._2).foreach(println)

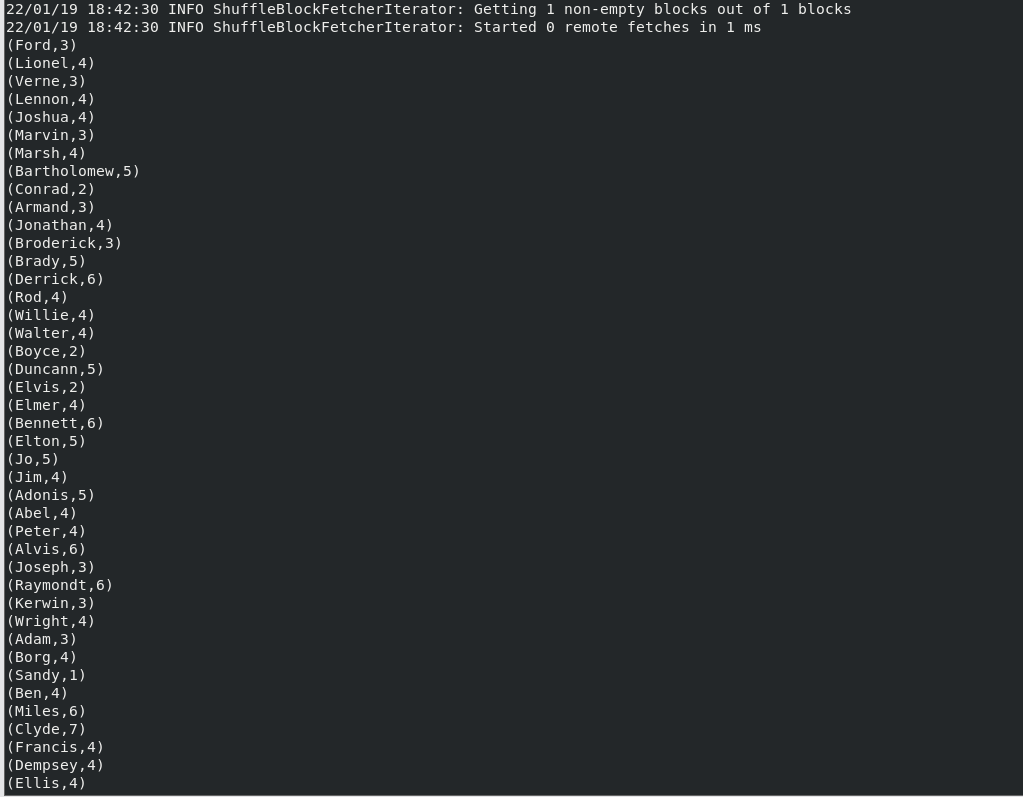

结果(此处仅为部分结果,结果共265项):

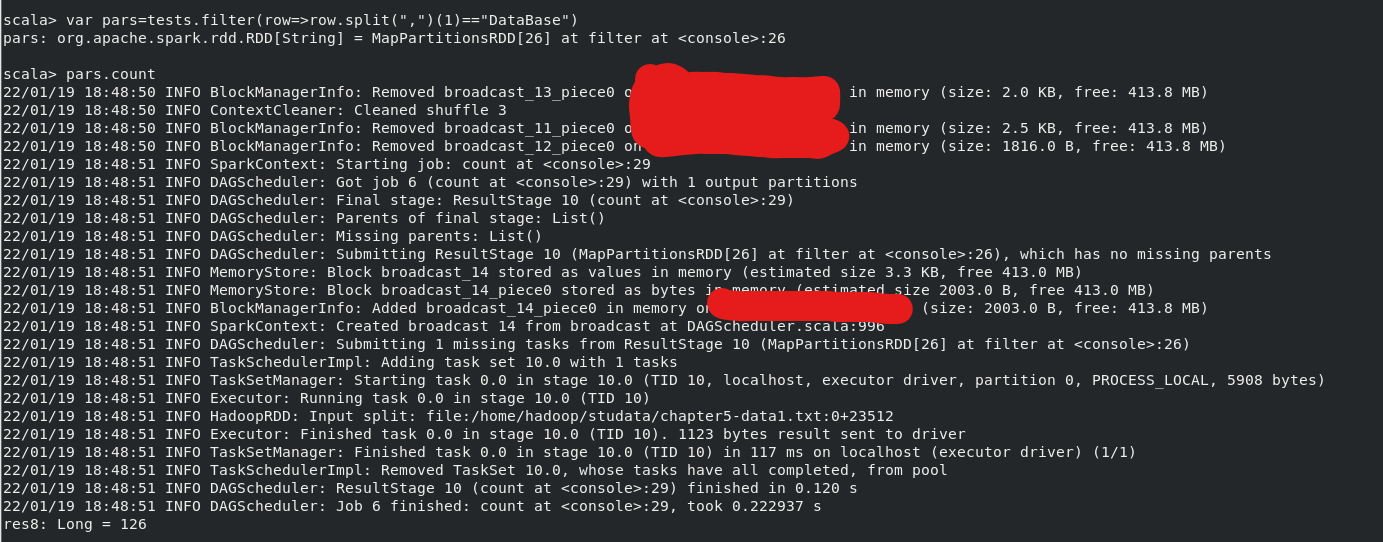

(5)该系 DataBase 课程共有多少人选修;

执行命令(结果最后一行):

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var pars=tests.filter(row=>(row.split(",")(1)=="Database"))

pars.count

(6)各门课程的平均分是多少;

执行命令:

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var pars=tests.map(row=>(row.split(",")(1),row.split(",")(2).toInt))

pars.mapValues(x=>(x,1)).reduceByKey((x,y)=>(x._1+y._1,x._2+y._2)).mapValues(x=>(x._1/x._2)).collect()

结果:

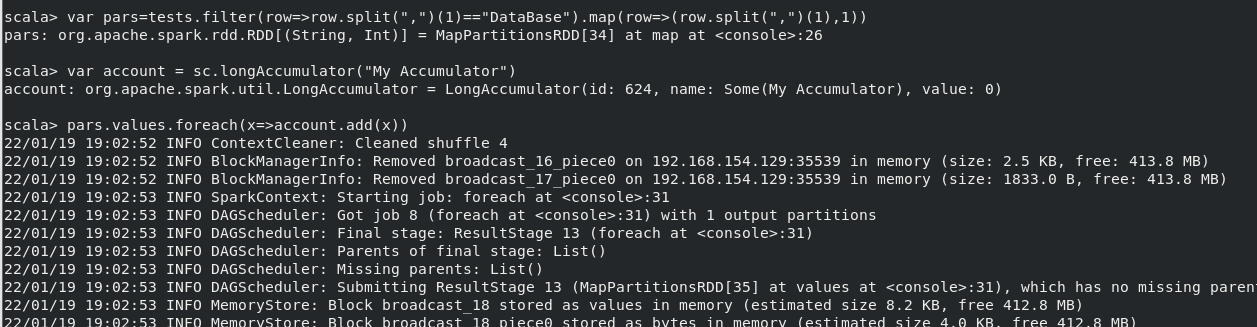

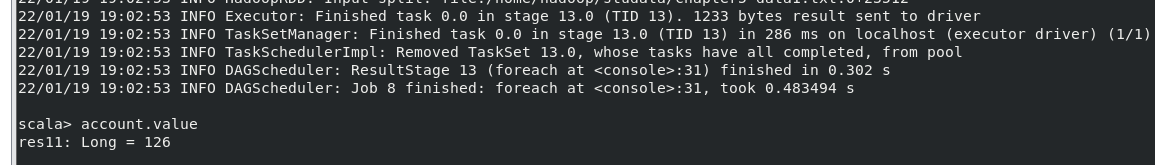

(7)使用累加器计算共有多少人选了 DataBase 这门课。

执行命令:

var tests=sc.textFile("file:///home/hadoop/studata/chapter5-data1.txt")

var pars=tests.filter(row=>(row.split(",")(1)=="Database")).map(row=>(row.split(",")(1),1))

var account=sc.longAccumulator("My Accumulator")

pars.values.foreach(x=>account.add(x))

结果:

2.编写独立应用程序实现数据去重

对于两个输入文件 A 和 B,编写 Spark 独立应用程序,对两个文件进行合并,并剔除其 中重复的内容,得到一个新文件 C。下面是输入文件和输出文件的一个样例,供参考。 输入文件 A 的样例如下:

20170101 x

20170102 y

20170103 x

20170104 y

20170105 z

20170106 z

输入文件 B 的样例如下:

20170101 y

20170102 y

20170103 x

20170104 z

20170105 y

根据输入的文件 A 和 B 合并得到的输出文件 C 的样例如下:

20170101 x

20170101 y

20170102 y

20170103 x

20170104 y

20170104 z

20170105 y

20170105 z

20170106 z

创建项目:

remdup.scala

import org.apache.spark.SparkContext

import org.apache.spark.SparkContext._

import org.apache.spark.SparkConf

import org.apache.spark.HashPartitioner

object RemDup {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName("RemDup")

val sc = new SparkContext(conf)

val A = sc.textFile("file:///home/hadoop/studata/A.txt")

val B = sc.textFile("file:///home/hadoop/studata/B.txt")

val C = A.union(B).distinct().sortBy(x => x,true)

C.foreach(println)

sc.stop()

}

}

simple.sbt

name := "RemDup Project"

version := "1.0"

scalaVersion := "2.11.8"

libraryDependencies += "org.apache.spark" %% "spark-core" % "2.1.0"

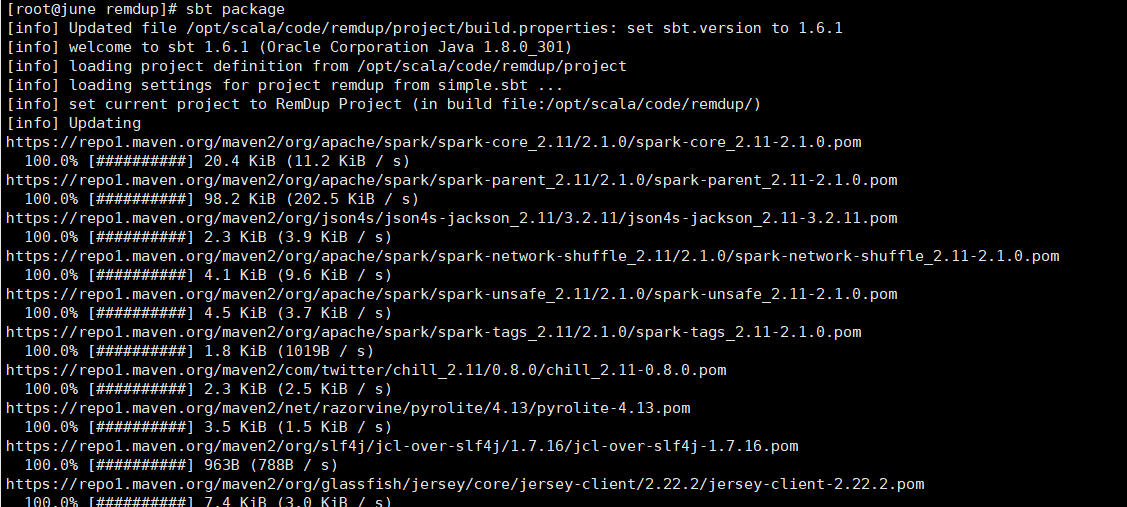

打包项目(sbt的安装请看Spark-寒假-实验3):

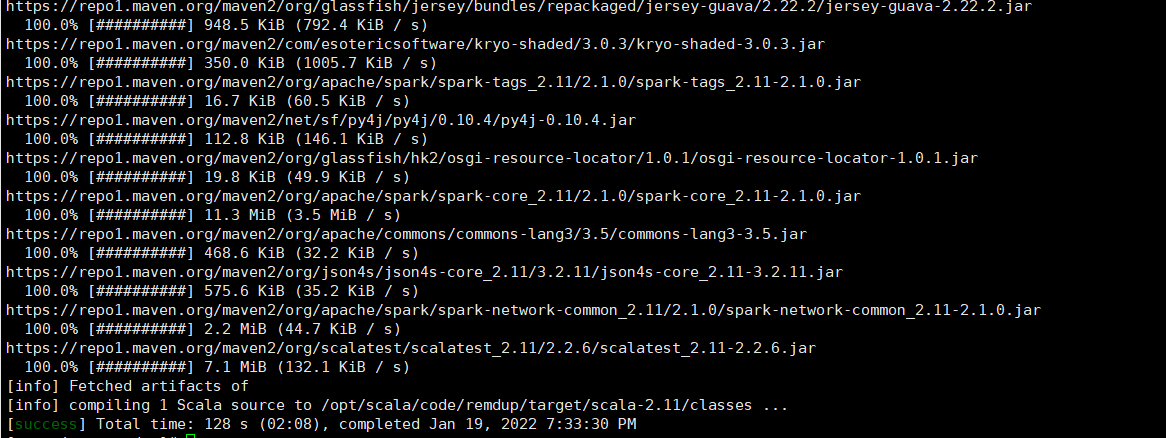

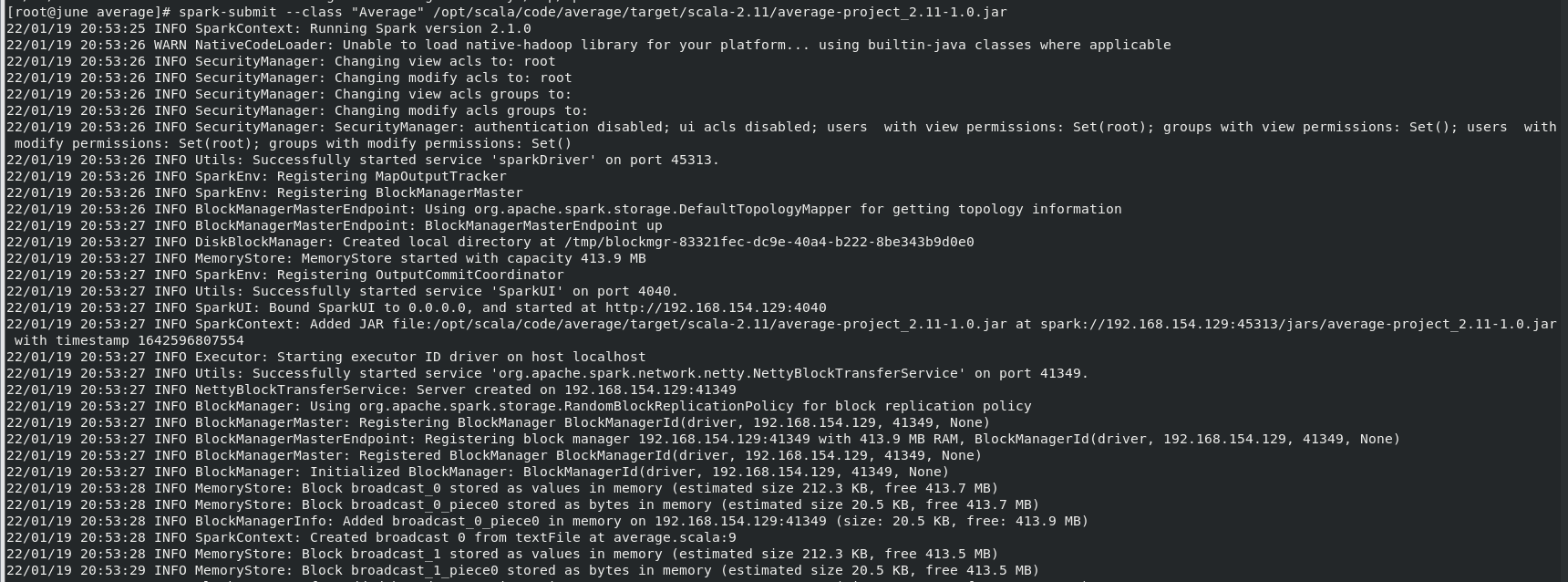

运行jar包:

运行结果:

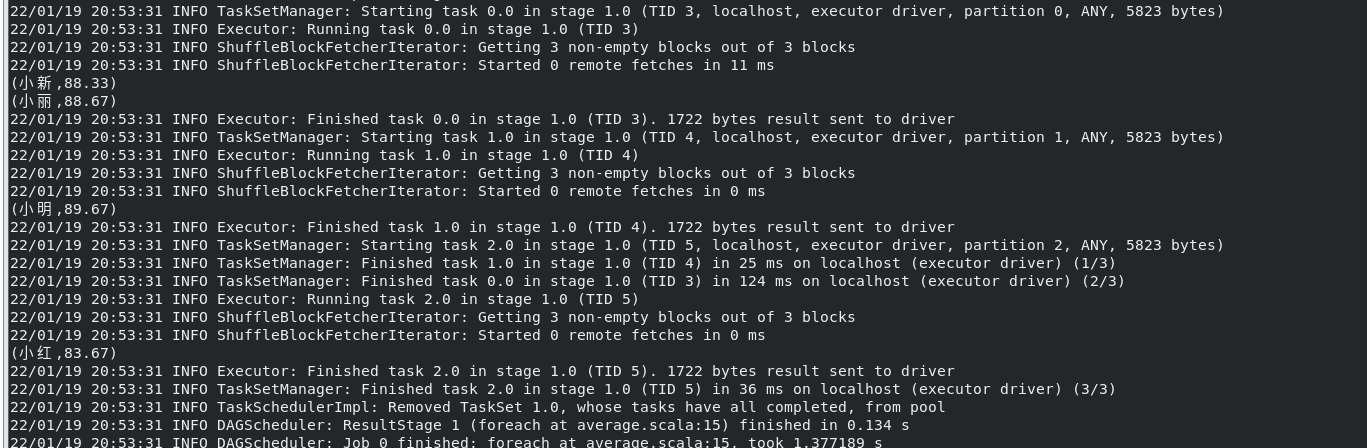

3.编写独立应用程序实现求平均值问题

创建项目流程同上:

程序代码如下:

average.scala

import org.apache.spark.SparkContext

import org.apache.spark.SparkContext._

import org.apache.spark.SparkConf

import org.apache.spark.HashPartitioner

object Average {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName("Average")

val sc = new SparkContext(conf)

val Algorimm = sc.textFile("file:///home/hadoop/studata/Algorimm.txt")

val DataBase = sc.textFile("file:///home/hadoop/studata/DataBase.txt")

val Python = sc.textFile("file:///home/hadoop/studata/Python.txt")

val allGradeAverage = Algorimm.union(DataBase).union(Python)

val stuArrayKeyValue = allGradeAverage.map(x=>(x.split(" ")(0),x.split(" ")(1).toDouble)).mapValues(x=>(x,1))

val totalGrade = stuArrayKeyValue.reduceByKey((x,y) => (x._1+y._1,x._2+y._2))

val averageGrade = totalGrade.mapValues(x=>(x._1.toDouble/x._2.toDouble).formatted("%.2f")).foreach(println)

sc.stop()

}

}

simple.sbt

name := "Average Project"

version := "1.0"

scalaVersion := "2.11.8"

libraryDependencies += "org.apache.spark" %% "spark-core" % "2.1.0"

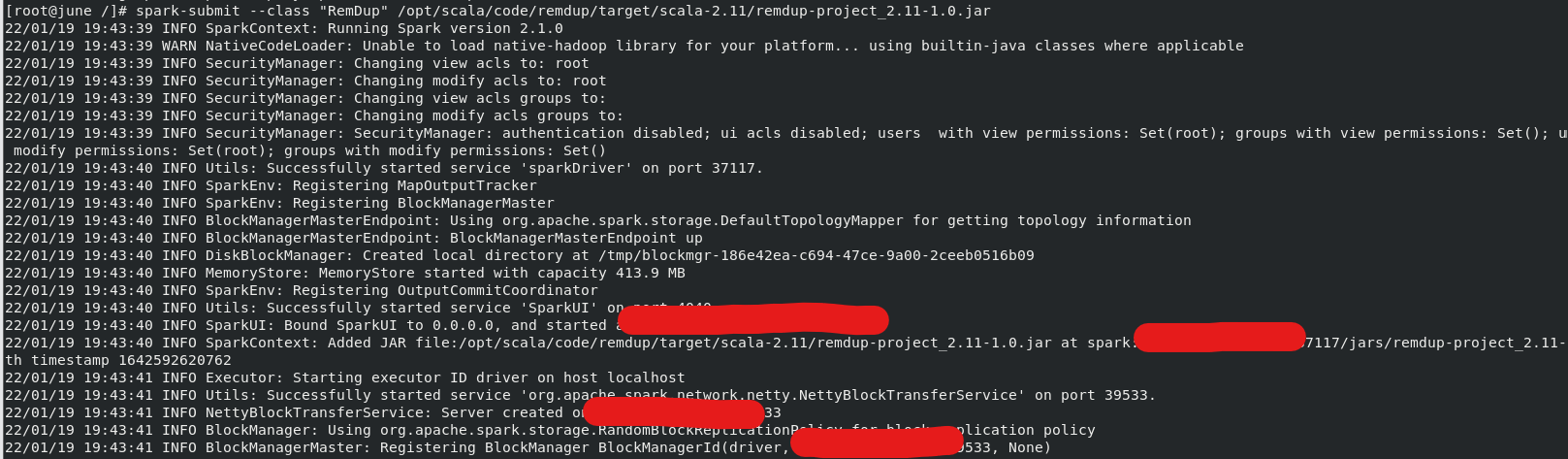

打包项目:

运行jar包:

运行结果:

Spark-寒假-实验4的更多相关文章

- Spark基础实验七

今天在做实验七,最开始有许许多多多的错误,最后通过查找.问同学才知道是数据集的格式和存放位置的原因. 就在好不容易解决了上一个错误,下一个错误就立马而来,错误如下: 目前还未找到解决办法,spark实 ...

- 沉淀,再出发——在Hadoop集群的基础上搭建Spark

在Hadoop集群的基础上搭建Spark 一.环境准备 在搭建Spark环境之前必须搭建Hadoop平台,尽管以前的一些博客上说在单机的环境下使用本地FS不用搭建Hadoop集群,可是在新版spark ...

- spark学习及环境配置

http://dblab.xmu.edu.cn/blog/spark/ 厦大数据库实验室博客 总结.分享.收获 实验室主页 首页 大数据 数据库 数据挖掘 其他 子雨大数据之Spark入门教程 林子 ...

- [DE] How to learn Big Data

打开一瞧:50G的文件! emptystacks jobstacks jobtickets stackrequests worker 大数据加数据分析,需要以python+scikit,sql作为基础 ...

- 通过案例对 spark streaming 透彻理解三板斧之一: spark streaming 另类实验

本期内容 : spark streaming另类在线实验 瞬间理解spark streaming本质 一. 我们最开始将从Spark Streaming入手 为何从Spark Streaming切入 ...

- Spark Streaming和Flume-NG对接实验

Spark Streaming是一个新的实时计算的利器,而且还在快速的发展.它将输入流切分成一个个的DStream转换为RDD,从而可以使用Spark来处理.它直接支持多种数据源:Kafka, Flu ...

- 在阿里云上搭建 Spark 实验平台

在阿里云上搭建 Spark 实验平台 Hadoop2.7.3+Spark2.1.0 完全分布式环境 搭建全过程 [传统文化热爱者] 阿里云服务器搭建spark特别坑的地方 阿里云实现Hadoop+Sp ...

- 实验5 Spark SQL编程初级实践

今天做实验[Spark SQL 编程初级实践],虽然网上有答案,但都是用scala语言写的,于是我用java语言重写实现一下. 1 .Spark SQL 基本操作将下列 JSON 格式数据复制到 Li ...

- 2019寒假训练营第三次作业part2 - 实验题

热身题 服务器正在运转着,也不知道这个技术可不可用,万一服务器被弄崩了,那损失可不小. 所以, 决定在虚拟机上试验一下,不小心弄坏了也没关系.需要在的电脑上装上虚拟机和linux系统 安装虚拟机(可参 ...

- 1.Spark Streaming另类实验与 Spark Streaming本质解析

1 Spark源码定制选择从Spark Streaming入手 我们从第一课就选择Spark子框架中的SparkStreaming. 那么,我们为什么要选择从SparkStreaming入手开始我们 ...

随机推荐

- 尚硅谷SSM-CRUD实战Demo

SSM-CRUD实战项目 1. 项目总览 SpringMVC + Spring + MyBatis CRUD:增删改查 功能: 分页 数据校验 jquery前端校验+JSR303后端校验 ajax R ...

- CF1097B Petr and a Combination Lock 题解

Content 有一个锁,它只有指针再次指到 \(0\) 刻度处才可以开锁(起始状态如图所示,一圈 \(360\) 度). 以下给出 \(n\) 个操作及每次转动度数,如果可以通过逆时针或顺时针再次转 ...

- LuoguB2029 大象喝水 题解

Update \(\texttt{2021.12.4}\) 修改了原先的错误代码,给各位造成影响,在此表示很抱歉. Content 大象要喝 \(20\) 升水,但现在只有一个深 \(h\) 厘米,半 ...

- CF535A Tavas and Nafas 题解

Content 请输出整数 \(s\) 的英文写法. 数据范围:\(0\leqslant s\leqslant 99\). Solution 直接对应打表即可. 当 \(0\leqslant s\le ...

- 当ligerui的grid出现固定列与非固定列不在同一水平线上时,改怎么处理

当ligerui的grid出现固定列与非固定列不在同一水平线上时,如下图所示: 此时可以增加fixedCellHeight:false属性进行解决.这个属性在IE上不起作用,那么该怎么处理,可以这样处 ...

- ACwing2.01背包问题

题目: 有 N 件物品和一个容量是 V 的背包.每件物品只能使用一次. 第 i 件物品的体积是 vi,价值是 wi. 求解将哪些物品装入背包,可使这些物品的总体积不超过背包容量,且总价值最大. 输出最 ...

- 【LeetCode】LCP 06. 拿硬币

作者: 负雪明烛 id: fuxuemingzhu 个人博客:http://fuxuemingzhu.cn/ 目录 题目描述 题目大意 解题方法 替换 日期 题目地址:https://leetcode ...

- 【LeetCode】944. Delete Columns to Make Sorted 解题报告(Python)

作者: 负雪明烛 id: fuxuemingzhu 个人博客: http://fuxuemingzhu.cn/ 目录 题目描述 题目大意 解题方法 日期 题目地址:https://leetcode.c ...

- 【LeetCode】877. Stone Game 解题报告(Python & C++)

作者: 负雪明烛 id: fuxuemingzhu 个人博客: http://fuxuemingzhu.cn/ 目录 题目描述 题目大意 解题方法 数学 双函数 单函数 + 记忆化递归 动态规划 日期 ...

- hud-5475 An easy problem(线段树)

http://acm.hdu.edu.cn/showproblem.php?pid=5475 An easy problem Time Limit: 8000/5000 MS (Java/Others ...