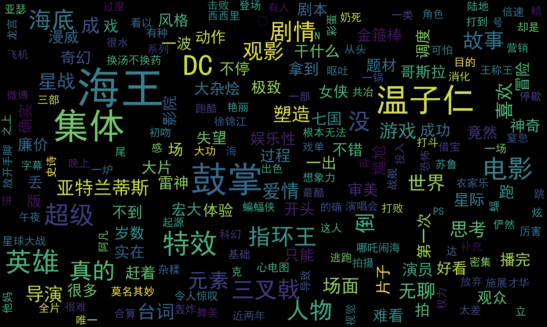

scrapy-redis爬取豆瓣电影短评,使用词云wordcloud展示

1、数据是使用scrapy-redis爬取的,存放在redis里面,爬取的是最近大热电影《海王》

2、使用了jieba中文分词解析库

3、使用了停用词stopwords,过滤掉一些无意义的词

4、使用matplotlib+wordcloud绘图展示

from redis import Redis

import json

import jieba

from wordcloud import WordCloud

import matplotlib.pyplot as plt

# 加载停用词

# stopwords = set(map(lambda x: x.rstrip('\n'), open('chineseStopWords.txt').readlines()))

stopwords = set()

with open('chineseStopWords.txt') as f:

for line in f.readlines():

stopwords.add(line.rstrip('\n'))

stopwords.add(' ')

# print(stopwords)

# print(len(stopwords))

# 读取影评

db = Redis(host='localhost')

items = db.lrange('review:items', 0, -1)

# print(items)

# print(len(items))

# 统计每个word出现的次数

# 过滤掉停用词

# 记录总数,用于计算词频

words = {}

total = 0

for item in items:

data = json.loads(item)['review']

# print(data)

# print('------------')

for word in jieba.cut(data):

if word not in stopwords:

words[word] = words.get(word, 0) + 1

total += 1

print(sorted(words.items(), key=lambda x: x[1], reverse=True))

# print(len(words))

# print(total)

# 词频

freq = {k: v / total for k, v in words.items()}

print(sorted(freq.items(), key=lambda x: x[1], reverse=True))

# 词云

wordcloud = WordCloud(font_path='simhei.ttf',

width=500,

height=300,

scale=10,

max_words=200,

max_font_size=40).fit_words(frequencies=freq) # Create a word_cloud from words and frequencies

plt.imshow(wordcloud, interpolation="bilinear")

plt.axis('off')

plt.show()

绘图结果:

参考:

https://github.com/amueller/word_cloud

http://amueller.github.io/word_cloud/

scrapy-redis爬取豆瓣电影短评,使用词云wordcloud展示的更多相关文章

- Scrapy实战篇(三)之爬取豆瓣电影短评

今天的主要内容是爬取豆瓣电影短评,看一下网友是怎么评价最近的电影的,方便我们以后的分析,以以下三部电影:二十二,战狼,三生三世十里桃花为例. 由于豆瓣短评网页比较简单,且不存在动态加载的内容,我们下面 ...

- python 爬取豆瓣电影短评并wordcloud生成词云图

最近学到数据可视化到了词云图,正好学到爬虫,各种爬网站 [实验名称] 爬取豆瓣电影<千与千寻>的评论并生成词云 1. 利用爬虫获得电影评论的文本数据 2. 处理文本数据生成词云图 第一步, ...

- 基于python的scrapy框架爬取豆瓣电影及其可视化

1.Scrapy框架介绍 主要介绍,spiders,engine,scheduler,downloader,Item pipeline scrapy常见命令如下: 对应在scrapy文件中有,自己增加 ...

- scrapy爬虫框架教程(二)-- 爬取豆瓣电影TOP250

scrapy爬虫框架教程(二)-- 爬取豆瓣电影TOP250 前言 经过上一篇教程我们已经大致了解了Scrapy的基本情况,并写了一个简单的小demo.这次我会以爬取豆瓣电影TOP250为例进一步为大 ...

- scrapy爬取豆瓣电影top250

# -*- coding: utf-8 -*- # scrapy爬取豆瓣电影top250 import scrapy from douban.items import DoubanItem class ...

- Scrapy中用xpath/css爬取豆瓣电影Top250:解决403HTTP status code is not handled or not allowed

好吧,我又开始折腾豆瓣电影top250了,只是想试试各种方法,看看哪一种的方法效率是最好的,一直进行到这一步才知道 scrapy的强大,尤其是和selector结合之后,速度飞起.... 下面我就采用 ...

- scrapy爬虫框架教程(二)-- 爬取豆瓣电影

前言 经过上一篇教程我们已经大致了解了Scrapy的基本情况,并写了一个简单的小demo.这次我会以爬取豆瓣电影TOP250为例进一步为大家讲解一个完整爬虫的流程. 工具和环境 语言:python 2 ...

- urllib+BeautifulSoup无登录模式爬取豆瓣电影Top250

对于简单的爬虫任务,尤其对于初学者,urllib+BeautifulSoup足以满足大部分的任务. 1.urllib是Python3自带的库,不需要安装,但是BeautifulSoup却是需要安装的. ...

- 爬取豆瓣电影TOP 250的电影存储到mongodb中

爬取豆瓣电影TOP 250的电影存储到mongodb中 1.创建项目sp1 PS D:\scrapy> scrapy.exe startproject douban 2.创建一个爬虫 PS D: ...

随机推荐

- Codeforces 999D Equalize the Remainders (set使用)

题目连接:Equalize the Remainders 题意:n个数字,对m取余有m种情况,使得每种情况的个数都为n/m个(保证n%m=0),最少需要操作多少次? 每次操作可以把某个数字+1.输出最 ...

- 蓝牙 link timeout分析

蓝牙主机和蓝牙设备建立连接之后,会在l2cap 层面上建立相应的channel,这些channel 基本上是用于各种不同的profile 或者protocol 进行通信用的. 当相应的profile或 ...

- [尝鲜]妈妈再也不用担心 dotnet core 程序发布了: .NET Core Global Tools

什么是 .NET Core Global Tools? Global Tools是.NET Core 2.1 中一个初次出现的特性.Global Tools提供了一种方法,让开发人员编写的.NET C ...

- 【微服务】使用spring cloud搭建微服务框架,整理学习资料

写在前面 使用spring cloud搭建微服务框架,是我最近最主要的工作之一,一开始我使用bubbo加zookeeper制作了一个基于dubbo的微服务框架,然后被架构师否了,架构师曰:此物过时.随 ...

- slurmdbd.conf系统初始配置

# Archive info ArchiveJobs=yes ArchiveDir=/usr/local/globle/softs/slurm/16.05.3/archive/ ArchiveStep ...

- 2018年高教社杯全国大学生数学建模竞赛A题解题思路

题目 先贴一下A的题目吧 A题 高温作业专用服装设计 在高温环境下工作时,人们需要穿着专用服装以避免灼伤.专用服装通常由三层织物材料构成,记为I.II.III层,其中I层与外界环境接触,III层与 ...

- Dell BOSS 卡是什么

全名: Boot Optimized Storage Solution 针对 M.2 接口的 SSD,主板上必须设计接口进行适配. 设计一款主板对于硬件厂商来说是有成本的,其中包括 主板设计成本 产品 ...

- Jenkins新建项目中源码管理Repository URL使用Git报错:Failed to connect to repository : Command "git ls-remote -h......

之前部署了Gitlab+Gerrit+Jenkins持续集成环境,但在Jenkins中新建项目的源码管理"Repository URL"中添加git地址环节出现了问题,信息为&qu ...

- Linux下的Mongodb部署应用梳理

一.Mongodb简介 官网地址:http://www.mongodb.org/ MongoDB是一个高性能,开源,无模式的文档型数据库,是当前NoSql数据库中比较热门的一种.MongoDB 是一 ...

- NoSuchBeanDefinitionException:No qualifying bean of type

Exception in thread "main" org.springframework.beans.factory.NoSuchBeanDefinitionException ...