论文笔记 - PRISM: A Rich Class of Parameterized Submodular Information Measures for Guided Subset Selection

Motivation

与 Active Learning 类似,Target Learning 致力于 挑选外卖更“感兴趣”的数据,即人为为更重要的数据添加 bias。例如我们当前的任务目标是增强自动驾驶算法的夜间行驶性能,我们就不能单纯从未标注数据集中抽取多样性大的数据,而是要满足黑夜条件的数据。

Guided Summarization 与此类似,在进行 Summarization 的同时,也只抽取用户“感兴趣”感兴趣的内容。例如在各种内容都有的新闻中做体育相关的摘要生成,就要给算法一个与体育相关的 bias。

Guided Summarization 包括两种目标:

- query-focused:抽取的内容要和 query 相关;

- privacy-preserving: 抽取的内容要 避免 privacy 相关的内容。

Analysis

提出三种指标:

- 次模条件增长(Submodular Conditional Gain, CG),越大说明差异越大:

$$f(\mathcal{A}|\mathcal{P})=f(\mathcal{A}\cup\mathcal{P})-f(\mathcal{P})$$

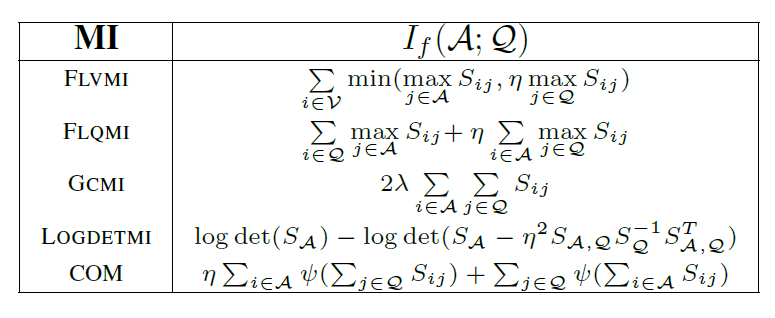

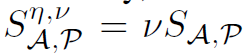

- 次模交互信息(Submodular Mutual Information, MI),越大说明相似性越大:

$$I_f(\mathcal{A};\;\mathcal{Q})=f(\mathcal{A})+f(\mathcal{Q})-f(\mathcal{A}\cup\mathcal{Q})$$

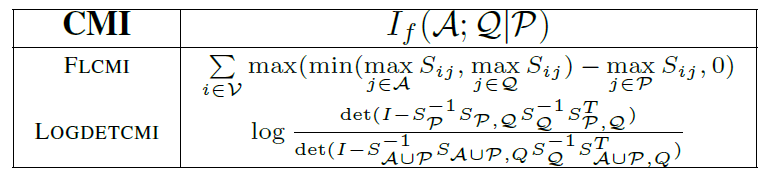

- 次模条件交互信息(Submodular Conditional Mutual Information, CMI),上面二者的结合:

$$I_f(\mathcal{A};\;\mathcal{Q}|\mathcal{P})=f(\mathcal{A}\cup\mathcal{P})+f(\mathcal{Q}\cup\mathcal{P})-f(\mathcal{A}\cup\mathcal{Q}\cup\mathcal{P})-f(\mathcal{P})$$

以上三种次模函数 CG、MI、CMI 均为单调(当其中一个作为参数的子集固定)非负,因此可以用贪心算法求解。

1. 三种实例化方案

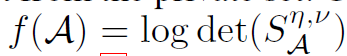

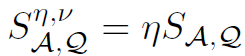

(1) Log Determinant

(2) Facility Location

MI 有两种变体:FLVMI 和 FLQMI(见上图),FLQMI 的好处在于,假如你已经选择了一个 query-relevant 的数据,仍然会选择其他的 query-relevant 数据仍可以使 MI 有所增长。

(3) GrPaph Cut

论文笔记 - PRISM: A Rich Class of Parameterized Submodular Information Measures for Guided Subset Selection的更多相关文章

- 论文笔记 - SIMILAR: Submodular Information Measures Based Active Learning In Realistic Scenarios

motivation Active Learning 存在的重要问题:现实数据极度不平衡,有许多类别很少见(rare),又有很多类别是冗余的(redundancy),又有些数据是 OOD 的(out- ...

- Deep Reinforcement Learning for Visual Object Tracking in Videos 论文笔记

Deep Reinforcement Learning for Visual Object Tracking in Videos 论文笔记 arXiv 摘要:本文提出了一种 DRL 算法进行单目标跟踪 ...

- Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现(转)

Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文, ...

- 论文笔记之:Visual Tracking with Fully Convolutional Networks

论文笔记之:Visual Tracking with Fully Convolutional Networks ICCV 2015 CUHK 本文利用 FCN 来做跟踪问题,但开篇就提到并非将其看做 ...

- Deep Learning论文笔记之(八)Deep Learning最新综述

Deep Learning论文笔记之(八)Deep Learning最新综述 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文,但老感觉看完 ...

- Twitter 新一代流处理利器——Heron 论文笔记之Heron架构

Twitter 新一代流处理利器--Heron 论文笔记之Heron架构 标签(空格分隔): Streaming-process realtime-process Heron Architecture ...

- Deep Learning论文笔记之(六)Multi-Stage多级架构分析

Deep Learning论文笔记之(六)Multi-Stage多级架构分析 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些 ...

- Multimodal —— 看图说话(Image Caption)任务的论文笔记(一)评价指标和NIC模型

看图说话(Image Caption)任务是结合CV和NLP两个领域的一种比较综合的任务,Image Caption模型的输入是一幅图像,输出是对该幅图像进行描述的一段文字.这项任务要求模型可以识别图 ...

- 论文笔记(1):Deep Learning.

论文笔记1:Deep Learning 2015年,深度学习三位大牛(Yann LeCun,Yoshua Bengio & Geoffrey Hinton),合作在Nature ...

随机推荐

- SpringBoot中如何使用自带的定时任务

随便创建一个类,@Component交给spring管理,用注解@EnableScheduling,让定时任务生效 方法上加注解:@Scheduled(cron = "你的cron表达式&q ...

- cad开发动态块对应的界面

为了使设计人员更加容易的操作动态块, 应经可能对动态块的制作制定相关的规范, 如动态块的属性 => 类的属性 动态块操作名称(作为变量名,后台数据库的字段) 动态块操作描述 (作为注释,后台数 ...

- java方法---定义,调用

定义,调用 1.方法的定义 方法就是一段用来完成特定功能的代码片段,类似于其它语言的函数. 方法用于定义该类或该类的实例的行为特征和功能实现.方法是类和对象行为特征的抽象. 方法很类似于面向过程中的函 ...

- 【Java】学习路径51-线程组

平时创建线程的时候,系统会默认为线程分组. 我们可以使用 ThreadGroup tg1 = t1.getThreadGroup(); 取得t1的线程组对象. 然后使用getName获得线程组名称. ...

- HCNP Routing&Switching之IP安全

前文我们了解了DHCP安全相关话题,回顾请参考https://www.cnblogs.com/qiuhom-1874/p/16637627.html:今天我们来聊一聊IP安全相关话题: 技术背景 随着 ...

- Python实现XMind测试用例快速转Excel用例

转载请注明出处️ 作者:测试蔡坨坨 原文链接:caituotuo.top/c2d10f21.html 你好,我是测试蔡坨坨. 今天分享一个Python编写的小工具,实现XMind测试用例转Excel用 ...

- KingbaseES V8R6集群维护案例之--单实例数据迁移到集群案例

案例说明: 生产环境是单实例,测试环境是集群,现需要将生产环境的数据迁移到集群中运行,本文档详细介绍了从单实例环境恢复数据到集群环境的操作步骤,可以作为生产环境迁移数据的参考. 适用版本: Kingb ...

- es证书生成方式

./bin/elasticsearch-certutil ca --pem # 生成一个名字叫做elastic-stack-ca.zip的文件 unzip elastic-stack-ca.zip A ...

- 通过堡垒机上传文件报错ssh:没有权限的问题

背景描述 一台有公网IP的主机安装的有jumpserver,假设为A主机,另外几台没有公网ip的主机,假设其中一个为B主机. 操作 1.通过主机A的公网IP和端口等登录到jumpserver的管理员用 ...

- Elasticsearch准实时索引实现(数据写入到es分片并存储到文件中的过程)

溢写到文件系统缓存 当数据写入到ES分片时,会首先写入到内存中,然后通过内存的buffer生成一个segment,并刷到文件系统缓存中,数据可以被检索(注意不是直接刷到磁盘) ES中默认1秒,refr ...