PyTorch : torch.nn.xxx 和 torch.nn.functional.xxx

PyTorch : torch.nn.xxx 和 torch.nn.functional.xxx

在写 PyTorch 代码时,我们会发现在

torch.nn.xxx和torch.nn.functional.xxx中有一些功能重复的操作,比如卷积、激活、池化。这些操作有什么不同?各有什么用处?

首先可以观察源码:

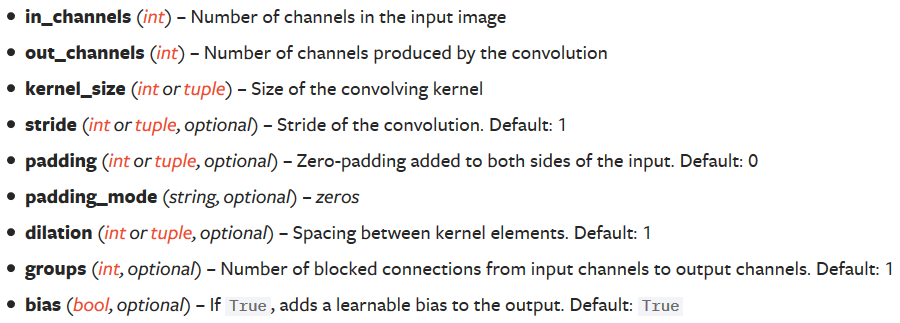

eg:torch.nn.Conv2d

CLASS torch.nn.Conv2d(in_channels, out_channels, kernel_size, stride=1, padding=0, dilation=1, groups=1, bias=True, padding_mode='zeros')

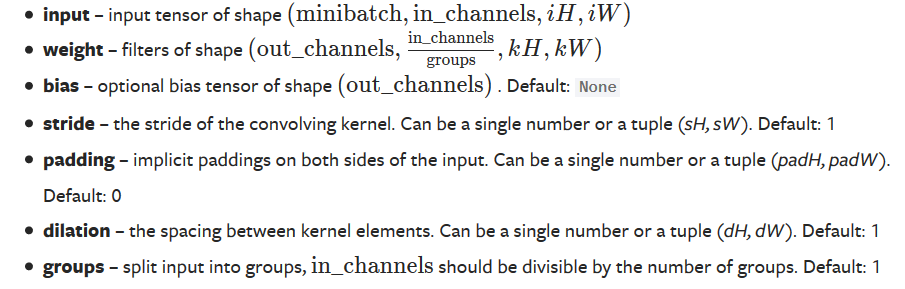

eg:torch.nn.functional

torch.nn.functional.conv2d(input, weight, bias=None, stride=1, padding=0, dilation=1, groups=1) → Tensor

从中,我们可以发现,nn.Conv2d 是一个类,而 nn.functional.conv2d是一个函数。

换言之:

- nn.Module 实现的 layer 是由 class Layer(nn.Module) 定义的特殊类

- nn.functional 中的函数更像是纯函数,由 def function(input) 定义

此外:

两者的调用方式不同:调用 nn.xxx 时要先在里面传入超参数,然后再将数据以函数调用的方式传入 nn.xxx

# torch.nn

inputs = torch.randn(64, 3, 244, 244)

self.conv = nn.Conv2d(in_channels=3, out_channels=64, kernel_size=3, padding=1)

outputs = self.conv(inputs) # torch.nn.functional 需要同时传入数据和 weight,bias等参数

inputs = torch.randn(64, 3, 244, 244)

weight = torch.randn(64, 3, 3, 3)

bias = torch.randn(64)

outputs = nn.functinoal.conv2d(inputs, weight, bias, padding=1)

nn.xxx 能够放在 nn.Sequential里,而 nn.functional.xxx 就不行

nn.functional.xxx 需要自己定义 weight,每次调用时都需要手动传入 weight,而 nn.xxx 则不用

import torch

import torch.nn as nn

import torch.nn.functional as F # torch.nn 定义的CNN

class CNN(nn.Module):

def __init__(self):

super(CNN, self).__init__() self.conv_1 = nn.Conv2d(1, 16, krenel_size=5, padding=0)

self.relu_1 = nn.ReLU(inplace=True)

self.maxpool_1 = nn.MaxPool2d(kernel_size=2) self.conv_2 = nn.Conv2d(16, 32, krenel_size=5, padding=0)

self.relu_2 = nn.ReLU(inplace=True)

self.maxpool_2 = nn.MaxPool2d(kernel_size=2) self.linear = nn.Linear(4*4*32, 10) def forward(self, x):

x = x.view(x.size(0), -1)

out = self.maxpool_1(self.relu_1(self.conv_1(x)))

out = self.maxpool_2(self.relu_2(self.conv_2(out)))

out = self.linear(out.view(x.size(0), -1))

return out # torch.nn.functional 定义一个相同的CNN

class CNN(nn.Module):

def __init__(self):

super(CNN, self).__init__() self.conv_1_weight = nn.Parameter(torch.randn(16, 1, 5, 5))

self.bias_1_weight = nn.Parameter(torch.randn(16)) self.conv_2_weight = nn.Parameter(torch.randn(32, 16, 5, 5))

self.bias_2_weight = nn.Parameter(torch.randn(32)) self.linear_weight = nn.Parameter(torch.randn(4 * 4 * 32, 10))

self.bias_weight = nn.Parameter(torch.randn(10)) def forward(self, x):

x = x.view(x.size(0), -1)

out = F.conv2d(x, self.conv_1_weight, self.bias_1_weight)

out = F.conv2d(out, self.conv_2_weight, self.bias_2_weight)

out = F.linear(out.view(x.size(0), -1), self.linear_weight, self.bias_weight)

在使用Dropout时,推荐使用 nn.xxx。因为一般只有训练时才使用 Dropout,在验证或测试时不需要使用 Dropout。使用 nn.Dropout时,如果调用 model.eval() ,模型的 Dropout 层都会关闭;但如果使用 nn.functional.dropout,在调用 model.eval() 时,不会关闭 Dropout。

当我们想要自定义卷积核时,是不能使用

torch.nn.ConvNd的,因为它里面的权重都是需要学习的参数,没有办法自行定义。但是,我们可以使用torch.nn.functional.conv2d()。

References:

PyTorch : torch.nn.xxx 和 torch.nn.functional.xxx的更多相关文章

- [深度学习] Pytorch学习(二)—— torch.nn 实践:训练分类器(含多GPU训练CPU加载预测的使用方法)

Learn From: Pytroch 官方Tutorials Pytorch 官方文档 环境:python3.6 CUDA10 pytorch1.3 vscode+jupyter扩展 #%% #%% ...

- PyTorch 介绍 | AUTOMATIC DIFFERENTIATION WITH TORCH.AUTOGRAD

训练神经网络时,最常用的算法就是反向传播.在该算法中,参数(模型权重)会根据损失函数关于对应参数的梯度进行调整. 为了计算这些梯度,PyTorch内置了名为 torch.autograd 的微分引擎. ...

- 『PyTorch』第十三弹_torch.nn.init参数初始化

初始化参数的方法 nn.Module模块对于参数进行了内置的较为合理的初始化方式,当我们使用nn.Parameter时,初始化就很重要,而且我们也可以指定代替内置初始化的方式对nn.Module模块进 ...

- [深度学习] Pytorch学习(一)—— torch tensor

[深度学习] Pytorch学习(一)-- torch tensor 学习笔记 . 记录 分享 . 学习的代码环境:python3.6 torch1.3 vscode+jupyter扩展 #%% im ...

- href="javascript:xxx(this);"和onclick="javascript:xxx(this);"的区别

href="javascript:xxx(this);"和onclick="javascript:xxx(this);" 一直以为这两种写法是等同的,今天在项目 ...

- 项目 XXX 的 NuGet 程序包还原失败:找不到“xxx”版本的程序包“xxx”

项目 XXX 的 NuGet 程序包还原失败:找不到“xxx”版本的程序包“xxx” 编译新下载的代码出错 修改包管理器的源为 http://www.nuget.org/api/v2/ .重试后成功 ...

- There is no getter for property named xxx' in 'class java.lang.xxx'

在xxxMapper.xml我们使用sql片段来提高sql代码的复用性,当时新手传入参数时常常出现这样的错误: There is no getter for property named xxx' i ...

- Android JS桥交互("Uncaught ReferenceError: xxx is not defined or xxx has no method")

网上android和js交互的代码有不少,也很容易搜到.最近在做的项目需要用到js桥,遇到了一些问题,记录下来,希望以后遇到能马上解决掉. 一开始我找的demo是从这个:http://blog.csd ...

- git@github.com: Permission denied (publickey).////remote: Permission to xxx/test.git denied to xxx.等权限问题

Error msg git@github.com: Permission denied (publickey) 或者: remote: Permission to xxx/test.git denie ...

随机推荐

- python post接口测试第一个用例日记

如下是我自己公司的一个请求,学习过程顺便记录下,都是白话语言,不那么专业,不喜勿喷! 首先看下图,post请求一般需要填写参数url, data(一般是表格类型的参数,如我们智联驾驶APP登录的参数) ...

- Android 开发使用自定义字体

有时候,系统自带的字体并不能满足我们特殊的需求,这时候就需要引用其他的字体了,可以把下载的字体文件放在 assets 目录下. 自定义字体文件不能使用xml代码读取而应该使用java代码: publi ...

- java的properties文件从数据库添加到文件

package com.xian.jdbc; import java.io.BufferedInputStream; import java.io.FileInputStream; import ja ...

- Go组件学习——gorm四步带你搞定DB增删改查

1.简介 ORM Object-Relationl Mapping, 它的作用是映射数据库和对象之间的关系,方便我们在实现数据库操作的时候不用去写复杂的sql语句,把对数据库的操作上升到对于对象的操作 ...

- 3. 源码分析---SOFARPC客户端服务调用

我们首先看看BoltClientProxyInvoker的关系图 所以当我们用BoltClientProxyInvoker#invoke的时候实际上是调用了父类的invoke方法 ClientProx ...

- Java equal() 和 == 详细分析

1 == 返回值是true/false; (1) 基本数据类型比较的就是值(2)引用型数据类型就是地址值 public class Test1 { public static void main(S ...

- python3 编译安装

前言: Linux下大部分系统默认自带python2.x的版本,最常见的是python2.6或python2.7版本,默认的python被系统很多程序所依赖,比如centos下的yum就是python ...

- npm 一些有用的提示和技巧

生成 package.json 我们通常执行 npm init,然后开始添加 npm 请求的信息. 但是,如果我们不关心所有这些信息,并且希望保留默认值,那么对于 npm 请求的每一条数据,我们都按 ...

- python3学习-pickle模块

pickle提供了一个简单的持久化功能.可以将对象以文件的形式存放在磁盘上. 基本接口: pickle.dump(obj, file, [,protocol]) 注解:将对象obj保存到文件file中 ...

- jmh源码解析-整体架构

我理解的jmh运行架构图 生成字节码,字节码负责维护测试的状态和调用被测试的方法 默认在fork的进程中进行测试,可以配置多个fork进程,以减少误差 通过线程池,提交每个迭代的测试任务,任务执行后, ...