RelationNet:学习目标间关系来增强特征以及去除NMS | CVPR 2018

论文基于NLP的注意力机制提出了目标关系模块,通过与其它目标的比对增强当前目标的特征,而且还可以代替NMS进行端到端的重复结果去除,思想十分新颖,效果也不错

来源:晓飞的算法工程笔记 公众号

论文: Relation Networks for Object Detection

- 论文地址:https://arxiv.org/abs/1711.11575

- 论文代码:https://github.com/msracver/Relation-Networks-for-Object-Detection

Introduction

当前大多数目标检测算法仍专注于单独识别目标,没有尝试在训练时挖掘目标之间的关系,受限于当前简单的网络结构,无法对无规律的目标关系进行建模。参考自然语言处理中的注意力机制,论文提出了用于目标检测的自适应注意力机制 -- 目标关系模块(object relation module),学习目标间的关系来增强特征以及去除重复结果。

检测目标有2D空间分布和不同的长宽比,比文本的场景要复杂些,所以论文拓展了NLP的注意力权重,分为两个权重:

- 基于目标特征产生的权重,跟NLP权重类似。

- 基于目标相对几何位置产生的权重,相对几何位置保证平移不变性。

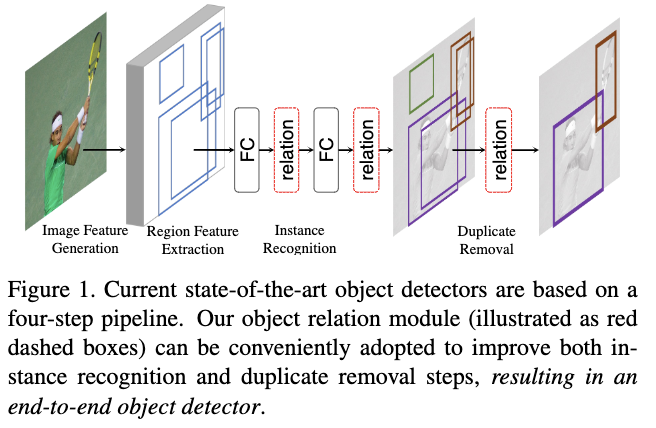

目标关系模块接收可变输入并行计算,是可微的in-place操作,可作为基础构建block嵌入到任意目标检测算法中,嵌入方式如图1所示,用于目标识别部分以及重复目标去除:

- 目标识别部分(instance recognition):利用目标关系模块,联合所有的检测目标来进行特征增强,再进行后续的识别。

- 重复目标去除(du-plicate remova):在识别完成后,常规的做法使用NMS进行重复目标的去除,而论文使用轻量级网关系网络进行该做法的替换。

Object Relation Module

常规的注意力机制为ScaledDot-Product Attention,计算为:

给定查询目标\(q\),计算与其它目标\(K\)的相似度,然后softmax归一化为权重,最后乘以各向量的值\(V\)得到加权后的特征,这3个值一般都是对目标特征进行embedding得到的。

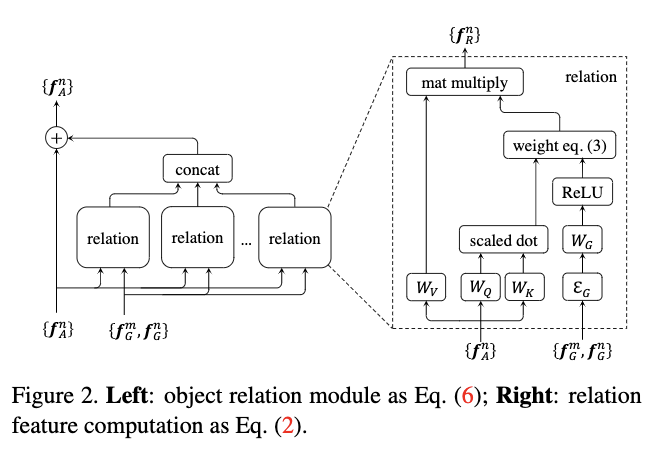

对于目标检测中的相似性计算,每个目标包含几何特征\(f_G\)和外观特征\(f_A\),给定\(N\)个目标\(\{(f^n_A, f^n_G)\}^N_{n=1}\),可计算每个目标相对于其它目标的关系特征(relation feature)\(f_R(n)\):

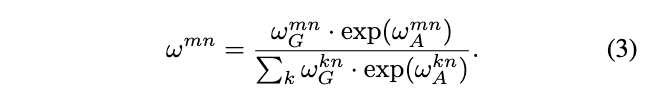

关系特征实际为所有目标的外观特征的加权和,\(W_V\)为线性变化,相当于将外观特征embedding为公式1的值\(V\)。权值\(w^{mn}\)表明其它目标相对于当前目标的重要性,计算方法为:

公式3实际上等同于公式1中的softmax,唯一不同的是除了外观权值\(w^{mn}_A\),还额外使用几何权值\(w^{mn}_G\)进行加权。

外观权值\(w^{mn}_A\)的计算跟公式1的softmax括号内的计算一样,具体为:

\(W_K\)和\(W_Q\)同样为线性变化,分别将对比目标和当前目标的外观特征embedding成公式1的\(K\)和\(Q\),embedding后的特征维度为\(d_k\)。

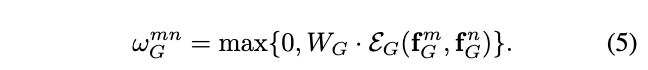

几何权值\(w^{mn}_G\)的计算为:

几何特征一般就是简单的四维bbox,所以公式5在计算几何权值包含两个步骤:

- 将当前目标和对比目标的几何特征通过\(\varepsilon_G\)embedding成高维特征,为了保证平移和尺寸不变性,几何特征转为相对值\((log(\frac{|x_m-x_n|}{w_m}), log(\frac{|y_m-y_n|}{h_m}), log(\frac{w_n}{w_m}), log(\frac{h_n}{h_m}) )\),embedding方法跟Attention Is All You Need里的位置编码一样,使用正弦函数和余弦函数。

- 使用\(W_G\)将高维几何特征转换为标量权值,小于0时设为0。

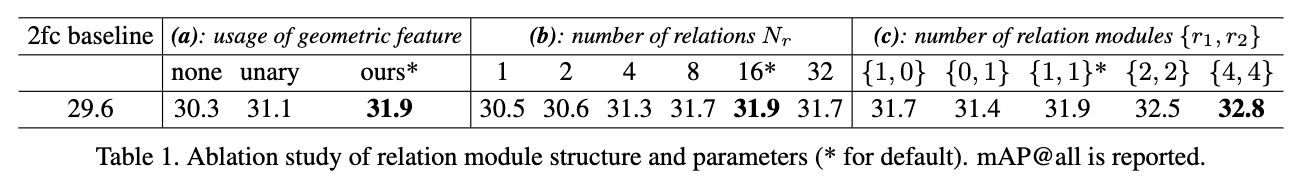

论文在几何特征的使用上也尝试了其它方法:1) none,直接将\(w^{mn}_G\)设为1.0计算权值,即不使用。 2) unary,将高维几何特征直接与外观特征融合,然后跟none一样计算权值。实验部分的表1有相关的结果对比,论文选择的公式5加权方法比较有效。

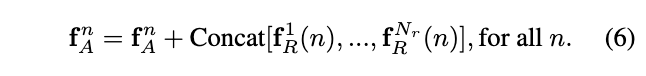

在实现时,类似于multi-head attention,一个目标关系模块(object relation module)包含\(N_r\)个关系特征,每个特征的维度为输入特征\(f^m_A\)的\(\frac{1}{N_r}\),图2可能会有一点问题,几何特征写了两个,但是外观特征只写了一个,大家根据公式理解就好,最后通过相加对输入目标的外观特征进行增强:

目标关系模块的计算逻辑如算法1所示,其空间复杂度和时间复杂度为:

一般而言,目标关系模块的整体计算量不会很大,而且输出特征的维度和输入特征的维度一致,可作为基础构建block嵌入到任何网络中。

Relation Networks For Object Detection

论文主要讨论将目标关系模块嵌入到region-based目标检测网络中,region-based目标检测网络一般包含四个步骤:1) 通过主干网络生成整图特征 2) 生成候选框的区域特征 3) 进行各实例识别和调整 4) 去除重复的检测结果,目标关系模块的嵌入主要在步骤3和步骤4。

Relation for Instance Recognition

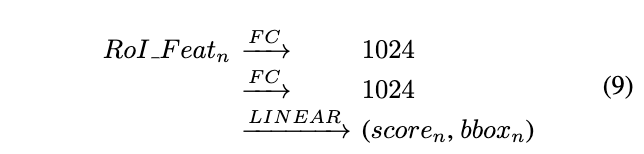

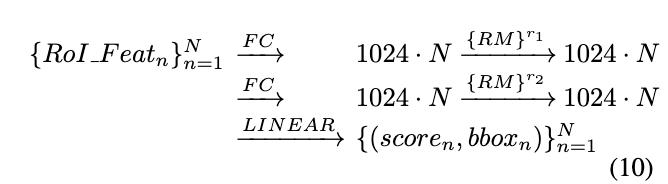

目标分类和目标回归一般使用两个1024维全连接层对目标的RoI池化特征进行处理:

目标关系模块可直接增强所有目标的1024维,不改变特征的维度,不仅可以在任意位置插入,还可以多次堆叠:

\(r_1\)和\(r_2\)为目标关系模块重复的次数,添加目标关系模块能够目标特征,提高识别的准确率,公式10的可视化如图a所示。

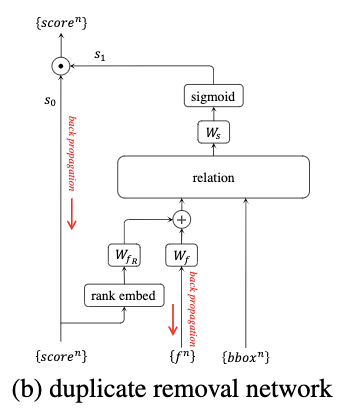

Relation for Duplicate Removal

去除重复目标这个任务本身就需要穷尽目标间的关系,比如启发式的NMS,高分目标可抹去其附近的低分目标。尽管NMS十分简单,但其去重的方式并不总是最优的,为此,论文采用目标关系模块去除重复目标。

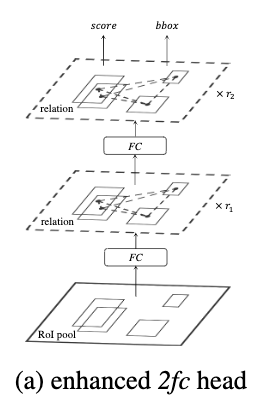

如图b所示,输入目标的分数、1024维外观特征以及几何特征,重复目标去除包含以下几个步骤:

- 对目标分数进行名次的转换,采用几何特征的embedding方式将分数转换成128维特征,将外观特征降维为128维特征,将两个特征相加。

- 跟前面描述的目标关系模块一样与其它目标计算,输出关系特征。

- 通过线性变化\(W_s\)和sigmoid函数输出概率\(s_1\in [0, 1]\),对原分数进行加权。

- 分数高于阈值的即为最终的结果。

在训练时直接对最终的分数使用交叉熵损失迭代,虽然大部分的目标都是重复的,但由于其最终分数都很小,所以不会对网络造成很大的偏差。而在推理时,先按分类的分数过滤一轮,这样能减轻计算量,论文实测大约增加2ms,相对的,NMS和SoftNMS增加5ms左右。

Experiments

各位置设置的对比实验。

重复目标去重效果对比。

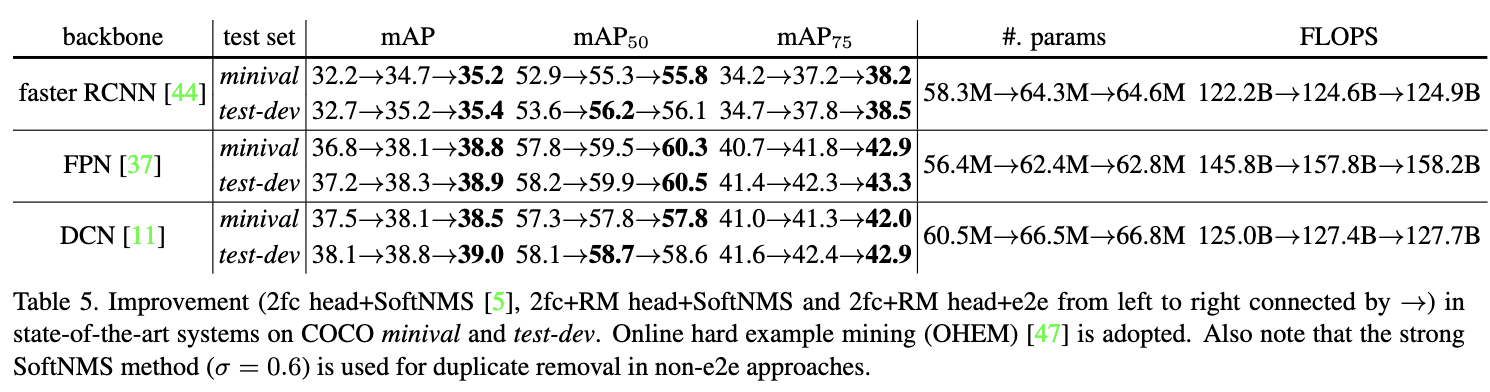

在各网络中的效果对比,分别对比2fc+SoftNMS、2fc+RM+SoftNMS和2fc+RM+e2e的效果。

Conclusion

论文基于NLP的注意力机制提出了目标关系模块,通过与其它目标的比对增强当前目标的特征,而且还可以代替NMS进行端到端的重复结果去除,思想十分新颖,效果也不错。

如果本文对你有帮助,麻烦点个赞或在看呗~

更多内容请关注 微信公众号【晓飞的算法工程笔记】

RelationNet:学习目标间关系来增强特征以及去除NMS | CVPR 2018的更多相关文章

- 论文学习-深度学习目标检测2014至201901综述-Deep Learning for Generic Object Detection A Survey

目录 写在前面 目标检测任务与挑战 目标检测方法汇总 基础子问题 基于DCNN的特征表示 主干网络(network backbone) Methods For Improving Object Rep ...

- 基于候选区域的深度学习目标检测算法R-CNN,Fast R-CNN,Faster R-CNN

参考文献 [1]Rich feature hierarchies for accurate object detection and semantic segmentation [2]Fast R-C ...

- zz深度学习目标检测2014至201901综述

论文学习-深度学习目标检测2014至201901综述-Deep Learning for Generic Object Detection A Survey 发表于 2019-02-14 | 更新 ...

- NLP之基于BERT的预测掩码标记和句间关系判断

BERT @ 目录 BERT 程序步骤 程序步骤 设置基本变量值,数据预处理 构建输入样本 在样本集中随机选取a和b两个句子 把ab两个句子合并为1个模型输入句,在句首加入分类符CLS,在ab中间和句 ...

- 20155206赵飞技能获取经验,C语言学习感想与对JAVA的学习目标

自己较强的技能获取经验. 1:实话实说我自己是没有哪个技能可以超过90%的人的,只有自认为做的还可以的一些事情,例如打篮球,office软件的应用,一百米跑.至于其他方面就是很平庸了. 2:经验主要有 ...

- 深入理解 Laravel Eloquent(三)——模型间关系(关联)

Eloquent是什么 Eloquent 是一个 ORM,全称为 Object Relational Mapping,翻译为 "对象关系映射"(如果只把它当成 Database A ...

- iOS设计模式 - (2)UML类间关系精解

在正式讲设计模式之前, 介绍一下UML类图之间的关系还是非常有必要的, 由于一些教程, 书籍, 包含我之后的文章, 都会大量使用类图, 去描写叙述各个类之间的关系.这是一种非常直观, 简约的方式. 当 ...

- c语言学习目标

运行c语言环境codeblocks. codeblocks的安装: 安装地址:http://www.codeblocks.org/downloads/26 codeblocks-16.01mingw- ...

- Python学习day24-面向对象的三大特征之继承

figure:last-child { margin-bottom: 0.5rem; } #write ol, #write ul { position: relative; } img { max- ...

- UML 有关类图知识及类间关系

原文链接:https://blog.csdn.net/mj_ww/article/details/53020346 1. 类的含义 类图(Class diagram)显示了系统的静态结构,而系统的静态 ...

随机推荐

- 欧拉公式 Euler's Formula

欧拉公式是数学中最重要的公式之一, 它涉及到了复数, 无理数, 三角函数, 简单优美 \(e^{i\theta} = cos(\theta) + isin(\theta)\) 欧拉公式代表的含义并不是 ...

- 解决unable to find valid certification path to requested target

问题描述 最近java程序去调用远程服务器接口时报错了: I/O error on POST request for "https://XXX.xyz/create": sun.s ...

- centos7使用repo方式安装zabbix4.0

1.安装zabbix的repo源 rpm -ivh https://mirrors.tuna.tsinghua.edu.cn/zabbix/zabbix/4.0/rhel/7/x86_64/zabbi ...

- Java 中拼接 String 的 N 种方式

文章持续更新,可以关注公众号程序猿阿朗或访问未读代码博客. 本文 Github.com/niumoo/JavaNotes 已经收录,欢迎Star. 1. 前言 Java 提供了拼接 String 字符 ...

- 使用 Visual Studio 断点调试 DLL

继上文说到使用 IDA 和 WinDbg 调试无 dmp 文件 那么在有源码的情况下可以直接断点调试 DLL,目的是查看 DLL 内部的函数调用 场景: 程序执行到某个 DLL 时突然崩溃,先确定 ...

- 利用VkKeyScanA判断大写字母

string bind = "Hello"; for (int i = 0; i < bind.length(); i++) { short ch = VkKeyScanA( ...

- Oracle日期格式化问题:to_date(sysdate,'yyyy-MM-dd')与 to_date(to_char(sysdate,'yyyy-MM-dd'),'yyyy-MM-dd')区别

1.需求描述 对系统日期进行格式化,并仍保持日期类型 2.错误方法 直接使用to_date()实现 SELECT TO_DATE(SYSDATE,'YYYY-MM-DD') FROM DUAL; 这样 ...

- React 组件通信方式

人生的游戏不在于拿了一副好牌,而在于怎样去打好坏牌,世上没有常胜将军,勇于超越自我者才能得到最后的奖杯. 1. 父子组件通信方式 1.1 父组件传递到子组件 直接通过属性进行传递,数据的传递可以提高组 ...

- 【Azure Function App】Nodejs Function遇见WorkerProcessExitException : node exited with code -1073740791 (0xC0000409) 错误

问题描述 Nodejs Function,使用Blob Trigger用于处理上传到Storage Blob的文件,但是最近发现偶发报错:Exception while executing funct ...

- 从全球顶级数据库大会 SIGMOD 看数据库发展趋势

本文来自 NebulaGraph 的软件工程师文豪在美国费城参加 2022 年 SIGMOD 大会时的见闻.SIGMOD 是数据库领域的顶级会议之一,是 CCF 数据库 / 数据挖掘 / 内容检索领域 ...