池化层 Pooling Layer

写在前面:人生就是努力、搞不懂、躺平,循环。

文章结构

- 池化层的相对位置

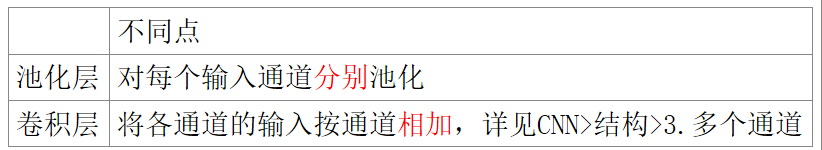

- 在多通道任务中,池化层和卷积层的不同

- 重要的参数stride 与 kernel_size 大小的相对关系决定3种池化层

- 参数

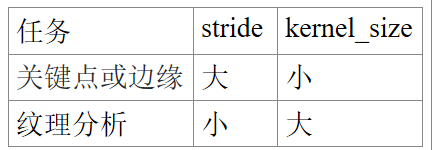

- 针对不同的任务,使用不同的 stride 和 kernel_size。

- kernel_size是否越大越好?

- 常用的池化层/结构(名称、优点、适用于、pytorch 函数)

- 最大值池化

- 平均值池化

- 组合池化

- 自适应最大值/均值池化

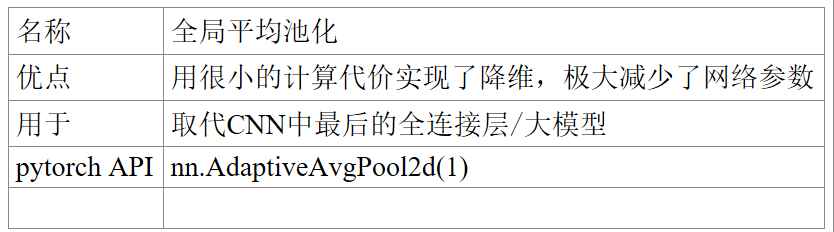

- 全局平均池化

- 随即池化

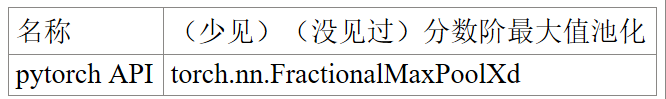

- 分数阶最大池化

- 幂均值池化/LP池化

- Detail-Preserving Pooling

- Local Importance Pooling

- 软池化

- 双线性池化

- 反池化反卷积/转置卷积

- 适用于

- pytorch函数

如果存在错误,欢迎指正,共同学习。

部分图片与公式来源网络。博客起初是我的个人学习笔记,如有侵权,请联系我添加来源或进行删除。

池化层的相对位置

Convolutional Layer → ReLU → Pooling Layer

在多通道任务中,池化层和卷积层的不同

重要参数

- 参数

- 步长 stride

- 填充值 zero_padding

- 卷积核kernel及其大小size,深度/个数depth

- 针对不同的任务,使用不同的 stride 和 kernel_size。

- kernel_size是否越大越好?

stride 与 kernel_size 大小的相对关系决定3种池化层。

常用的池化层/结构(名称、优点、适用于、pytorch 函数)

组合池化 组合最大值池化和均值池化,常见 Cat与Add 当做分类任务的一个trick,其作用就是丰富特征层,maxpool更关注重要的局部特征,而average pooling更关注全局特征。

随机池化/随机位置池化 将方格中的元素同时除以它们的和sum,得到概率矩阵

Detail-Preserving Pooling 保存网络的精度 放大空间变化并保留重要的图像结构细节,且其内部的参数可通过反向传播加以学习

Local Importance Pooling

反池化

- 适用于:扩大特征图的尺寸,它通过学习滤波器和步长来逆转池化过程中的降维过程。

- pytorch 函数: torch.nn.MaxUnpool2d

反卷积/转置卷积 计算步骤

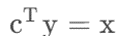

按卷积核个数depth,写成一个depth行input_size*input_size列大小的矩阵 C,将现有的结果y,根据公式

计算得 输入 input/x

池化层 Pooling Layer的更多相关文章

- 图像处理池化层pooling和卷积核

1.池化层的作用 在卷积神经网络中,卷积层之间往往会加上一个池化层.池化层可以非常有效地缩小参数矩阵的尺寸,从而减少最后全连层中的参数数量.使用池化层即可以加快计算速度也有防止过拟合的作用. 2.为什 ...

- 神经网络中的池化层(pooling)

在卷积神经网络中,我们经常会碰到池化操作,而池化层往往在卷积层后面,通过池化来降低卷积层输出的特征向量,同时改善结果(不易出现过拟合).为什么可以通过降低维度呢? 因为图像具有一种“静态性”的属性,这 ...

- 池化层pooling

from mxnet import autograd,nd from mxnet import gluon,init from mxnet.gluon import nn,loss as gloss ...

- CNN之池化层tf.nn.max_pool | tf.nn.avg_pool | tf.reduce_mean | padding的规则解释

摘要:池化层的主要目的是降维,通过滤波器映射区域内取最大值.平均值等操作. 均值池化:tf.nn.avg_pool(input,ksize,strides,padding) 最大池化:tf.nn.ma ...

- 深入解析CNN pooling 池化层原理及其作用

原文地址:https://blog.csdn.net/CVSvsvsvsvs/article/details/90477062 池化层作用机理我们以最简单的最常用的max pooling最大池化层为例 ...

- tensorflow 1.0 学习:池化层(pooling)和全连接层(dense)

池化层定义在 tensorflow/python/layers/pooling.py. 有最大值池化和均值池化. 1.tf.layers.max_pooling2d max_pooling2d( in ...

- 【37】池化层讲解(Pooling layers)

池化层(Pooling layers) 除了卷积层,卷积网络也经常使用池化层来缩减模型的大小,提高计算速度,同时提高所提取特征的鲁棒性,我们来看一下. 先举一个池化层的例子,然后我们再讨论池化层的 ...

- ubuntu之路——day17.3 简单的CNN和CNN的常用结构池化层

来看上图的简单CNN: 从39x39x3的原始图像 不填充且步长为1的情况下经过3x3的10个filter卷积后 得到了 37x37x10的数据 不填充且步长为2的情况下经过5x5的20个filter ...

- 【python实现卷积神经网络】池化层实现

代码来源:https://github.com/eriklindernoren/ML-From-Scratch 卷积神经网络中卷积层Conv2D(带stride.padding)的具体实现:https ...

- [PyTorch 学习笔记] 3.3 池化层、线性层和激活函数层

本章代码:https://github.com/zhangxiann/PyTorch_Practice/blob/master/lesson3/nn_layers_others.py 这篇文章主要介绍 ...

随机推荐

- linux命令系列 sudo apt-get update和upgrade的区别

入门linux的同志,刚开始最迫切想知道的,大概一个是中文输入法,另一个就是怎么安装软件.本文主要讲一下LINUX安装软件方面的特点.在windows下安装软件,我们只需要有EXE文件,然后双击,下一 ...

- 关于在VMware中安装的CentOS7系统中无法安装ntp

一.问题引言 今天在虚拟机中新安装了CentOS7,在使用yum命令时,出现如下如错误: 2.点击图片中链接,即是"2"中的红框,发现该链接竟不可达 3.于是开始找度娘,但并没有发 ...

- [转]Windows10下CLion配置说明

Windows10下CLion配置说明CLion 是 C/C++的 IDE,可以配置多种编译环境,本文以配置MinGW编译环境为例. 安装CLion 的安装可直接到官网下载 ZIP,文件解压后直接运行 ...

- Win7/8/10操作系统之间通过“映射网络驱动器”映射共享目录或者网络磁盘,有的可以映射成功,有的不成功的原因和终极解决办法

Win7/8/10操作系统相互之间通过"映射网络驱动器"映射共享目录或者网络磁盘,有的可以映射成功,有的不成功 原因: 待添加映射驱动器的计算机的"网络发现"和 ...

- Android保活从入门到放弃:乖乖引导用户加白名单吧(附7大机型加白示例)

1.引言 IM在Android上的保活问题经常在即时通讯网的论坛和技术群里被讨论,自从Android 8.0后系统大大降低了后台运行应用的保活容忍度(详见<Android P正式版即将到来:后台 ...

- nginx升级与版本回退

ginx官网下载安装包http://nginx.org/en/download.html 查看nginx文件或目录find / -name nginx 2>/dev/null 查看已安装的 Ng ...

- Kubernetes 深入学习

目录 一.简介 1.Kubernetes 是什么 2.Kubernetes 特性 二.集群架构与组件 1.Master 2.Node 三.核心概念 四.集群搭建 -- 平台规划 1.生产环境 K8S ...

- 链路追踪 Sleuth 和 Zipkin

微服务的链路追踪概述: 分布式链路追踪(Distributed Tracing),就是将一次分布式请求还原成调用链路,进行日志记录,性能监控并将一次分布式请求的调用情况集中展示.比如各个服务节点上的耗 ...

- C++:异常处理

C++的异常处理机制是由三部分组成:检查(try).抛出(throw)和捕获(catch).需要检查的语句放到try中:throw用来当出现异常时发出一个异常信息:catch用来捕获异常信息,且处理它 ...

- Codeforces Round 962 (Div. 3)

题目链接:Codeforces Round 962 (Div. 3) 总结:ABC秒过,D有点难评了,E优化很妙. A. Legs tag:签到 void solve(){ cin >> ...