Spark 倾斜连接

- 业务数据本身的特性

- Key分布不均匀

- 建表时考虑不周

- 某些SQL语句本身就有数据倾斜

【数据倾斜的解决方案】

------

------ ------

------

【SPARK 代码】

package spark

import org.apache.spark.{SparkContext, SparkConf}

/**

* Created by Liu Jinhong on 2016/5/27.

*/

object TiltJoin {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName("TiltJoin").setMaster("local")

val sc = new SparkContext(conf)

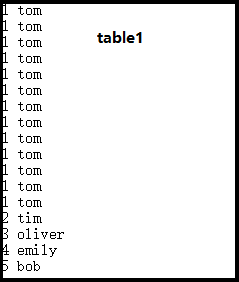

val line1 = sc.textFile("E:\\testdoc\\a.txt")

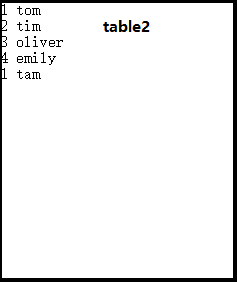

val line2 = sc.textFile("E:\\testdoc\\b.txt")

val table1 = line1.map(_.split(' ')).map(x => (x(0), x(1)))

val table2 = line2.map(_.split(' ')).map(x => (x(0), x(1)))

//对table1进行采样

val sample = table1.sample(false, 0.3, 9).map(x => (x._1, 1)).reduceByKey(_+_)

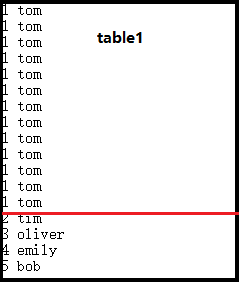

//找到table1中的倾斜数据

val maxrowKey = sample.map(x => (x._2, x._1)).sortByKey(false).take(1).toSeq(0)._2

//把table1拆分成两个表

val maxrowTable = table1.filter(_._1 == maxrowKey)

val maintable = table1.filter(_._1 != maxrowKey)

val result = sc.union(maxrowTable.join(table2), maintable.join(table2)).foreach(println(_))

}

}

【涉及到的函数】

val maxrowKey = sample.map(x => (x._2, x._1)).sortByKey(false).take(1).toSeq(0)._2

上诉代码相当于实现了按照value降序排序。

Spark 倾斜连接的更多相关文章

- Spark Streaming连接TCP Socket

1.Spark Streaming是什么 Spark Streaming是在Spark上建立的可扩展的高吞吐量实时处理流数据的框架,数据可以是来自多种不同的源,例如kafka,Flume,Twitte ...

- 【spark】连接Hbase

0.我们有这样一个表,表名为Student 1.在Hbase中创建一个表 表明为student,列族为info 2.插入数据 我们这里采用put来插入数据 格式如下 put ‘表命’,‘行键’, ...

- Spark Streaming连接Kafka的两种方式 direct 跟receiver 方式接收数据的区别

Receiver是使用Kafka的高层次Consumer API来实现的. Receiver从Kafka中获取的数据都是存储在Spark Executor的内存中的,然后Spark Streaming ...

- Spark join连接

内链接

- Spark SQL 官方文档-中文翻译

Spark SQL 官方文档-中文翻译 Spark版本:Spark 1.5.2 转载请注明出处:http://www.cnblogs.com/BYRans/ 1 概述(Overview) 2 Data ...

- 《Spark大数据处理:技术、应用与性能优化 》

基本信息 作者: 高彦杰 丛书名:大数据技术丛书 出版社:机械工业出版社 ISBN:9787111483861 上架时间:2014-11-5 出版日期:2014 年11月 开本:16开 页码:255 ...

- 《Spark大数据处理:技术、应用与性能优化》【PDF】 下载

内容简介 <Spark大数据处理:技术.应用与性能优化>根据最新技术版本,系统.全面.详细讲解Spark的各项功能使用.原理机制.技术细节.应用方法.性能优化,以及BDAS生态系统的相关技 ...

- 《Spark大数据处理:技术、应用与性能优化》【PDF】

内容简介 <Spark大数据处理:技术.应用与性能优化>根据最新技术版本,系统.全面.详细讲解Spark的各项功能使用.原理机制.技术细节.应用方法.性能优化,以及BDAS生态系统的相关技 ...

- Spark记录-SparkSql官方文档中文翻译(部分转载)

1 概述(Overview) Spark SQL是Spark的一个组件,用于结构化数据的计算.Spark SQL提供了一个称为DataFrames的编程抽象,DataFrames可以充当分布式SQL查 ...

随机推荐

- 使用Stardict命令行版本sdcv

sdcv命令的常用选项如下: -l:列出安装的词典 -u:指定查词所用的词典 在我的电脑上列出的词典有: Dictionary's name Word count Merrian Webster 10 ...

- linux标准输入输出2>&1

linux中有三种标准输入输出,分别是STDIN,STDOUT,STDERR,对应的数字是0,1,2. STDIN是标准输入,默认从键盘读取信息:STDOUT是标准输出,默认将输出结果输出至终 ...

- Arch安装KDE5

plasma desktop Install the plasma-meta meta-package or the plasma group. Alternatively, for a more m ...

- NGINX----源码阅读---config配置脚本

config文件为nginx的配置入口文件. 1. #!/bin/sh # Copyright (C) Igor Sysoev # Copyright (C) Nginx, Inc. LC_ALL=C ...

- How I Mathematician Wonder What You Are!(poj 3130)

题意:求问多边形的核(能够看到所有点的点)是否存在. /* 对于这样的题目,我只能面向std编程了,然而还是不理解. 算法可参考:http://www.cnblogs.com/huangxf/p/40 ...

- Hadoop之MapReduce分布式计算

简单介绍一下项目背景——很简单,作死去接下老师的活,然后一干就是半个月,一直忙着从零基础到使用Hadoop中的MapReduce来解决一个实际问题,也就是用来计算一个数据量较大的二度朋友关系. 那么首 ...

- 使用vscode对c进行调试

最近在学习C语言.知道vscode支持对c语言的代码的调试,就想试试.然后找了教程: https://code.visualstudio.com/docs/languages/cpp http://w ...

- Python基础知识学习_Day2

一.for循环 1.1功能及语法 for循环是迭代循环机制(while是条件循环),语法如下: for i in a b c: print(i) 1.2典型例子: 1.2.1猜年龄循环 realy_a ...

- Edward's Cola Plan

Edward's Cola Plan Time Limit:3000MS Memory Limit:32768KB 64bit IO Format:%lld & %llu S ...

- C#第十二天

1.Directory 操作文件夹 1)创建文件夹 Directory.CreateDirectory(@"C:\a"); Console.WriteLine("创建成功 ...