【转载】Spark SQL 1.3.0 DataFrame介绍、使用

http://www.aboutyun.com/forum.php?mod=viewthread&tid=12358&page=1

1.DataFrame是什么?

2.如何创建DataFrame?

3.如何将普通RDD转变为DataFrame?

4.如何使用DataFrame?

5.在1.3.0中,提供了哪些完整的数据写入支持API?

DataFrame

- # 从Hive中的users表构造DataFrame

- users = sqlContext.table("users")

- # 加载S3上的JSON文件

- logs = sqlContext.load("s3n://path/to/data.json", "json")

- # 加载HDFS上的Parquet文件

- clicks = sqlContext.load("hdfs://path/to/data.parquet", "parquet")

- # 通过JDBC访问MySQL

- comments = sqlContext.jdbc("jdbc:mysql://localhost/comments", "user")

- # 将普通RDD转变为DataFrame

- rdd = sparkContext.textFile("article.txt") \

- .flatMap(lambda line: line.split()) \

- .map(lambda word: (word, 1)) \

- .reduceByKey(lambda a, b: a + b) \

- wordCounts = sqlContext.createDataFrame(rdd, ["word", "count"])

- # 将本地数据容器转变为DataFrame

- data = [("Alice", 21), ("Bob", 24)]

- people = sqlContext.createDataFrame(data, ["name", "age"])

- # 将Pandas DataFrame转变为Spark DataFrame(Python API特有功能)

- sparkDF = sqlContext.createDataFrame(pandasDF)

- # 创建一个只包含"年轻"用户的DataFrame

- young = users.filter(users.age < 21)

- # 也可以使用Pandas风格的语法

- young = users[users.age < 21]

- # 将所有人的年龄加1

- young.select(young.name, young.age + 1)

- # 统计年轻用户中各性别人数

- young.groupBy("gender").count()

- # 将所有年轻用户与另一个名为logs的DataFrame联接起来

- young.join(logs, logs.userId == users.userId, "left_outer")

- young.registerTempTable("young")

- sqlContext.sql("SELECT count(*) FROM young")

- # 追加至HDFS上的Parquet文件

- young.save(path="hdfs://path/to/data.parquet",

- source="parquet",

- mode="append")

- # 覆写S3上的JSON文件

- young.save(path="s3n://path/to/data.json",

- source="json",

- mode="append")

- # 保存为SQL表

- young.saveAsTable(tableName="young", source="parquet" mode="overwrite")

- # 转换为Pandas DataFrame(Python API特有功能)

- pandasDF = young.toPandas()

- # 以表格形式打印输出

- young.show()

幕后英雄:Spark SQL查询优化器与代码生成

外部数据源API增强

数据写入支持

- CREATE [TEMPORARY] TABLE [IF NOT EXISTS]

- <table-name> [(col-name data-type [, ...)]

- USING <source> [OPTIONS ...]

- [AS <select-query>]

统一的load/save API

- rdd.saveAsParquetFile(...)

- rdd.saveAsTextFile(...)

- rdd.toJSON.saveAsTextFile(...)

- rdd.saveAsTable(...)

- ....

Parquet数据源增强

- // 创建两个简单的DataFrame,将之存入两个独立的分区目录

- val df1 = (1 to 5).map(i => (i, i * 2)).toDF("single", "double")

- df1.save("data/test_table/key=1", "parquet", SaveMode.Append)

- val df2 = (6 to 10).map(i => (i, i * 2)).toDF("single", "double")

- df2.save("data/test_table/key=2", "parquet", SaveMode.Append)

- // 在另一个DataFrame中引入一个新的列,并存入另一个分区目录

- val df3 = (11 to 15).map(i => (i, i * 3)).toDF("single", "triple")

- df3.save("data/test_table/key=3", "parquet", SaveMode.Append)

- // 一次性读入整个分区表的数据

- val df4 = sqlContext.load("data/test_table", "parquet")

- // 按分区进行查询,并展示结果

- val df5 = df4.filter($"key" >= 2) df5.show()

- 6 12 null 2

- 7 14 null 2

- 8 16 null 2

- 9 18 null 2

- 10 20 null 2

- 11 null 33 3

- 12 null 36 3

- 13 null 39 3

- 14 null 42 3

- 15 null 45 3

小结

【转载】Spark SQL 1.3.0 DataFrame介绍、使用的更多相关文章

- 平易近人、兼容并蓄——Spark SQL 1.3.0概览

自2013年3月面世以来,Spark SQL已经成为除Spark Core以外最大的Spark组件.除了接过Shark的接力棒,继续为Spark用户提供高性能的SQL on Hadoop解决方案之外, ...

- Spark SQL,如何将 DataFrame 转为 json 格式

今天主要介绍一下如何将 Spark dataframe 的数据转成 json 数据.用到的是 scala 提供的 json 处理的 api. 用过 Spark SQL 应该知道,Spark dataf ...

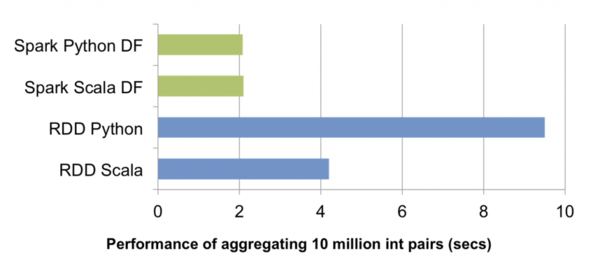

- Spark SQL概念学习系列之DataFrame与RDD的区别

不多说,直接上干货! DataFrame的推出,让Spark具备了处理大规模结构化数据的能力,不仅比原有的RDD转化方式更加简单易用,而且获得了更高的计算性能.Spark能够轻松实现从MySQL到Da ...

- Spark SQL 之 RDD、DataFrame 和 Dataset 如何选择

引言 Apache Spark 2.2 以及以上版本提供的三种 API - RDD.DataFrame 和 Dataset,它们都可以实现很多相同的数据处理,它们之间的性能差异如何,在什么情况下该选用 ...

- Spark SQL初始化和创建DataFrame的几种方式

一.前述 1.SparkSQL介绍 Hive是Shark的前身,Shark是SparkSQL的前身,SparkSQL产生的根本原因是其完全脱离了Hive的限制. SparkSQL支持查询原 ...

- spark SQL、RDD、Dataframe总结

- Spark学习之路(八)—— Spark SQL 之 DataFrame和Dataset

一.Spark SQL简介 Spark SQL是Spark中的一个子模块,主要用于操作结构化数据.它具有以下特点: 能够将SQL查询与Spark程序无缝混合,允许您使用SQL或DataFrame AP ...

- Spark 系列(八)—— Spark SQL 之 DataFrame 和 Dataset

一.Spark SQL简介 Spark SQL 是 Spark 中的一个子模块,主要用于操作结构化数据.它具有以下特点: 能够将 SQL 查询与 Spark 程序无缝混合,允许您使用 SQL 或 Da ...

- Spark SQL怎么创建编程创建DataFrame

创建DataFrame在Spark SQL中,开发者可以非常便捷地将各种内.外部的单机.分布式数据转换为DataFrame.以下Python示例代码充分体现了Spark SQL 1.3.0中DataF ...

随机推荐

- mmap和普通文件读写的区别和比较 & mmap的注意点

参考 http://www.cnblogs.com/huxiao-tee/p/4660352.html 对linux文件系统不了解的朋友,请参阅我之前写的博文<从内核文件系统看文件读写过程> ...

- C#客户端链接网页需要用到的WebClient

WebClient 类提供向 URI 标识的任何本地.Intranet 或 Internet 资源发送数据以及从这些资源接收数据的公共方法. WebClient 类使用 WebRequest 类提供对 ...

- 【不积跬步,无以致千里】linux下如何查看自己的外网IP

局域网的服务器是通过ADSL路由器连接外网的,但ADSL是从ISP运营商那儿通过动态获得IP的,那么我怎么知道自己的外网地址是多少呢?今天得到几个办法:curl -s http://whatismyi ...

- Flex Alert.show()方法的详解

本文和大家重点讨论一下Flex Alert.show()flag详细值,Flex Alert.show()里面有多个属性,其中排在第三是flags,这个属性作用是在弹出的Alert提示框里面显示那一个 ...

- java.io.File类

java.io.File类 1.凡是与输入.输出相关的类.接口等都定义在java.io包下 2.File是一个类.能够有构造器创建其对象.此对象相应着一个文件(.txt .avi .doc .ppt ...

- Hadoop 2.4.0全然分布式平台搭建、配置、安装

一:系统安装与配置 虚拟机软件:Virtualbox 4.3.10(已安装对应扩展包) 虚拟机:Ubuntu 13.04 LTS 32位(至于为什么选择13.04,是由于最新的版本号装上后开机会出现错 ...

- 【转】教你Ruby快速入门

转自:http://developer.51cto.com/art/200703/41243.htm 介绍 这是一个短小的Ruby入门,完全读完只需20分钟.这里假设读者已经安装了Ruby,如果你没有 ...

- 【剑指offer】近期公共祖先

转载请注明出处:http://blog.csdn.net/ns_code/article/details/28113959 剑指offer上的最后一题了,一个递归函数调了一下午,才得到正确的结果. 题 ...

- [AngularJS] Lazy loading Angular modules with ocLazyLoad

With the ocLazyLoad you can load AngularJS modules on demand. This is very handy for runtime loading ...

- LVS三种模式配置及优点缺点比较 转

LVS三种模式配置及优点缺点比较 作者:gzh0222,发布于2012-11-12,来源:CSDN 目录: LVS三种模式配置 LVS 三种工作模式的优缺点比较 LVS三种模式配置 LVS三种 ...