scrapy中间件之下载中间件使用(网易新闻爬取)

scrapy项目中的middlewarse.py中间件

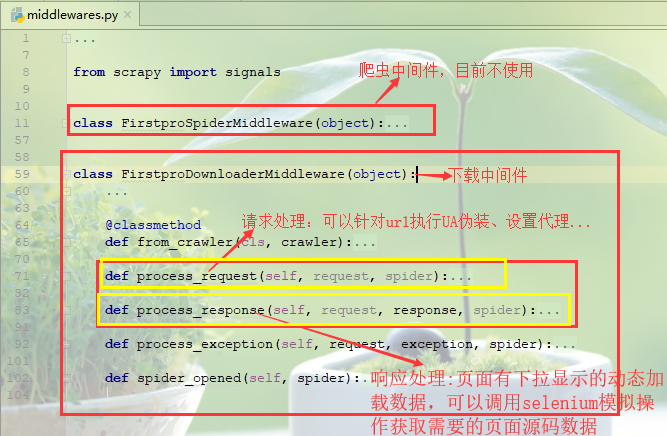

爬虫中间件:目前先不介绍

下载中间件(需要在settings.py中开启)

(1)请求处理函数:process_request(self, request, spider)

可以针对url请求指定UA伪装、配置代理等功能(UA伪装可以在settings.py中进行全局配置,代理配置更倾向于在异常处理函数,大部分异常都是因为ip的问题)

def process_request(self, request, spider):

#UA伪装

# request.headers['User-Agent']=random.choice(UA_list) #ip代理配置(一般更多的放在process_exception异常处理函数中)

# request.meta['proxy']='http[s]://ip:port'

return None

process_request

(2)响应处理函数:process_response(self, request, response, spider)

对于一些网页请求,立即相应的数据可能不完全,页面部分内容是通过触发滚轮或者下拉操作才会动态加载的数据,因此获取的到数据并不是完整的,需要对响应对象进行篡改(比如通过selenium模拟浏览器操作获取到完整数据)后返回。

(3)异常处理函数:process_exception(self, request, exception, spider)

对于请求异常处理,一般可以更换ip设置代理操作

def process_exception(self, request, exception, spider):

#对请求异常进行修正

#更换代理(一定要 return request将请求返回以便再次发起)

# request.meta['proxy']='http[s]://ip:port'

# return request

pass

process_exception

网易新闻爬取案例:

分析页面可以获知不同板块内容都是页面下拉动态加载的:国内、国际、军事、航空、无人机这几个板块内容都是标题都是在div中的一个a标签中,因此统一来进行爬取解析!

1.新建爬虫项目

scrapy startproject firstPro

cd firstPro

scrapy genspider middlewareTest www.xxx.com

2.编写爬虫文件middlewareTest.py

# -*- coding: utf-8 -*-

import scrapy

from firstPro.items import FirstproItem

from selenium import webdriver class MiddlewaretestSpider(scrapy.Spider):

name = 'middlewareTest'

# allowed_domains = ['www.xxx.com']

start_urls = ['https://news.163.com/']

plate_urls=[]#存放板块的url,以便在下载中间件次改请求获取完整标题数据

def __init__(self):

self.bro=webdriver.Chrome(executable_path=r'E:\Python项目\爬虫\day110_20190809(全站爬取、分布式爬虫)\firstPro\firstPro\spiders\chromedriver.exe')#初始化浏览器实例

def parse(self, response):

#解析首页标题板块

li_list=response.xpath('//div[@class="ns_area list"]/ul/li')

print(len(li_list))

#确定爬取的板块

index_list=[4,5,7,8,9]

for index in index_list:

item=FirstproItem()

plate=li_list[index-1].xpath('./a/text()').extract_first()

url=li_list[index-1].xpath('./a/@href').extract_first()

self.plate_urls.append(url)

item['plate']=plate

# 对每个板块进行发起请求,获取标题信息

yield scrapy.Request(url,callback=self.parse_title,meta={"item":item})

break

#对每个板块的新闻标题进行解析,但是新闻标题都是动态加载的,因此直接的响应对象不完整,需要通过下载中间件对新闻板块标题获取进行处理

#解决思路:为获取板块完整标题内容,需要模拟浏览器下拉操作,结合使用selenuim在下载中间件进行操作

def parse_title(self, response):

item=response.meta['item']

#解析每个板块中的新闻标题

div_list=response.xpath('//div[@class="ndi_main"]/div')

for div in div_list:

title=div.xpath('./div/div[1]/h3/a/text()').extract_first()

url=div.xpath('./div/div[1]/h3/a/@href').extract_first()

item["title"]=title

#对每个标题详情发起请求

yield scrapy.Request(url,callback=self.parse_detail,meta={"item":item}) def parse_detail(self,response):

item = response.meta['item']

#解析每个标题对应的详细新闻内容

content="".join(response.xpath('//*[@id="endText"]//text()').extract())

item["content"]=content

yield item # 程序全部结束的时候被调用

def closed(self, spider):

print('结束爬虫!!!')

self.bro.quit()

爬虫脚本middlewareTest.py

3.定义items.py字段属性

import scrapy class FirstproItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

#新闻板块

plate=scrapy.Field()

#新闻标题

title=scrapy.Field()

#新闻详情

content=scrapy.Field()

pass

items.py

4.管道pipelines.py持久化

import redis

class FirstproPipeline(object):

#持久化存储在redis数据库中

conn=None

# def open_spider(self,spider):

# self.conn=redis.Redis(host="127.0.0.1",port=6379) def process_item(self, item, spider):

# self.conn.lpush('wangyi',dict(item))

print(item)

return item

pipelines.py

5.settings.py配置

#UA伪装

USER_AGENT = "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36" #robots协议

ROBOTSTXT_OBEY = False #输出日志等级

LOG_LEVEL="ERROR" #打开下载中间件

DOWNLOADER_MIDDLEWARES = {

'firstPro.middlewares.FirstproDownloaderMiddleware': 543,

} #打开管道

ITEM_PIPELINES = {

'firstPro.pipelines.FirstproPipeline': 300,

}

scrapy中间件之下载中间件使用(网易新闻爬取)的更多相关文章

- python爬虫---scrapy框架爬取图片,scrapy手动发送请求,发送post请求,提升爬取效率,请求传参(meta),五大核心组件,中间件

# settings 配置 UA USER_AGENT = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, l ...

- scrapy架构与目录介绍、scrapy解析数据、配置相关、全站爬取cnblogs数据、存储数据、爬虫中间件、加代理、加header、集成selenium

今日内容概要 scrapy架构和目录介绍 scrapy解析数据 setting中相关配置 全站爬取cnblgos文章 存储数据 爬虫中间件和下载中间件 加代理,加header,集成selenium 内 ...

- Python 网络爬虫 006 (编程) 解决下载(或叫:爬取)到的网页乱码问题

解决下载(或叫:爬取)到的网页乱码问题 使用的系统:Windows 10 64位 Python 语言版本:Python 2.7.10 V 使用的编程 Python 的集成开发环境:PyCharm 20 ...

- Python 网络爬虫 005 (编程) 如何编写一个可以 下载(或叫:爬取)一个网页 的网络爬虫

如何编写一个可以 下载(或叫:爬取)一个网页 的网络爬虫 使用的系统:Windows 10 64位 Python 语言版本:Python 2.7.10 V 使用的编程 Python 的集成开发环境:P ...

- python 全栈开发,Day138(scrapy框架的下载中间件,settings配置)

昨日内容拾遗 打开昨天写的DianShang项目,查看items.py class AmazonItem(scrapy.Item): name = scrapy.Field() # 商品名 price ...

- scrapy框架4——下载中间件的使用

一.下载中间件 下载中间件是scrapy提供用于用于在爬虫过程中可修改Request和Response,用于扩展scrapy的功能:比如: 可以在请求被Download之前,请求头部加上某些信息(例如 ...

- scrapy框架之下载中间件

介绍 中间件是Scrapy里面的一个核心概念.使用中间件可以在爬虫的请求发起之前或者请求返回之后对数据进行定制化修改,从而开发出适应不同情况的爬虫. “中间件”这个中文名字和前面章节讲到的“中间人”只 ...

- Scrapy教程——搭建环境、创建项目、爬取内容、保存文件

1.创建项目 在开始爬取之前,您必须创建一个新的Scrapy项目.进入您打算存储代码的目录中,运行新建命令. 例如,我需要在D:\00Coding\Python\scrapy目录下存放该项目,打开命令 ...

- Scrapy分布式爬虫打造搜索引擎- (二)伯乐在线爬取所有文章

二.伯乐在线爬取所有文章 1. 初始化文件目录 基础环境 python 3.6.5 JetBrains PyCharm 2018.1 mysql+navicat 为了便于日后的部署:我们开发使用了虚拟 ...

随机推荐

- D3.js 力导向图的显示优化

D3.js 作为一个前端,说到可视化除了听过 D3.js 的大名,常见的可视化库还有 ECharts.Chart.js,这两个库功能也很强大,但是有一个共同特点是封装层次高,留给开发者可设计和控制的部 ...

- hdu_2391 Filthy Rich DP

Filthy Rich Time Limit: 10000/5000 MS (Java/Others) Memory Limit: 32768/32768 K (Java/Others)Tota ...

- HDU 5416 CBR and tree

#include<bits/stdc++.h> using namespace std; #define for(i,a,b) for(int i=a;i<=b;++i) //T,N ...

- 6.Python中内存是如何管理的?

Python中内存是如何管理的? Python memory is managed by Python private heap space. All Python objects and data ...

- WordPress发布文章/页面时自动添加默认的自定义字段

如果你每篇文章或页面都需要插入同一个自定义字段和值,可以考虑在WordPress发布文章/页面时,自动添加默认的自定义字段.将下面的代码添加到当前主题的 functions.php 即可: 1 2 3 ...

- 图论--最长路--洛谷P1807 最长路_NOI导刊2010提高(07)

题目描述 设G为有n个顶点的有向无环图,G中各顶点的编号为1到n,且当为G中的一条边时有i < j.设w(i,j)为边的长度,请设计算法,计算图G中<1,n>间的最长路径. 输入格式 ...

- java基于socket的网络通信,实现一个服务端多个客户端的群聊,传输文件功能,界面使用Swing

最近在复习java的io流及网络编程.但复习写那些样板程序总是乏味的.便准备写个项目来巩固.想来想去还是聊天项目比较好玩.如果日后完成的比较好自己也可以用(哈哈哈).并且自己后面也要继续巩固java多 ...

- libevent(八)激活事件

激活事件添加流程 事件发生后,需要把对应的event加入到激活事件队列中. 整个流程如下: 对于定时器事件,在timeout_process过程中,会将事件从最小堆中删除. 激活事件处理流程 在eve ...

- B. Math Show 暴力 C - Four Segments

B. Math Show 这个题目直接暴力,还是有点难想,我没有想出来,有点思维. #include <cstdio> #include <cstdlib> #include ...

- restful 架构风格的curd(增删改查)

restful架构 概念:REST指的是一组架构约束条件和原则,如果一个架构符合REST的约束条件和原则,就称之为RESTful架构. restful不是一个专门的技术,他是一个规范.规范就是写写代码 ...