Python爬虫刷回复

最近闲的无聊,就想着去看看爬虫,顺着爬虫顺利的做到了模拟登录、刷帖子等等,这里简要说一下。

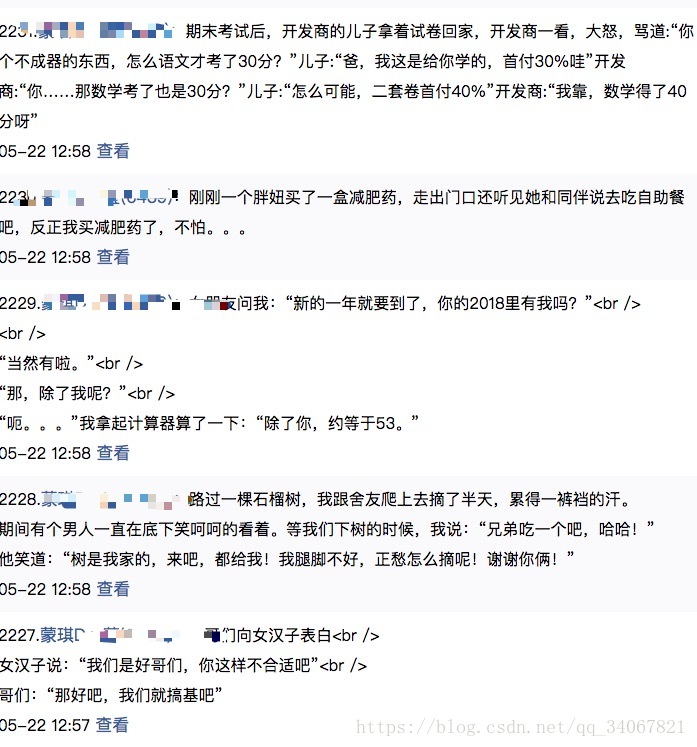

使用Python2.7写的爬虫,对某论坛做模拟登陆和刷帖子、回复等等,由于之前是没有接触过爬虫,这次之后感觉爬虫很强大,能做很多事,先来贴几张图。

由于论坛不让使用相同的文字,所以调用了笑话的api,达到不同文字的目的。

该论坛使用的是cookie,所以先去获取一下cookie,顺便将cookie写到文件里面。

'''

获取cookie

'''

def get_cookie(login_data, url, testurl=None):

filename = "cookie"

cookie = cookielib.MozillaCookieJar(filename)

hadler = urllib2.HTTPCookieProcessor(cookie)

opener = urllib2.build_opener(hadler)

post_data = urllib.urlencode(

{'logname': 123456, "logpass": "123456", "action": "login", })

url = 'http://*****.me/waplogin.aspx'

opener.open(url, post_data)

cookie.save(ignore_discard=True, ignore_expires=True)

print("获取成功")

# print(opener.open(testurl).read())先要分析该网站登录地址,登录需要的参数,如上代码

获得cookie之后,分析该论坛的回复参数,该论坛采用的是post提交,需要有帖子id,回复内容等等,分析之后得到如下代码

代码先加载文件里面的cookie,然后调用了haha这个笑话api,当然我已经将这个api的json进行了处理,这里只要笑话内容就行。

'''

回复帖子

'''

def post_reply():

filename = "cookie"

cookie = cookielib.MozillaCookieJar(filename)

cookie.load(filename, ignore_discard=True, ignore_expires=True)

handler = urllib2.HTTPCookieProcessor(cookie)

opener = urllib2.build_opener(handler)

num=0

for i in range(216255, 800000):

num = num + 1

huifu = urllib.urlencode(

{'sendmsg': 0, "content": str(haha(num)), "action": "add", "id": str(i), "classid": 177})

gradeUrl = 'http://******.me/bbs/book_re.aspx'

result = opener.open(gradeUrl)

print result.read()

print "当前第" + str(num) + "" + "次回帖"

print("当前帖子id" + str(i))

sleep(1)发帖子代码:

'''

发帖子(普通帖子或者加悬赏分的帖子:并不是悬赏板块的帖子)

'''

def post_articles(book_title, book_content, classid=177, sendmoney=0):

filename = "cookie"

cookie = cookielib.MozillaCookieJar(filename)

cookie.load(filename, ignore_discard=True, ignore_expires=True)

handler = urllib2.HTTPCookieProcessor(cookie)

opener = urllib2.build_opener(handler)

post_articles = urllib.urlencode(

{'sendmsg': 0, "book_title": str(book_title), "action": "gomod", "siteid": "1000",

"book_content": str(book_content), "classid": classid, "sendmoney": sendmoney})

gradeUrl = 'http://*****.me/bbs/book_view_add.aspx'

result = opener.open(gradeUrl, post_articles)

print(result.read())

将这些代码进行进行调用就可以去刷回复了。

Python爬虫刷回复的更多相关文章

- python 爬虫刷访问量

import urllib.requestimport time # 使用build_opener()是为了让python程序模仿浏览器进行访问opener = urllib.request.buil ...

- 利用Python爬虫刷店铺微博等访问量最简单有效教程

一.安装必要插件 测试环境:Windows 10 + Python 3.7.0 (1)安装Selenium pip install selenium (2)安装Requests pip install ...

- Python爬虫帮你打包下载所有抖音好听的背景音乐,还不快收藏一起听歌【华为云技术分享】

版权声明:本文为博主原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明. 本文链接:https://blog.csdn.net/devcloud/article/detai ...

- python爬虫学习(7) —— 爬取你的AC代码

上一篇文章中,我们介绍了python爬虫利器--requests,并且拿HDU做了小测试. 这篇文章,我们来爬取一下自己AC的代码. 1 确定ac代码对应的页面 如下图所示,我们一般情况可以通过该顺序 ...

- [python爬虫] Selenium定向爬取海量精美图片及搜索引擎杂谈

我自认为这是自己写过博客中一篇比较优秀的文章,同时也是在深夜凌晨2点满怀着激情和愉悦之心完成的.首先通过这篇文章,你能学到以下几点: 1.可以了解Python简单爬取图片的一些思路和方法 ...

- 【Python爬虫】入门知识

爬虫基本知识 这阵子需要用爬虫做点事情,于是系统的学习了一下python爬虫,觉得还挺有意思的,比我想象中的能干更多的事情,这里记录下学习的经历. 网上有关爬虫的资料特别多,写的都挺复杂的,我这里不打 ...

- Python爬虫实例:爬取猫眼电影——破解字体反爬

字体反爬 字体反爬也就是自定义字体反爬,通过调用自定义的字体文件来渲染网页中的文字,而网页中的文字不再是文字,而是相应的字体编码,通过复制或者简单的采集是无法采集到编码后的文字内容的. 现在貌似不少网 ...

- Python爬虫基础之认识爬虫

一.前言 爬虫Spider什么的,老早就听别人说过,感觉挺高大上的东西,爬网页,爬链接~~~dos黑屏的数据刷刷刷不断地往上冒,看着就爽,漂亮的校花照片,音乐网站的歌曲,笑话.段子应有尽有,全部都过来 ...

- Python爬虫之诗歌接龙

介绍 本文将展示如何利用Python爬虫来实现诗歌接龙. 该项目的思路如下: 利用爬虫爬取诗歌,制作诗歌语料库: 将诗歌分句,形成字典:键(key)为该句首字的拼音,值(value)为该拼音对 ...

随机推荐

- #C++初学记录#日常学习函数

静态变量static,只进行一次初始化. #include<cstring> #include<iostream> using namespace std; int main( ...

- 固定权重 关于Mxnet的一些基础知识理解(1)

https://blog.csdn.net/pandav5/article/details/53993684 (1)Mxnet的数据格式为NDArray,当需要读取可观看的数据,就要调用: numpy ...

- Android开发--IntentService的用法,你错过了什么

Android开发--IntentService的用法,你错过了什么 . 本文链接:https://blog.csdn.net/smbroe/article/details/45009721 Inte ...

- Java之Object对象中的wait()和notifyAll()用法

用一个例子来说明Object对象中的wait方法和notifyAll方法的使用. 首先定义一个消息类,用于封装数据,以供读写线程进行操作: /** * 消息 * * @author syj */ pu ...

- SeetaFaceEngine2 实例

LOG: Creating layer(6):LOG: Creating layer(0):LOG: Creating layer(9):LOG: Creating layer(0):LOG: Cre ...

- 判断本网段有多少可用的ip地址

为了提高效率,使用多线程方式同时ping. 但是如果开启255个线程,又会因为网络端口太拥挤,会被判定为无法ping通.所以本例使用java自带线程池,线程池的连接数还不能太大,启动了15个线程. 等 ...

- NativeExcel3使用示例

除了XLSReadWriteII5,还有个NativeExcel也是比较好的操作excel的组件,现将NativeExcel3的使用示例写一下,以下是代码和生成的excel表格的效果: procedu ...

- Java EE互联网轻量级框架整合开发— SSM框架(中文版带书签)、原书代码

Java EE互联网轻量级框架整合开发 第1部分 入门和技术基础 第1章 认识SSM框架和Redis 2 1.1 Spring框架 2 1.2 MyBatis简介 6 1.3 Spring MVC简介 ...

- Shell中 2>/dev/null

1.文件描述符 Linux系统预留可三个文件描述符:0.1和2,他们的意义如下所示: 0——标准输入(stdin) 1——标准输出(stdout) 2——标准错误(stderr) 标准输出——stdo ...

- 通过pathinfo返回扩展名

strtolower(pathinfo(abs.php,PATHINFO_EXTENSION)); 小写 通过pathinfo返回扩展名 pathinfo() 函数以数组的形式返回文件路径的信息. p ...