重新发现梯度下降法--backtracking line search

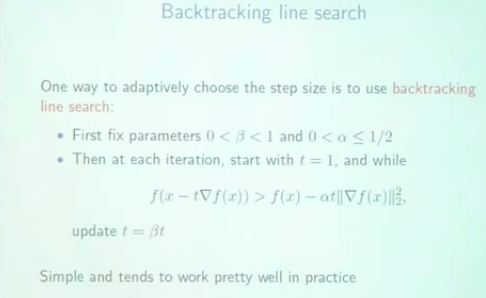

一直以为梯度下降很简单的,结果最近发现我写的一个梯度下降特别慢,后来终于找到原因:step size的选择很关键,有一种叫backtracking line search的梯度下降法就非常高效,该算法描述见下图:

下面用一个简单的例子来展示,给一个无约束优化问题:

minimize y = (x-3)*(x-3)

下面是python代码,比较两种方法

# -*- coding: cp936 -*-

#optimization test, y = (x-3)^2

from matplotlib.pyplot import figure, hold, plot, show, xlabel, ylabel, legend

def f(x):

"The function we want to minimize"

return (x-3)**2

def f_grad(x):

"gradient of function f"

return 2*(x-3)

x = 0

y = f(x)

err = 1.0

maxIter = 300

curve = [y]

it = 0

step = 0.1

#下面展示的是我之前用的方法,看上去貌似还挺合理的,但是很慢

while err > 1e-4 and it < maxIter:

it += 1

gradient = f_grad(x)

new_x = x - gradient * step

new_y = f(new_x)

new_err = abs(new_y - y)

if new_y > y: #如果出现divergence的迹象,就减小step size

step *= 0.8

err, x, y = new_err, new_x, new_y

print 'err:', err, ', y:', y

curve.append(y) print 'iterations: ', it

figure(); hold(True); plot(curve, 'r*-')

xlabel('iterations'); ylabel('objective function value') #下面展示的是backtracking line search,速度很快

x = 0

y = f(x)

err = 1.0

alpha = 0.25

beta = 0.8

curve2 = [y]

it = 0 while err > 1e-4 and it < maxIter:

it += 1

gradient = f_grad(x)

step = 1.0

while f(x - step * gradient) > y - alpha * step * gradient**2:

step *= beta

x = x - step * gradient

new_y = f(x)

err = y - new_y

y = new_y

print 'err:', err, ', y:', y

curve2.append(y) print 'iterations: ', it

plot(curve2, 'bo-')

legend(['gradient descent I used', 'backtracking line search'])

show()

运行结果如下图:

孰优孰劣,一目了然

我的方法用了25次迭代,而backtracking line search只用了6次。(而且之前我用的方法不一定会收敛的,比如你把第一种方法的stepsize改成1,就会发现,没有收敛到最优解就停止了,这是一个bug,要注意)

这只是个toy example,在我真实使用的优化问题上,两者的效率差别更加显著,估计有10倍的样子

--

文章中截图来自:https://www.youtube.com/watch?v=nvZF-t2ltSM

(是cmu的优化课程)

重新发现梯度下降法--backtracking line search的更多相关文章

- Backtracking line search的理解

使用梯度下降方法求解凸优化问题的时候,会遇到一个问题,选择什么样的梯度下降步长才合适. 假设优化函数为,若每次梯度下降的步长都固定,则可能出现左图所示的情况,无法收敛.若每次步长都很小,则下降速度非常 ...

- 【原创】回溯线搜索 Backtracking line search

机器学习中很多数值优化算法都会用到线搜索(line search).线搜索的目的是在搜索方向上找到是目标函数\(f(x)\)最小的点.然而,精确找到最小点比较耗时,由于搜索方向本来就是近似,所以用较小 ...

- Line Search and Quasi-Newton Methods 线性搜索与拟牛顿法

Gradient Descent 机器学习中很多模型的参数估计都要用到优化算法,梯度下降是其中最简单也用得最多的优化算法之一.梯度下降(Gradient Descent)[3]也被称之为最快梯度(St ...

- Line Search and Quasi-Newton Methods

Gradient Descent 机器学习中很多模型的参数估计都要用到优化算法,梯度下降是其中最简单也用得最多的优化算法之一.梯度下降(Gradient Descent)[3]也被称之为最快梯度(St ...

- 线搜索(line search)方法

在机器学习中, 通常需要求某个函数的最值(比如最大似然中需要求的似然的最大值). 线搜索(line search)是求得一个函数\(f(x)\)的最值的两种常用迭代方法之一(另外一个是trust re ...

- 机器学习基础——梯度下降法(Gradient Descent)

机器学习基础--梯度下降法(Gradient Descent) 看了coursea的机器学习课,知道了梯度下降法.一开始只是对其做了下简单的了解.随着内容的深入,发现梯度下降法在很多算法中都用的到,除 ...

- line search中的重要定理 - 梯度与方向的点积为零

转载请注明出处:http://www.codelast.com/ 对精确的line search(线搜索),有一个重要的定理: ∇f(xk+αkdk)Tdk=0 这个定理表明,当前点在dk方向上移动到 ...

- 『科学计算_理论』优化算法:梯度下降法&牛顿法

梯度下降法 梯度下降法用来求解目标函数的极值.这个极值是给定模型给定数据之后在参数空间中搜索找到的.迭代过程为: 可以看出,梯度下降法更新参数的方式为目标函数在当前参数取值下的梯度值,前面再加上一个步 ...

- [DeeplearningAI笔记]改善深层神经网络_优化算法2.1_2.2_mini-batch梯度下降法

觉得有用的话,欢迎一起讨论相互学习~Follow Me 2.1 mini-batch gradient descent mini-batch梯度下降法 我们将训练数据组合到一个大的矩阵中 \(X=\b ...

随机推荐

- MVP

引自: http://www.cnblogs.com/Leo_wl/archive/2013/05/03/3056299.html http://www.codeproject.com/Article ...

- 字符串匹配算法之SimHash算法

SimHash算法 由于实验室和互联网基本没啥关系,也就从来没有关注过数据挖掘相关的东西.在实际工作中,第一次接触到匹配和聚类等工作,虽然用一些简单的匹配算法可以做小数据的聚类,但数据量达到一定的时候 ...

- [ACM_图论] ZOJ 3708 [Density of Power Network 线路密度,a->b=b->a去重]

The vast power system is the most complicated man-made system and the greatest engineering innovatio ...

- IBM的“认知计算时代”

IBM 提出信息技术进入“认知计算时代”.所有电子设备都有潜力发展出认知能力,换言之,都可以像人一样‘思考’. 何为认知计算时代呢? 认知计算系统能够学习并与人类自然地交流,以扩展人类或机器可亲自执 ...

- 不要过早退出循环 while(1){no break}

我们在尝试新的事物的时候,总是会遇到各种各样的困难,不同的人会在碰壁不同的次数之后退出.用程序员喜欢的话来说就是,我们都在for循环,区别在于你是什么情况下break的.有的人退出阈值高,这是能坚持的 ...

- java包装类的作用

转载自http://zhidao.baidu.com/question/2052192149152534987.html 第一,基本数据类型之间的相互转换不是都可以制动转换的,而你强制转换又会出问题, ...

- Cocoa编程开发者手册

Cocoa编程开发者手册(Objective-C权威著作超一流翻译阵容) [美] 奇斯纳尔(Chisnall,D.) 著 霍炬等 译 ISBN 978-7-121-12239-2 2013年7月出版 ...

- 如何将 DVD 转成 ISO

Windows 电脑 + 光驱(Mac 下没找到类似 UltraISO 这么好用的软件,知道的朋友推荐一下哈) 安装 UltraISO 软件(试用版即可),http://baoku.360.cn/so ...

- TCP/IP 端口号大全

常用端口: 20 ftp-data FTP 数据端口 21 ftp 文件传输协议(FTP)端口:有时被文件服务协议(FSP)使用 22 ssh 安全 Shell(SSH)服务 23 telnet T ...

- Backbone.js Wine Cellar 教程

中文版: http://rd.189works.com/article-74541-1.html http://www.189works.com/article-74542-1.html http:/ ...