hugging face-基于pytorch-bert的中文文本分类

1、安装hugging face的transformers

pip install transformers

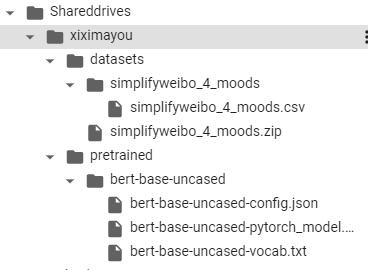

2、下载相关文件

字表:

wget http://52.216.242.246/models.huggingface.co/bert/bert-base-uncased-vocab.txt

配置文件:

wget http://52.216.242.246/models.huggingface.co/bert/bert-base-uncased-config.json

模型文件:

wget http://52.216.242.246/models.huggingface.co/bert/bert-base-uncased-pytorch_model.bin

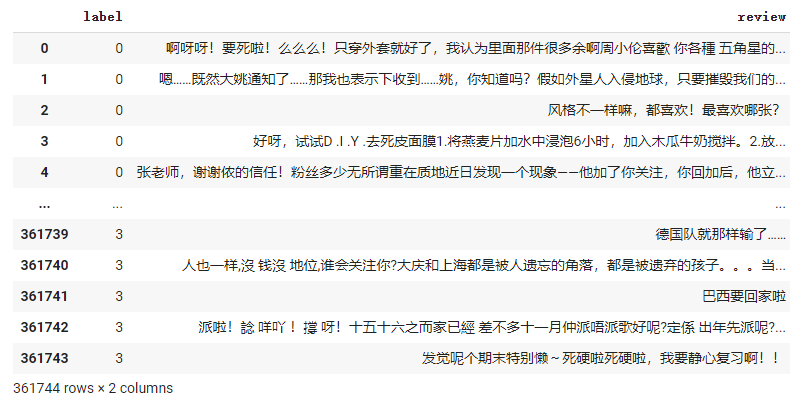

3、数据集

simplifyweibo_4_moods数据集:

数据集下载地址: https://pan.baidu.com/s/16c93E5x373nsGozyWevITg

36 万多条,带情感标注,包含 4 种情感,其中喜悦约 20 万条,愤怒、厌恶、低落各约 5 万条

0:喜悦 1:愤怒 2:厌恶 3:低落

4、完整代码

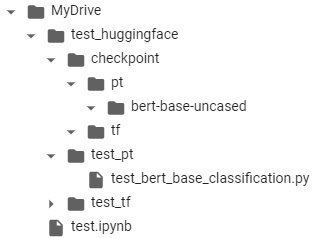

目录结构:谷歌colab中

import os

import pprint

import numpy as np

import pandas as pd

import random from transformers import BertTokenizer,BertConfig,BertForSequenceClassification,AdamW,AutoTokenizer,AutoModel

from transformers import get_linear_schedule_with_warmup

from sklearn.metrics import accuracy_score

from sklearn.metrics import classification_report

from sklearn.model_selection import train_test_split

import torch

from torch.utils.data import TensorDataset, DataLoader class MyBertModel:

def __init__(self,

train,

vocab_path,

config_path,

pretrain_Model_path,

saveModel_path,

learning_rate,

n_class,epochs,

batch_size,

val_batch_size,

max_len,

gpu=True):

self.n_class = n_class #类别数

self.max_len = max_len #句子最大长度

self.lr = learning_rate #学习率

self.epochs = epochs self.tokenizer = BertTokenizer.from_pretrained(vocab_path) #加载分词模型

text_list, labels = self.load_data(train) #加载训练数据集

train_x, val_x, train_y, val_y = self.split_train_val(text_list, labels)

self.train = self.process_data(train_x, train_y)

self.validation = self.process_data(val_x, val_y)

self.batch_size = batch_size #训练集的batch_size

self.val_batch_size = val_batch_size self.saveModel_path = saveModel_path #模型存储位置

self.gpu = gpu #是否使用gpu config = BertConfig.from_json_file(config_path) #加载bert模型配置信息

config.num_labels = n_class #设置分类模型的输出个数

self.model = BertForSequenceClassification.from_pretrained(pretrain_Model_path,config=config) #加载bert分类模型 if self.gpu:

seed = 42

random.seed(seed)

np.random.seed(seed)

torch.manual_seed(seed)

torch.cuda.manual_seed_all(seed)

torch.backends.cudnn.deterministic = True

self.device = torch.device('cuda')

else:

self.device = 'cpu' def encode_fn(self,text_list):

#将text_list embedding成bert模型可用的输入形式

#text_list:['我爱你','猫不是狗']

tokenizer = self.tokenizer(

text_list,

padding = True,

truncation = True,

max_length = self.max_len,

return_tensors='pt' # 返回的类型为pytorch tensor

)

input_ids = tokenizer['input_ids']

token_type_ids = tokenizer['token_type_ids']

attention_mask = tokenizer['attention_mask']

return input_ids,token_type_ids,attention_mask def load_data(self,path):

df = pd.read_csv(path)

text_list = df['review'].to_list()

labels = df['label'].to_list()

return text_list, labels def process_data(self, text_list, labels):

input_ids,token_type_ids,attention_mask = self.encode_fn(text_list)

labels = torch.tensor(labels)

data = TensorDataset(input_ids,token_type_ids,attention_mask,labels)

return data def split_train_val(self, data, labels):

train_x, val_x, train_y, val_y = train_test_split(data,

labels,

test_size = 0.2,

random_state = 0)

return train_x, val_x, train_y, val_y def flat_accuracy(self, preds, labels):

"""A function for calculating accuracy scores"""

pred_flat = np.argmax(preds, axis=1).flatten()

labels_flat = labels.flatten()

return accuracy_score(labels_flat, pred_flat) def train_model(self):

#训练模型

if self.gpu:

self.model.cuda()

optimizer = AdamW(self.model.parameters(), lr=self.lr)

trainData = DataLoader(self.train, batch_size = self.batch_size, shuffle = True) #处理成多个batch的形式

valData = DataLoader(self.validation, batch_size = self.val_batch_size, shuffle = True) total_steps = len(trainData) * self.epochs

scheduler = get_linear_schedule_with_warmup(optimizer, num_warmup_steps=0, num_training_steps=total_steps) for epoch in range(self.epochs):

self.model.train()

total_loss, total_val_loss = 0, 0

total_eval_accuracy = 0

print('epoch:' , epoch , ', step_number:' , len(trainData))

#训练

for step,batch in enumerate(trainData):

outputs = self.model(input_ids = batch[0].to(self.device),

token_type_ids=batch[1].to(self.device),

attention_mask=batch[2].to(self.device),

labels=batch[3].to(self.device)

) #输出loss 和 每个分类对应的输出,softmax后才是预测是对应分类的概率

loss, logits = outputs.loss, outputs.logits

total_loss += loss.item()

loss.backward()

torch.nn.utils.clip_grad_norm_(self.model.parameters(), 1.0)

optimizer.step()

scheduler.step()

if step % 10 == 0 and step > 0: #每10步输出一下训练的结果,flat_accuracy()会对logits进行softmax

self.model.eval()

logits = logits.detach().cpu().numpy()

label_ids = batch[3].cuda().data.cpu().numpy()

avg_val_accuracy = self.flat_accuracy(logits, label_ids)

print('step:' , step)

print(f'Accuracy: {avg_val_accuracy:.4f}')

print('\n')

#每个epoch结束,就使用validation数据集评估一次模型

self.model.eval()

print('testing ....')

for i, batch in enumerate(valData):

with torch.no_grad():

loss, logits = self.model(input_ids=batch[0].to(self.device),

token_type_ids=batch[1].to(self.device),

attention_mask=batch[2].to(self.device),

labels=batch[3].to(self.device)

)

total_val_loss += loss.item() logits = logits.detach().cpu().numpy()

label_ids = batch[3].cuda().data.cpu().numpy()

total_eval_accuracy += self.flat_accuracy(logits, label_ids) avg_train_loss = total_loss / len(trainData)

avg_val_loss = total_val_loss / len(valData)

avg_val_accuracy = total_eval_accuracy / len(valData) print(f'Train loss : {avg_train_loss}')

print(f'Validation loss: {avg_val_loss}')

print(f'Accuracy: {avg_val_accuracy:.4f}')

print('\n')

self.save_model(self.saveModel_path + '-' + str(epoch)) def save_model(self , path):

#保存分词模型和分类模型

self.model.save_pretrained(path)

self.tokenizer.save_pretrained(path) def load_model(self,path):

#加载分词模型和分类模型

tokenizer = AutoTokenizer.from_pretrained(path)

model = BertForSequenceClassification.from_pretrained(path)

return tokenizer,model def eval_model(self,Tokenizer, model,text_list,y_true):

#输出模型的召回率、准确率、f1-score

preds = self.predict_batch(Tokenizer, model, text_list)

print(classification_report(y_true,preds)) def predict_batch(self, Tokenizer, model, text_list):

tokenizer = Tokenizer(

text_list,

padding = True,

truncation = True,

max_length = self.max_len,

return_tensors='pt' # 返回的类型为pytorch tensor

)

input_ids = tokenizer['input_ids']

token_type_ids = tokenizer['token_type_ids']

attention_mask = tokenizer['attention_mask']

pred_data = TensorDataset(input_ids,token_type_ids,attention_mask)

pred_dataloader = DataLoader(pred_data, batch_size=self.batch_size, shuffle=False)

model = model.to(self.device)

model.eval()

preds = []

for i, batch in enumerate(pred_dataloader):

with torch.no_grad():

outputs = model(input_ids=batch[0].to(self.device),

token_type_ids=batch[1].to(self.device),

attention_mask=batch[2].to(self.device)

)

logits = outputs[0]

logits = logits.detach().cpu().numpy()

preds += list(np.argmax(logits, axis=1))

return preds

if __name__ == '__main__':

epoch = 3 pretrained_path = "/content/drive/Shareddrives/xiximayou/pretrained/bert-base-uncased"

dataset_path = "/content/drive/Shareddrives/xiximayou/datasets"

save_path = "/content/drive/MyDrive/test_hugging face/checkpoint"

train_path = os.path.join(dataset_path, "simplifyweibo_4_moods/simplifyweibo_4_moods.csv")

save_model_path = os.path.join(dataset_path, "pt/bert-base-uncased")

bert_tokenizer_path = os.path.join(pretrained_path, "bert-base-uncased-vocab.txt")

bert_config_path = os.path.join(pretrained_path, "bert-base-uncased-config.json")

bert_model_path = os.path.join(pretrained_path, "bert-base-uncased-pytorch_model.bin")

model_name = "bert_weibo"

myBertModel = MyBertModel(

train = train_path,

vocab_path = bert_tokenizer_path,

config_path = bert_config_path,

pretrain_Model_path = bert_model_path,

saveModel_path = os.path.join(save_model_path, model_name),

learning_rate = 2e-5,

n_class = 4,

epochs = epoch,

batch_size = 4,

val_batch_size = 4,

max_len = 100 ,

gpu = True

)

myBertModel.train_model()

Tokenizer, model = myBertModel.load_model(myBertModel.saveModel_path + '-'+ str(epoch-1))

#text_list, y_true = myBertModel.load_data_predict('xxx.csv')

#myBertModel.eval_model(Tokenizer, model,text_list,y_true)

使用模型得到的输出是:

SequenceClassifierOutput(loss=tensor(1.2209, device='cuda:0', grad_fn=<NllLossBackward>), logits=tensor([[-0.0275, -0.2090, -0.1251, -0.2942],

[ 0.0310, -0.2028, -0.1399, -0.3605],

[-0.0671, -0.3543, -0.1225, -0.4625],

[ 0.1389, -0.1244, -0.2310, -0.3664]], device='cuda:0',

grad_fn=<AddmmBackward>), hidden_states=None, attentions=None)

因此我们使用outputs.loss和outputs.logits来获得相关的值。

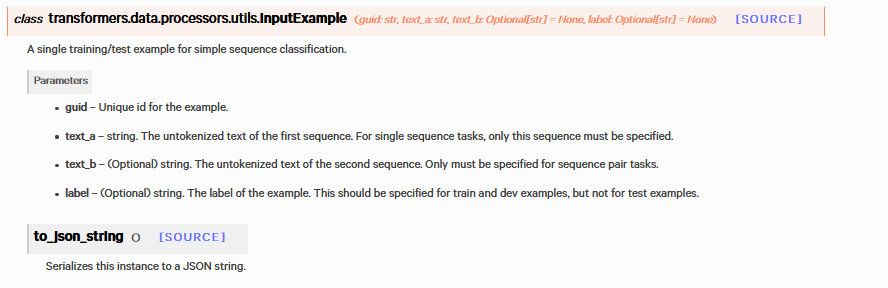

- tokenizer的输入和输出;

- warm up的使用;

- 使用的模型接口是BertForSequenceClassification,我们只需要修改类别数为自己的类别就行了,这里的类别是4,

from transformers import (

DataProcessor,

InputExample,

BertConfig,

BertTokenizer,

BertForSequenceClassification,

glue_convert_examples_to_features,

)

import torch.nn as nn

import torch

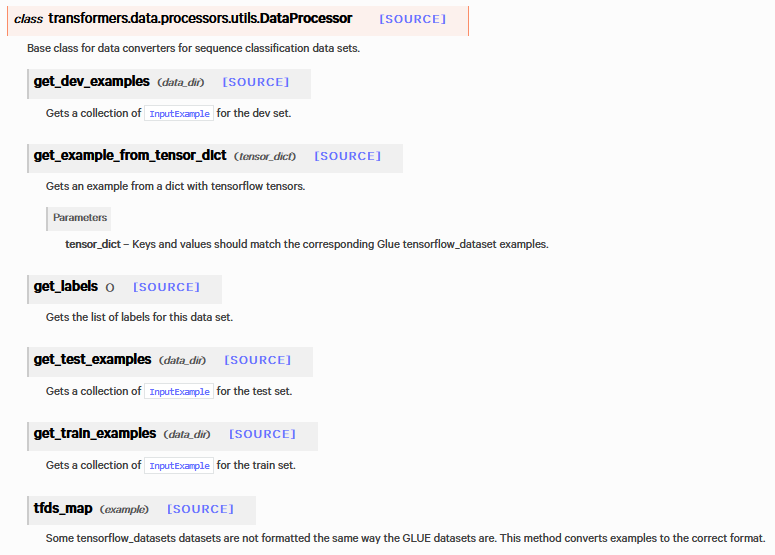

class Processor(DataProcessor):

def __init__(self):

super(DataProcessor,self).__init__()

"""实体链接数据处理""" def get_train_examples(self, inputexample):

return self._create_examples(

lines,

labels,

set_type='train',

) def get_test_examples(self, inputexample):

return self._create_examples(

lines,

labels,

set_type='test',

) def get_labels(self):

return [0, 1] def _create_examples(self, lines, labels,set_type):# 将

document_examples=[]

for i, document in enumerate(lines):

sentence_examples = []

for j,sentence in enumerate(document): guid = f'{set_type}-{i}-{j}'

text_a = sentence label = labels[i][j]

sentence_examples.append(InputExample(

guid=guid,

text_a=text_a,

label=label,

))

document_examples.append(sentence_examples)

return document_examples

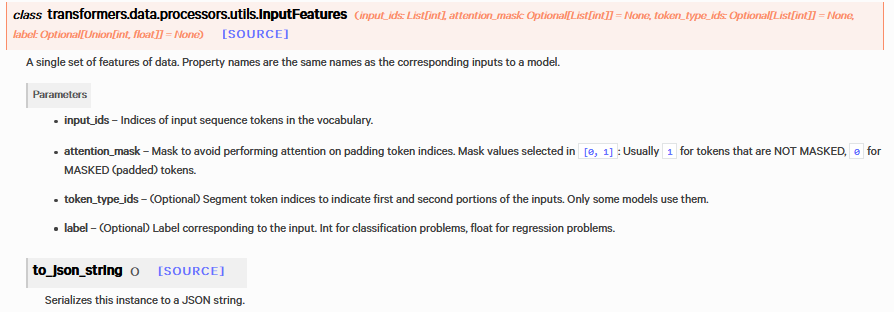

def _create_features(self,document_examples):

features = []

for document_example in document_examples:

examples = document_example document_features = glue_convert_examples_to_features(

examples,

tokenizer,

max_length=30,

label_list=get_labels(),

output_mode= 'classification' )

features.append(document_features)

return features def creat_train_dataloader(self,train_features):

dataloader =[]

for document_features in train_features: input_ids = torch.LongTensor([f.input_ids for f in document_features])

attention_mask = torch.LongTensor([f.attention_mask for f in document_features])

token_type_ids = torch.LongTensor([f.token_type_ids for f in document_features])

labels = torch.LongTensor([f.label for f in document_features])

batch = [input_ids,attention_mask,token_type_ids,labels]

dataloader.append(batch)

return dataloader

def generate_dataloader(self,data):

train_dataloader = self.creat_train_dataloader(self._create_features((self._create_examples(data[0],data[1],'train'))))

valid_dataloader = self.creat_train_dataloader(self._create_features((self._create_examples(data[2],data[3],'valid'))))

test_dataloader = self.creat_train_dataloader(self._create_features((self._create_examples(data[4],data[5],'test'))))

return train_dataloader,valid_dataloader,test_dataloader

继承DataProcessor类

hugging face-基于pytorch-bert的中文文本分类的更多相关文章

- Chinese-Text-Classification,用卷积神经网络基于 Tensorflow 实现的中文文本分类。

用卷积神经网络基于 Tensorflow 实现的中文文本分类 项目地址: https://github.com/fendouai/Chinese-Text-Classification 欢迎提问:ht ...

- 基于Text-CNN模型的中文文本分类实战 流川枫 发表于AI星球订阅

Text-CNN 1.文本分类 转眼学生生涯就结束了,在家待就业期间正好有一段空闲期,可以对曾经感兴趣的一些知识点进行总结. 本文介绍NLP中文本分类任务中核心流程进行了系统的介绍,文末给出一个基于T ...

- 基于Text-CNN模型的中文文本分类实战

Text-CNN 1.文本分类 转眼学生生涯就结束了,在家待就业期间正好有一段空闲期,可以对曾经感兴趣的一些知识点进行总结. 本文介绍NLP中文本分类任务中核心流程进行了系统的介绍,文末给出一个基于T ...

- 利用CNN进行中文文本分类(数据集是复旦中文语料)

利用TfidfVectorizer进行中文文本分类(数据集是复旦中文语料) 利用RNN进行中文文本分类(数据集是复旦中文语料) 上一节我们利用了RNN(GRU)对中文文本进行了分类,本节我们将继续使用 ...

- 万字总结Keras深度学习中文文本分类

摘要:文章将详细讲解Keras实现经典的深度学习文本分类算法,包括LSTM.BiLSTM.BiLSTM+Attention和CNN.TextCNN. 本文分享自华为云社区<Keras深度学习中文 ...

- 利用RNN进行中文文本分类(数据集是复旦中文语料)

利用TfidfVectorizer进行中文文本分类(数据集是复旦中文语料) 1.训练词向量 数据预处理参考利用TfidfVectorizer进行中文文本分类(数据集是复旦中文语料) ,现在我们有了分词 ...

- 基于Naive Bayes算法的文本分类

理论 什么是朴素贝叶斯算法? 朴素贝叶斯分类器是一种基于贝叶斯定理的弱分类器,所有朴素贝叶斯分类器都假定样本每个特征与其他特征都不相关.举个例子,如果一种水果其具有红,圆,直径大概3英寸等特征,该水果 ...

- 基于keras中IMDB的文本分类 demo

本次demo主题是使用keras对IMDB影评进行文本分类: import tensorflow as tf from tensorflow import keras import numpy a ...

- 中文文本分类之TextRNN

RNN模型由于具有短期记忆功能,因此天然就比较适合处理自然语言等序列问题,尤其是引入门控机制后,能够解决长期依赖问题,捕获输入样本之间的长距离联系.本文的模型是堆叠两层的LSTM和GRU模型,模型的结 ...

- 中文文本分类之CharCNN

文本分类是自然语言处理中一个非常经典的任务,可用的模型非常多,相关的开源代码也非常多了.这篇博客用一个CNN模型,对新闻文本进行分类. 全部代码有4个模块:1.数据处理模块(命名为:cnews_loa ...

随机推荐

- jQuery 第七章 实例方法 位置图形

位置坐标图形大小相关方法: .offset() .position() .scrollTop() .scrollLeft() .width() .height() .innerWidth() inne ...

- C语言编程学习者问答第一期,看看这些问题你出现过吗?

今天给大家分享我们学习基地的小伙伴遇到的问题,以及正确回答,看看这些问题你遇到过吗~ 1.这张图片文字"第二段"后面的说法是否有问题? 回答: 这是二进制的加法,很多人会误解减 ...

- 加快alter table

mysql的alter table操作的性能对打表来说是个大问题. mysql执行大部分修改表结构的方法是用新的结构创建一个空表,从旧表中查出所有的数据插入新表,然后删除旧表.这样操作就可能需要花费很 ...

- python应用(4):变量与流程

程序是什么?就是一堆代码啰.但是代码是有组织而来的,不是凭空堆砌出来的.有一个"古老"的说法:程序=数据结构+算法,意思是,程序是由一些数据结构(数据的组织结构)加上某些算法而形成 ...

- 冲刺随笔——Day_One

这个作业属于哪个课程 软件工程 (福州大学至诚学院 - 计算机工程系) 这个作业要求在哪里 团队作业第五次--Alpha冲刺 这个作业的目标 团队进行Alpha冲刺 作业正文 正文 其他参考文献 无 ...

- MacBook键盘锁定、按键失效、无反应等问题

目录 MacBook按键无反应 u,i,o,j,k,l等键失灵 capslock灯不亮 原文链接:joselynzhao·CSDN·MacBook键盘锁定.按键失效.无反应等问题 MacBook按键无 ...

- springmvc<二> 一些配置

1.1.3. Web MVC Config 1.1.2中的解析器可以自定义实现,DispatcherServlet检查每个特殊bean的WebApplicationContext,如果没有匹配的 ...

- Cypress系列(101)- intercept() 命令详解

如果想从头学起Cypress,可以看下面的系列文章哦 https://www.cnblogs.com/poloyy/category/1768839.html 作用 使用该命令在网络层管理 HTTP ...

- 第7.15节 Python中classmethod定义的类方法详解

第7.15节 Python中classmethod定义的类方法详解 类中的方法,除了实例方法外,还有两种方法,分别是类方法和静态方法.本节介绍类方法的定义和使用. 一. 类方法的定义 在类中定 ...

- PyQt(Python+Qt)学习随笔:树型部件QTreeWidget中当前列currentColumn和选中项selectedItems访问方法

老猿Python博文目录 专栏:使用PyQt开发图形界面Python应用 老猿Python博客地址 当前列访问方法 树型部件QTreeWidget的currentColumn()方法返回当前项中得到焦 ...